Think More, Hallucinate Less: Mitigating Hallucinations via Dual Process of Fast and Slow Thinking

作者: Xiaoxue Cheng, Junyi Li, Wayne Xin Zhao, Ji-Rong Wen

分类: cs.CL

发布日期: 2025-01-02 (更新: 2025-01-03)

💡 一句话要点

提出HaluSearch框架,通过快慢双重思维过程缓解大语言模型的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 幻觉缓解 树搜索 蒙特卡洛树搜索 双重过程理论 文本生成 自评估奖励模型

📋 核心要点

- 现有大语言模型采用自回归生成,缺乏推理过程,易产生幻觉和不准确的回复。

- HaluSearch框架通过树搜索算法模拟慢速思考,利用自评估奖励模型引导生成更可靠的文本。

- 实验结果表明,HaluSearch在英语和中文数据集上显著优于现有方法,有效缓解了幻觉问题。

📝 摘要(中文)

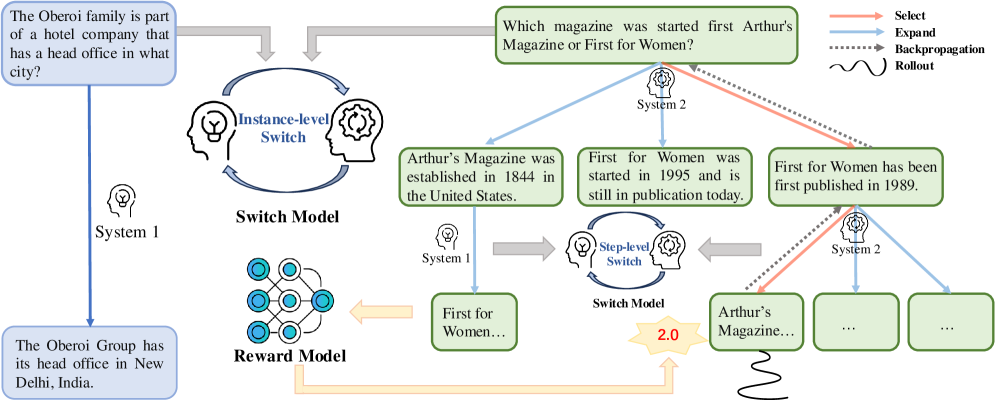

大型语言模型(LLMs)展现了卓越的能力,但仍然面临幻觉问题。典型的文本生成方法采用自回归生成,缺乏深思熟虑的推理,这常常导致不可信和事实不准确的响应。本文提出了HaluSearch,一种新颖的框架,它结合了基于树搜索的算法(例如MCTS),以实现显式的慢速思维生成过程,从而减轻LLMs在推理过程中的幻觉。具体来说,HaluSearch将文本生成构建为一个逐步推理过程,使用自评估奖励模型来对每个生成步骤进行评分,并引导树搜索找到最可靠的生成路径,以充分利用LLMs的内部知识。为了平衡效率和质量,我们引入了一种受认知科学中双重过程理论启发的层级思维系统切换机制,该机制在实例和步骤级别动态地在快速和慢速思维模式之间切换,从而适应问题的复杂性和推理状态。我们在英语和中文数据集上进行了广泛的实验,结果表明我们的方法明显优于基线方法。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在文本生成过程中出现的幻觉问题,即生成不真实或与事实相悖的内容。现有自回归生成方法缺乏明确的推理过程,导致模型依赖于记忆而非逻辑,从而容易产生幻觉。

核心思路:论文的核心思路是模拟人类的“快慢双重思维”过程。快速思维对应于传统的自回归生成,效率高但易出错;慢速思维则通过树搜索算法进行逐步推理和验证,提高生成内容的可靠性。通过动态切换两种思维模式,在保证效率的同时降低幻觉的发生。

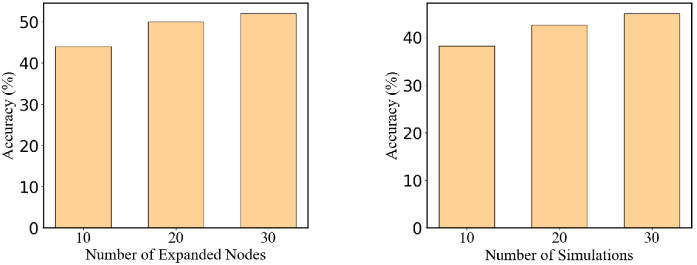

技术框架:HaluSearch框架包含以下几个主要模块:1) 文本生成模块:使用LLM进行文本生成,作为树搜索的节点扩展基础。2) 自评估奖励模型:评估每个生成步骤的质量和可靠性,为树搜索提供指导。3) 树搜索算法:例如蒙特卡洛树搜索(MCTS),用于探索不同的生成路径,选择最优的生成序列。4) 双重思维切换机制:根据问题复杂度和推理状态,动态地在快速和慢速思维模式之间切换。

关键创新:HaluSearch的关键创新在于将树搜索算法引入到LLM的文本生成过程中,模拟了人类的慢速思考过程,从而提高了生成内容的可靠性。此外,双重思维切换机制能够根据问题的复杂程度自适应地调整推理的深度,在效率和质量之间取得平衡。与现有方法相比,HaluSearch不再仅仅依赖于LLM的记忆,而是通过显式的推理过程来生成文本。

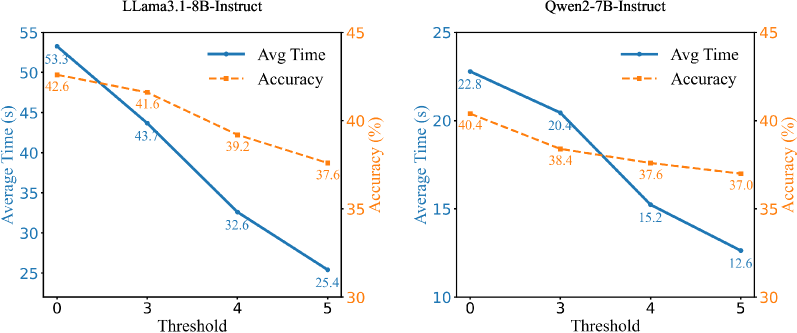

关键设计:自评估奖励模型的设计至关重要,需要能够准确地评估生成内容的质量和可靠性。奖励模型可以使用各种指标,例如事实一致性、逻辑连贯性等。双重思维切换机制需要根据问题复杂度和推理状态设定合理的切换阈值,以避免过度推理或推理不足。树搜索算法的参数,例如探索率和深度,也需要进行精细调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HaluSearch在多个英语和中文数据集上显著优于基线方法。例如,在某些数据集上,HaluSearch可以将LLM的幻觉率降低超过20%。此外,双重思维切换机制能够有效地平衡效率和质量,使得HaluSearch在保证生成质量的同时,不会显著降低生成速度。

🎯 应用场景

HaluSearch框架可应用于各种需要高质量文本生成的场景,例如问答系统、机器翻译、内容创作等。通过降低LLM的幻觉,可以提高这些应用的可信度和实用性。未来,该研究可以扩展到其他模态,例如图像和视频生成,以提高生成内容的一致性和真实性。

📄 摘要(原文)

Large language models (LLMs) demonstrate exceptional capabilities, yet still face the hallucination issue. Typical text generation approaches adopt an auto-regressive generation without deliberate reasoning, which often results in untrustworthy and factually inaccurate responses. In this paper, we propose HaluSearch, a novel framework that incorporates tree search-based algorithms (e.g. MCTS) to enable an explicit slow thinking generation process for mitigating hallucinations of LLMs during inference. Specifically, HaluSearch frames text generation as a step-by-step reasoning process, using a self-evaluation reward model to score each generation step and guide the tree search towards the most reliable generation pathway for fully exploiting the internal knowledge of LLMs. To balance efficiency and quality, we introduce a hierarchical thinking system switch mechanism inspired by the dual process theory in cognitive science, which dynamically alternates between fast and slow thinking modes at both the instance and step levels, adapting to the complexity of questions and reasoning states. We conduct extensive experiments on both English and Chinese datasets and the results show that our approach significantly outperforms baseline approaches.