Self-Refinement Strategies for LLM-based Product Attribute Value Extraction

作者: Alexander Brinkmann, Christian Bizer

分类: cs.CL

发布日期: 2025-01-02 (更新: 2025-02-14)

💡 一句话要点

研究表明,基于LLM的自精炼策略在产品属性值抽取任务中未能有效提升性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 产品属性值抽取 大型语言模型 自精炼 GPT-4o 电商 微调 零样本学习 少量样本学习

📋 核心要点

- 电商产品属性值抽取面临非结构化描述的挑战,需要有效方法提升数据质量和可用性。

- 论文探索了基于LLM的自精炼策略,包括错误驱动的提示重写和自我纠正,以期提升抽取性能。

- 实验结果表明,自精炼策略未能显著提升性能,反而增加了计算成本,微调在有开发数据时表现更优。

📝 摘要(中文)

结构化的产品数据,例如属性-值对,对于电商平台的功能(如分面搜索和基于属性的产品比较)至关重要。然而,供应商通常提供非结构化的产品描述,因此需要属性值抽取来确保数据一致性和可用性。大型语言模型(LLM)已展示了其在少量样本场景下进行产品属性值抽取的潜力。最近的研究表明,自精炼技术可以提高LLM在代码生成和文本到SQL翻译等任务中的性能。对于其他任务,由于处理额外token而导致成本增加,但并未实现任何性能提升。本文研究了将两种自精炼技术(基于错误的提示重写和自我纠正)应用于产品属性值抽取任务。使用GPT-4o在零样本、少量样本上下文学习和微调场景中评估了自精炼技术。实验表明,这两种自精炼技术都未能显著提高抽取性能,同时大幅增加了处理成本。对于具有开发数据的场景,微调产生最高的性能,并且随着产品描述数量的增加,微调的启动成本会得到平衡。

🔬 方法详解

问题定义:论文旨在解决电商领域中,从非结构化产品描述中准确抽取属性值的问题。现有方法,特别是直接应用大型语言模型(LLM),在抽取精度和效率上存在挑战。自精炼方法在其他任务上表现出潜力,但其在产品属性值抽取上的效果未知,且可能带来额外的计算成本。

核心思路:论文的核心思路是探索两种自精炼技术——基于错误的提示重写和自我纠正——在产品属性值抽取任务中的有效性。通过迭代地改进LLM的输出,期望提高抽取精度。然而,研究发现这些方法并未带来显著的性能提升,反而增加了计算成本。

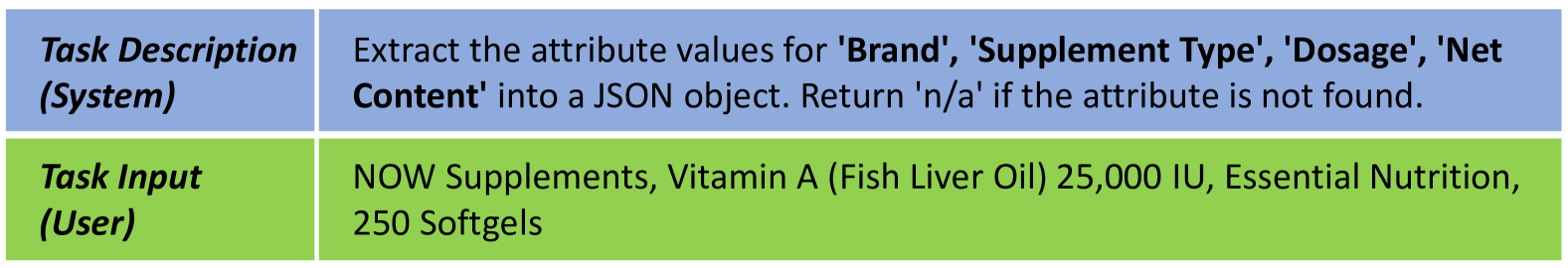

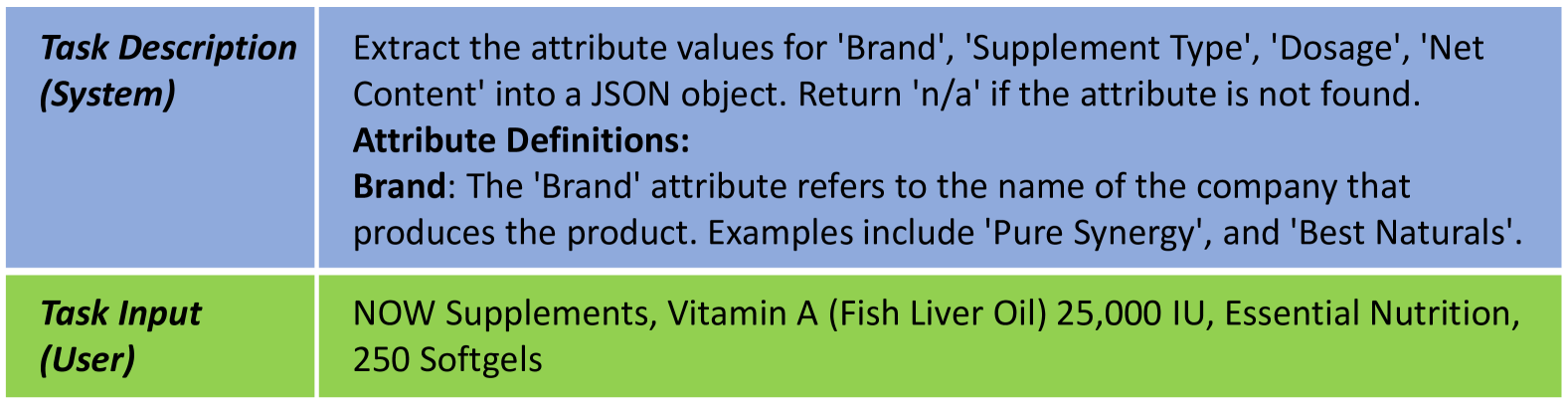

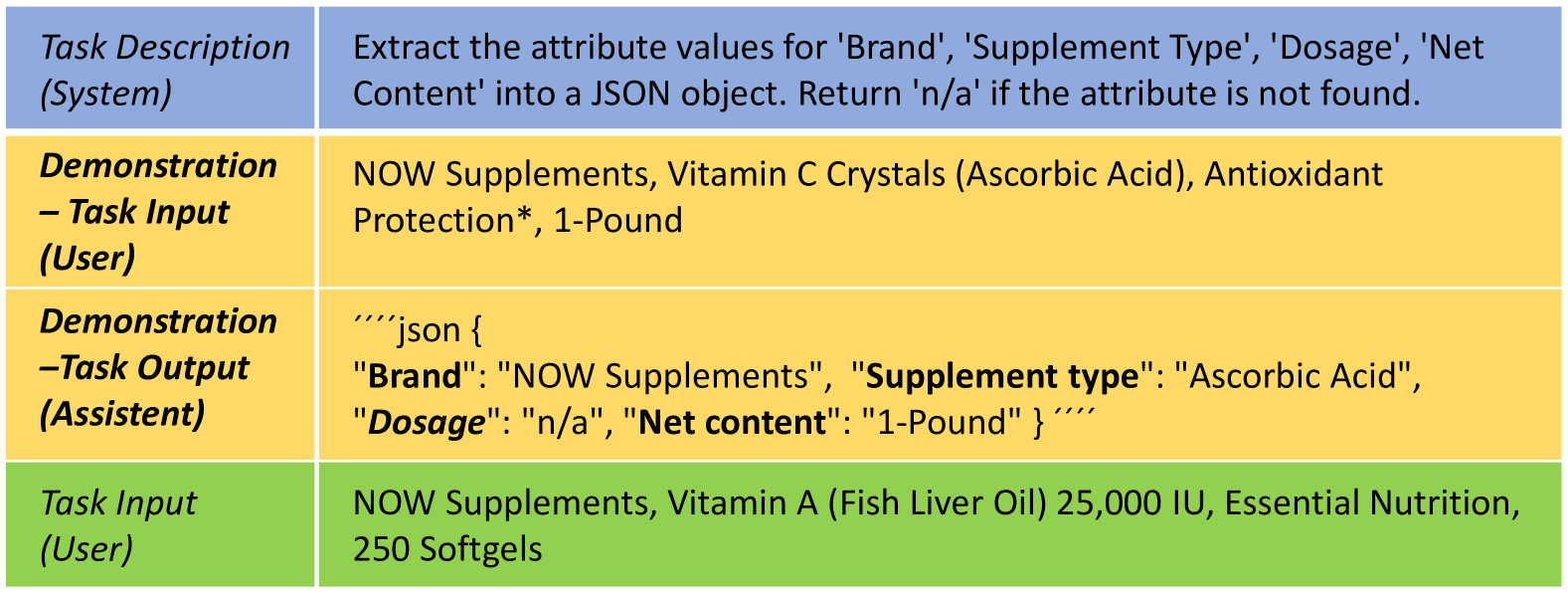

技术框架:研究采用GPT-4o作为基础LLM,并在三种场景下进行评估:零样本学习、少量样本上下文学习和微调。对于自精炼技术,首先使用LLM进行初始抽取,然后根据抽取结果的错误(例如,格式错误、值不正确)生成新的提示或进行自我纠正,再次使用LLM进行抽取。整个流程迭代进行,直到满足停止条件。

关键创新:论文的关键创新在于对自精炼技术在产品属性值抽取任务中的适用性进行了实证研究。虽然自精炼在其他任务中表现良好,但本研究表明其在该任务中并不有效。这一发现对于指导未来研究方向具有重要意义,避免了盲目地将自精炼应用于所有LLM任务。

关键设计:研究中,基于错误的提示重写通过分析LLM的初始输出,识别错误类型,并生成包含更明确指令的新提示。自我纠正则让LLM自行检查和修正其输出。实验中,研究人员仔细控制了提示的长度和复杂性,以避免引入额外的偏差。此外,还评估了不同迭代次数对性能的影响。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在产品属性值抽取任务中,自精炼策略(包括基于错误的提示重写和自我纠正)未能显著提高性能,反而增加了处理成本。相比之下,在具有开发数据的场景下,微调GPT-4o能够获得最高的性能。这表明,对于该任务,微调可能比自精炼更有效。

🎯 应用场景

该研究成果对电商平台的产品数据管理具有指导意义。虽然自精炼策略未显示出优势,但研究结果强调了微调在特定场景下的有效性。未来的研究可以探索更高效的微调方法,或开发专门针对产品属性值抽取的LLM架构,以提升数据质量和用户体验。

📄 摘要(原文)

Structured product data, in the form of attribute-value pairs, is essential for e-commerce platforms to support features such as faceted product search and attribute-based product comparison. However, vendors often provide unstructured product descriptions, making attribute value extraction necessary to ensure data consistency and usability. Large language models (LLMs) have demonstrated their potential for product attribute value extraction in few-shot scenarios. Recent research has shown that self-refinement techniques can improve the performance of LLMs on tasks such as code generation and text-to-SQL translation. For other tasks, the application of these techniques has resulted in increased costs due to processing additional tokens, without achieving any improvement in performance. This paper investigates applying two self-refinement techniques (error-based prompt rewriting and self-correction) to the product attribute value extraction task. The self-refinement techniques are evaluated across zero-shot, few-shot in-context learning, and fine-tuning scenarios using GPT-4o. The experiments show that both self-refinement techniques fail to significantly improve the extraction performance while substantially increasing processing costs. For scenarios with development data, fine-tuning yields the highest performance, while the ramp-up costs of fine-tuning are balanced out as the amount of product descriptions increases.