Exploring Information Processing in Large Language Models: Insights from Information Bottleneck Theory

作者: Zhou Yang, Zhengyu Qi, Zhaochun Ren, Zhikai Jia, Haizhou Sun, Xiaofei Zhu, Xiangwen Liao

分类: cs.CL, cs.AI

发布日期: 2025-01-02 (更新: 2025-01-06)

备注: 9 pages, 9 figures, 3 tables

💡 一句话要点

基于信息瓶颈理论探索大语言模型的信息处理机制,并提出IC-ICL和TS-FT方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 信息瓶颈理论 任务空间 上下文学习 微调 信息压缩 推理效率

📋 核心要点

- 现有大语言模型的内部信息处理机制尚不明确,阻碍了对其能力的深入理解和进一步优化。

- 论文提出基于信息瓶颈理论的分析框架,揭示LLM通过压缩信息到任务空间进行理解和预测的关键机制。

- 实验表明,基于该理论提出的IC-ICL和TS-FT方法,能有效提升LLM的推理性能和效率。

📝 摘要(中文)

大型语言模型(LLM)通过理解输入信息并预测相应的输出来展示了在各种任务中的卓越性能。然而,LLM理解输入并做出有效预测的内部机制仍然知之甚少。本文从信息瓶颈理论的角度探讨了LLM在信息处理中的工作机制。我们提出了一种非训练的构建策略来定义任务空间,并确定了以下关键发现:(1)LLM将输入信息压缩到特定的任务空间(例如,情感空间、主题空间)以促进任务理解;(2)它们在关键时刻从任务空间中提取和利用相关信息以生成准确的预测。基于这些见解,我们引入了两种新方法:基于信息压缩的上下文学习(IC-ICL)和任务空间引导的微调(TS-FT)。IC-ICL通过将检索到的示例信息压缩到任务空间来增强推理性能和推理效率。TS-FT采用空间引导的损失来微调LLM,鼓励学习更有效的压缩和选择机制。跨多个数据集的实验验证了任务空间构建的有效性。此外,IC-ICL不仅提高了性能,还将推理速度提高了40%以上,而TS-FT以最小的策略调整实现了卓越的结果。

🔬 方法详解

问题定义:现有的大语言模型(LLM)在各种任务中表现出色,但其内部如何处理信息以理解输入并生成准确预测的机制仍然是一个黑盒。缺乏对这些机制的理解限制了我们进一步改进LLM的能力,例如提高推理效率和性能。现有方法通常侧重于模型架构或训练数据的改进,而忽略了对LLM信息处理过程的深入分析。

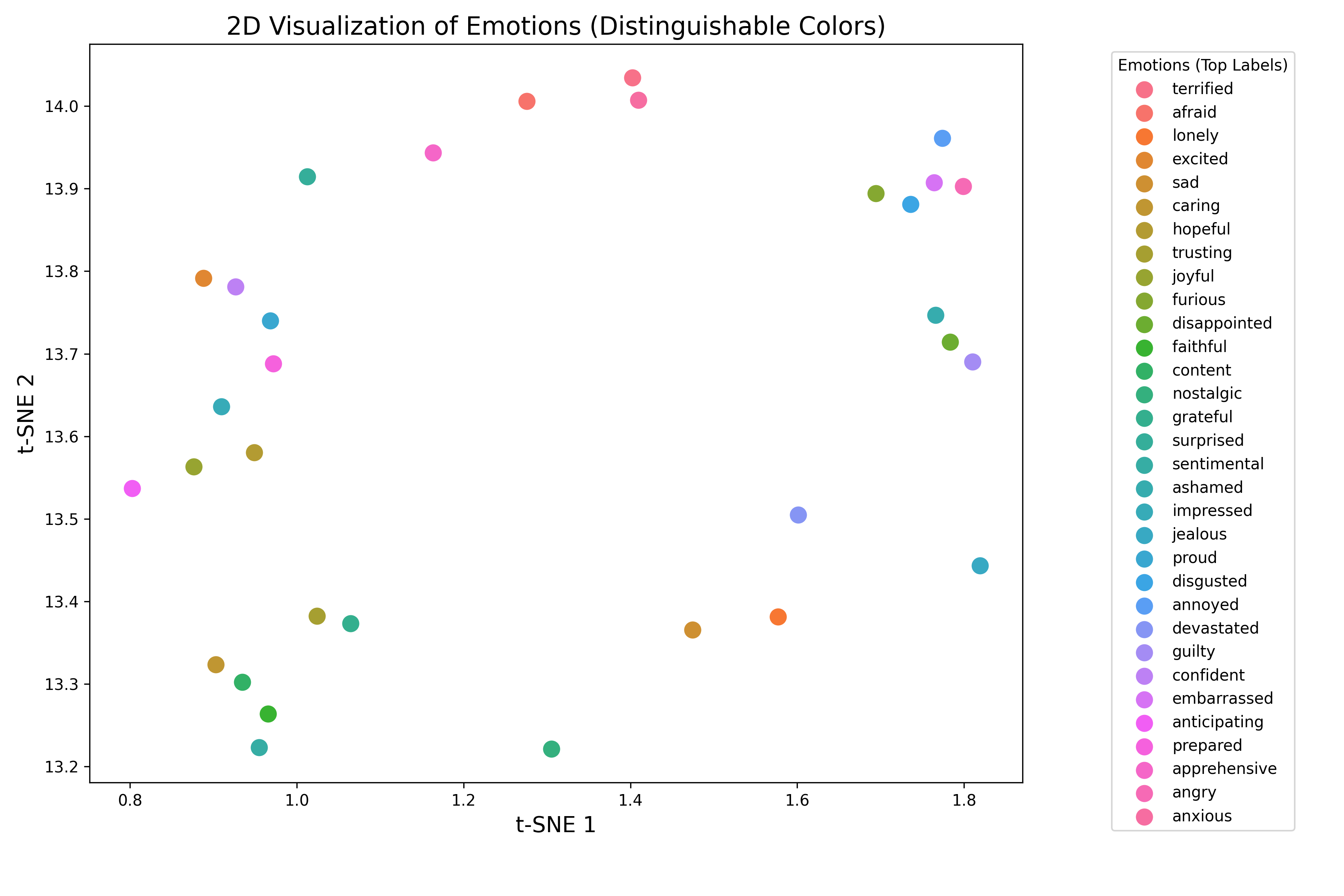

核心思路:本文的核心思路是从信息瓶颈(Information Bottleneck, IB)理论的角度来分析LLM的信息处理过程。IB理论认为,一个好的模型应该在压缩输入信息的同时,保留与目标任务最相关的信息。因此,论文假设LLM会将输入信息压缩到特定的“任务空间”,例如情感空间或主题空间,以便更好地理解任务并做出预测。通过显式地构建和利用这些任务空间,可以提高LLM的推理性能和效率。

技术框架:论文的技术框架主要包括三个部分:1) 任务空间的构建:提出一种非训练的策略来定义任务空间,例如通过聚类或降维等方法将输入信息映射到低维空间。2) 基于信息压缩的上下文学习(IC-ICL):将检索到的上下文示例压缩到任务空间,然后利用压缩后的信息进行推理。3) 任务空间引导的微调(TS-FT):设计一个空间引导的损失函数,鼓励LLM在微调过程中学习更有效的压缩和选择机制。

关键创新:论文的关键创新在于将信息瓶颈理论应用于分析和改进LLM的信息处理过程。通过显式地构建任务空间,并利用该空间来指导上下文学习和微调,可以更有效地利用LLM的内部知识。与现有方法相比,该方法提供了一种更具解释性和可控性的方式来优化LLM。

关键设计:IC-ICL的关键设计在于如何有效地将上下文示例压缩到任务空间。论文可能采用了诸如k-means聚类或PCA等方法来降低上下文示例的维度,并保留与任务最相关的信息。TS-FT的关键设计在于空间引导的损失函数,该损失函数可能包含一个正则化项,用于惩罚模型偏离任务空间的行为。具体的参数设置和网络结构细节在论文中应该有更详细的描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,IC-ICL方法在提高推理性能的同时,还能将推理速度提高40%以上。TS-FT方法通过最小的策略调整,实现了优于现有微调方法的结果。这些结果验证了任务空间构建的有效性,并表明基于信息瓶颈理论的优化方法具有显著的优势。

🎯 应用场景

该研究成果可应用于各种需要高效和精确推理的自然语言处理任务,例如情感分析、文本分类、问答系统等。通过信息压缩和任务空间引导,可以显著提高LLM在资源受限环境下的性能,并为开发更具解释性和可控性的LLM提供新的思路。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable performance across a wide range of tasks by understanding input information and predicting corresponding outputs. However, the internal mechanisms by which LLMs comprehend input and make effective predictions remain poorly understood. In this paper, we explore the working mechanism of LLMs in information processing from the perspective of Information Bottleneck Theory. We propose a non-training construction strategy to define a task space and identify the following key findings: (1) LLMs compress input information into specific task spaces (e.g., sentiment space, topic space) to facilitate task understanding; (2) they then extract and utilize relevant information from the task space at critical moments to generate accurate predictions. Based on these insights, we introduce two novel approaches: an Information Compression-based Context Learning (IC-ICL) and a Task-Space-guided Fine-Tuning (TS-FT). IC-ICL enhances reasoning performance and inference efficiency by compressing retrieved example information into the task space. TS-FT employs a space-guided loss to fine-tune LLMs, encouraging the learning of more effective compression and selection mechanisms. Experiments across multiple datasets validate the effectiveness of task space construction. Additionally, IC-ICL not only improves performance but also accelerates inference speed by over 40\%, while TS-FT achieves superior results with a minimal strategy adjustment.