AraSTEM: A Native Arabic Multiple Choice Question Benchmark for Evaluating LLMs Knowledge In STEM Subjects

作者: Ahmad Mustapha, Hadi Al-Khansa, Hadi Al-Mubasher, Aya Mourad, Ranam Hamoud, Hasan El-Husseini, Marwah Al-Sakkaf, Mariette Awad

分类: cs.CL, cs.AI

发布日期: 2024-12-31

💡 一句话要点

AraSTEM:用于评估LLM在STEM学科知识的阿拉伯语多选题基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 阿拉伯语 STEM教育 知识评估 多选题基准

📋 核心要点

- 现有LLM知识评估基准主要集中在英语,忽略了多语言LLM的阿拉伯语知识评估需求。

- AraSTEM数据集旨在通过阿拉伯语STEM多选题,评估LLM在科学、技术、工程和数学领域的知识。

- 实验结果表明,现有公开LLM在AraSTEM数据集上表现不佳,凸显了开发本地化阿拉伯语LLM的必要性。

📝 摘要(中文)

大型语言模型(LLM)不仅在生成类人文本方面表现出卓越的能力,而且在获取知识方面也表现出色。这突显了超越典型的自然语言处理下游基准,评估LLM的各个方面(包括知识和推理)的需求。已经开发了许多基准来评估LLM的知识,但它们主要集中在英语上。鉴于许多LLM是多语言的,仅仅依靠基准英语知识是不够的。为了解决这个问题,我们引入了AraSTEM,这是一个新的阿拉伯语多项选择题数据集,旨在评估LLM在STEM学科中的知识。该数据集涵盖了不同级别的各种主题,要求模型展示对科学阿拉伯语的深刻理解,以实现高准确率。我们的研究结果表明,各种规模的公开模型都在这个数据集上表现不佳,并强调了对更多本地化语言模型的需求。该数据集可在Hugging Face上免费访问。

🔬 方法详解

问题定义:论文旨在解决缺乏阿拉伯语STEM领域知识评估基准的问题。现有LLM主要在英语数据集上进行评估,无法有效衡量其在阿拉伯语科学知识方面的能力。这限制了对多语言LLM的全面评估,并阻碍了阿拉伯语本地化LLM的发展。

核心思路:论文的核心思路是构建一个高质量的阿拉伯语STEM多选题数据集,用于评估LLM在科学、技术、工程和数学领域的知识掌握程度。通过多选题的形式,可以方便地衡量LLM的知识准确性和推理能力。数据集的设计涵盖不同难度级别,以全面评估LLM的能力。

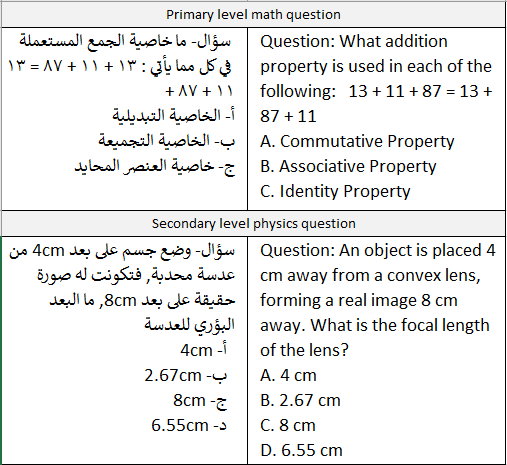

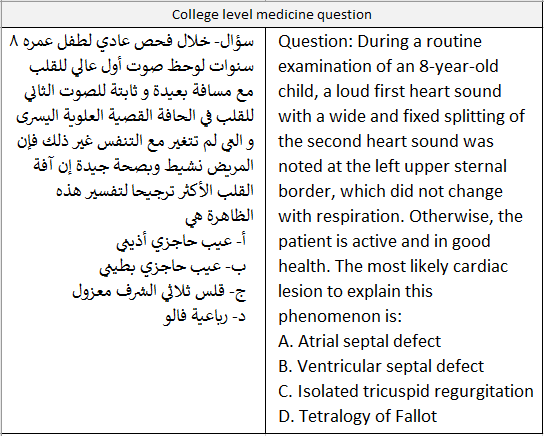

技术框架:AraSTEM数据集的构建主要包含以下几个阶段:1) 确定STEM学科的范围和主题;2) 设计多选题,包括题干、正确答案和干扰项;3) 对题目进行专家评审,确保其科学性和语言准确性;4) 将数据集发布在Hugging Face上,供研究人员使用。数据集涵盖了不同难度级别,以评估LLM在不同知识层次上的表现。

关键创新:AraSTEM数据集的主要创新在于它是首个专门用于评估LLM在阿拉伯语STEM领域知识的多选题基准。它填补了现有LLM评估体系中的空白,为研究人员提供了一个评估和改进阿拉伯语LLM的工具。此外,数据集的设计考虑了科学阿拉伯语的特点,确保了评估的有效性和准确性。

关键设计:AraSTEM数据集包含多个STEM学科的多选题,每个问题包含一个题干和四个选项(一个正确答案和三个干扰项)。题目的难度级别各不相同,涵盖了从基础知识到高级概念的范围。数据集的构建过程中,专家对题目进行了评审,以确保其科学性和语言准确性。数据集以JSON格式存储,方便研究人员使用。

🖼️ 关键图片

📊 实验亮点

研究结果表明,现有公开LLM在AraSTEM数据集上的表现普遍不佳,准确率远低于人类水平。这表明现有LLM在阿拉伯语STEM知识方面存在显著差距,需要进一步的研究和开发。该数据集的发布为研究人员提供了一个评估和改进阿拉伯语LLM的工具。

🎯 应用场景

AraSTEM数据集可用于评估和比较不同LLM在阿拉伯语STEM领域的知识水平。它可以帮助研究人员开发更有效的阿拉伯语LLM,并促进阿拉伯语科学教育的发展。此外,该数据集还可以用于评估LLM在特定STEM学科中的知识差距,从而指导LLM的训练和改进。

📄 摘要(原文)

Large Language Models (LLMs) have shown remarkable capabilities, not only in generating human-like text, but also in acquiring knowledge. This highlights the need to go beyond the typical Natural Language Processing downstream benchmarks and asses the various aspects of LLMs including knowledge and reasoning. Numerous benchmarks have been developed to evaluate LLMs knowledge, but they predominantly focus on the English language. Given that many LLMs are multilingual, relying solely on benchmarking English knowledge is insufficient. To address this issue, we introduce AraSTEM, a new Arabic multiple-choice question dataset aimed at evaluating LLMs knowledge in STEM subjects. The dataset spans a range of topics at different levels which requires models to demonstrate a deep understanding of scientific Arabic in order to achieve high accuracy. Our findings show that publicly available models of varying sizes struggle with this dataset, and underscores the need for more localized language models. The dataset is freely accessible on Hugging Face.