Temporal reasoning for timeline summarisation in social media

作者: Jiayu Song, Mahmud Elahi Akhter, Dana Atzil Slonim, Maria Liakata

分类: cs.CL, cs.AI

发布日期: 2024-12-30 (更新: 2025-07-18)

💡 一句话要点

提出基于知识蒸馏的时间推理方法,提升社交媒体时间线摘要质量

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间线摘要 时间推理 知识蒸馏 大型语言模型 社交媒体分析

📋 核心要点

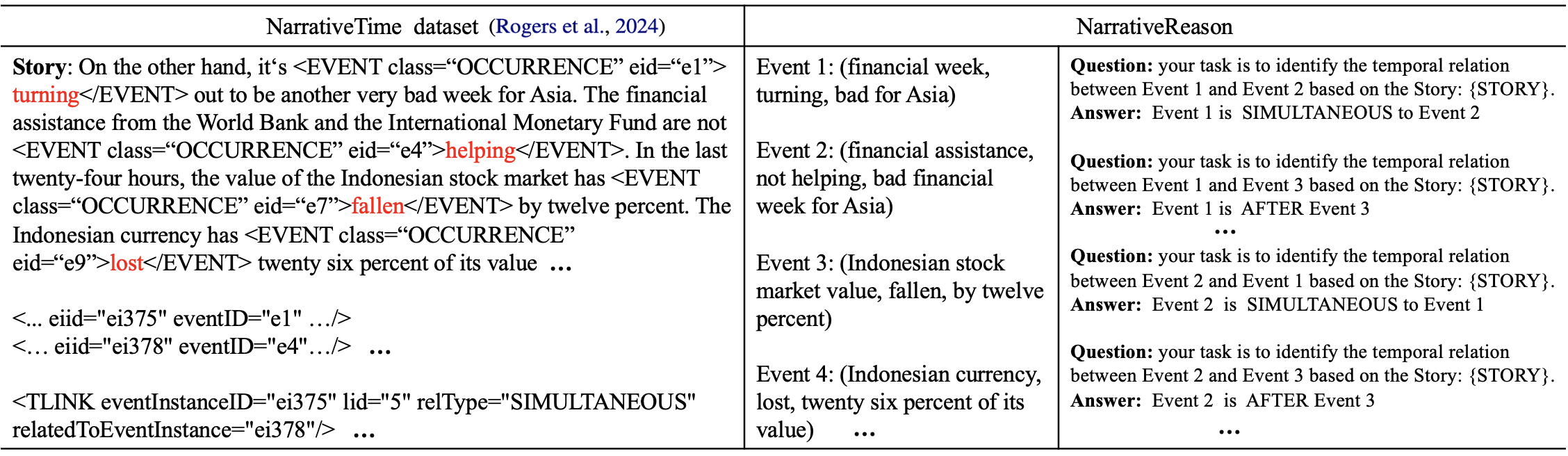

- 现有时间推理数据集主要关注成对事件关系,缺乏对叙事中连续事件时间关系的建模。

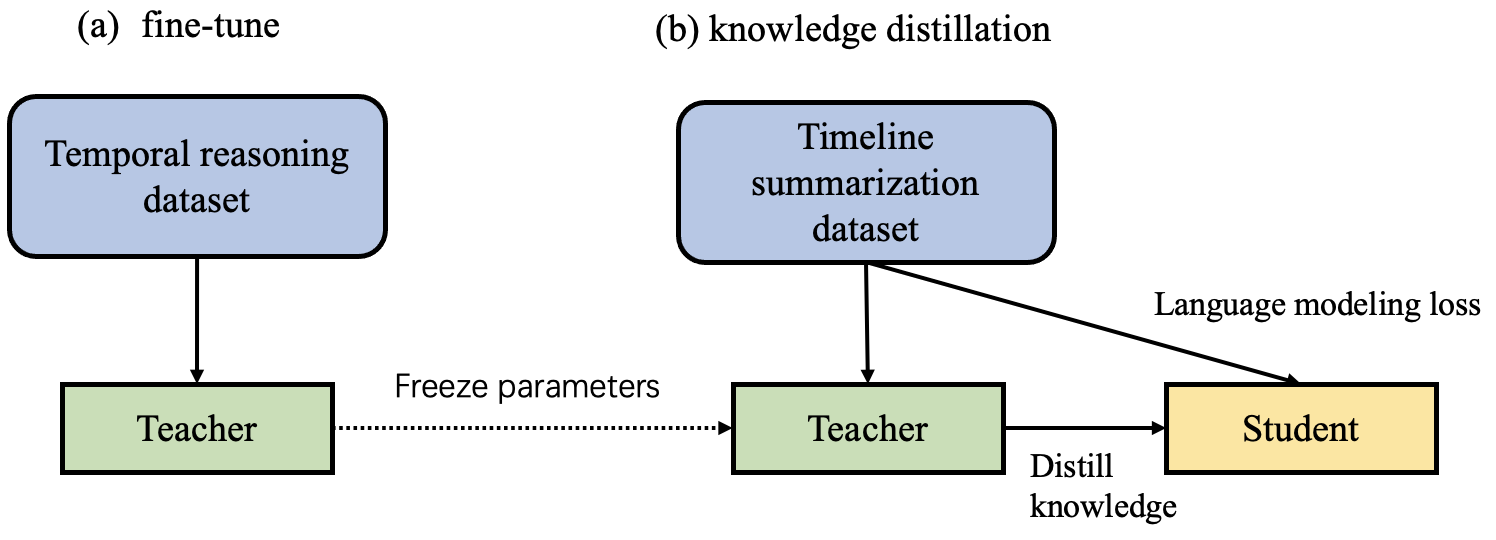

- 通过知识蒸馏,将时间推理能力从教师模型迁移到学生模型,同时训练学生模型进行时间线摘要。

- 实验表明,该模型在心理健康相关的社交媒体时间线摘要任务中表现出色,验证了时间推理的有效性。

📝 摘要(中文)

本文探讨了增强大型语言模型(LLM)的时间推理能力是否可以提高时间线摘要的质量,时间线摘要是指对包含事件序列的长文本(如社交媒体帖子)进行概括的任务。我们首先引入了 NarrativeReason,这是一个新的数据集,专注于叙述中连续事件之间的时间关系,这与主要处理成对事件关系的现有时间推理数据集不同。然后,我们的方法通过知识蒸馏框架将时间推理与时间线摘要相结合,首先在时间推理任务上微调教师模型,然后在训练学生模型进行时间线摘要任务的同时,将这些知识提炼到学生模型中。实验结果表明,我们的模型在领域外(out-of-domain)的心理健康相关时间线摘要任务中取得了优异的性能,该任务涉及具有事件重复和情感混合的长社交媒体帖子,突出了利用时间推理来改进时间线摘要的重要性和泛化性。

🔬 方法详解

问题定义:论文旨在解决社交媒体时间线摘要任务中,大型语言模型缺乏有效的时间推理能力,导致摘要质量不高的问题。现有方法通常忽略了事件之间的时序关系,无法准确捕捉叙事的时间演变过程。

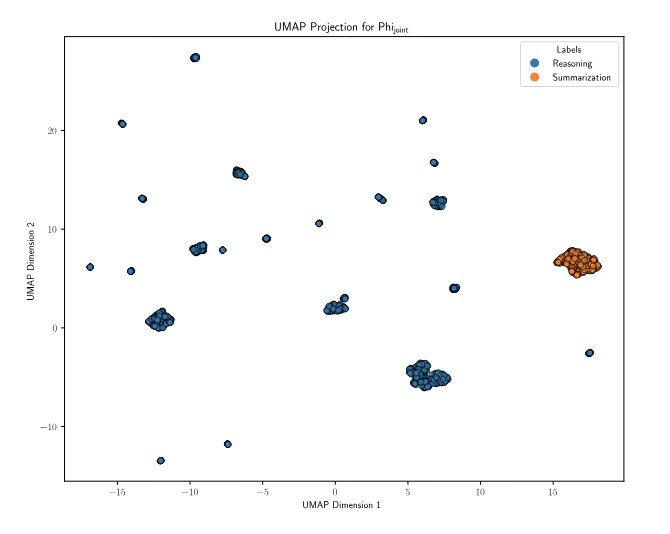

核心思路:论文的核心思路是利用知识蒸馏,将时间推理能力注入到用于时间线摘要的模型中。通过首先训练一个擅长时间推理的教师模型,然后将该模型的知识迁移到学生模型,从而提高学生模型在时间线摘要任务中的表现。这样做的目的是让模型能够更好地理解事件之间的时序关系,从而生成更准确、更连贯的摘要。

技术框架:整体框架包含两个主要阶段:1) 教师模型训练阶段:使用 NarrativeReason 数据集对教师模型进行微调,使其具备较强的时间推理能力。2) 知识蒸馏和学生模型训练阶段:使用时间线摘要数据集训练学生模型,同时利用教师模型的输出作为软标签,通过知识蒸馏损失函数引导学生模型学习时间推理知识。

关键创新:论文的关键创新在于将时间推理与时间线摘要任务相结合,并采用知识蒸馏的方式实现知识迁移。此外,还提出了一个新的数据集 NarrativeReason,专门用于训练模型的时间推理能力,特别是针对叙事中连续事件的时间关系。

关键设计:在知识蒸馏过程中,使用了交叉熵损失函数来衡量学生模型预测结果与真实标签之间的差异,同时使用KL散度损失函数来衡量学生模型预测结果与教师模型预测结果之间的差异。通过调整两个损失函数的权重,可以控制知识蒸馏的强度。具体的网络结构和参数设置在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在领域外(out-of-domain)的心理健康相关时间线摘要任务中取得了显著的性能提升。具体的数据指标和对比基线在论文中未详细说明,属于未知信息。但论文强调,该模型在处理包含事件重复和情感混合的长社交媒体帖子时表现出色,证明了时间推理对于提升时间线摘要质量的重要性。

🎯 应用场景

该研究成果可应用于社交媒体舆情分析、新闻事件追踪、医疗记录摘要等领域。通过提升模型对时间序列事件的理解能力,可以更准确地提取关键信息,辅助决策,并为用户提供更优质的信息服务。未来,该方法有望扩展到其他需要时间推理的自然语言处理任务中。

📄 摘要(原文)

This paper explores whether enhancing temporal reasoning capabilities in Large Language Models (LLMs) can improve the quality of timeline summarisation, the task of summarising long texts containing sequences of events, such as social media threads. We first introduce NarrativeReason, a novel dataset focused on temporal relationships among sequential events within narratives, distinguishing it from existing temporal reasoning datasets that primarily address pair-wise event relationships. Our approach then combines temporal reasoning with timeline summarisation through a knowledge distillation framework, where we first fine-tune a teacher model on temporal reasoning tasks and then distill this knowledge into a student model while simultaneously training it for the task of timeline summarisation. Experimental results demonstrate that our model achieves superior performance on out-of-domain mental health-related timeline summarisation tasks, which involve long social media threads with repetitions of events and a mix of emotions, highlighting the importance and generalisability of leveraging temporal reasoning to improve timeline summarisation.