Knowledge Editing for Large Language Model with Knowledge Neuronal Ensemble

作者: Yongchang Li, Yujin Zhu, Tao Yan, Shijian Fan, Gang Wu, Liang Xu

分类: cs.CL

发布日期: 2024-12-30

备注: 26 pages, 5 figures, 2 tables

💡 一句话要点

提出知识神经元集成(KNE)方法,提升大语言模型知识编辑的准确性和效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识编辑 大语言模型 神经元集成 梯度归因 参数定位

📋 核心要点

- 现有知识编辑方法存在参数定位耦合、定位不精确以及缺乏跨层动态交互等问题。

- KNE方法通过知识神经元集成来编码特定知识,并利用梯度归因分数提高参数定位的精度。

- 实验结果表明,KNE方法显著提高了知识编辑的准确性,并在可移植性和局部性指标上表现优异。

📝 摘要(中文)

随着真实世界知识的不断演变,确保模型知识的时效性和准确性至关重要。这使得大语言模型中的知识编辑变得越来越重要。然而,现有的知识编辑方法面临着若干挑战,包括参数定位耦合、不精确的定位以及缺乏跨层的动态交互。在本文中,我们提出了一种新的知识编辑方法,称为知识神经元集成(KNE)。知识神经元集成代表了一组编码特定知识的神经元,从而缓解了参数定位中耦合导致的频繁参数修改问题。KNE方法通过计算每一层每个参数的梯度归因分数来提高参数定位的精度和准确性。在编辑过程中,仅计算与知识神经元集成相关的梯度和损失,并相应地执行误差反向传播,从而确保参数之间的动态交互和协同更新。在三个广泛使用的知识编辑数据集上的实验结果表明,KNE方法显著提高了知识编辑的准确性,并在可移植性和局部性指标上达到甚至超过了最佳基线方法的性能。

🔬 方法详解

问题定义:论文旨在解决大语言模型知识编辑中参数定位不准确和效率低下的问题。现有方法通常面临参数耦合,导致修改一个知识点时会影响其他知识,同时缺乏跨层之间的协同更新,使得编辑效果难以达到最优。

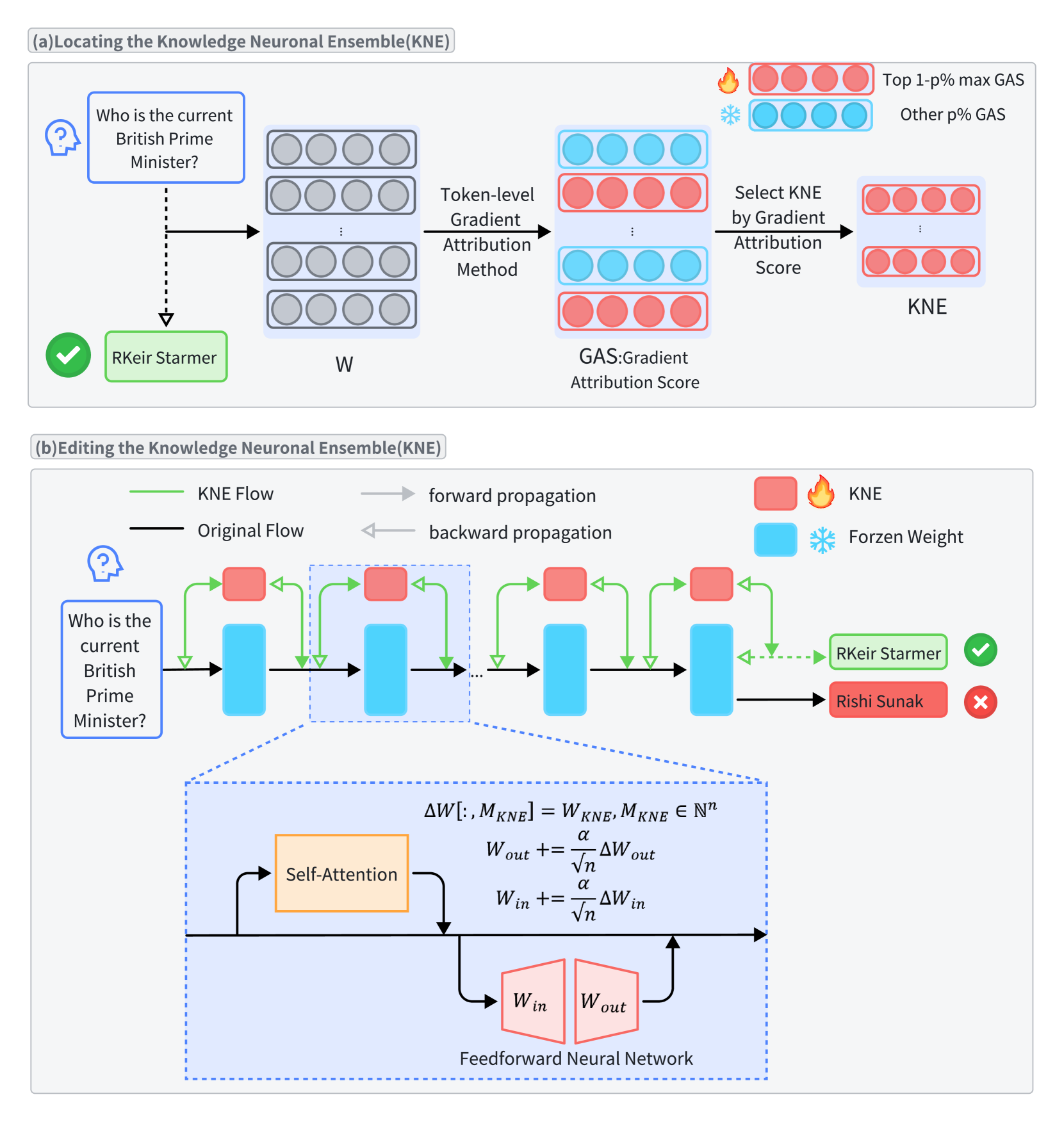

核心思路:论文的核心思路是将知识表示为一组神经元的集合,即知识神经元集成(Knowledge Neuronal Ensemble, KNE)。通过这种方式,可以减少参数之间的耦合,使得知识编辑更加局部化。同时,利用梯度归因分数来精确地定位与特定知识相关的神经元,从而提高编辑的准确性。

技术框架:KNE方法主要包含以下几个阶段:1) 知识神经元集成构建:识别并选择编码特定知识的神经元集合。2) 梯度归因计算:计算每一层每个参数对于知识预测的梯度归因分数,用于确定哪些神经元对该知识的贡献最大。3) 知识编辑:仅更新与知识神经元集成相关的参数,并通过误差反向传播实现跨层之间的协同更新。

关键创新:KNE方法的关键创新在于:1) 引入了知识神经元集成的概念,将知识表示为一组神经元,降低了参数耦合度。2) 利用梯度归因分数进行精确的参数定位,提高了编辑的准确性。3) 通过误差反向传播实现跨层之间的动态交互和协同更新,提升了编辑效果。

关键设计:KNE方法的关键设计包括:1) 梯度归因分数的计算方式,例如可以使用Integrated Gradients或SmoothGrad等方法。2) 知识神经元集成的选择策略,例如可以选择梯度归因分数最高的若干个神经元。3) 损失函数的设计,例如可以使用交叉熵损失或对比损失等,以优化知识编辑的效果。4) 反向传播过程中,只更新与知识神经元集成相关的参数,避免影响其他知识。

🖼️ 关键图片

📊 实验亮点

实验结果表明,KNE方法在知识编辑的准确性方面取得了显著提升,并在可移植性和局部性指标上达到了甚至超过了最佳基线方法的性能。具体来说,KNE方法在三个广泛使用的知识编辑数据集上都取得了优异的成绩,证明了其有效性和泛化能力。量化结果(具体数值未知)表明,KNE在编辑成功率上优于现有方法。

🎯 应用场景

该研究成果可应用于各种需要持续更新知识的大语言模型应用场景,例如智能客服、知识问答、内容生成等。通过KNE方法,可以更高效、更准确地更新模型知识,提高模型的实用性和可靠性。未来,该方法还可以扩展到其他类型的模型和任务中。

📄 摘要(原文)

As real-world knowledge is constantly evolving, ensuring the timeliness and accuracy of a model's knowledge is crucial. This has made knowledge editing in large language models increasingly important. However, existing knowledge editing methods face several challenges, including parameter localization coupling, imprecise localization, and a lack of dynamic interaction across layers. In this paper, we propose a novel knowledge editing method called Knowledge Neuronal Ensemble (KNE). A knowledge neuronal ensemble represents a group of neurons encoding specific knowledge, thus mitigating the issue of frequent parameter modification caused by coupling in parameter localization. The KNE method enhances the precision and accuracy of parameter localization by computing gradient attribution scores for each parameter at each layer. During the editing process, only the gradients and losses associated with the knowledge neuronal ensemble are computed, with error backpropagation performed accordingly, ensuring dynamic interaction and collaborative updates among parameters. Experimental results on three widely used knowledge editing datasets show that the KNE method significantly improves the accuracy of knowledge editing and achieves, or even exceeds, the performance of the best baseline methods in portability and locality metrics.