HindiLLM: Large Language Model for Hindi

作者: Sanjay Chouhan, Shubha Brata Nath, Aparajita Dutta

分类: cs.CL, cs.AI

发布日期: 2024-12-29

期刊: Pattern Recognition. ICPR 2024. Lecture Notes in Computer Science, vol 15306, pp. 255--270, Springer, Cham, 2025

DOI: 10.1007/978-3-031-78172-8_17

💡 一句话要点

提出HindiLLM,为印地语构建高性能的大型语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 印地语 自然语言处理 预训练 微调 自回归模型 文本分类

📋 核心要点

- 现有大型语言模型主要集中在英语上,缺乏针对印地语等印度语言的高性能模型。

- HindiLLM通过两阶段训练,首先进行无监督预训练,然后进行监督微调,提升模型性能。

- 实验结果表明,HindiLLM在情感分析、文本分类等任务上优于其他模型,展现了其有效性。

📝 摘要(中文)

本文提出了一种针对印地语的大型语言模型(LLM)HindiLLM,旨在解决现有文献中缺乏高性能印地语及其他印度语言模型的问题。该研究预训练了两个自回归LLM模型,分别为HindiLLM-Small和HindiLLM-Medium。训练过程分为两步:无监督预训练和监督微调。首先,构建了一个大规模高质量的印地语文本语料库用于无监督预训练。然后,使用该语料库训练了一个名为HindiLLM tokenizer的Byte-Pair Encoding分词器。接着,在无标签数据上进行预训练,得到HindiLLM基础模型。最后,针对情感分析、文本分类、自然语言推理和多项选择问答等任务,在流行的标注数据集上对HindiLLM基础模型进行微调,以评估其真实性能。评估结果表明,基于HindiLLM的微调模型在大多数语言相关任务中优于其他模型。

🔬 方法详解

问题定义:本文旨在解决印地语大型语言模型(LLM)的缺失问题。现有的大部分LLM研究都集中在英语上,而忽略了印地语等其他重要语言。这导致在处理印地语相关任务时,缺乏高性能的语言模型,现有方法效果不佳。

核心思路:本文的核心思路是构建一个专门针对印地语的LLM,通过大规模语料库的预训练和针对特定任务的微调,使模型能够更好地理解和生成印地语文本。这种方法借鉴了英语LLM的成功经验,并针对印地语的特点进行了优化。

技术框架:HindiLLM的训练过程分为两个阶段:无监督预训练和监督微调。在无监督预训练阶段,首先收集并清洗大规模的印地语文本数据,构建预训练语料库。然后,使用该语料库训练一个Byte-Pair Encoding (BPE) 分词器,即HindiLLM tokenizer。接着,使用该分词器和语料库训练HindiLLM基础模型。在监督微调阶段,针对不同的下游任务(如情感分析、文本分类等),使用相应的标注数据集对HindiLLM基础模型进行微调。

关键创新:本文的关键创新在于构建了专门针对印地语的LLM,并针对印地语的特点进行了优化。具体来说,本文构建了一个大规模高质量的印地语预训练语料库,并训练了一个专门的印地语分词器。此外,本文还通过实验验证了HindiLLM在多个下游任务上的有效性。与直接使用通用LLM相比,HindiLLM能够更好地捕捉印地语的语言特征,从而获得更好的性能。

关键设计:HindiLLM采用了自回归Transformer架构,具体参数设置(如模型大小、层数、注意力头数等)根据HindiLLM-Small和HindiLLM-Medium有所不同,但具体数值未知。损失函数采用标准的交叉熵损失函数。在微调阶段,针对不同的任务选择合适的学习率和优化器。预训练语料库的规模和质量对模型性能至关重要,但具体规模未知。

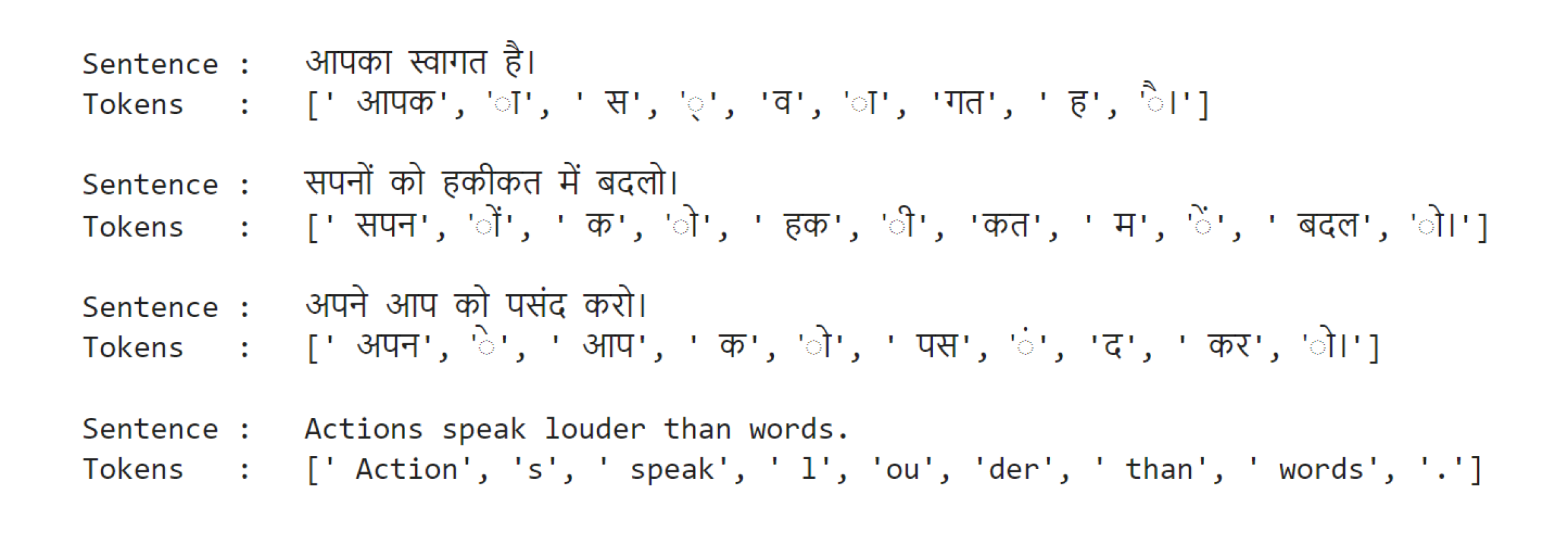

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过微调的HindiLLM模型在情感分析、文本分类、自然语言推理和多项选择问答等任务上,优于多个现有模型。具体的性能提升幅度未知,但总体而言,HindiLLM展现了其在印地语自然语言处理方面的优越性能。

🎯 应用场景

HindiLLM的应用场景广泛,包括机器翻译、文本摘要、问答系统、情感分析、内容生成等。它可以用于开发各种印地语相关的智能应用,例如智能客服、新闻推荐、社交媒体分析等。该研究有助于推动印地语自然语言处理技术的发展,并为其他低资源语言的LLM研究提供借鉴。

📄 摘要(原文)

The advancements in the Large Language Model (LLM) have helped in solving several problems related to language processing. Most of the researches have focused on the English language only, because of its popularity and abundance on the internet. However, a high-performance language model for Hindi and other Indic languages is lacking in the literature. In this work, we have pre-trained two autoregressive LLM models for the Hindi language, namely HindiLLM-Small and HindiLLM-Medium. We use a two-step process comprising unsupervised pre-training and supervised fine-tuning. First, we create a large and high-quality text corpus for unsupervised pre-training. Next, we train a Byte-Pair Encoding, named HindiLLM tokenizer, using the pre-training text data. We then perform training on the unlabeled data, known as the pre-training step, to get the HindiLLM base models. Furthermore, we perform fine-tuning of the HindiLLM base models for different tasks like sentiment analysis, text classification, natural language inference, and multiple choice question-answer on popular labeled datasets to measure the real-world performance. The evaluation shows that the HindiLLM-based fine-tuned models outperform several models in most of the language related tasks.