Large Language Models for Mathematical Analysis

作者: Ziye Chen, Hao Qi

分类: cs.CL, cs.AI

发布日期: 2024-12-28

💡 一句话要点

提出DEMI-MathAnalysis数据集并设计引导框架,提升LLM在数学分析问题上的证明能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数学分析 问题求解 形式推理 数据集构建 证明生成 微调 引导框架

📋 核心要点

- 现有数学问题求解研究多集中于计算任务,缺乏对需要严格证明和形式推理的数学分析领域的关注。

- 论文提出DEMI-MathAnalysis数据集,并设计引导框架,旨在提升LLM在数学分析问题上的证明能力。

- 通过在DEMI-MathAnalysis数据集上微调LLM并应用引导框架,显著提高了LLM生成逻辑、完整和优雅证明的能力。

📝 摘要(中文)

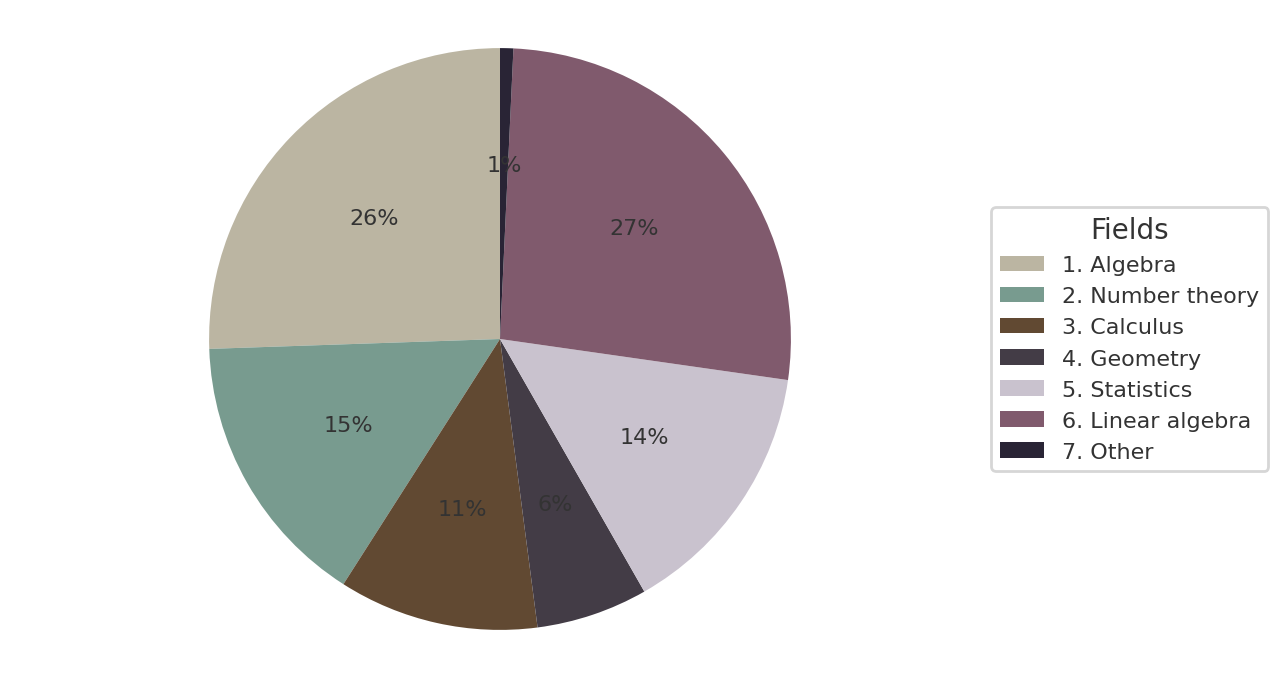

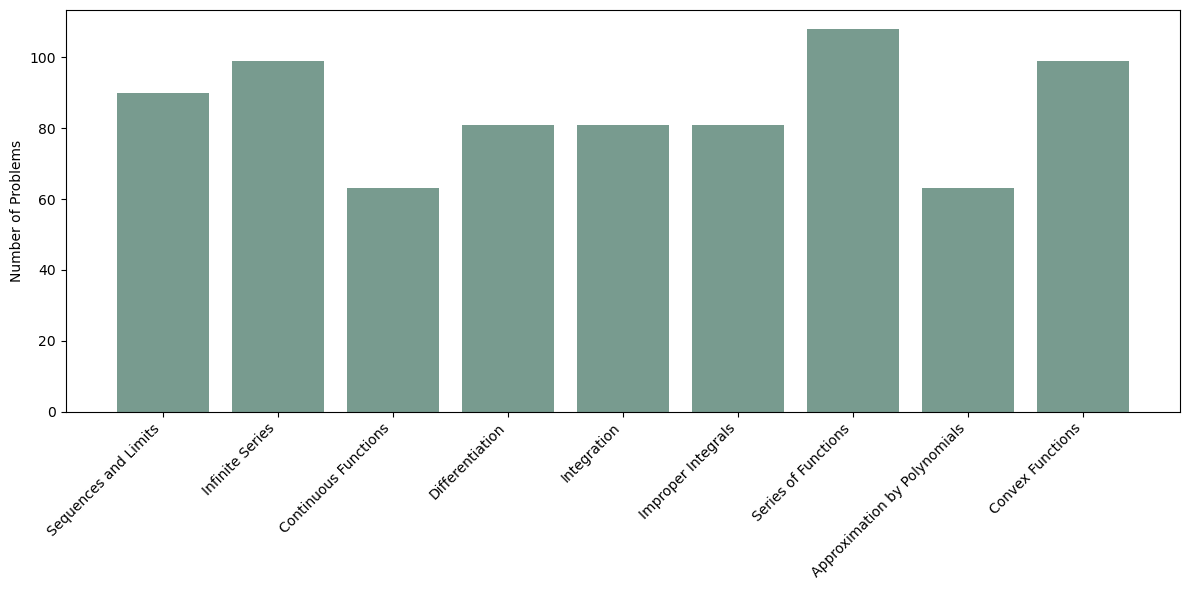

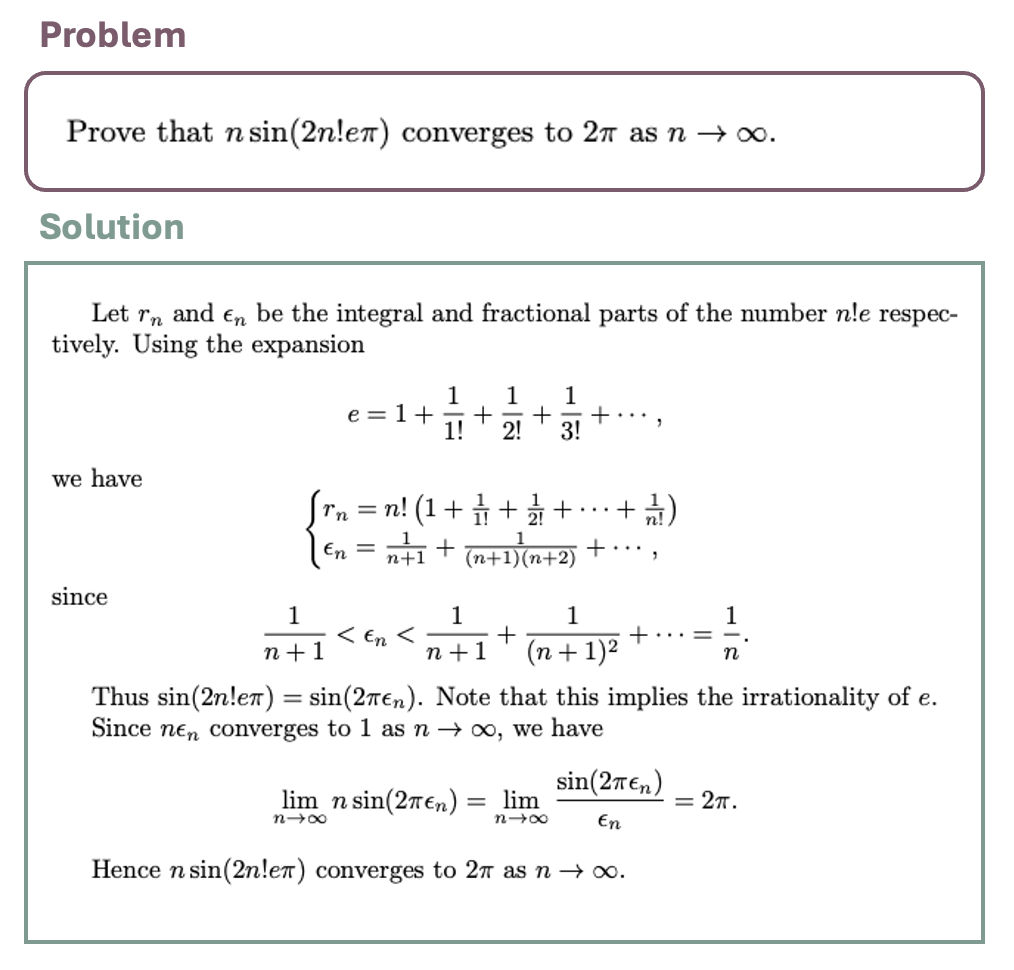

数学问题求解是人工智能的关键领域,也是评估大型语言模型(LLM)能力的重要基准。虽然对数学问题求解的研究很多,但现有工作和数据集主要集中在计算任务上,在数学分析等领域存在空白,而数学分析需要严格的证明和形式推理。我们开发了DEMI-MathAnalysis数据集,其中包含来自数学分析主题(如序列与极限、无穷级数和凸函数)的基于证明的问题。我们还设计了一个指导框架,以严格提高LLM解决这些问题的能力。通过在此数据集上微调LLM并采用我们的框架,我们观察到它们生成逻辑、完整和优雅证明的能力得到了显著提高。这项工作解决了数学推理中的关键差距,并有助于推进能够处理形式化数学语言的可信AI。代码可在LLMs for Mathematical Analysis公开获取。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在数学分析问题求解中,特别是生成严格证明方面的不足。现有方法和数据集主要关注计算任务,忽略了数学分析中对形式推理和逻辑严密性的要求。这导致LLM在处理需要证明的数学问题时表现不佳,难以生成完整、正确的证明过程。

核心思路:论文的核心思路是构建一个高质量的数学分析数据集(DEMI-MathAnalysis),并设计一个引导框架,通过微调LLM来提升其证明能力。该框架旨在引导LLM学习如何进行逻辑推理、形式化表达,并生成符合数学规范的证明。通过数据和框架的双重作用,使LLM能够更好地理解和解决数学分析问题。

技术框架:整体框架包含两个主要部分:数据集构建和模型训练。数据集构建阶段,作者收集并整理了来自数学分析领域的证明题,涵盖序列与极限、无穷级数和凸函数等主题。模型训练阶段,作者使用DEMI-MathAnalysis数据集对LLM进行微调,并结合设计的引导框架,指导LLM学习证明过程。具体流程可能包括:问题输入、证明步骤生成、逻辑验证、结果输出等。

关键创新:论文的关键创新在于:1) 提出了DEMI-MathAnalysis数据集,填补了现有数学问题求解数据集中数学分析证明题的空白。2) 设计了引导框架,能够有效地提升LLM在数学分析问题上的证明能力。与现有方法相比,该方法更注重培养LLM的逻辑推理和形式化表达能力,使其能够生成更严谨、更完整的证明。

关键设计:论文中关于引导框架和微调策略的具体技术细节未知。可能涉及的关键设计包括:1) 引导框架的具体实现方式,例如是否包含特定的损失函数或训练技巧,以鼓励LLM生成逻辑连贯的证明步骤。2) 数据增强方法,例如通过对现有证明题进行变换或生成新的证明题,来扩充数据集。3) 模型选择和超参数调整,例如选择合适的LLM架构,并调整学习率、batch size等超参数,以获得最佳的训练效果。

🖼️ 关键图片

📊 实验亮点

论文通过在DEMI-MathAnalysis数据集上微调LLM并应用引导框架,显著提高了LLM生成逻辑、完整和优雅证明的能力。具体的性能数据和提升幅度未知,但摘要中明确指出观察到了“significant improvements”,表明该方法在提升LLM的数学分析能力方面具有显著效果。与未经过微调或使用其他数据集微调的LLM相比,该方法具有明显的优势。

🎯 应用场景

该研究成果可应用于智能教育、自动化定理证明、科学研究等领域。例如,可以开发智能辅导系统,帮助学生理解和掌握数学分析的证明方法;可以用于自动化验证数学定理的正确性,提高数学研究的效率;还可以应用于其他需要形式推理和逻辑证明的领域,例如软件验证、安全协议分析等。

📄 摘要(原文)

Mathematical problem-solving is a key field in artificial intelligence (AI) and a critical benchmark for evaluating the capabilities of large language models (LLMs). While extensive research has focused on mathematical problem-solving, most existing work and datasets concentrate on computational tasks, leaving gaps in areas like mathematical analysis, which demands rigorous proofs and formal reasoning. We developed the DEMI-MathAnalysis dataset, comprising proof-based problems from mathematical analysis topics such as Sequences and Limits, Infinite Series, and Convex Functions. We also designed a guiding framework to rigorously enhance LLMs' ability to solve these problems. Through fine-tuning LLMs on this dataset and employing our framework, we observed significant improvements in their capability to generate logical, complete, and elegant proofs. This work addresses critical gaps in mathematical reasoning and contributes to advancing trustworthy AI capable of handling formalized mathematical language. The code is publicly accessible at LLMs for Mathematical Analysis.