LLM Reasoning Engine: Specialized Training for Enhanced Mathematical Reasoning

作者: Shuguang Chen, Guang Lin

分类: cs.CL

发布日期: 2024-12-28 (更新: 2025-03-19)

备注: Accepted to NAACL 2025 KnowledgeNLP

💡 一句话要点

提出LLM推理引擎,通过专业训练增强大语言模型数学推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 数学推理 问题释义 专业训练 模型泛化

📋 核心要点

- 现有LLM在数学推理中面临挑战,集成方法受限于目标领域数据稀缺。

- 论文提出问题释义策略,使数学问题语言形式多样化,提升模型泛化能力。

- 通过专门的训练目标,增强LLM对数学概念和推理过程的理解,提升性能。

📝 摘要(中文)

大型语言模型(LLM)在各种自然语言处理任务中表现出色,但在数学推理方面面临挑战,因为复杂的解决问题既需要语言理解能力,也需要数学推理技能。现有的解决这一挑战的方法通常依赖于集成方法,并且存在目标领域数据稀缺的问题。本文提出了一种新方法来增强LLM在数学推理任务中的能力。受弥合这一差距的需求的推动,我们的方法结合了一种问题释义策略,旨在使数学问题的语言形式多样化,以提高泛化能力。此外,采用专门的训练目标来指导模型的学习过程,重点是增强其对数学概念和推理过程的理解。我们使用不同的LLM在四个数据集上进行了实验,证明了我们的方法在提高LLM在数学推理任务中的性能方面的有效性。我们的发现强调了我们的方法在推进大型语言模型方面的重要性,以及它对需要数学推理能力的实际应用的潜在影响。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在数学推理任务中表现不佳的问题。现有方法,如集成方法,虽然可以提升性能,但往往依赖于大量标注数据,且在特定领域面临数据稀缺的困境,限制了模型的泛化能力。因此,如何利用有限的数据,有效提升LLM的数学推理能力是本文要解决的核心问题。

核心思路:论文的核心思路是通过问题释义和专门的训练目标来增强LLM的数学推理能力。问题释义旨在通过改变问题的语言表达形式,增加训练数据的多样性,从而提高模型的泛化能力。专门的训练目标则侧重于引导模型学习数学概念和推理过程,使其更好地理解和解决数学问题。

技术框架:该方法主要包含两个关键模块:问题释义模块和专门训练模块。问题释义模块负责生成同一数学问题的多种语言表达形式。专门训练模块则利用这些释义后的数据,结合特定的训练目标,对LLM进行微调。整体流程是:首先,对原始数学问题进行释义,生成多个变体;然后,将原始问题及其变体作为训练数据,输入到LLM中;最后,通过专门的训练目标,优化LLM的参数,使其更好地完成数学推理任务。

关键创新:论文的关键创新在于将问题释义策略与专门的训练目标相结合,用于提升LLM的数学推理能力。与传统的集成方法相比,该方法不需要大量标注数据,且能够有效提高模型的泛化能力。此外,专门的训练目标能够引导模型学习数学概念和推理过程,使其更好地理解和解决数学问题。

关键设计:问题释义的具体方法未知,可能包括同义词替换、句子结构变换等。专门的训练目标可能包括:1)数学概念理解损失,鼓励模型正确理解数学概念;2)推理过程损失,鼓励模型按照正确的逻辑步骤进行推理;3)答案正确性损失,鼓励模型给出正确的答案。具体的损失函数形式和权重比例未知。网络结构方面,论文使用了不同的LLM作为基础模型,但没有提及对LLM结构进行修改。

🖼️ 关键图片

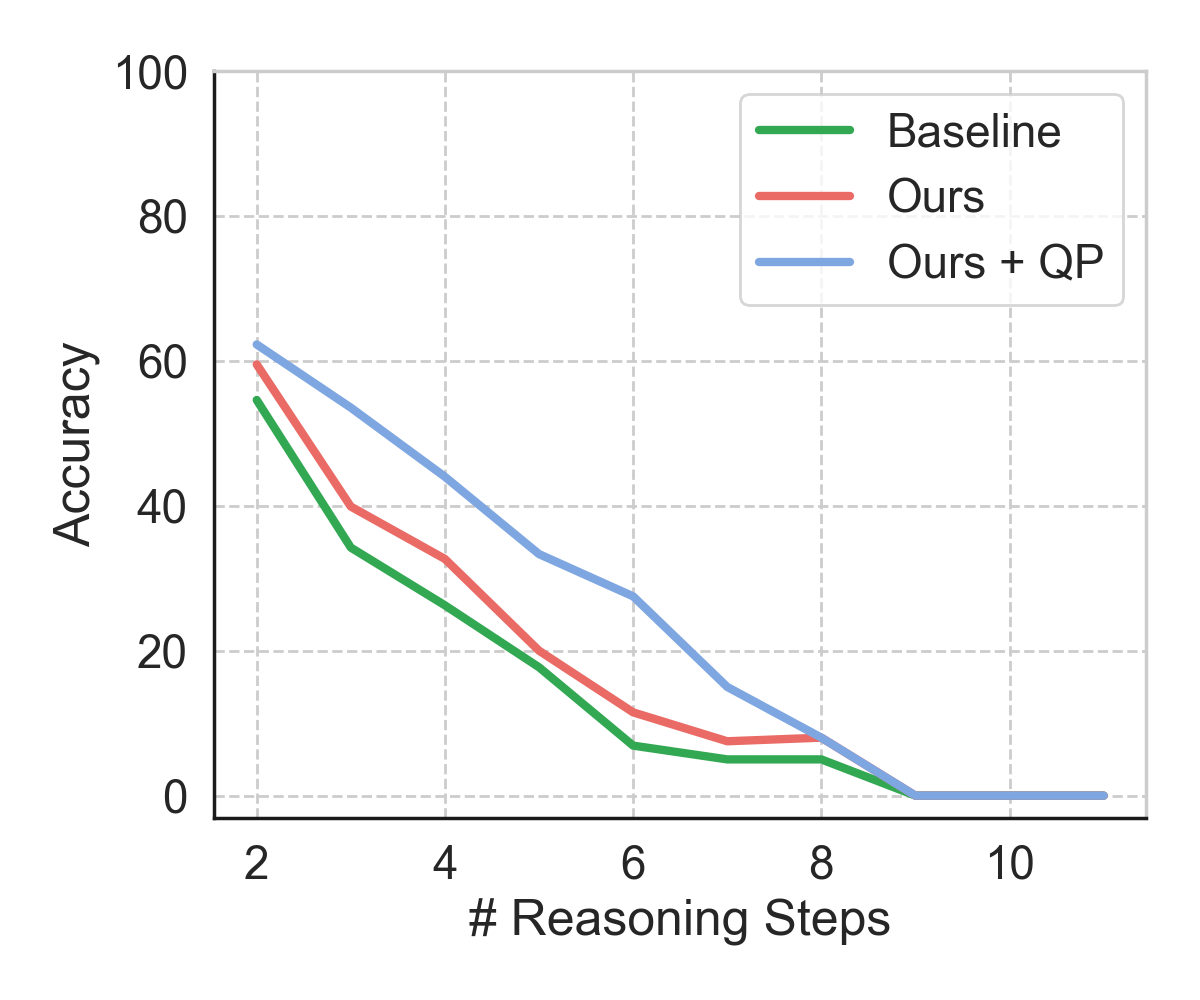

📊 实验亮点

论文在四个数据集上进行了实验,证明了该方法的有效性。具体的性能数据和对比基线未知,但摘要中明确指出该方法能够提高LLM在数学推理任务中的性能。实验结果强调了该方法在推进大型语言模型方面的重要性,以及它对需要数学推理能力的实际应用的潜在影响。

🎯 应用场景

该研究成果可应用于教育领域,例如智能辅导系统,帮助学生解决数学难题。在科研领域,可以用于自动化定理证明、数学建模等任务。此外,在金融、工程等领域,需要进行复杂数学计算的场景,该方法也有潜在的应用价值,能够提高问题解决的效率和准确性。

📄 摘要(原文)

Large Language Models (LLMs) have shown remarkable performance in various natural language processing tasks but face challenges in mathematical reasoning, where complex problem-solving requires both linguistic understanding and mathematical reasoning skills. Existing approaches to address this challenge often rely on ensemble methods and suffer from the problem of data scarcity in target domains. In this work, we present a novel method to enhance LLMs' capabilities in mathematical reasoning tasks. Motivated by the need to bridge this gap, our approach incorporates a question paraphrase strategy, which aims at diversifying the linguistic forms of mathematical questions to improve generalization. Additionally, specialized training objectives are employed to guide the model's learning process, focusing on enhancing its understanding of mathematical concepts and reasoning processes. We conduct experiments on four datasets using different LLMs, and demonstrate the effectiveness of our approach in improving LLMs' performance on mathematical reasoning tasks. Our findings underscore the significance of our methodology in the advancement of large language models and its potential implications for real-world applications that require mathematical reasoning abilities.