Distilling Fine-grained Sentiment Understanding from Large Language Models

作者: Yice Zhang, Guangyu Xie, Hongling Xu, Kaiheng Hou, Jianzhu Bao, Qianlong Wang, Shiwei Chen, Ruifeng Xu

分类: cs.CL

发布日期: 2024-12-24 (更新: 2024-12-30)

🔗 代码/项目: GITHUB

💡 一句话要点

提出一种基于知识蒸馏的细粒度情感分析方法,提升小模型性能并降低推理成本。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 细粒度情感分析 知识蒸馏 大型语言模型 小型语言模型 预训练 零样本学习 情感理解

📋 核心要点

- 现有细粒度情感分析方法难以兼顾性能与效率,直接应用大型语言模型成本过高。

- 利用大型语言模型生成的数据预训练小型语言模型,实现知识蒸馏,提升小模型的情感理解能力。

- 实验表明,蒸馏显著提升了小模型在细粒度情感分析任务中的性能,甚至超越了更大的模型。

📝 摘要(中文)

细粒度情感分析(FSA)旨在从大量带有观点色彩的文本中提取和总结用户观点。最近的研究表明,大型语言模型(LLM)具有卓越的情感理解能力。然而,直接部署LLM进行FSA应用会产生高昂的推理成本。因此,本文研究了将LLM的细粒度情感理解能力蒸馏到小型语言模型(SLM)中。我们提示LLM检查和解释给定评论的情感,然后利用生成的内容来预训练SLM。此外,我们开发了一个全面的FSA基准来评估SLM和LLM。在该基准上的大量实验表明:(1)蒸馏显著提高了SLM在FSA任务中的性能,F1-score提高了6.00%,并且蒸馏后的模型仅用220M参数就能优于Llama-2-7b;(2)蒸馏使SLM具备了出色的零样本情感分类能力,使其能够匹配甚至超过其教师模型。这些结果表明,从LLM进行蒸馏是FSA的一个非常有希望的方向。我们将发布我们的代码、数据和预训练模型权重。

🔬 方法详解

问题定义:论文旨在解决细粒度情感分析任务中,直接使用大型语言模型(LLM)进行推理成本过高的问题。现有的细粒度情感分析方法,在性能和效率之间难以取得平衡,无法在资源受限的场景下有效应用。

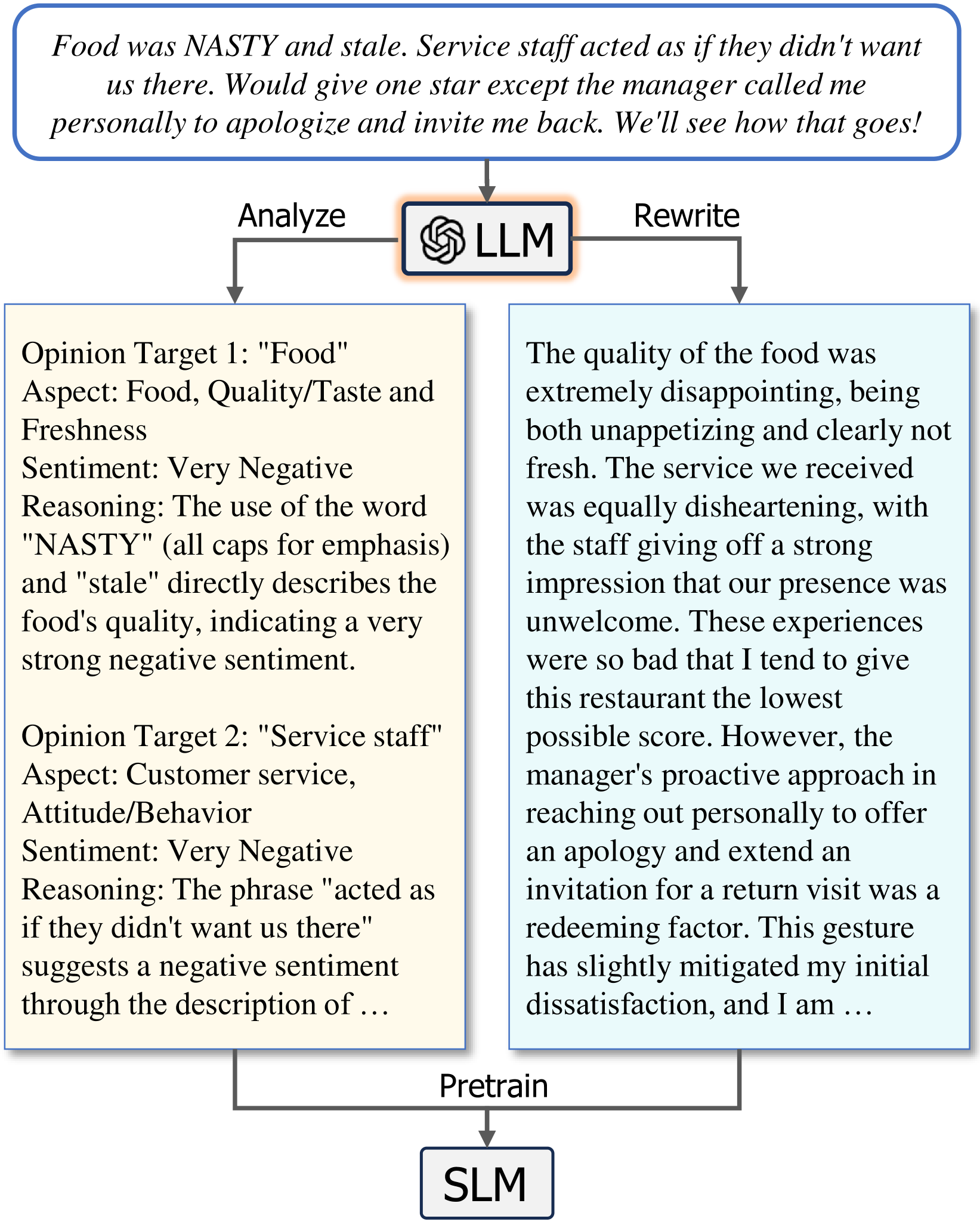

核心思路:论文的核心思路是通过知识蒸馏,将大型语言模型(LLM)强大的情感理解能力迁移到小型语言模型(SLM)中。通过让LLM对情感文本进行分析和解释,生成带有丰富情感信息的训练数据,然后利用这些数据来预训练SLM,从而使SLM能够以更低的计算成本实现接近甚至超越LLM的性能。

技术框架:整体框架包含两个主要阶段:1) LLM数据生成阶段:使用Prompt工程,引导LLM分析情感文本,生成包含情感标签和解释的训练数据。2) SLM预训练阶段:利用LLM生成的数据对SLM进行预训练,使其学习到LLM的情感理解能力。此外,论文还构建了一个全面的细粒度情感分析基准,用于评估LLM和SLM的性能。

关键创新:最重要的技术创新点在于利用LLM生成的数据进行SLM的预训练,实现了细粒度情感知识的有效蒸馏。与传统的知识蒸馏方法不同,该方法侧重于利用LLM的生成能力,而非仅仅是预测结果,从而为SLM提供了更丰富的情感信息。

关键设计:在LLM数据生成阶段,设计了有效的Prompt模板,引导LLM生成高质量的情感分析数据。在SLM预训练阶段,采用了标准的语言模型预训练目标,并针对情感分析任务进行了微调。具体参数设置和损失函数细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过知识蒸馏,小型语言模型在细粒度情感分析任务中的F1-score提高了6.00%。更重要的是,仅用220M参数的蒸馏模型就能超越Llama-2-7b的性能。此外,蒸馏后的模型还具备了出色的零样本情感分类能力,能够匹配甚至超过其教师模型。

🎯 应用场景

该研究成果可应用于各种需要细粒度情感分析的场景,例如舆情监控、产品评论分析、客户服务等。通过将大型语言模型的情感理解能力迁移到小型模型,可以在资源受限的环境下实现高效的情感分析,降低部署成本,并提升用户体验。未来,该方法可以进一步扩展到其他自然语言处理任务中。

📄 摘要(原文)

Fine-grained sentiment analysis (FSA) aims to extract and summarize user opinions from vast opinionated text. Recent studies demonstrate that large language models (LLMs) possess exceptional sentiment understanding capabilities. However, directly deploying LLMs for FSA applications incurs high inference costs. Therefore, this paper investigates the distillation of fine-grained sentiment understanding from LLMs into small language models (SLMs). We prompt LLMs to examine and interpret the sentiments of given reviews and then utilize the generated content to pretrain SLMs. Additionally, we develop a comprehensive FSA benchmark to evaluate both SLMs and LLMs. Extensive experiments on this benchmark reveal that: (1) distillation significantly enhances the performance of SLMs in FSA tasks, achieving a 6.00\% improvement in $F_1$-score, and the distilled model can outperform Llama-2-7b with only 220M parameters; (2) distillation equips SLMs with excellent zero-shot sentiment classification capabilities, enabling them to match or even exceed their teacher models. These results suggest that distillation from LLMs is a highly promising direction for FSA. We will release our code, data, and pretrained model weights at https://github.com/HITSZ-HLT/FSA-Distillation.