Token-Budget-Aware LLM Reasoning

作者: Tingxu Han, Zhenting Wang, Chunrong Fang, Shiyu Zhao, Shiqing Ma, Zhenyu Chen

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-12-24 (更新: 2025-06-02)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Token-Budget-Aware框架,在保证LLM推理性能的同时降低token使用成本。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 LLM推理 思维链 Token预算 成本优化

📋 核心要点

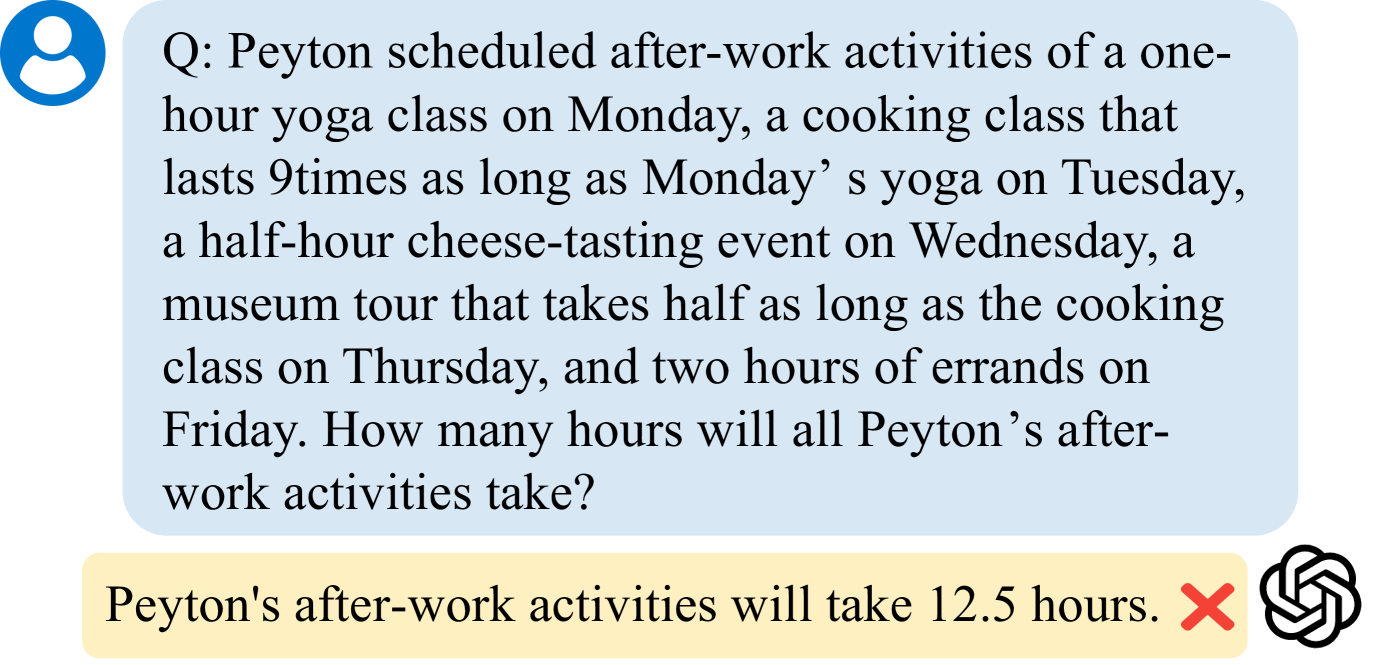

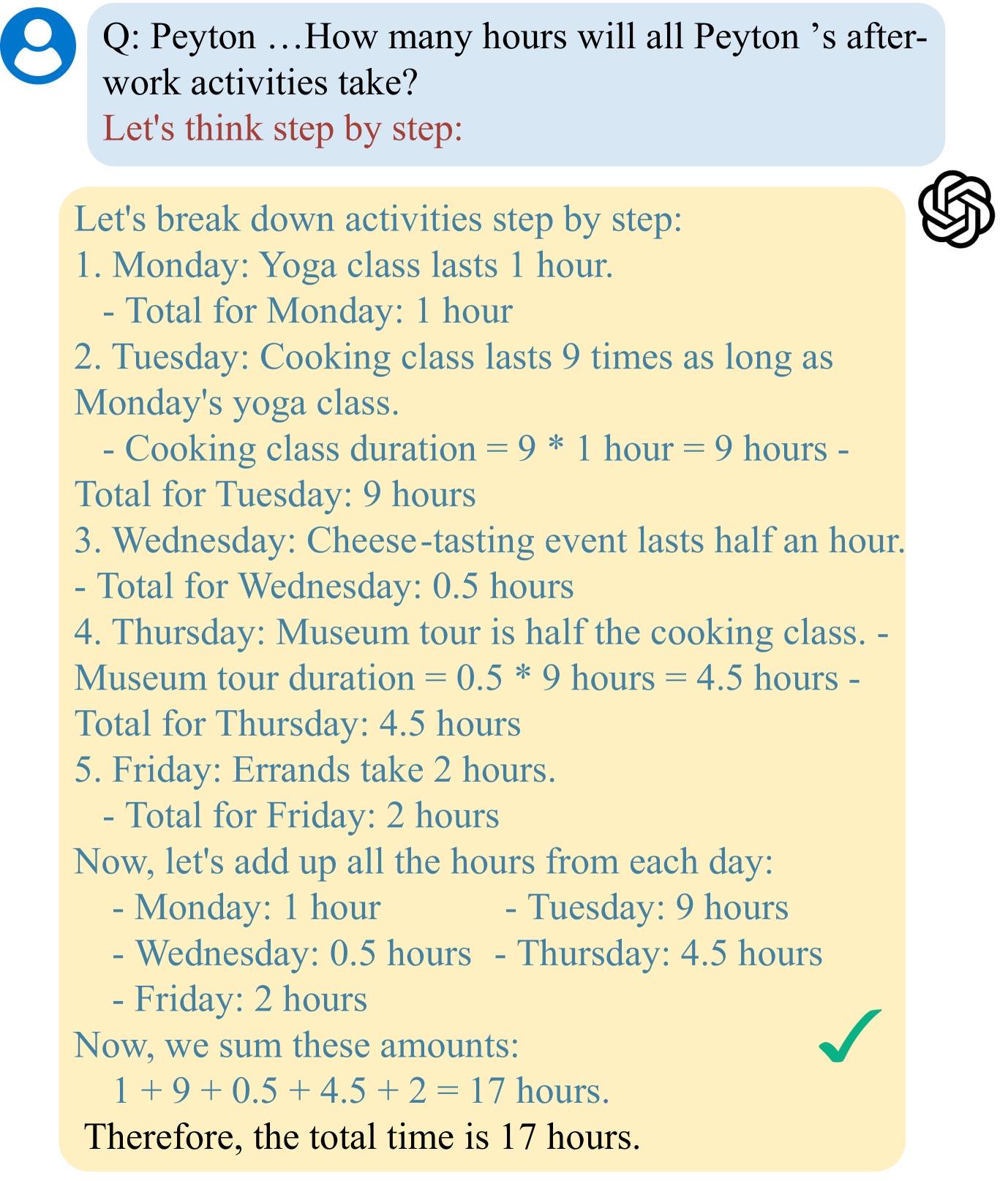

- 现有LLM推理方法,如CoT,虽然提升了性能,但token使用量大,成本高昂。

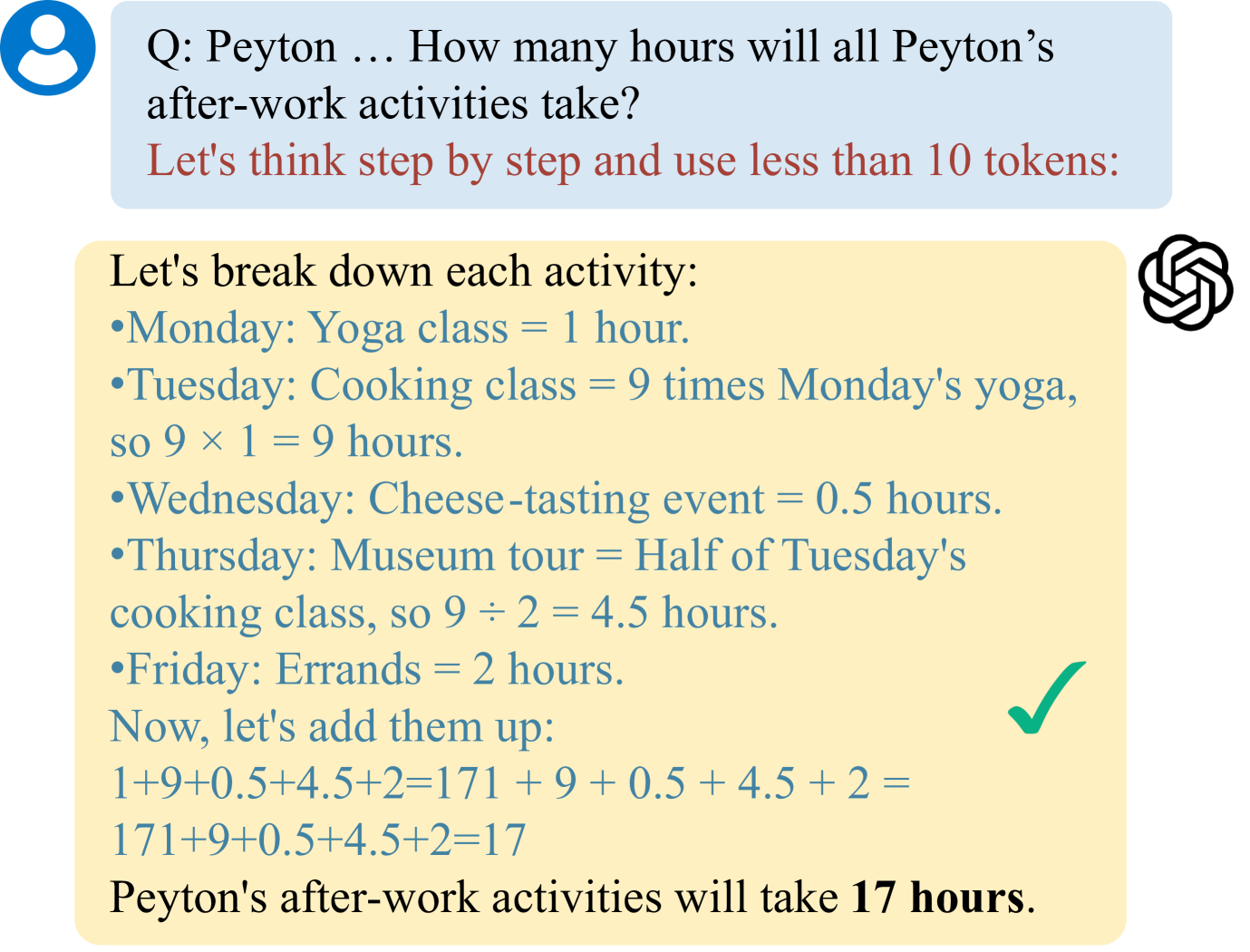

- 论文提出token-budget-aware框架,根据问题复杂度动态调整推理token数量,压缩推理过程。

- 实验表明,该方法在CoT推理中有效降低了token成本,性能仅有轻微下降。

📝 摘要(中文)

大型语言模型(LLM)的推理能力对于完成各种任务至关重要。诸如思维链(CoT)推理等方法通过将问题分解为中间步骤来增强LLM的性能,但也导致了token使用量的显著增加,从而提高了成本。我们发现,当前LLM的推理过程不必要地冗长,可以通过在提示中包含合理的token预算来压缩推理过程,但token预算的选择对实际压缩效果起着至关重要的作用。因此,我们提出了一个token-budget-aware的LLM推理框架,该框架根据每个问题的推理复杂性动态调整推理token的数量。实验表明,我们的方法有效地降低了CoT推理中的token成本,同时性能仅略有下降,为平衡LLM推理的效率和准确性提供了一个实用的解决方案。

🔬 方法详解

问题定义:现有的大型语言模型在进行推理时,特别是使用诸如CoT等方法时,会产生大量的token,导致计算成本显著增加。现有的方法没有充分考虑不同问题的推理复杂性,导致推理过程冗长,存在不必要的token消耗。因此,如何在保证推理性能的前提下,降低token的使用成本,是本文要解决的核心问题。

核心思路:论文的核心思路是根据问题的推理复杂性动态地调整LLM推理过程中使用的token数量。通过在prompt中引入token预算的概念,并根据问题的具体情况进行调整,可以有效地压缩推理过程,避免不必要的token消耗。这样既能保证推理的准确性,又能降低计算成本。

技术框架:Token-Budget-Aware LLM Reasoning框架主要包含以下几个阶段:1. 问题分析:分析输入问题的复杂程度,评估所需的推理token数量。2. Token预算设定:根据问题分析的结果,设定合理的token预算。3. LLM推理:使用设定的token预算进行LLM推理,生成中间推理步骤。4. 结果评估:评估推理结果的质量,并根据需要调整token预算。整个框架通过动态调整token预算,实现了在推理性能和token成本之间的平衡。

关键创新:该方法最重要的创新点在于提出了token-budget-aware的推理机制,能够根据问题的复杂性动态调整推理token的数量。与传统的固定token数量的推理方法相比,该方法更加灵活高效,能够更好地适应不同类型的问题。此外,该方法还提供了一种在推理性能和token成本之间进行权衡的有效手段。

关键设计:论文的关键设计在于如何确定合适的token预算。具体来说,可能涉及到以下技术细节:1. 使用启发式方法或机器学习模型来预测问题所需的token数量。2. 设计一种损失函数,用于衡量推理结果的质量和token使用量之间的平衡。3. 探索不同的prompt工程技巧,以引导LLM在给定的token预算内生成高质量的推理步骤。具体的参数设置和网络结构等细节在论文中可能没有详细描述,需要进一步查阅论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的token-budget-aware框架在CoT推理中能够有效降低token成本,同时性能仅有轻微下降。具体的性能数据和对比基线需要在论文中查找。该方法为平衡LLM推理的效率和准确性提供了一个实用的解决方案,具有重要的实际意义。

🎯 应用场景

该研究成果可广泛应用于需要LLM推理的各种场景,例如问答系统、文本摘要、机器翻译等。通过降低token使用成本,可以使得LLM在资源受限的环境中也能高效运行,并降低大规模部署的经济成本。未来,该方法有望进一步扩展到其他类型的LLM推理任务中,并与其他优化技术相结合,实现更高效、更经济的LLM应用。

📄 摘要(原文)

Reasoning is critical for large language models (LLMs) to excel in a wide range of tasks. While methods like Chain-of-Thought (CoT) reasoning and enhance LLM performance by decomposing problems into intermediate steps, they also incur significant overhead in token usage, leading to increased costs. We find that the reasoning process of current LLMs is unnecessarily lengthy and it can be compressed by including a reasonable token budget in the prompt, but the choice of token budget plays a crucial role in the actual compression effectiveness. We then propose a token-budget-aware LLM reasoning framework that dynamically adjusts the number of reasoning tokens based on the reasoning complexity of each problem. Experiments show that our method effectively reduces token costs in CoT reasoning with only a slight performance reduction, offering a practical solution to balance efficiency and accuracy in LLM reasoning. Code: https://github.com/GeniusHTX/TALE