CARL-GT: Evaluating Causal Reasoning Capabilities of Large Language Models

作者: Ruibo Tu, Hedvig Kjellström, Gustav Eje Henter, Cheng Zhang

分类: cs.CL, cs.LG, stat.ME

发布日期: 2024-12-23

💡 一句话要点

提出CARL-GT基准以评估大语言模型的因果推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果推理 大语言模型 基准评估 知识发现 决策支持

📋 核心要点

- 现有的LLM基准主要集中于对话和编码任务,缺乏对因果推理能力的全面评估。

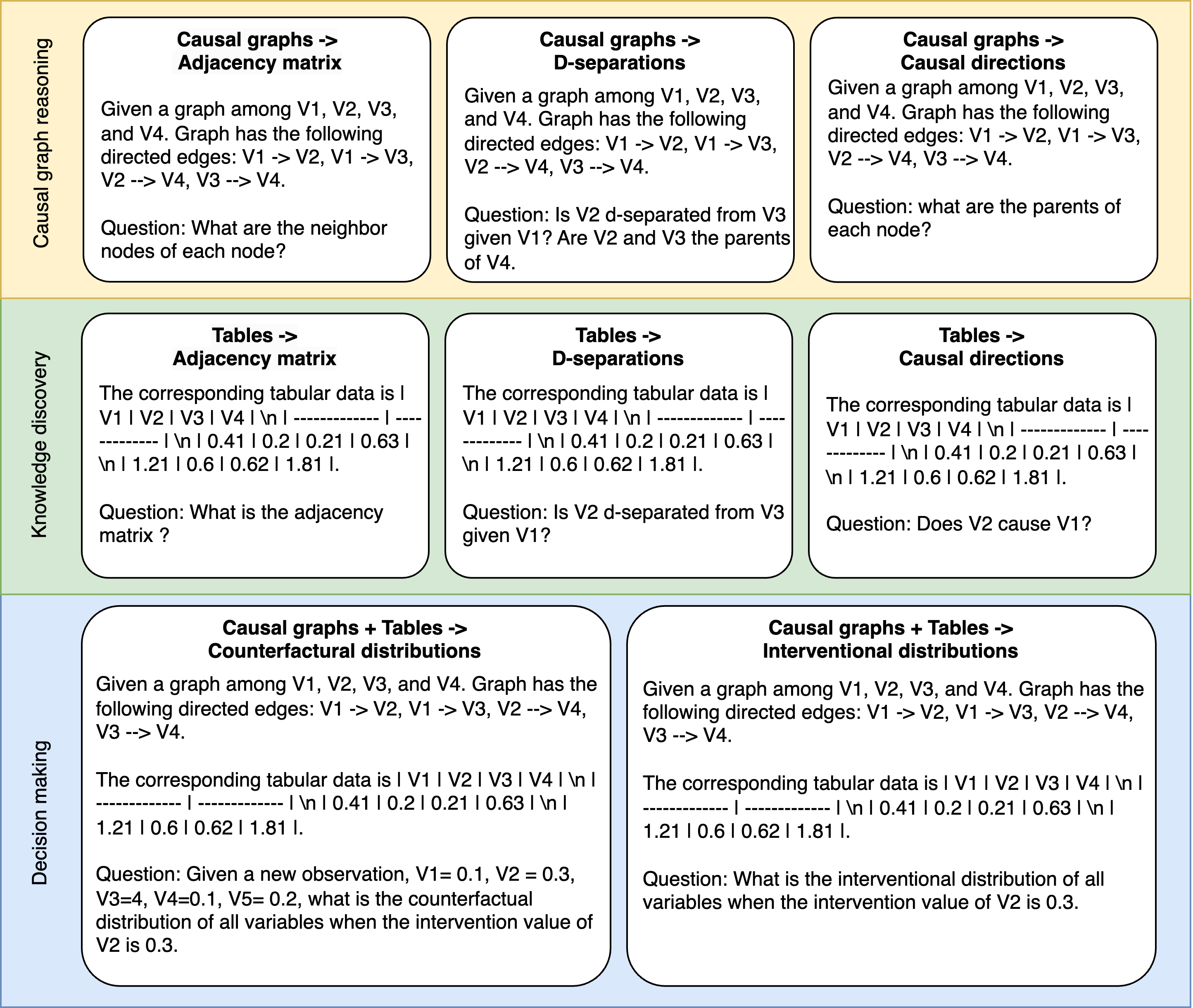

- 本文提出CARL-GT基准,利用图形和表格数据评估LLMs的因果推理能力,涵盖多种任务。

- 实验结果显示,LLMs在因果推理方面表现较弱,尤其是在表格数据的知识发现任务中。

📝 摘要(中文)

因果推理能力对于大语言模型(LLMs)在教育和医疗等多个应用领域至关重要。然而,目前缺乏有效的基准来深入理解这些能力。现有的LLM基准主要集中在对话任务、学术数学测试和编码测试上,这些测试在规范化环境中评估LLMs,但在解决现实问题的能力上存在局限性。本文提出了一个名为CARL-GT的基准,通过图形和表格数据评估LLMs的因果推理能力,涵盖因果图推理、知识发现和决策等多样化任务。此外,针对这些任务开发了有效的零样本学习提示。实验表明,LLMs在因果推理方面仍然较弱,特别是在利用表格数据发现新见解时。

🔬 方法详解

问题定义:本文旨在解决当前缺乏有效基准以评估大语言模型在因果推理能力方面的不足,尤其是在处理现实世界问题时的局限性。

核心思路:通过构建CARL-GT基准,结合图形和表格数据,全面评估LLMs在因果推理、知识发现和决策等方面的能力,设计有效的零样本学习提示以提升评估效果。

技术框架:CARL-GT基准包括多个模块,首先是因果图推理模块,其次是知识发现模块,最后是决策制定模块。每个模块都设计了特定的任务,以全面评估LLMs的因果推理能力。

关键创新:CARL-GT基准的最大创新在于其多样化的任务设计,特别是将图形和表格数据结合起来,填补了现有基准在因果推理评估中的空白。

关键设计:在任务设计中,采用了零样本学习提示,确保模型在没有额外训练的情况下能够有效应对各种任务,同时在评估过程中关注不同任务之间的性能关系。

🖼️ 关键图片

📊 实验亮点

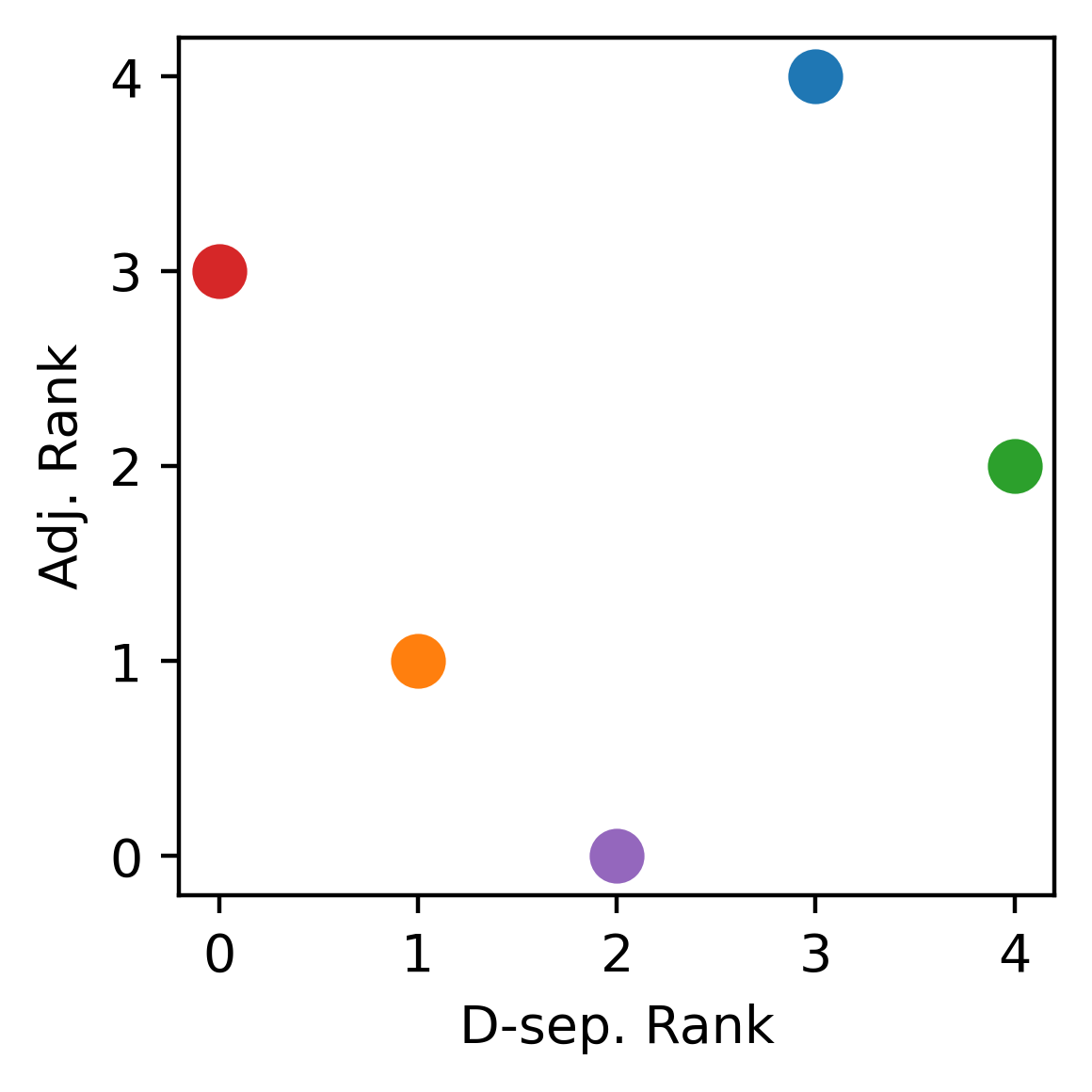

实验结果表明,LLMs在因果推理任务中的表现仍然较弱,尤其是在表格数据的知识发现任务中,性能提升幅度有限。不同任务之间的表现相关性较强,显示出LLMs在不同类别任务中的能力差异。

🎯 应用场景

该研究的潜在应用领域包括教育、医疗和决策支持系统等,能够帮助开发更具因果推理能力的智能系统,从而提高其在复杂场景中的应用效果。未来,CARL-GT基准可能成为评估大语言模型因果推理能力的标准工具,推动相关领域的研究进展。

📄 摘要(原文)

Causal reasoning capabilities are essential for large language models (LLMs) in a wide range of applications, such as education and healthcare. But there is still a lack of benchmarks for a better understanding of such capabilities. Current LLM benchmarks are mainly based on conversational tasks, academic math tests, and coding tests. Such benchmarks evaluate LLMs in well-regularized settings, but they are limited in assessing the skills and abilities to solve real-world problems. In this work, we provide a benchmark, named by CARL-GT, which evaluates CAusal Reasoning capabilities of large Language models using Graphs and Tabular data. The benchmark has a diverse range of tasks for evaluating LLMs from causal graph reasoning, knowledge discovery, and decision-making aspects. In addition, effective zero-shot learning prompts are developed for the tasks. In our experiments, we leverage the benchmark for evaluating open-source LLMs and provide a detailed comparison of LLMs for causal reasoning abilities. We found that LLMs are still weak in casual reasoning, especially with tabular data to discover new insights. Furthermore, we investigate and discuss the relationships of different benchmark tasks by analyzing the performance of LLMs. The experimental results show that LLMs have different strength over different tasks and that their performance on tasks in different categories, i.e., causal graph reasoning, knowledge discovery, and decision-making, shows stronger correlation than tasks in the same category.