A Career Interview Dialogue System using Large Language Model-based Dynamic Slot Generation

作者: Ekai Hashimoto, Mikio Nakano, Takayoshi Sakurai, Shun Shiramatsu, Toshitake Komazaki, Shiho Tsuchiya

分类: cs.CL

发布日期: 2024-12-22

备注: 9 pages, 9 tables, 2 figures; 14 pages of appendix. Accepted to COLING 2025

💡 一句话要点

提出基于LLM动态槽生成的职业访谈对话系统,提升访谈效率和质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话系统 大型语言模型 动态槽生成 溯因推理 职业访谈 人机交互 自然语言处理

📋 核心要点

- 传统槽填充对话系统在信息收集灵活性上受限,对话依赖预定义槽集合。

- 利用大型语言模型动态生成新槽,使对话更自然,信息收集更全面。

- 引入溯因推理,提升槽生成的合理性和有效性,实验验证了其性能。

📝 摘要(中文)

本研究旨在提高护理管理者进行职业访谈的效率和质量。为此,我们开发了一种槽填充对话系统,该系统在实际访谈前进行预访谈,以收集员工的职业信息作为准备步骤。传统的基于槽填充的访谈对话系统在信息收集的灵活性方面存在局限性,因为对话是基于预定义的槽集合进行的。因此,我们提出了一种利用大型语言模型(LLM)根据对话流程动态生成新槽的方法,从而实现更自然的对话。此外,我们将溯因推理融入到槽生成过程中,以实现更适当和有效的槽生成。为了验证所提出方法的有效性,我们使用用户模拟器进行了实验。结果表明,所提出的使用溯因推理的方法在增强信息收集能力和对话的自然性方面是有效的。

🔬 方法详解

问题定义:现有职业访谈对话系统依赖于预定义的槽集合,无法灵活适应对话的动态变化,导致信息收集不全面,对话不够自然。护理管理者需要更高效、高质量的访谈工具,以更好地了解员工职业发展需求。

核心思路:利用大型语言模型(LLM)的强大生成能力,在对话过程中动态生成新的槽,而不是依赖预先设定的槽。通过这种方式,系统可以根据对话的实际情况,灵活地提出问题,收集更丰富的信息,并使对话更自然流畅。

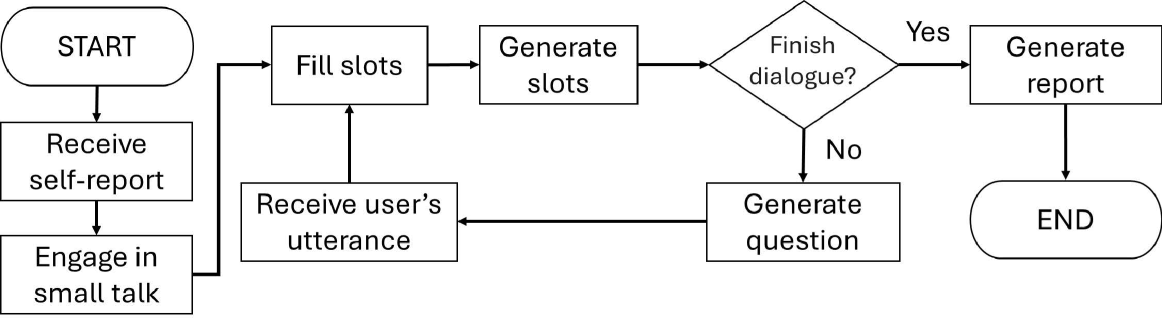

技术框架:该系统包含以下主要模块:1) 对话历史记录模块,用于存储和跟踪对话的上下文信息;2) LLM槽生成模块,利用LLM根据对话历史动态生成新的槽;3) 溯因推理模块,用于评估和筛选生成的槽,确保其合理性和有效性;4) 对话管理模块,负责控制对话的流程,并根据生成的槽提出问题。

关键创新:最重要的创新点在于动态槽生成机制,它打破了传统槽填充对话系统的静态槽限制,使系统能够根据对话的实际情况灵活地提出问题。此外,引入溯因推理进一步提升了槽生成的质量,避免生成不相关或不合理的槽。

关键设计:溯因推理模块的设计是关键。该模块使用预定义的规则或知识库,评估LLM生成的槽是否与对话上下文相关,以及是否能够有效地帮助收集所需信息。具体的实现细节,例如溯因推理的具体算法、规则或知识库的构建方法,论文中可能未详细说明。

🖼️ 关键图片

📊 实验亮点

论文通过用户模拟器实验验证了所提出方法的有效性。实验结果表明,使用溯因推理的动态槽生成方法在信息收集能力和对话自然度方面均优于传统方法。具体的性能提升数据(例如信息收集的准确率、对话的流畅度等)在摘要中未提及,属于未知信息。

🎯 应用场景

该研究成果可应用于各种需要进行信息收集和对话的场景,例如招聘面试、客户服务、医疗问诊等。通过动态槽生成,系统能够更灵活地适应对话的变化,收集更全面的信息,并提供更个性化的服务。未来,该技术有望在人机交互领域发挥重要作用,提升对话系统的智能化水平。

📄 摘要(原文)

This study aims to improve the efficiency and quality of career interviews conducted by nursing managers. To this end, we have been developing a slot-filling dialogue system that engages in pre-interviews to collect information on staff careers as a preparatory step before the actual interviews. Conventional slot-filling-based interview dialogue systems have limitations in the flexibility of information collection because the dialogue progresses based on predefined slot sets. We therefore propose a method that leverages large language models (LLMs) to dynamically generate new slots according to the flow of the dialogue, achieving more natural conversations. Furthermore, we incorporate abduction into the slot generation process to enable more appropriate and effective slot generation. To validate the effectiveness of the proposed method, we conducted experiments using a user simulator. The results suggest that the proposed method using abduction is effective in enhancing both information-collecting capabilities and the naturalness of the dialogue.