Self-guided Knowledgeable Network of Thoughts: Amplifying Reasoning with Large Language Models

作者: Chao-Chi Chen, Chin-Yuan Yeh, Hsi-Wen Chen, De-Nian Yang, Ming-Syan Chen

分类: cs.MA, cs.CL, cs.LG

发布日期: 2024-12-21

备注: SOTA result over CoT, ToT, GoT

💡 一句话要点

提出知识网络思维(kNoT),通过LLM工作流模板提升大语言模型的推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 推理 知识网络思维 LLM工作流模板 提示工程

📋 核心要点

- 现有CoT、ToT、GoT等方法在复杂推理任务中存在可靠性问题,需要大量prompt工程。

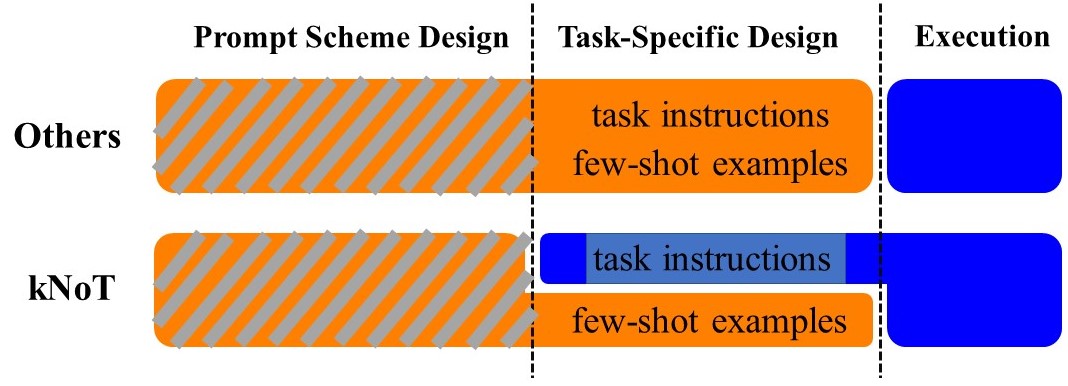

- kNoT通过LLM工作流模板(LWT)让LLM为LLM制定可执行计划,构建任意网络结构的推理流程。

- 实验表明,kNoT在排序等任务上显著优于现有方法,且大幅减少了任务特定prompt的需求。

📝 摘要(中文)

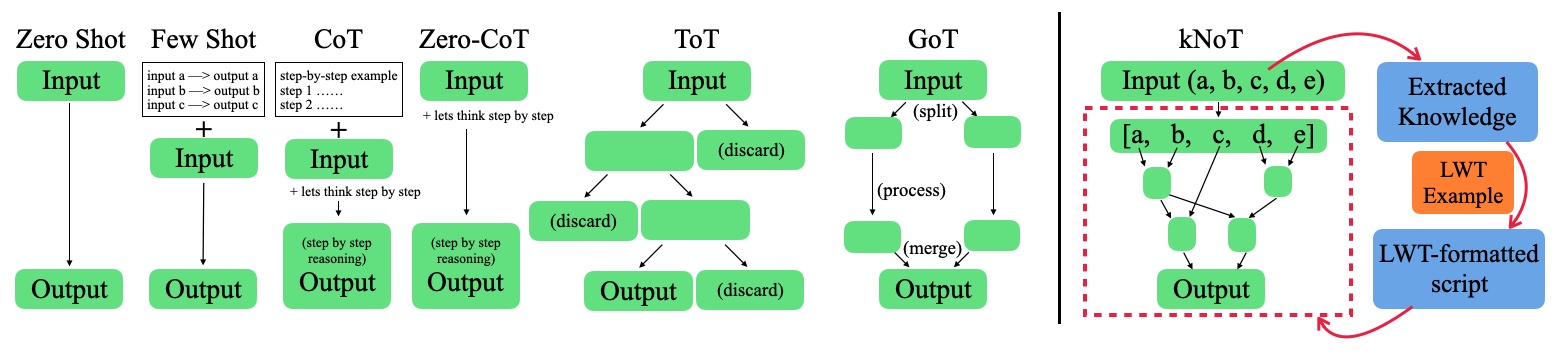

本文提出了一种名为知识网络思维(kNoT)的提示方案,旨在提升大型语言模型(LLM)的能力,超越了现有的思维链(CoT)、思维树(ToT)和思维图(GoT)等范式。kNoT的关键创新在于LLM工作流模板(LWT),它允许LLM为LLM指定可执行的计划。LWT支持将这些计划表示为任意网络,其中单步LLM操作是节点,边对应于这些步骤之间的消息传递。此外,LWT支持通过索引选择单个元素,从而使kNoT能够生成复杂的计划,其中每个LLM操作都可以限制为基本操作,从而大大提高了扩展任务序列的可靠性。实验表明,kNoT在六个用例中显著优于现有技术,同时减少了对大量提示工程的需求。例如,kNoT在对32个数字进行排序时,准确率达到92%,而ToT和GoT的准确率分别为12%和31%,同时分别减少了高达84.4%和87.3%的任务特定提示。

🔬 方法详解

问题定义:现有的大语言模型推理方法,如CoT、ToT和GoT,在处理复杂推理任务时,往往需要大量的prompt工程,并且在长序列任务中容易出现可靠性问题。这些方法难以有效地分解和管理复杂的推理过程,导致性能瓶颈。

核心思路:kNoT的核心思路是利用LLM自身的能力来规划和执行推理过程。通过引入LLM工作流模板(LWT),允许LLM定义一个可执行的计划,该计划可以表示为任意网络结构,其中每个节点代表一个单步LLM操作,边表示消息传递。这种设计使得推理过程更加模块化和可控。

技术框架:kNoT的技术框架主要包含以下几个阶段:1) 计划生成:LLM根据任务描述生成一个LWT,该LWT定义了推理步骤和它们之间的依赖关系。2) 执行:按照LWT的定义,逐步执行每个LLM操作,并将结果传递给后续步骤。3) 选择与索引:LWT支持通过索引选择单个元素,允许将复杂的LLM操作分解为更小的基本操作,从而提高可靠性。

关键创新:kNoT最重要的技术创新在于LLM工作流模板(LWT)。LWT允许LLM以网络结构的方式组织推理步骤,并支持通过索引选择和组合操作。这与CoT等线性推理方法以及ToT、GoT等树状或图状搜索方法有着本质的区别,kNoT更加灵活和可控,能够更好地处理复杂推理任务。

关键设计:LWT的设计是关键。它需要定义节点(LLM操作)的类型、输入输出格式以及节点之间的连接方式。此外,索引机制的设计也很重要,它决定了如何将复杂的LLM操作分解为基本操作。具体的参数设置和网络结构取决于具体的任务,但LWT提供了一个通用的框架,可以根据任务需求进行定制。

🖼️ 关键图片

📊 实验亮点

实验结果表明,kNoT在六个用例中显著优于现有技术。例如,在对32个数字进行排序的任务中,kNoT的准确率达到了92%,而ToT和GoT的准确率分别为12%和31%。同时,kNoT还大幅减少了对任务特定prompt的需求,分别减少了高达84.4%和87.3%。这些结果表明,kNoT能够有效地提升LLM的推理能力,并降低prompt工程的成本。

🎯 应用场景

kNoT具有广泛的应用前景,例如可以应用于复杂问题求解、代码生成、科学研究、金融分析等领域。通过将复杂任务分解为一系列可控的LLM操作,kNoT可以显著提高LLM在这些领域的应用效果,并降低对人工prompt工程的依赖。未来,kNoT有望成为构建更智能、更可靠的AI系统的关键技术。

📄 摘要(原文)

We introduce Knowledgeable Network of Thoughts (kNoT): a prompt scheme that advances the capabilities of large language models (LLMs) beyond existing paradigms like Chain-of-Thought (CoT), Tree of Thoughts (ToT), and Graph of Thoughts (GoT). The key innovation of kNoT is the LLM Workflow Template (LWT), which allows for an executable plan to be specified by LLMs for LLMs. LWT allows these plans to be arbitrary networks, where single-step LLM operations are nodes, and edges correspond to message passing between these steps. Furthermore, LWT supports selection of individual elements through indexing, facilitating kNoT to produce intricate plans where each LLM operation can be limited to elementary operations, greatly enhancing reliability over extended task sequences. We demonstrate that kNoT significantly outperforms the state of the art on six use cases, while reducing the need for extensive prompt engineering. For instance, kNoT finds 92% accuracy for sorting 32 numbers over 12% and 31% for ToT and GoT, while utilizing up to 84.4% and 87.3% less task-specific prompts, respectively.