The Only Way is Ethics: A Guide to Ethical Research with Large Language Models

作者: Eddie L. Ungless, Nikolas Vitsakis, Zeerak Talat, James Garforth, Björn Ross, Arno Onken, Atoosa Kasirzadeh, Alexandra Birch

分类: cs.CL, cs.AI

发布日期: 2024-12-20

备注: Accepted to COLING '25. This paper is the condensed pocket guide to accompany our full LLM Ethics Whitepaper, available at arXiv:2410.19812, and at https://github.com/MxEddie/Ethics-Whitepaper for suggested revisions

💡 一句话要点

构建LLM伦理白皮书:为NLP从业者提供LLM伦理研究的实用指南

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 伦理研究 自然语言处理 人工智能伦理 白皮书 研究指南 NLP伦理 道德风险

📋 核心要点

- 现有LLM伦理研究分散,缺乏整合的实用指南,难以指导实际研究。

- 本文构建了“LLM伦理白皮书”,将伦理文献转化为具体建议,为计算机科学家提供清晰的初步步骤。

- 白皮书提炼了“应该做”和“不应该做”的准则,并识别出支持伦理工作的工具包。

📝 摘要(中文)

现有大量工作关注大型语言模型(LLM)的伦理考量,包括批评性能和危害的评估工具、提出辅助构思的工具包、讨论对工作者的风险以及考虑隐私和安全相关的立法等。然而,目前还没有工作将这些资源整合到一个专注于LLM的实用指南中。本文旨在实现这一目标,推出了“LLM伦理白皮书”,并将其作为NLP从业者和负责评估他人工作伦理影响的人员的开放式动态资源。目标是将伦理文献转化为具体的建议和启发,为计算机科学家提供清晰的初步步骤。“LLM伦理白皮书”将全面的文献综述提炼为清晰的“应该做”和“不应该做”的准则,并在本文中展示。同时,也识别出支持伦理工作的有用工具包。感兴趣的读者可以参考完整的LLM伦理白皮书,其中提供了项目生命周期每个阶段的伦理考量简明讨论,以及引用了数百篇论文,这些论文构成了建议的基础。本文可以被认为是进行LLM伦理研究的袖珍指南。

🔬 方法详解

问题定义:当前针对大型语言模型(LLM)的伦理研究存在碎片化的问题,缺乏一个统一的、实用的指南来指导研究人员在LLM的开发和应用过程中充分考虑伦理因素。现有的伦理资源分散在不同的论文、工具包和立法讨论中,难以系统性地应用到实际项目中。因此,研究人员需要一个集成的资源,能够提供具体的建议和工具,以确保LLM的开发和使用符合伦理标准。

核心思路:本文的核心思路是整合现有的LLM伦理研究资源,并将其转化为一个实用、易于理解的指南,即“LLM伦理白皮书”。该白皮书旨在为NLP从业者和负责评估他人工作伦理影响的人员提供一个开放式的动态资源,帮助他们在LLM项目的各个阶段识别和解决潜在的伦理问题。通过将伦理文献提炼为具体的“应该做”和“不应该做”的准则,并提供相关的工具包,该白皮书旨在促进LLM的伦理开发和应用。

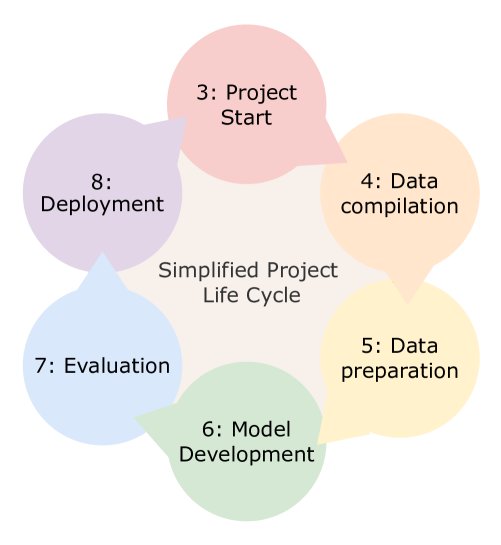

技术框架:LLM伦理白皮书的整体框架围绕LLM项目的生命周期展开,涵盖了项目规划、数据收集、模型训练、评估和部署等各个阶段。在每个阶段,白皮书都提供了相应的伦理考量和建议,包括:1) 识别潜在的伦理风险;2) 评估风险的影响;3) 制定缓解措施;4) 监控和评估措施的有效性。此外,白皮书还提供了相关的工具包和资源,以支持研究人员进行伦理评估和风险管理。

关键创新:本文的关键创新在于将分散的LLM伦理研究资源整合为一个统一的、实用的指南。与现有方法相比,该白皮书不仅提供了理论上的伦理考量,还提供了具体的建议和工具,帮助研究人员在实际项目中应用伦理原则。此外,该白皮书是一个开放式的动态资源,可以根据LLM技术的发展和伦理问题的变化进行更新和完善。

关键设计:LLM伦理白皮书的关键设计包括:1) 清晰的“应该做”和“不应该做”的准则,帮助研究人员快速识别和解决伦理问题;2) 针对LLM项目生命周期各个阶段的伦理考量和建议;3) 相关的工具包和资源,支持研究人员进行伦理评估和风险管理;4) 开放式的动态资源,可以根据LLM技术的发展和伦理问题的变化进行更新和完善。

🖼️ 关键图片

📊 实验亮点

本文的主要亮点在于构建了一个全面的LLM伦理白皮书,它整合了数百篇相关论文的建议,并将其转化为清晰的行动指南。该白皮书不仅提供了理论层面的伦理考量,更重要的是,它为研究人员提供了在LLM项目各个阶段应用伦理原则的具体方法和工具。虽然论文本身没有提供具体的性能数据,但其价值在于为LLM的伦理研究和实践提供了一个重要的框架。

🎯 应用场景

该研究成果可广泛应用于所有涉及大型语言模型的研究和开发领域,包括但不限于自然语言处理、机器翻译、文本生成、对话系统等。通过提供伦理指导,有助于确保LLM的应用符合伦理标准,减少潜在的社会危害,并促进负责任的人工智能发展。该白皮书可以作为企业、研究机构和政府部门制定LLM伦理规范的重要参考。

📄 摘要(原文)

There is a significant body of work looking at the ethical considerations of large language models (LLMs): critiquing tools to measure performance and harms; proposing toolkits to aid in ideation; discussing the risks to workers; considering legislation around privacy and security etc. As yet there is no work that integrates these resources into a single practical guide that focuses on LLMs; we attempt this ambitious goal. We introduce 'LLM Ethics Whitepaper', which we provide as an open and living resource for NLP practitioners, and those tasked with evaluating the ethical implications of others' work. Our goal is to translate ethics literature into concrete recommendations and provocations for thinking with clear first steps, aimed at computer scientists. 'LLM Ethics Whitepaper' distils a thorough literature review into clear Do's and Don'ts, which we present also in this paper. We likewise identify useful toolkits to support ethical work. We refer the interested reader to the full LLM Ethics Whitepaper, which provides a succinct discussion of ethical considerations at each stage in a project lifecycle, as well as citations for the hundreds of papers from which we drew our recommendations. The present paper can be thought of as a pocket guide to conducting ethical research with LLMs.