TelcoLM: collecting data, adapting, and benchmarking language models for the telecommunication domain

作者: Camille Barboule, Viet-Phi Huynh, Adrien Bufort, Yoan Chabot, Géraldine Damnati, Gwénolé Lecorvé

分类: cs.CL, cs.AI

发布日期: 2024-12-20

备注: 30 pages (main: 13 pages, appendices: 17 pages), 1 figure, 22 tables, achieved March 2024, released December 2024

💡 一句话要点

TelcoLM:构建、适配和评测电信领域专用语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 电信领域 语言模型 领域适配 指令调优 Llama-2 自然语言处理 知识密集型任务

📋 核心要点

- 大型语言模型在特定技术领域,如电信领域,由于专业术语和概念的复杂性,表现仍有不足。

- 该论文提出TelcoLM,通过收集领域数据并进行模型适配,提升LLM在电信领域的性能。

- 实验结果表明,经过领域适配的Llama-2-7b模型在电信相关任务上可与大型通用模型相媲美,且仅需指令调优。

📝 摘要(中文)

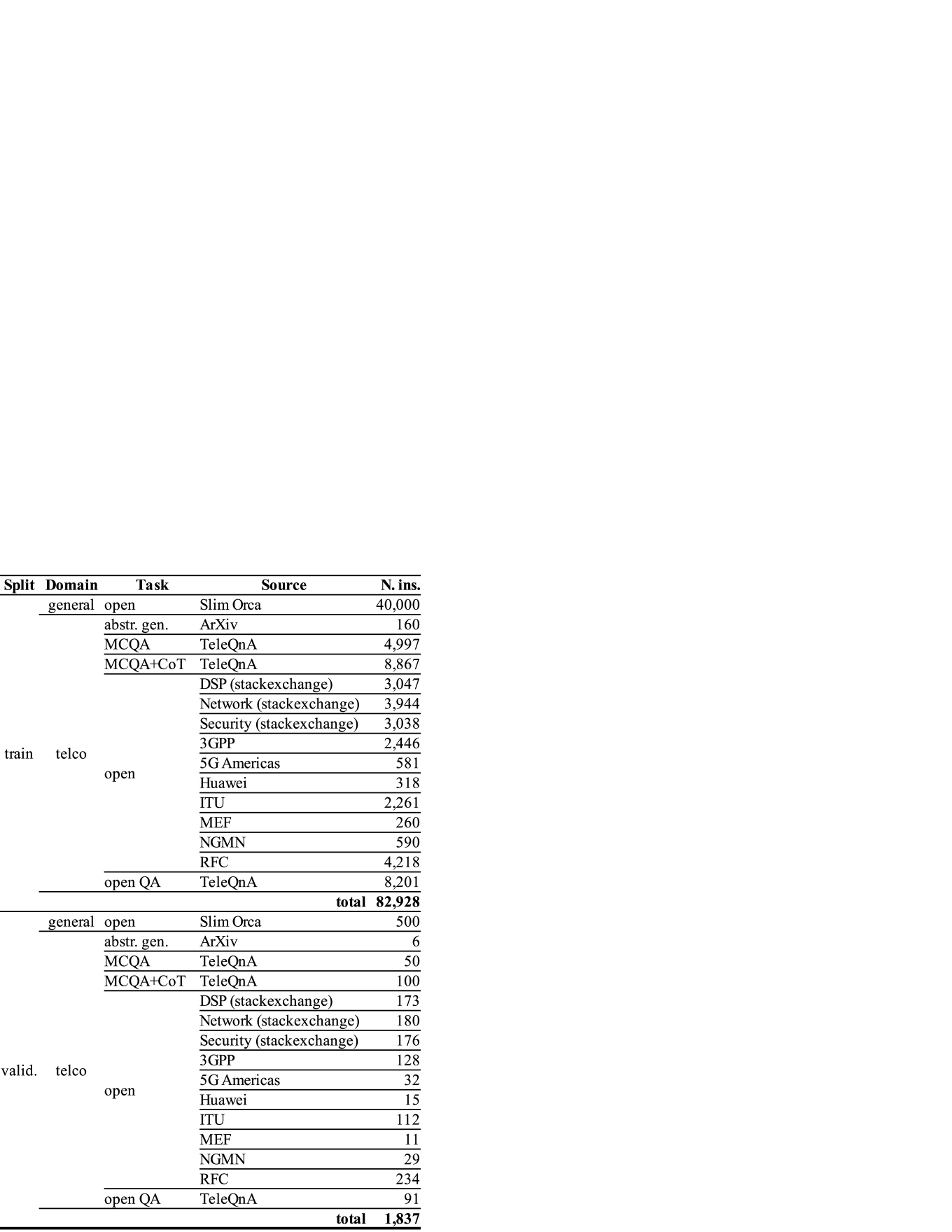

大型语言模型(LLM)在许多任务中表现出色,但在处理高度技术化的领域时仍然缺乏准确性。电信(telco)领域由于其大量的词汇、语义和概念特殊性,尤其具有挑战性。然而,该领域拥有许多与工业需求直接相关的有价值的用例。因此,本文研究了如何将LLM适配到电信领域。它报告了我们在以下方面的努力:(i)收集大量的领域特定数据(8亿tokens,8万条指令),(ii)使用各种方法进行适配,以及(iii)在需要广泛电信知识的下游任务中,针对更大的通用模型进行基准测试。我们对Llama-2-7b的实验表明,领域适配的模型可以挑战大型通用模型。他们还表明,适配可以仅限于一个独特的指令调优步骤,而不需要事先对原始文本进行任何微调。

🔬 方法详解

问题定义:现有的大型语言模型在处理电信领域相关的任务时,由于缺乏特定领域的知识和理解,准确性不足。通用模型难以应对电信领域中大量的专业术语、语义和概念的特殊性,导致在实际应用中效果不佳。

核心思路:论文的核心思路是通过收集大量的电信领域数据,并利用这些数据对现有的LLM进行适配,使其具备更强的领域知识和理解能力。通过领域适配,模型能够更好地理解和处理电信领域相关的任务,从而提高准确性和性能。

技术框架:TelcoLM的构建主要包含三个阶段:数据收集、模型适配和基准测试。首先,收集大量的电信领域数据,包括文本数据和指令数据。然后,使用收集到的数据,采用不同的方法对LLM进行适配,例如指令调优和微调。最后,在电信领域相关的下游任务中,对适配后的模型进行基准测试,评估其性能。

关键创新:该论文的关键创新在于提出了一种针对电信领域的LLM适配方法,该方法强调数据收集的重要性,并探索了不同的适配策略。此外,实验结果表明,仅使用指令调优即可达到较好的适配效果,无需预先对原始文本进行微调,这大大简化了适配流程。

关键设计:论文中收集了8亿tokens的领域特定数据和8万条指令数据。模型适配主要基于Llama-2-7b,并采用了指令调优的方法。具体的指令调优过程和超参数设置在论文中未详细说明,属于未知信息。损失函数和网络结构沿用了Llama-2-7b的默认设置,没有进行修改。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过领域适配的Llama-2-7b模型在电信相关任务上表现出色,能够与大型通用模型相媲美。更重要的是,实验证明仅通过指令调优即可实现有效的领域适配,无需预先对原始文本进行微调,这大大降低了适配的复杂度和成本。具体性能提升数据未知。

🎯 应用场景

该研究成果可应用于电信行业的多个领域,例如智能客服、故障诊断、网络优化等。通过提升LLM在电信领域的理解和生成能力,可以提高工作效率、降低运营成本,并为用户提供更优质的服务。未来,该研究可以进一步扩展到其他专业领域,为各行各业的智能化转型提供支持。

📄 摘要(原文)

Despite outstanding processes in many tasks, Large Language Models (LLMs) still lack accuracy when dealing with highly technical domains. Especially, telecommunications (telco) is a particularly challenging domain due the large amount of lexical, semantic and conceptual peculiarities. Yet, this domain holds many valuable use cases, directly linked to industrial needs. Hence, this paper studies how LLMs can be adapted to the telco domain. It reports our effort to (i) collect a massive corpus of domain-specific data (800M tokens, 80K instructions), (ii) perform adaptation using various methodologies, and (iii) benchmark them against larger generalist models in downstream tasks that require extensive knowledge of telecommunications. Our experiments on Llama-2-7b show that domain-adapted models can challenge the large generalist models. They also suggest that adaptation can be restricted to a unique instruction-tuning step, dicarding the need for any fine-tuning on raw texts beforehand.