Dynamic Label Name Refinement for Few-Shot Dialogue Intent Classification

作者: Gyutae Park, Ingeol Baek, ByeongJeong Kim, Joongbo Shin, Hwanhee Lee

分类: cs.CL

发布日期: 2024-12-20

备注: 11 pages, 3 figures, 11 tables

💡 一句话要点

提出动态标签优化方法,解决少样本对话意图分类中语义混淆问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话意图分类 少样本学习 动态标签优化 上下文学习 大型语言模型

📋 核心要点

- 现有对话意图分类方法难以区分大量语义相似的意图类别,导致分类精度下降。

- 该论文提出一种基于上下文学习和动态标签优化的方法,利用大语言模型提升意图区分度。

- 实验结果表明,该方法在多个数据集上显著提升了少样本意图分类的性能,并生成更易解释的标签。

📝 摘要(中文)

对话意图分类旨在识别对话中用户输入的潜在目的或意图。现有的意图分类系统面临着巨大的挑战,主要是由于大量可能的意图以及相似意图类别之间显著的语义重叠。本文提出了一种新的少样本对话意图分类方法,通过上下文学习,结合动态标签优化来应对这些挑战。我们的方法从训练集中检索与测试输入相关的示例,并利用大型语言模型基于语义理解动态地优化意图标签,确保意图之间清晰可辨。实验结果表明,与基线方法相比,我们的方法有效地解决了语义相似意图之间的混淆,从而显著提高了多个数据集上的性能。我们还表明,与基线方法相比,我们的方法生成了更易于解释的意图标签,并且在捕获潜在用户意图方面具有更好的语义连贯性。

🔬 方法详解

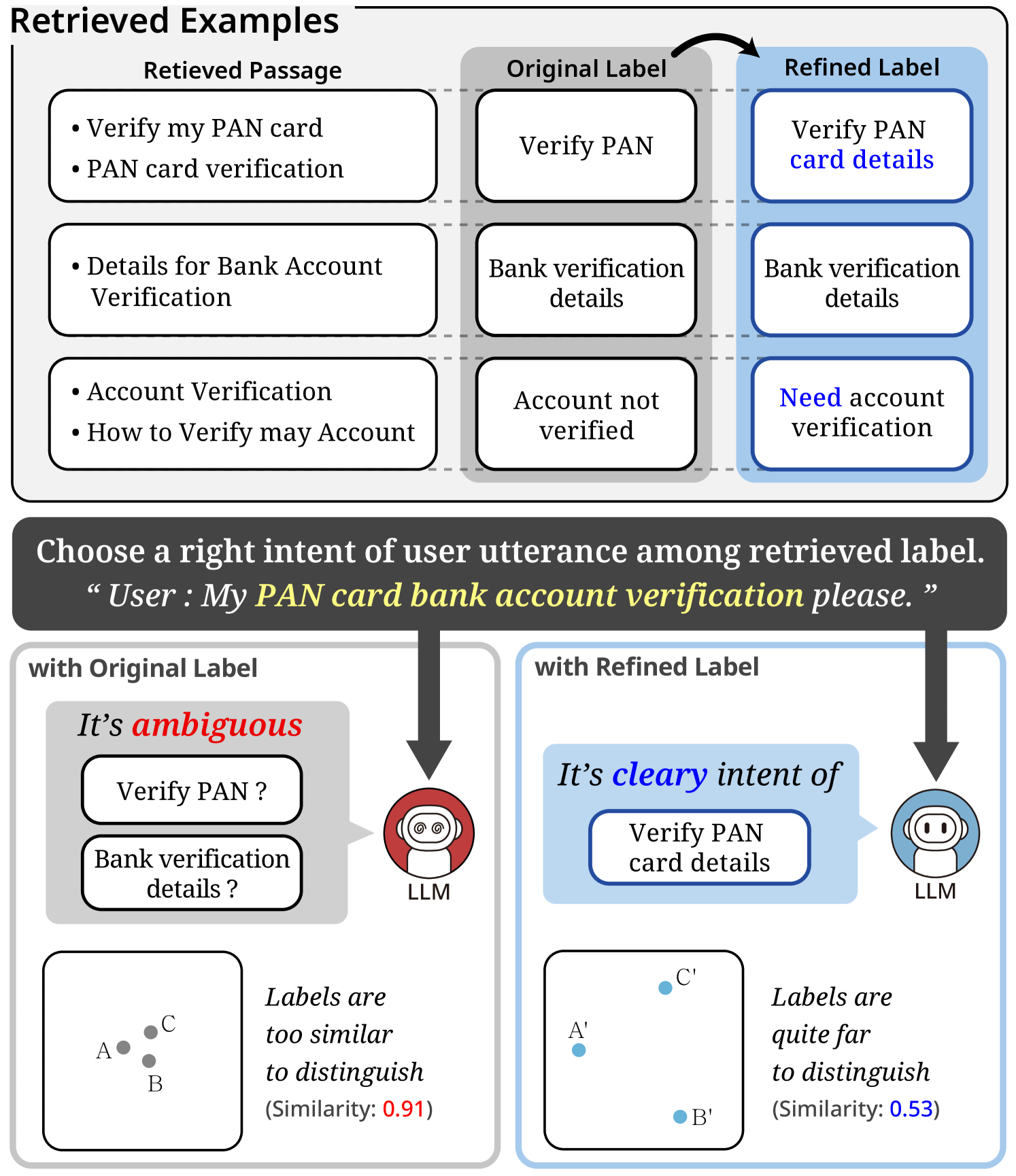

问题定义:论文旨在解决少样本对话意图分类中,由于大量意图类别和语义重叠导致的意图混淆问题。现有方法难以有效区分语义相似的意图,导致分类精度较低。尤其是在少样本场景下,模型难以学习到足够区分不同意图的特征。

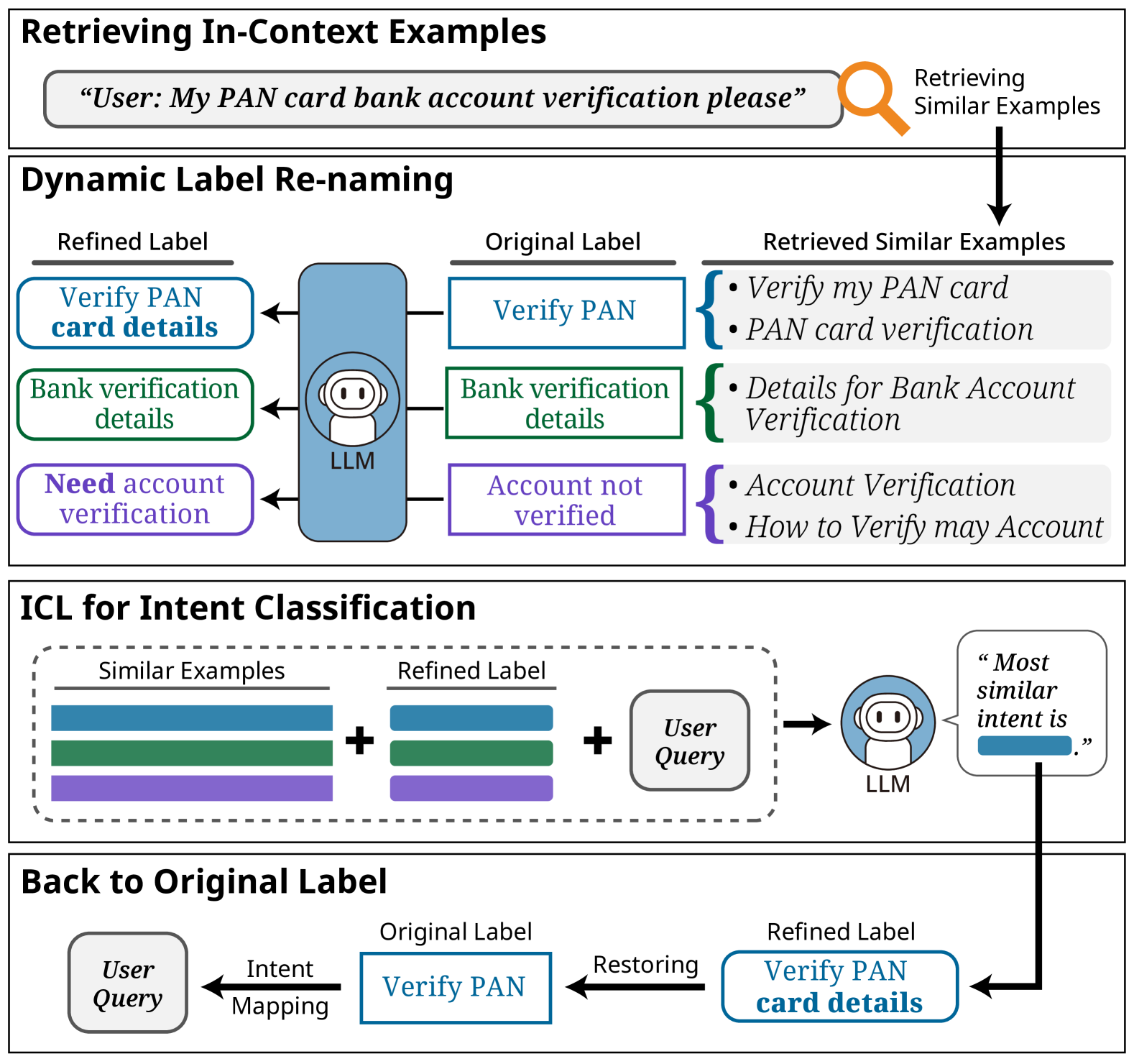

核心思路:论文的核心思路是利用大型语言模型(LLM)的语义理解能力,动态地优化意图标签,使得语义相似的意图在标签层面就能被清晰地区分。通过上下文学习,LLM可以根据输入的上下文信息,更好地理解意图的细微差别,从而生成更具区分性的标签。

技术框架:整体框架包含以下几个主要阶段:1) 从训练集中检索与测试输入相关的示例;2) 利用LLM,基于检索到的示例和测试输入,动态地优化意图标签;3) 使用优化后的标签训练分类器;4) 对测试输入进行意图分类。该框架利用了上下文学习的能力,使得模型能够更好地理解意图的语义信息。

关键创新:最重要的技术创新点在于动态标签优化。与传统的静态标签相比,动态标签能够根据具体的输入上下文进行调整,从而更好地反映意图的真实含义。这种动态性使得模型能够更好地处理语义相似的意图,并提高分类精度。此外,利用LLM进行标签优化也降低了人工标注的成本。

关键设计:在标签优化阶段,论文使用了Prompt Engineering技术,设计合适的Prompt,引导LLM生成更具区分性的意图标签。具体的Prompt形式未知,但其目标是让LLM能够理解输入上下文,并根据上下文信息对意图标签进行细化和调整。损失函数未知,但推测是标准的交叉熵损失函数,用于训练意图分类器。

🖼️ 关键图片

📊 实验亮点

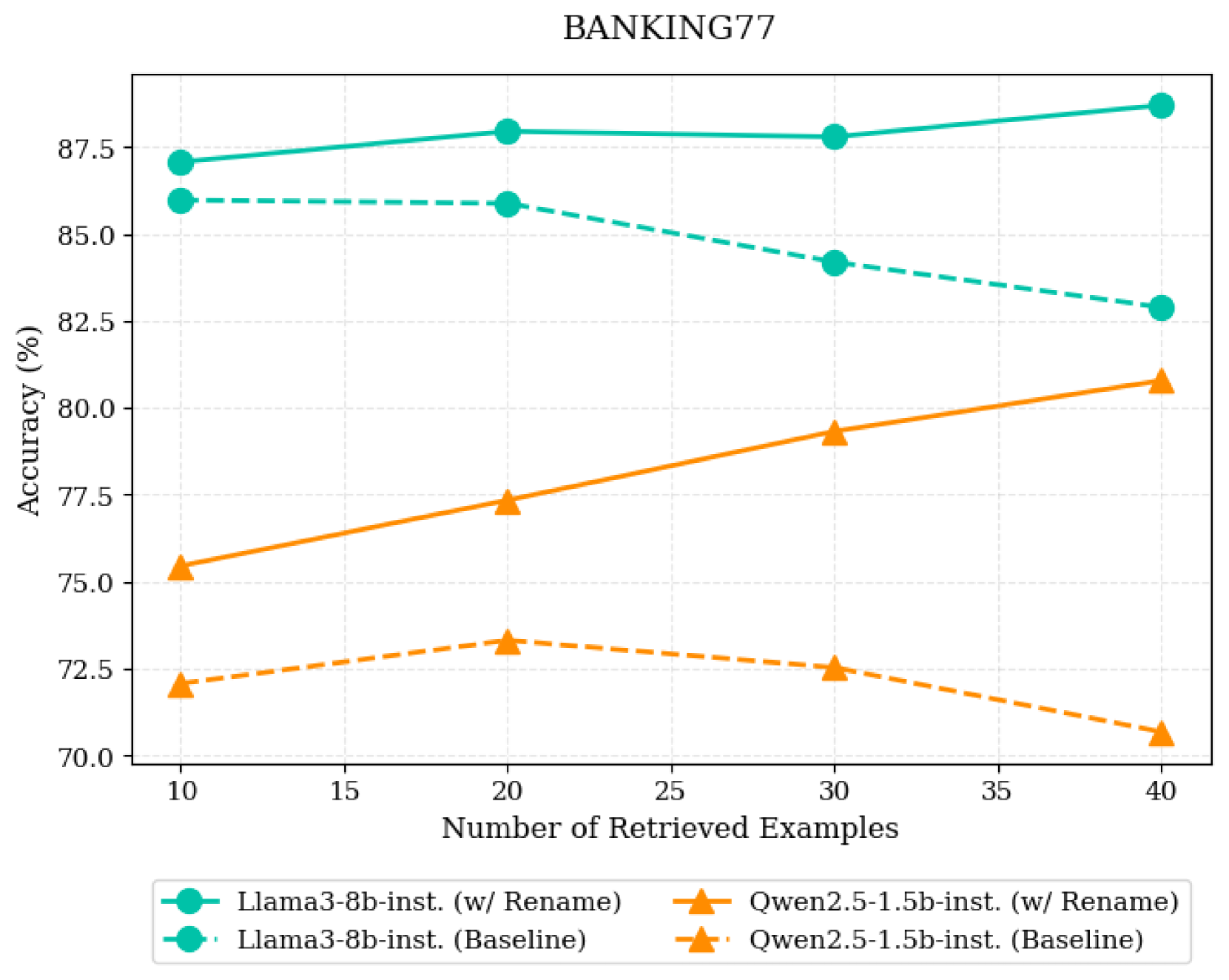

实验结果表明,该方法在多个少样本对话意图分类数据集上取得了显著的性能提升。具体提升幅度未知,但论文强调该方法有效地解决了语义相似意图之间的混淆问题,并生成了更易于解释的意图标签。与基线方法相比,该方法在捕获潜在用户意图方面具有更好的语义连贯性。

🎯 应用场景

该研究成果可应用于智能客服、语音助手等领域,提升对话系统的意图识别准确率,从而改善用户体验。通过动态标签优化,可以减少人工标注成本,加速对话系统的开发和部署。未来,该方法可以扩展到其他自然语言处理任务,如文本分类、情感分析等。

📄 摘要(原文)

Dialogue intent classification aims to identify the underlying purpose or intent of a user's input in a conversation. Current intent classification systems encounter considerable challenges, primarily due to the vast number of possible intents and the significant semantic overlap among similar intent classes. In this paper, we propose a novel approach to few-shot dialogue intent classification through in-context learning, incorporating dynamic label refinement to address these challenges. Our method retrieves relevant examples for a test input from the training set and leverages a large language model to dynamically refine intent labels based on semantic understanding, ensuring that intents are clearly distinguishable from one another. Experimental results demonstrate that our approach effectively resolves confusion between semantically similar intents, resulting in significantly enhanced performance across multiple datasets compared to baselines. We also show that our method generates more interpretable intent labels, and has a better semantic coherence in capturing underlying user intents compared to baselines.