Humanlike Cognitive Patterns as Emergent Phenomena in Large Language Models

作者: Zhisheng Tang, Mayank Kejriwal

分类: cs.CL, cs.AI

发布日期: 2024-12-20

💡 一句话要点

综述性研究:大型语言模型涌现类人认知模式的系统性分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 认知模式 决策偏差 推理能力 创造力 人机协作 系统综述 心理学测试

📋 核心要点

- 大型语言模型涌现的类人认知模式引发了心理学和人工智能领域的广泛关注,但缺乏系统性的综述。

- 本文通过分析LLMs在决策、推理和创造力三个认知领域的表现,揭示其与人类认知模式的异同。

- 研究结果表明,LLMs在特定认知任务中展现出类人能力,但在其他任务中存在局限性,并探讨了其作为协作工具的潜力。

📝 摘要(中文)

本文系统性地综述了大型语言模型(LLMs)在三个重要认知领域——决策偏差、推理和创造力——的能力。通过分析基于心理学测试的实证研究,并将LLMs的性能与人类基准进行比较,我们发现:在决策方面,LLMs表现出一些类人偏差,但并非所有人类偏差都存在,表明其认知模式与人类决策仅部分一致;在推理方面,GPT-4等高级LLMs展现出类似于人类系统2思维的审慎推理,而较小的模型则达不到人类水平;在创造力方面,LLMs擅长基于语言的创造性任务(如讲故事),但在需要真实世界背景的发散性思维任务中表现不佳。然而,研究表明LLMs作为协作工具具有相当大的潜力,可以增强人机问题解决中的创造力。最后,我们讨论了关键局限性,并为未来在记忆、注意力和开源模型开发等领域的研究提供了指导。

🔬 方法详解

问题定义:现有研究对大型语言模型(LLMs)涌现的类人认知模式缺乏系统性的综述,难以全面理解LLMs在不同认知领域的表现。现有方法通常侧重于特定任务或模型,缺乏跨领域和模型的综合分析,无法有效揭示LLMs与人类认知的异同。

核心思路:本文的核心思路是通过系统性地回顾和分析LLMs在决策偏差、推理和创造力三个关键认知领域的实证研究,对比LLMs与人类的性能,从而揭示LLMs类人认知模式的特点和局限性。通过这种对比分析,可以更深入地理解LLMs的认知能力,并为未来的研究提供指导。

技术框架:本文采用综述研究的方法,主要包含以下几个阶段: 1. 文献检索:系统性地搜索和筛选相关研究论文,涵盖LLMs在决策、推理和创造力方面的应用。 2. 数据提取:从筛选出的论文中提取关键数据,包括LLMs的性能指标、使用的心理学测试、以及与人类基准的比较结果。 3. 综合分析:对提取的数据进行综合分析,比较LLMs与人类在不同认知任务中的表现,识别LLMs的类人认知模式和局限性。 4. 结果总结与讨论:总结研究结果,讨论LLMs的潜在应用和未来研究方向。

关键创新:本文的创新之处在于: 1. 系统性地综述了LLMs在三个重要认知领域的表现,提供了全面的视角。 2. 通过对比LLMs与人类的性能,揭示了LLMs类人认知模式的特点和局限性。 3. 为未来的研究提供了指导,包括记忆、注意力和开源模型开发等领域。

关键设计:本文主要关注已发表的实证研究,并基于这些研究结果进行综合分析。没有涉及具体的模型参数设置、损失函数或网络结构的设计。关键在于对现有研究的系统性整理和归纳,以及对LLMs与人类认知差异的深入分析。

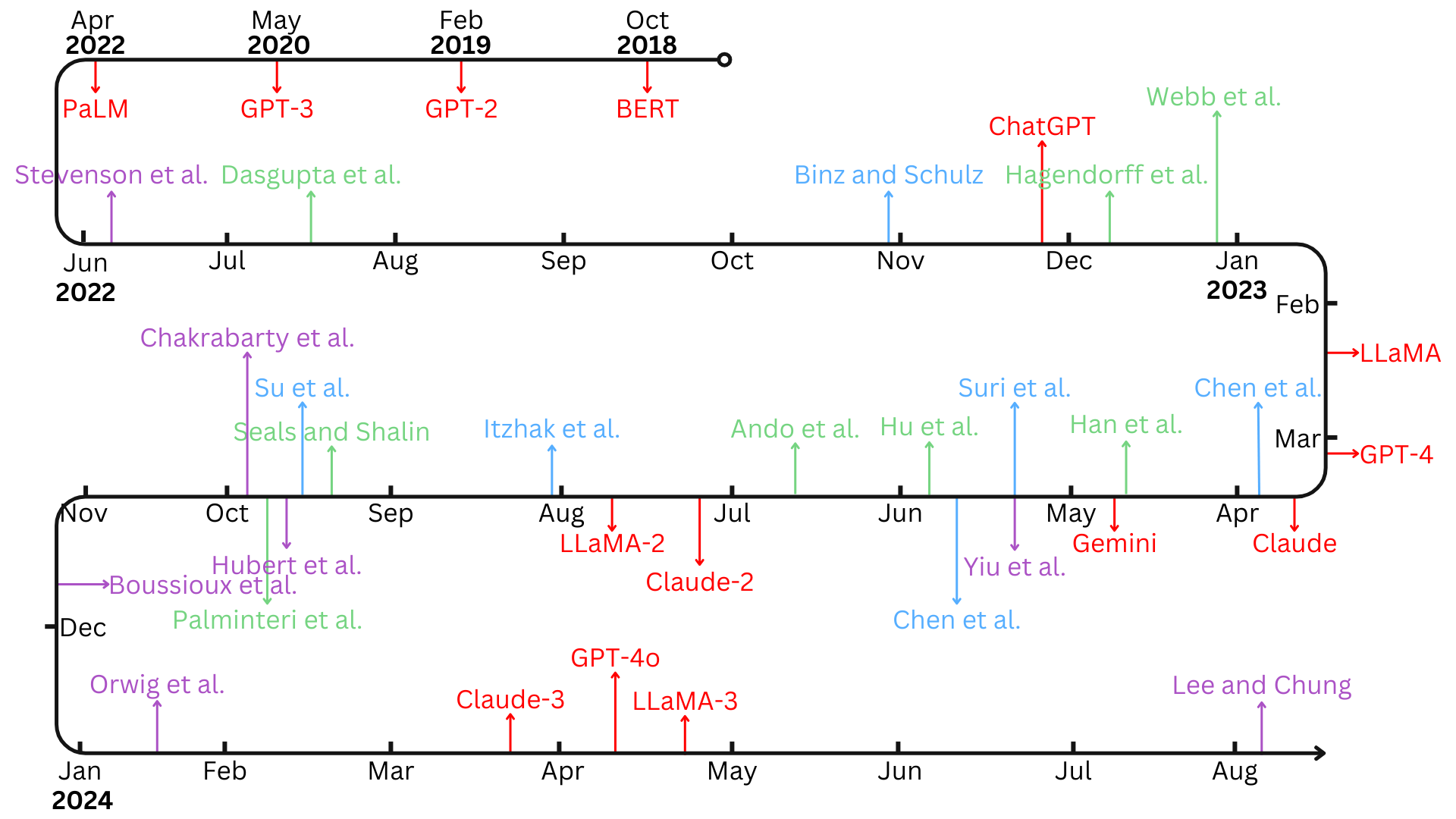

🖼️ 关键图片

📊 实验亮点

研究表明,GPT-4等高级LLMs在推理方面表现出类似于人类系统2思维的审慎推理能力,但在需要真实世界背景的发散性思维任务中表现不佳。LLMs在语言类创造性任务(如讲故事)中表现出色,但在决策方面,虽然展现出一些类人偏差,但并非所有人类偏差都存在。这些结果揭示了LLMs认知能力的复杂性和局限性。

🎯 应用场景

该研究成果可应用于评估和改进大型语言模型的认知能力,指导人机协作系统的设计,以及深入理解人工智能的认知机制。通过了解LLMs的优势和局限性,可以更好地利用它们解决实际问题,例如辅助决策、创意生成和智能客服等。未来的研究可以进一步探索LLMs在更广泛认知领域的应用,并开发更具通用性和鲁棒性的认知模型。

📄 摘要(原文)

Research on emergent patterns in Large Language Models (LLMs) has gained significant traction in both psychology and artificial intelligence, motivating the need for a comprehensive review that offers a synthesis of this complex landscape. In this article, we systematically review LLMs' capabilities across three important cognitive domains: decision-making biases, reasoning, and creativity. We use empirical studies drawing on established psychological tests and compare LLMs' performance to human benchmarks. On decision-making, our synthesis reveals that while LLMs demonstrate several human-like biases, some biases observed in humans are absent, indicating cognitive patterns that only partially align with human decision-making. On reasoning, advanced LLMs like GPT-4 exhibit deliberative reasoning akin to human System-2 thinking, while smaller models fall short of human-level performance. A distinct dichotomy emerges in creativity: while LLMs excel in language-based creative tasks, such as storytelling, they struggle with divergent thinking tasks that require real-world context. Nonetheless, studies suggest that LLMs hold considerable potential as collaborators, augmenting creativity in human-machine problem-solving settings. Discussing key limitations, we also offer guidance for future research in areas such as memory, attention, and open-source model development.