RobustFT: Robust Supervised Fine-tuning for Large Language Models under Noisy Response

作者: Junyu Luo, Xiao Luo, Kaize Ding, Jingyang Yuan, Zhiping Xiao, Ming Zhang

分类: cs.CL, cs.AI

发布日期: 2024-12-19

💡 一句话要点

提出RobustFT框架,解决大语言模型在噪声响应下的鲁棒微调问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 鲁棒微调 噪声数据 大型语言模型 多专家系统 上下文增强 数据清洗 响应熵

📋 核心要点

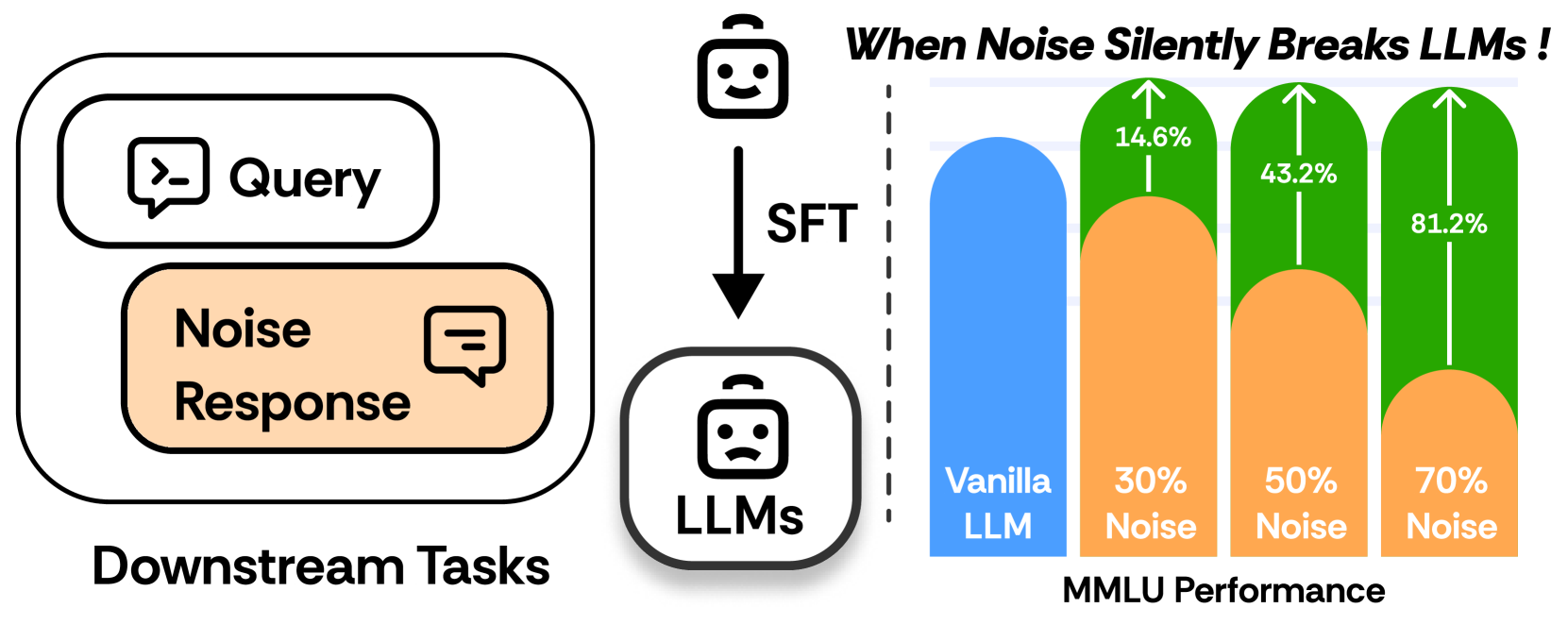

- 现有监督微调方法在噪声数据下性能显著下降,无法保证下游任务的有效性。

- RobustFT框架通过噪声检测和重标记,结合多专家系统和上下文增强策略,提升模型鲁棒性。

- 实验表明,RobustFT在多个数据集和LLM上表现出色,验证了其在噪声环境下的有效性。

📝 摘要(中文)

监督微调(SFT)在将大型语言模型(LLM)适应特定领域或任务方面起着至关重要的作用。然而,经验实验表明,在实际应用中收集的数据不可避免地包含噪声,这对下游任务的模型性能提出了重大挑战。因此,迫切需要一种噪声鲁棒的SFT框架来增强模型在下游任务中的能力。为了应对这一挑战,我们引入了一个鲁棒的SFT框架(RobustFT),该框架对下游任务数据执行噪声检测和重新标记。对于噪声识别,我们的方法采用了一个多专家协作系统,该系统具有推理增强模型,以实现卓越的噪声检测。在去噪阶段,我们利用上下文增强策略,该策略结合了最相关和置信的知识,然后进行仔细评估,以生成可靠的注释。此外,我们还引入了一种基于响应熵的有效数据选择机制,确保只保留高质量的样本用于微调。在五个数据集上对多个LLM进行的广泛实验证明了RobustFT在噪声场景中的卓越性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在监督微调过程中,由于训练数据中存在噪声响应而导致的模型性能下降问题。现有的微调方法对噪声数据敏感,容易过拟合噪声,导致在下游任务中泛化能力不足。

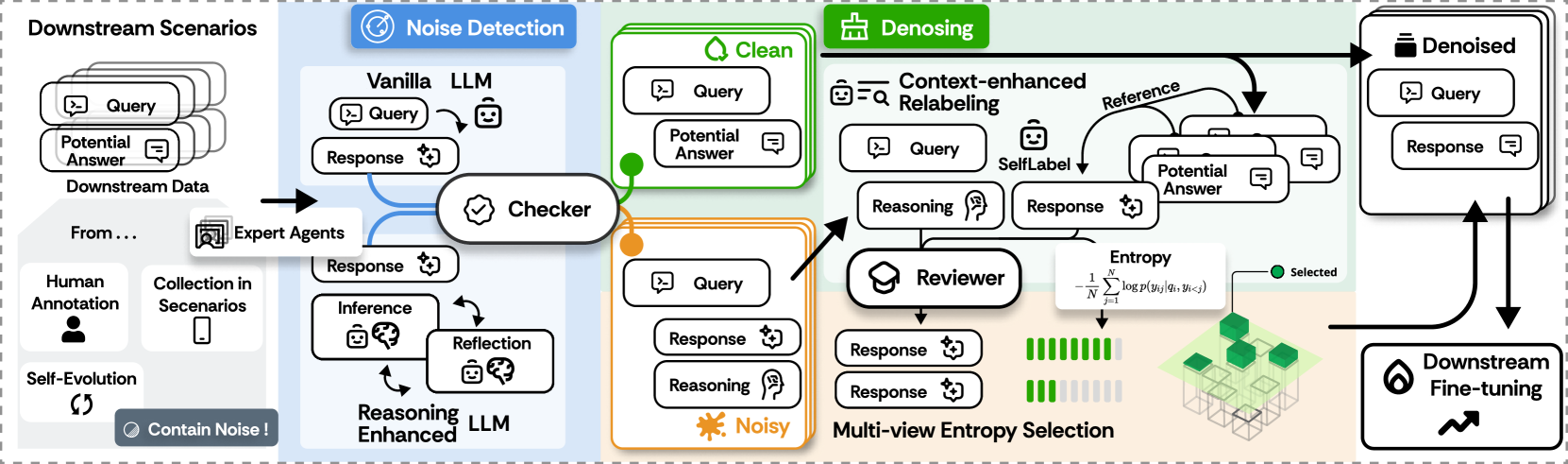

核心思路:RobustFT的核心思路是在微调之前,先对训练数据进行噪声检测和清洗,然后利用清洗后的高质量数据进行微调。通过多专家协作系统进行噪声识别,并利用上下文增强策略进行数据重标记,从而提高训练数据的质量。

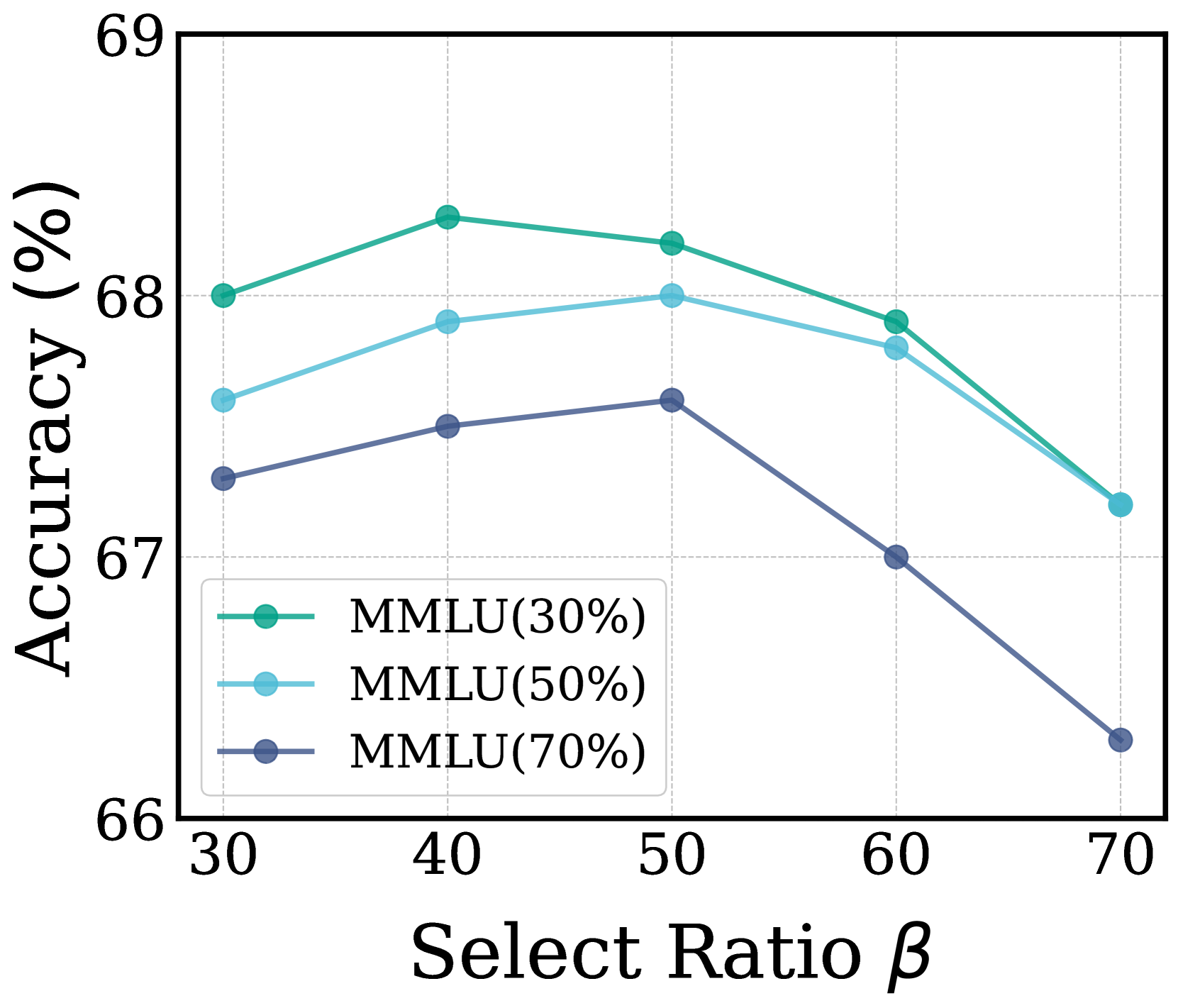

技术框架:RobustFT框架主要包含三个阶段:1) 噪声检测阶段:利用多专家协作系统,每个专家是一个经过推理增强的模型,对数据进行噪声评估。2) 数据去噪阶段:利用上下文增强策略,结合相关知识和置信度评估,对噪声数据进行重标记。3) 数据选择阶段:基于响应熵,选择高质量的样本进行微调。

关键创新:RobustFT的关键创新在于其噪声检测和数据去噪方法。多专家协作系统能够更准确地识别噪声数据,而上下文增强策略能够生成更可靠的标签。此外,基于响应熵的数据选择机制能够进一步提高训练数据的质量。

关键设计:在噪声检测阶段,每个专家模型都经过推理增强,例如通过思维链(Chain-of-Thought)等技术,提高其判断噪声的能力。在数据去噪阶段,上下文增强策略会选择最相关的知识片段,并根据置信度进行加权,以生成更准确的标签。数据选择阶段,响应熵被用作衡量数据质量的指标,只保留熵值较低的样本。

🖼️ 关键图片

📊 实验亮点

RobustFT在五个数据集上进行了广泛的实验,结果表明其在噪声场景下显著优于现有的微调方法。具体而言,RobustFT在多个数据集上取得了超过5%的性能提升,证明了其在噪声数据下的鲁棒性和有效性。实验结果还表明,多专家协作系统和上下文增强策略对性能提升起到了关键作用。

🎯 应用场景

RobustFT框架可广泛应用于各种需要使用大型语言模型进行微调的场景,尤其是在数据质量难以保证的情况下,例如自动问答、文本生成、对话系统等。该研究有助于提升LLM在实际应用中的可靠性和性能,降低数据清洗成本,加速LLM的部署。

📄 摘要(原文)

Supervised fine-tuning (SFT) plays a crucial role in adapting large language models (LLMs) to specific domains or tasks. However, as demonstrated by empirical experiments, the collected data inevitably contains noise in practical applications, which poses significant challenges to model performance on downstream tasks. Therefore, there is an urgent need for a noise-robust SFT framework to enhance model capabilities in downstream tasks. To address this challenge, we introduce a robust SFT framework (RobustFT) that performs noise detection and relabeling on downstream task data. For noise identification, our approach employs a multi-expert collaborative system with inference-enhanced models to achieve superior noise detection. In the denoising phase, we utilize a context-enhanced strategy, which incorporates the most relevant and confident knowledge followed by careful assessment to generate reliable annotations. Additionally, we introduce an effective data selection mechanism based on response entropy, ensuring only high-quality samples are retained for fine-tuning. Extensive experiments conducted on multiple LLMs across five datasets demonstrate RobustFT's exceptional performance in noisy scenarios.