Federated Learning and RAG Integration: A Scalable Approach for Medical Large Language Models

作者: Jincheol Jung, Hongju Jeong, Eui-Nam Huh

分类: cs.CL, cs.AI

发布日期: 2024-12-18 (更新: 2025-01-08)

💡 一句话要点

提出联邦学习与RAG集成的医学LLM方案,提升性能并保护隐私

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 检索增强生成 大型语言模型 医学领域 数据隐私

📋 核心要点

- 现有医学LLM训练面临数据孤岛和隐私泄露风险,限制了模型性能提升。

- 提出联邦学习与RAG集成框架,利用联邦学习保护隐私,RAG增强生成质量。

- 实验表明,集成RAG的联邦学习模型在各项指标上均优于未集成RAG的模型。

📝 摘要(中文)

本研究通过在联邦学习框架内集成检索增强生成(RAG)系统,分析了医学领域特定的大型语言模型(LLM)的性能。利用联邦学习固有的优势,如保护数据隐私和实现分布式计算,本研究探索了RAG系统与在不同客户端配置下训练的模型集成,以优化性能。实验结果表明,基于联邦学习并集成RAG系统的模型在所有评估指标上始终优于未集成的模型。这项研究强调了结合联邦学习和RAG系统在医学领域开发领域特定LLM的潜力,为增强文本生成能力提供了一种可扩展且保护隐私的解决方案。

🔬 方法详解

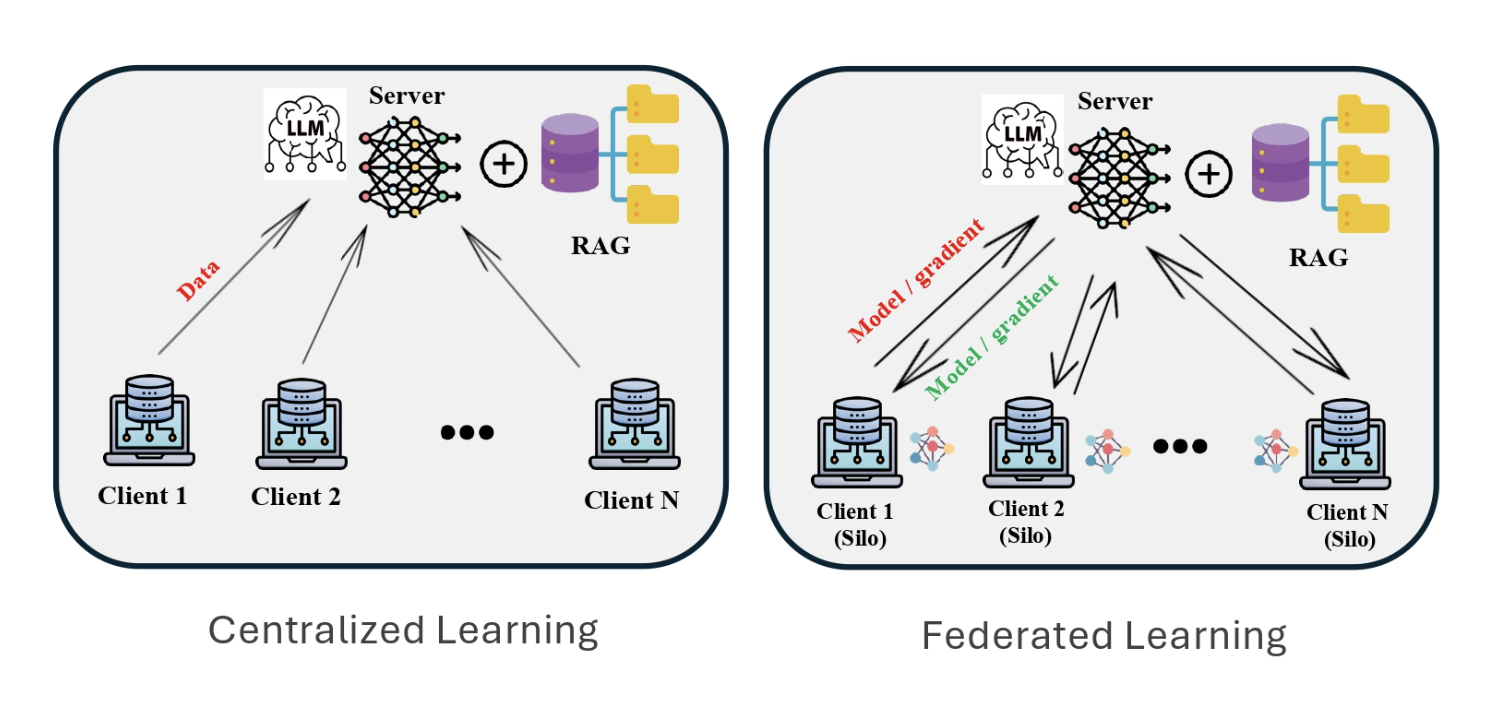

问题定义:医学领域的大型语言模型(LLM)训练面临着数据隐私和数据孤岛的挑战。由于医疗数据的敏感性,直接共享和集中训练是不现实的。现有的中心化训练方法无法充分利用分散在各个医疗机构的数据,导致模型性能受限。

核心思路:本研究的核心思路是将联邦学习和检索增强生成(RAG)相结合。联邦学习允许多个客户端(例如,不同的医院)在本地训练模型,然后将模型更新聚合到中央服务器,而无需共享原始数据。RAG通过检索外部知识库来增强LLM的生成能力,使其能够生成更准确、更全面的文本。

技术框架:该框架包含以下主要模块:1) 客户端本地训练:每个客户端使用本地医疗数据训练LLM。2) 模型更新聚合:中央服务器收集来自客户端的模型更新,并使用联邦平均等算法进行聚合。3) RAG集成:将训练好的联邦学习模型与RAG系统集成,RAG系统包含一个外部医学知识库。4) 推理:在推理阶段,RAG系统首先从知识库中检索相关信息,然后将这些信息提供给LLM,LLM生成最终的文本。

关键创新:该研究的关键创新在于将联邦学习和RAG系统有效地结合起来,从而在保护数据隐私的同时,提高了医学LLM的性能。与传统的联邦学习方法相比,RAG的引入增强了模型的知识储备和生成能力。与中心化训练的RAG模型相比,联邦学习保证了数据隐私。

关键设计:具体的参数设置和技术细节在论文中未详细说明,属于未知信息。但可以推测,联邦学习中会涉及学习率、客户端选择比例、聚合算法等参数的调整。RAG系统中,知识库的构建、检索算法的选择、以及检索结果与LLM的融合方式都是关键的设计因素。

🖼️ 关键图片

📊 实验亮点

实验结果表明,集成了RAG系统的联邦学习模型在所有评估指标上均优于未集成RAG系统的模型。具体的性能数据和提升幅度在摘要中未给出,属于未知信息。但可以确定的是,RAG的引入显著提升了联邦学习模型的文本生成能力。

🎯 应用场景

该研究成果可应用于智能医疗问答、电子病历分析、医学报告生成等领域。通过联邦学习保护患者隐私,同时利用RAG增强LLM的专业知识,有望提升医疗服务的质量和效率。未来可进一步探索更复杂的联邦学习策略和RAG技术,以应对更复杂的医学场景。

📄 摘要(原文)

This study analyzes the performance of domain-specific Large Language Models (LLMs) for the medical field by integrating Retrieval-Augmented Generation (RAG) systems within a federated learning framework. Leveraging the inherent advantages of federated learning, such as preserving data privacy and enabling distributed computation, this research explores the integration of RAG systems with models trained under varying client configurations to optimize performance. Experimental results demonstrate that the federated learning-based models integrated with RAG systems consistently outperform their non-integrated counterparts across all evaluation metrics. This study highlights the potential of combining federated learning and RAG systems for developing domain-specific LLMs in the medical field, providing a scalable and privacy-preserving solution for enhancing text generation capabilities.