Inference Scaling for Bridging Retrieval and Augmented Generation

作者: Youngwon Lee, Seung-won Hwang, Daniel Campos, Filip Graliński, Zhewei Yao, Yuxiong He

分类: cs.CL

发布日期: 2024-12-14

💡 一句话要点

提出Mixture-of-Intervention (MOI)方法,通过推理缩放缓解RAG中的生成器偏差问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 RAG 生成器偏差 推理缩放 混合干预

📋 核心要点

- 现有RAG方法存在生成器偏差,单纯提升检索质量可能反而降低生成效果,成为RAG应用的瓶颈。

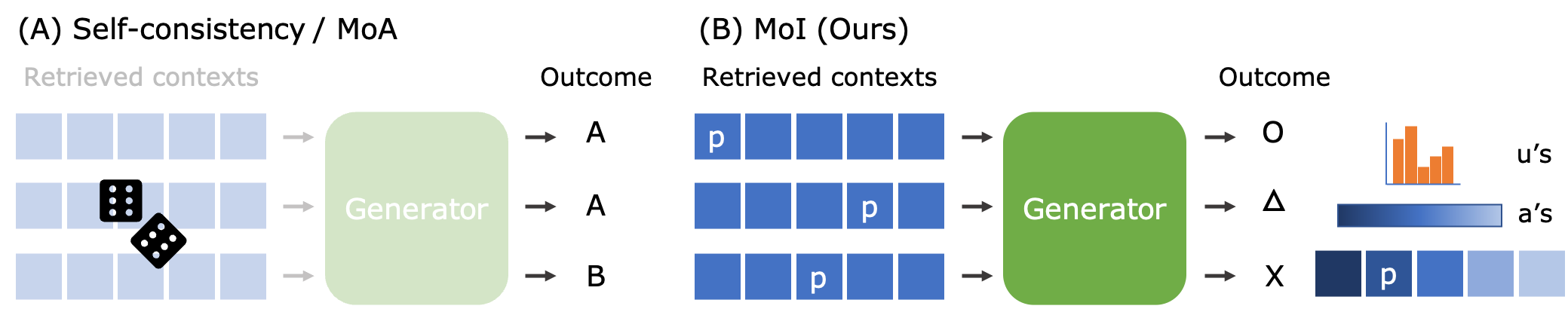

- 论文提出Mixture-of-Intervention (MOI)方法,通过对检索结果的不同排列组合进行多次推理,缓解生成器偏差。

- 实验表明,MOI在MS MARCO和HotpotQA等RAG任务上显著提升了ROUGE-L和EM指标,验证了其有效性。

📝 摘要(中文)

检索增强生成(RAG)已成为一种流行的技术,通过将检索到的上下文作为输入来引导大型语言模型(LLM)的输出。然而,现有研究观察到生成器偏差,即改进检索结果反而可能对最终结果产生负面影响。本文表明,这种偏差可以通过推理缩放来缓解,即聚合来自检索到的上下文的不同排列顺序的推理调用。提出的混合干预(MOI)方法通过多次前向传递显式地建模每个段落的去偏效用,从而构建新的排序。MOI还可以利用检索器的先验知识,通过最小化考虑的排列数量和降低每次LLM调用的成本来降低计算成本。在不同的RAG任务上展示了MOI的有效性,在MS MARCO上的ROUGE-L指标和HotpotQA上的EM指标上提高了约7个点。

🔬 方法详解

问题定义:论文旨在解决检索增强生成(RAG)中存在的生成器偏差问题。现有方法虽然依赖检索结果来引导LLM生成,但单纯提升检索质量有时反而会降低最终生成效果,这表明LLM对检索结果的利用存在偏差。这种偏差限制了RAG系统的性能。

核心思路:论文的核心思路是通过推理缩放来缓解生成器偏差。具体来说,就是对检索到的上下文的不同排列组合进行多次推理,然后聚合这些推理结果,从而更准确地评估每个上下文片段的真实效用。通过这种方式,可以消除LLM对特定上下文顺序的偏好,从而提高生成质量。

技术框架:MOI方法的技术框架主要包含以下几个步骤:1) 从检索器获取top-k个相关文档;2) 对这k个文档进行排列组合,生成多个不同的上下文序列;3) 将每个上下文序列输入LLM进行推理,得到相应的生成结果;4) 使用特定的聚合函数(例如加权平均)将不同序列的生成结果进行融合,得到最终的生成结果。MOI还利用检索器的先验知识来减少需要考虑的排列数量,从而降低计算成本。

关键创新:MOI的关键创新在于它显式地建模了每个段落的去偏效用。通过对检索结果的不同排列组合进行多次推理,MOI可以消除LLM对特定上下文顺序的偏好,从而更准确地评估每个上下文片段的真实价值。此外,MOI还利用检索器的先验知识来降低计算成本,使其更具实用性。

关键设计:MOI的关键设计包括:1) 如何选择合适的排列组合策略,以在计算成本和性能之间取得平衡;2) 如何设计有效的聚合函数,以将不同序列的生成结果进行融合;3) 如何利用检索器的先验知识来减少需要考虑的排列数量。论文中具体使用了加权平均作为聚合函数,并提出了一种基于检索器置信度的剪枝策略来减少排列数量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MOI方法在MS MARCO数据集上将ROUGE-L指标提高了约7个点,在HotpotQA数据集上将EM指标提高了约7个点。这些显著的性能提升表明MOI能够有效地缓解RAG中的生成器偏差,并显著提升RAG系统的性能。实验结果充分验证了MOI方法的有效性。

🎯 应用场景

该研究成果可广泛应用于各种需要利用外部知识来增强LLM生成能力的场景,例如问答系统、对话系统、文本摘要等。通过缓解生成器偏差,可以显著提升这些系统的性能和用户体验,尤其是在需要处理复杂或长尾知识的场景下,具有重要的实际价值和应用前景。

📄 摘要(原文)

Retrieval-augmented generation (RAG) has emerged as a popular approach to steering the output of a large language model (LLM) by incorporating retrieved contexts as inputs. However, existing work observed the generator bias, such that improving the retrieval results may negatively affect the outcome. In this work, we show such bias can be mitigated, from inference scaling, aggregating inference calls from the permuted order of retrieved contexts. The proposed Mixture-of-Intervention (MOI) explicitly models the debiased utility of each passage with multiple forward passes to construct a new ranking. We also show that MOI can leverage the retriever's prior knowledge to reduce the computational cost by minimizing the number of permutations considered and lowering the cost per LLM call. We showcase the effectiveness of MOI on diverse RAG tasks, improving ROUGE-L on MS MARCO and EM on HotpotQA benchmarks by ~7 points.