ROUTE: Robust Multitask Tuning and Collaboration for Text-to-SQL

作者: Yang Qin, Chao Chen, Zhihang Fu, Ze Chen, Dezhong Peng, Peng Hu, Jieping Ye

分类: cs.CL, cs.AI

发布日期: 2024-12-13 (更新: 2025-05-26)

💡 一句话要点

提出ROUTE方法,通过多任务调优和协作提升开源LLM在Text-to-SQL任务上的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text-to-SQL 多任务学习 大型语言模型 监督微调 协作提示

📋 核心要点

- 现有Text-to-SQL技术依赖闭源LLM的上下文学习,限制了其在开放场景中的应用。

- ROUTE方法通过多任务监督微调和多任务协作提示,提升开源LLM的SQL生成能力。

- 实验结果表明,ROUTE方法在多个基准测试中优于现有Text-to-SQL方法,性能领先。

📝 摘要(中文)

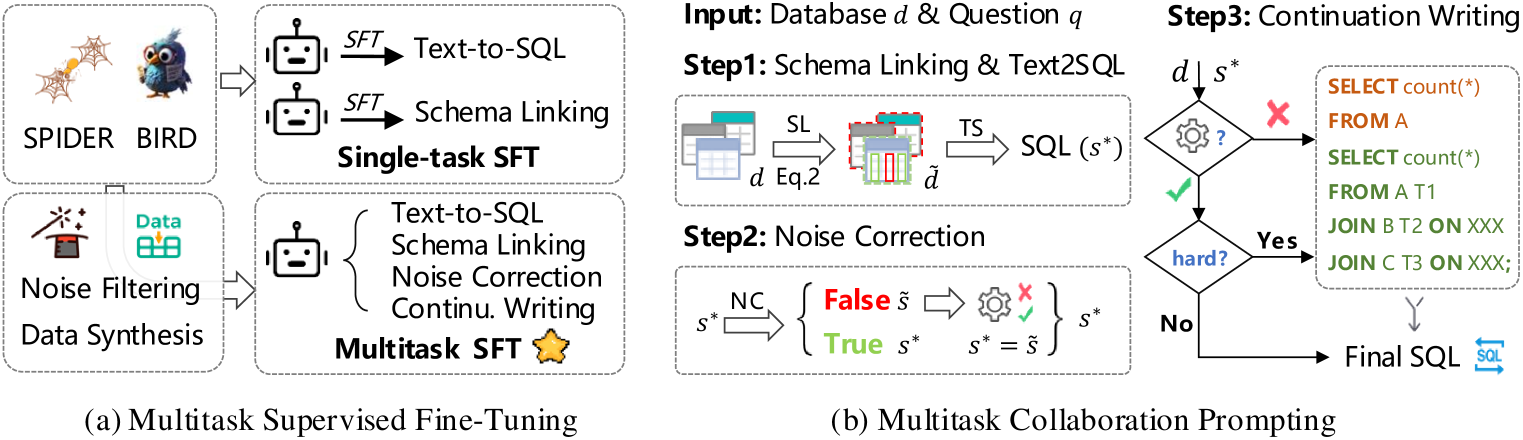

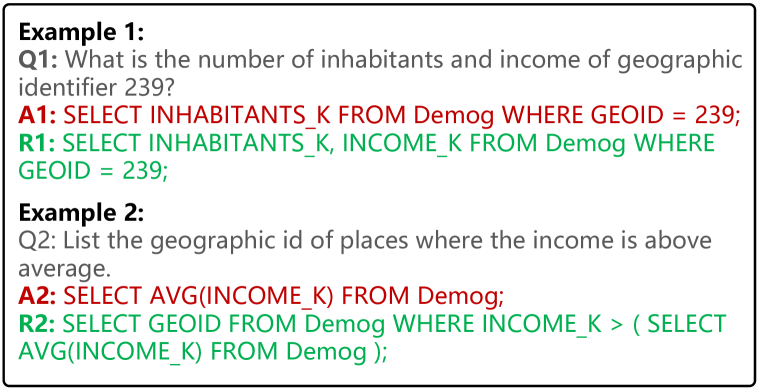

本文提出了一种新颖的鲁棒多任务调优和协作方法(ROUTE),旨在提升开源大型语言模型(LLM)在Text-to-SQL任务上的综合能力,从而提供更实用的解决方案。该方法首先利用与SQL生成相关的各种合成训练数据进行多任务监督微调(SFT)。与现有的基于SFT的Text-to-SQL方法不同,本文引入了包括模式链接、噪声校正和续写等额外的SFT任务。参与各种SQL生成任务可以增强模型对SQL语法的理解,并提高生成高质量SQL查询的能力。此外,受到LLM代理协作模式的启发,本文引入了一种多任务协作提示(MCP)策略。该策略利用多个SQL相关任务之间的协作来减少SQL生成过程中的幻觉,从而最大限度地发挥通过显式多任务能力增强Text-to-SQL性能的潜力。在八个开源LLM和五个广泛使用的基准上进行了广泛的实验和深入的分析。结果表明,该方法优于最新的Text-to-SQL方法,并取得了领先的性能。

🔬 方法详解

问题定义:Text-to-SQL任务旨在将自然语言描述转换为可执行的SQL查询。现有方法,特别是依赖于闭源LLM的上下文学习的方法,存在可移植性差、成本高昂等问题,限制了其在开放场景中的应用。此外,开源LLM在SQL生成过程中容易出现幻觉,影响查询的准确性。

核心思路:ROUTE方法的核心思路是通过多任务学习增强开源LLM对SQL语法的理解和推理能力,并通过多任务协作提示减少幻觉。通过将SQL生成任务分解为多个相关子任务,并利用这些子任务之间的协作,可以提高模型生成高质量SQL查询的能力。

技术框架:ROUTE方法包含两个主要阶段:多任务监督微调(SFT)和多任务协作提示(MCP)。在SFT阶段,使用包含SQL生成、模式链接、噪声校正和续写等任务的合成数据集对开源LLM进行微调。在MCP阶段,利用多个SQL相关任务之间的协作来指导SQL生成过程,减少幻觉。整体流程是先通过SFT提升模型基础能力,再通过MCP进行优化。

关键创新:ROUTE方法的关键创新在于其多任务学习框架和多任务协作提示策略。与传统的单任务微调方法不同,ROUTE方法通过同时学习多个相关任务,提高了模型的泛化能力和鲁棒性。MCP策略则借鉴了LLM代理的协作模式,通过任务间的相互验证和纠正,减少了SQL生成过程中的错误。

关键设计:在SFT阶段,使用了多种合成数据集,包括SQL生成、模式链接、噪声校正和续写等任务的数据。这些数据集的构建方式和规模对模型的性能有重要影响。在MCP阶段,设计了特定的提示模板,用于引导模型在不同任务之间进行协作。具体的损失函数选择和网络结构取决于所使用的开源LLM。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ROUTE方法在五个广泛使用的Text-to-SQL基准测试中取得了领先的性能。例如,在Spider数据集上,ROUTE方法相较于现有最佳方法取得了显著的提升。此外,消融实验验证了多任务学习和多任务协作提示策略的有效性。该方法在多个开源LLM上均表现出良好的性能,证明了其通用性和鲁棒性。

🎯 应用场景

ROUTE方法可应用于各种需要将自然语言转换为SQL查询的场景,例如智能数据库助手、自动化数据分析和报表生成等。该方法能够提升开源LLM在Text-to-SQL任务上的性能,降低了对闭源LLM的依赖,具有重要的实际应用价值和商业潜力。未来,该方法可以进一步扩展到其他自然语言处理任务中。

📄 摘要(原文)

Despite the significant advancements in Text-to-SQL (Text2SQL) facilitated by large language models (LLMs), the latest state-of-the-art techniques are still trapped in the in-context learning of closed-source LLMs (e.g., GPT-4), which limits their applicability in open scenarios. To address this challenge, we propose a novel RObust mUltitask Tuning and collaboration mEthod (ROUTE) to improve the comprehensive capabilities of open-source LLMs for Text2SQL, thereby providing a more practical solution. Our approach begins with multi-task supervised fine-tuning (SFT) using various synthetic training data related to SQL generation. Unlike existing SFT-based Text2SQL methods, we introduced several additional SFT tasks, including schema linking, noise correction, and continuation writing. Engaging in a variety of SQL generation tasks enhances the model's understanding of SQL syntax and improves its ability to generate high-quality SQL queries. Additionally, inspired by the collaborative modes of LLM agents, we introduce a Multitask Collaboration Prompting (MCP) strategy. This strategy leverages collaboration across several SQL-related tasks to reduce hallucinations during SQL generation, thereby maximizing the potential of enhancing Text2SQL performance through explicit multitask capabilities. Extensive experiments and in-depth analyses have been performed on eight open-source LLMs and five widely-used benchmarks. The results demonstrate that our proposal outperforms the latest Text2SQL methods and yields leading performance.