Enhancing the Reasoning Capabilities of Small Language Models via Solution Guidance Fine-Tuning

作者: Jing Bi, Yuting Wu, Weiwei Xing, Zhenjie Wei

分类: cs.CL

发布日期: 2024-12-13

备注: 11 pages, 4 figures, to be published in The 31st International Conference on Computational Linguistics (COLING 2025)

💡 一句话要点

提出Solution Guidance Fine-Tuning,提升小语言模型推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 小语言模型 推理能力 思维链 微调 问题解决指导

📋 核心要点

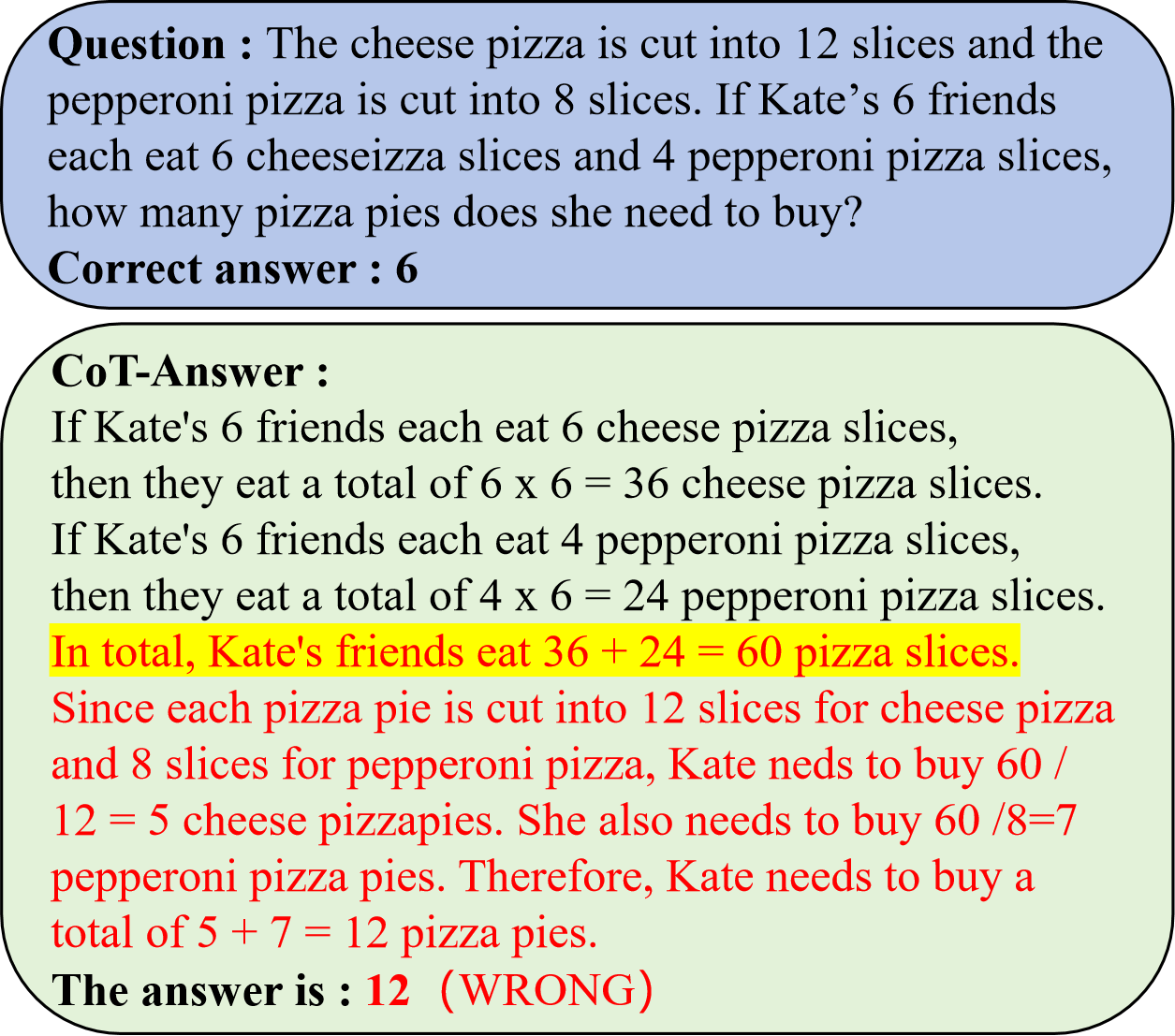

- 现有CoT微调方法依赖大量数据,小模型推理能力提升受限,且易引入不一致性。

- 提出Solution Guidance (SG)策略,侧重语义和逻辑层面的问题理解与分解,提升泛化性。

- SGFT仅需少量数据即可微调小模型,生成问题解决指导,显著提升推理任务性能。

📝 摘要(中文)

大型语言模型(LLMs)在各种任务中表现出卓越的性能。提示工程和微调技术的进步进一步增强了它们解决复杂推理挑战的能力。然而,这些高级能力通常仅限于超过1000亿参数的模型。尽管针对较小模型(低于100亿参数)已经探索了思维链(CoT)微调方法,但它们通常依赖于大量的CoT训练数据,这可能会引入不一致性并限制在低数据环境中的有效性。为了克服这些限制,本文提出了一种新的推理策略Solution Guidance(SG)和一种即插即用训练范式Solution-Guidance Fine-Tuning(SGFT),用于增强小语言模型的推理能力。SG侧重于语义和逻辑层面的问题理解和分解,而不是具体的计算,从而有效地提高SLM的泛化和推理能力。仅需少量SG训练数据,SGFT就可以微调SLM以生成准确的问题解决指导,然后可以将其灵活地输入到任何SLM作为提示,使其能够直接生成正确的答案。实验结果表明,我们的方法显著提高了SLM在各种推理任务中的性能,从而提高了它们在资源受限环境中的实用性和效率。

🔬 方法详解

问题定义:论文旨在解决小语言模型(SLM)在推理任务中表现不佳的问题。现有方法,如CoT微调,依赖于大量的训练数据,这在数据稀缺的情况下变得不可行,并且容易引入不一致性,限制了SLM的推理能力和泛化能力。

核心思路:论文的核心思路是引入Solution Guidance (SG)策略,该策略不关注具体的计算步骤,而是侧重于在语义和逻辑层面上理解和分解问题。通过提供问题解决的指导,而不是直接的计算过程,可以有效地提高SLM的泛化能力和推理能力。

技术框架:整体框架包含两个主要阶段:首先,使用少量SG训练数据对SLM进行微调,使其能够生成准确的问题解决指导(Solution Guidance)。然后,将生成的Solution Guidance作为提示输入到另一个SLM中,引导其直接生成正确的答案。这种即插即用的训练范式使得SGFT可以灵活地应用于不同的SLM。

关键创新:最重要的技术创新点在于Solution Guidance策略本身,它将推理过程从具体的计算步骤抽象到语义和逻辑层面的问题理解和分解。这种抽象使得模型能够更好地泛化到新的问题,并且减少了对大量训练数据的依赖。与CoT方法相比,SG更关注问题解决的策略,而非具体的计算过程。

关键设计:论文的关键设计包括SG训练数据的构建方式,以及如何将生成的Solution Guidance有效地作为提示输入到SLM中。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SGFT方法显著提高了SLM在各种推理任务中的性能。具体性能数据和对比基线在摘要中未提及,属于未知信息。但强调了该方法在提升SLM推理能力方面的有效性,尤其是在资源受限的环境中。

🎯 应用场景

该研究成果可广泛应用于资源受限环境下的智能问答、逻辑推理、数学问题求解等领域。通过提升小语言模型的推理能力,可以降低对计算资源的需求,使得AI技术在边缘设备和低成本场景中得到更广泛的应用,例如移动设备上的智能助手、嵌入式系统中的决策支持等。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable performance across a wide range of tasks. Advances in prompt engineering and fine-tuning techniques have further enhanced their ability to address complex reasoning challenges. However, these advanced capabilities are often exclusive to models exceeding 100 billion parameters. Although Chain-of-Thought (CoT) fine-tuning methods have been explored for smaller models (under 10 billion parameters), they typically depend on extensive CoT training data, which can introduce inconsistencies and limit effectiveness in low-data settings. To overcome these limitations, this paper introduce a new reasoning strategy Solution Guidance (SG) and a plug-and-play training paradigm Solution-Guidance Fine-Tuning (SGFT) for enhancing the reasoning capabilities of small language models. SG focuses on problem understanding and decomposition at the semantic and logical levels, rather than specific computations, which can effectively improve the SLMs' generalization and reasoning abilities. With only a small amount of SG training data, SGFT can fine-tune a SLM to produce accurate problem-solving guidances, which can then be flexibly fed to any SLM as prompts, enabling it to generate correct answers directly. Experimental results demonstrate that our method significantly improves the performance of SLMs on various reasoning tasks, enhancing both their practicality and efficiency within resource-constrained environments.