Low-Rank Adaptation with Task-Relevant Feature Enhancement for Fine-tuning Language Models

作者: Changqun Li, Chaofan Ding, Kexin Luan, Xinhan Di

分类: cs.CL, cs.CV

发布日期: 2024-12-13

备注: 6 Pages, 3 figures accepted by AAAI 2025 CoLoRAI - Connecting Low-Rank Representations in AI Workshop

💡 一句话要点

提出LoRATRF,通过任务相关特征增强提升LoRA微调语言模型性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 参数高效微调 低秩适应 任务相关特征增强 语言模型 神经网络表示

📋 核心要点

- LoRA等参数高效微调方法在学习新任务时,与全量微调相比仍存在性能差距,是当前面临的核心问题。

- LoRATRF的核心思想是从神经网络表示层面增强任务相关特征,通过任务感知过滤器选择性提取关键知识。

- 实验结果表明,LoRATRF在多种数据集上优于SOTA低秩方法,同时显著减少了微调参数量。

📝 摘要(中文)

参数高效地微调预训练大型语言模型因其有效性和效率而受到广泛研究。LoRA是其中最广泛使用的方法之一,它假设优化过程本质上是低维的。虽然LoRA已经展示了值得称赞的性能,但在学习新任务时,LoRA和完全微调之间仍然存在显著的性能差距。在这项工作中,我们提出了具有任务相关特征增强的低秩适应(LoRATRF),从编辑神经网络表示的角度增强任务相关特征。为了优先考虑任务相关特征,我们设计了一个任务感知过滤器,该过滤器选择性地从隐藏表示中提取目标或当前任务的宝贵知识。在包括NLU、常识推理和数学推理任务在内的各种数据集上的实验表明,与SOTA低秩方法相比,我们的方法减少了33.71%的参数,并在各种数据集上实现了更好的性能。

🔬 方法详解

问题定义:论文旨在解决LoRA在微调大型语言模型时,与全量微调相比存在的性能差距问题。现有LoRA方法虽然参数效率高,但在学习新任务时,对任务相关特征的提取和利用不足,导致性能受限。

核心思路:论文的核心思路是通过增强任务相关特征来提升LoRA的微调性能。具体而言,设计一个任务感知的过滤器,从隐藏层表示中选择性地提取对当前任务有用的知识,从而突出任务相关的特征,抑制无关特征。这样可以使LoRA更专注于学习任务的关键信息,提高微调效率和性能。

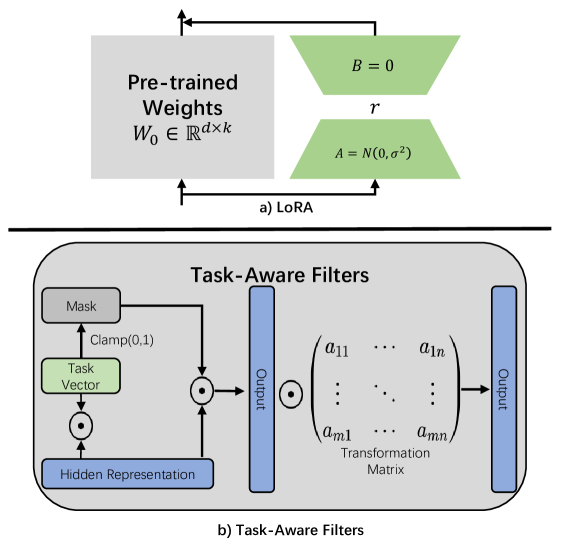

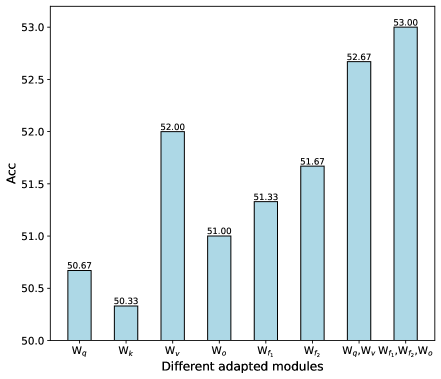

技术框架:LoRATRF的整体框架是在LoRA的基础上,增加了一个任务感知特征增强模块。该模块位于Transformer模型的隐藏层之间,接收隐藏层输出作为输入,并输出增强后的特征表示。整个微调过程包括:1) 使用LoRA进行参数高效微调;2) 使用任务感知过滤器增强隐藏层特征;3) 使用增强后的特征进行下游任务预测。

关键创新:LoRATRF的关键创新在于任务感知过滤器的设计。该过滤器能够根据当前任务的特点,自适应地选择对任务有用的特征,并抑制无关特征。这种选择性提取机制使得模型能够更有效地利用隐藏层表示中的信息,从而提高微调性能。与现有方法相比,LoRATRF不是简单地对所有特征进行处理,而是有选择性地增强任务相关特征,更符合人类的学习方式。

关键设计:任务感知过滤器的具体实现方式未知,论文中可能没有详细描述其内部结构和参数设置。但可以推测,该过滤器可能包含一些可学习的参数,用于衡量不同特征的重要性,并根据重要性进行加权或选择。损失函数的设计可能也考虑了任务相关性,例如,可以设计一个损失函数,鼓励过滤器选择与任务标签相关的特征。

🖼️ 关键图片

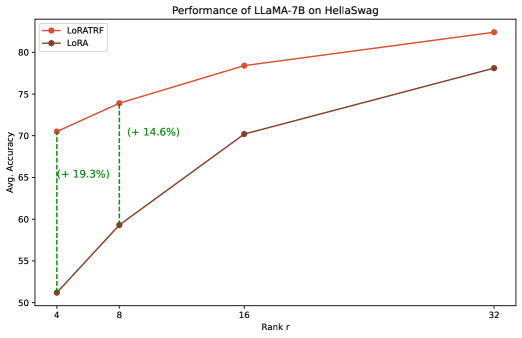

📊 实验亮点

实验结果表明,LoRATRF在NLU、常识推理和数学推理等多个数据集上取得了显著的性能提升。与SOTA低秩方法相比,LoRATRF在性能提升的同时,减少了33.71%的参数量。这些结果表明,LoRATRF在参数效率和性能之间取得了更好的平衡,具有很强的实用价值。

🎯 应用场景

LoRATRF可应用于各种自然语言处理任务,如文本分类、情感分析、机器翻译、问答系统等。它尤其适用于资源受限的场景,例如移动设备或边缘计算环境,在这些场景下,全量微调大型语言模型的成本过高。通过LoRATRF,可以在保证性能的同时,显著降低微调所需的计算资源和存储空间,加速模型的部署和应用。

📄 摘要(原文)

Fine-tuning pre-trained large language models in a parameter-efficient manner is widely studied for its effectiveness and efficiency. LoRA is one of the most widely used methods, which assumes that the optimization process is essentially low dimensional. Although LoRA has demonstrated commendable performance, there remains a significant performance gap between LoRA and full fine-tuning when learning new tasks. In this work, we propose Low-Rank Adaptation with Task-Relevant Feature Enhancement(LoRATRF) for enhancing task-relevant features from the perspective of editing neural network representations. To prioritize task-relevant features, a task-aware filter that selectively extracts valuable knowledge from hidden representations for the target or current task is designed. As the experiments on a vareity of datasets including NLU, commonsense reasoning and mathematical reasoning tasks demonstrates, our method reduces 33.71% parameters and achieves better performance on a variety of datasets in comparison with SOTA low-rank methods.