The Impact of Copyrighted Material on Large Language Models: A Norwegian Perspective

作者: Javier de la Rosa, Vladislav Mikhailov, Lemei Zhang, Freddy Wetjen, David Samuel, Peng Liu, Rolv-Arild Braaten, Petter Mæhlum, Magnus Breder Birkenes, Andrey Kutuzov, Tita Enstad, Hans Christian Farsethås, Svein Arne Brygfjeld, Jon Atle Gulla, Stephan Oepen, Erik Velldal, Wilfred Østgulen, Liljia Øvrelid, Aslak Sira Myhre

分类: cs.CL

发布日期: 2024-12-12 (更新: 2025-01-24)

备注: 17 pages, 5 figures, 8 tables. Accepted at NoDaLiDa/Baltic-HLT 2025

💡 一句话要点

评估版权材料对挪威语大型语言模型性能的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 版权材料 挪威语 性能评估 数据混合

📋 核心要点

- 大型语言模型训练中使用版权材料引发了重要的法律和伦理问题,需要进行深入研究。

- 该研究通过实证评估版权语料对挪威语LLM性能的影响,探索不同类型版权材料的作用。

- 实验表明,书籍和报纸的加入通常能提升LLM性能,而小说类作品的加入则可能带来负面影响。

📝 摘要(中文)

本文提出了一个框架,用于评估受出版商控制的版权语料库对挪威语生成式大型语言模型(LLM)性能的影响,并给出了实验结果。研究发现,在LLM的数据混合中加入书籍和报纸通常会提高其性能,而加入小说作品似乎会产生不利影响。我们的实验结果可以为作者的作品对人工智能发展做出贡献的补偿方案的制定提供参考。

🔬 方法详解

问题定义:论文旨在解决大型语言模型训练过程中使用版权材料对模型性能的具体影响问题。现有方法缺乏对不同类型版权材料(如书籍、报纸、小说)的区分,无法量化它们各自对模型性能的贡献或负面影响。这使得在法律和伦理层面难以制定合理的版权补偿方案。

核心思路:论文的核心思路是通过控制训练数据中不同类型版权材料的比例,并评估由此产生的模型性能变化,从而量化不同类型版权材料对模型的影响。这种方法允许研究人员区分不同类型版权材料的贡献,并为制定公平的版权补偿方案提供依据。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 收集和整理挪威语的版权语料库,包括书籍、报纸和小说等;2) 构建多个LLM,每个LLM使用不同的数据混合比例,即不同类型的版权材料的比例不同;3) 使用一系列评估任务来评估每个LLM的性能,这些任务涵盖了语言理解、生成和推理等方面;4) 分析实验结果,量化不同类型版权材料对LLM性能的影响。

关键创新:该研究的关键创新在于其系统性的评估框架,该框架能够量化不同类型版权材料对LLM性能的影响。与以往的研究相比,该研究更加关注不同类型版权材料的区分,并试图找到它们各自对模型性能的贡献或负面影响。此外,该研究还关注挪威语这一特定语种,为其他低资源语种的研究提供了参考。

关键设计:论文的关键设计包括:1) 精心选择的挪威语版权语料库,确保语料库的质量和多样性;2) 多种数据混合比例的设置,以便能够充分评估不同类型版权材料的影响;3) 多样化的评估任务,涵盖了语言理解、生成和推理等多个方面,以全面评估LLM的性能;4) 采用合适的统计方法来分析实验结果,确保结果的可靠性。

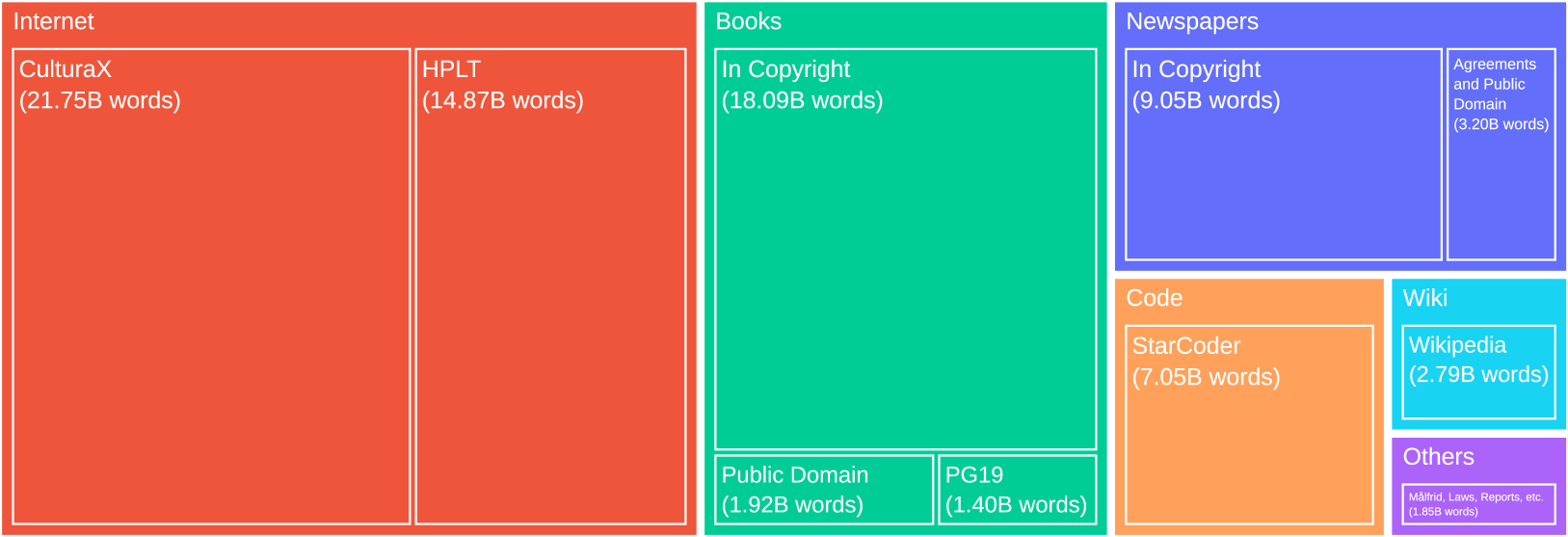

🖼️ 关键图片

📊 实验亮点

实验结果表明,在挪威语LLM的训练数据中加入书籍和报纸通常能提高模型性能,而加入小说作品则可能产生负面影响。这一发现为版权材料的使用提供了经验证据,并为未来的研究方向提供了启示。具体的性能提升幅度未知,需要在论文中查找。

🎯 应用场景

该研究成果可应用于指导大型语言模型的训练数据选择,优化模型性能。同时,为版权所有者提供数据贡献的量化依据,促进公平合理的版权补偿机制的建立,推动人工智能领域的健康发展。该研究对其他语言和文化背景下的LLM训练具有借鉴意义。

📄 摘要(原文)

The use of copyrighted materials in training language models raises critical legal and ethical questions. This paper presents a framework for and the results of empirically assessing the impact of publisher-controlled copyrighted corpora on the performance of generative large language models (LLMs) for Norwegian. When evaluated on a diverse set of tasks, we found that adding both books and newspapers to the data mixture of LLMs tend to improve their performance, while the addition of fiction works seems to be detrimental. Our experiments could inform the creation of a compensation scheme for authors whose works contribute to AI development.