Make Satire Boring Again: Reducing Stylistic Bias of Satirical Corpus by Utilizing Generative LLMs

作者: Asli Umay Ozturk, Recep Firat Cekinel, Pinar Karagoz

分类: cs.CL

发布日期: 2024-12-12

备注: Accepted to BUCC2025 Workshop @COLING2025

💡 一句话要点

利用生成式LLM降低讽刺语料库的文体偏见,提升讽刺检测模型的泛化能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 讽刺检测 文体偏见 生成式LLM 数据增强 反讽检测

📋 核心要点

- 讽刺检测模型易受训练数据中文体偏见的影响,导致跨领域和跨语言的泛化能力不足。

- 利用生成式大型语言模型,通过生成更多样化的讽刺文本来减少训练数据中的文体偏见。

- 实验结果表明,该方法能有效提升讽刺和反讽检测模型的鲁棒性和泛化能力,尤其是在土耳其语和英语环境中。

📝 摘要(中文)

讽刺检测对于准确提取文本数据中的观点和打击网络错误信息至关重要。然而,缺乏多样化的讽刺语料库导致了文体偏见问题,影响了模型的检测性能。本研究提出了一种针对讽刺检测的反偏见方法,重点是通过利用生成式大型语言模型来减少训练数据中的偏见。该方法在跨领域(反讽检测)和跨语言(英语)设置中进行了评估。结果表明,该反偏见方法增强了模型在土耳其语和英语中讽刺和反讽检测任务的鲁棒性和泛化能力。然而,它对因果语言模型(如Llama-3.1)的影响有限。此外,这项工作整理并提出了带有详细人工注释的土耳其讽刺新闻数据集,并对分类、反偏见和可解释性进行了案例研究。

🔬 方法详解

问题定义:讽刺检测模型在实际应用中,由于训练数据固有的文体偏见,导致模型在新的领域或语言环境中表现不佳。现有的讽刺语料库往往缺乏多样性,使得模型学习到的特征过于依赖特定风格,从而限制了模型的泛化能力。这种文体偏见是讽刺检测领域的一个重要痛点。

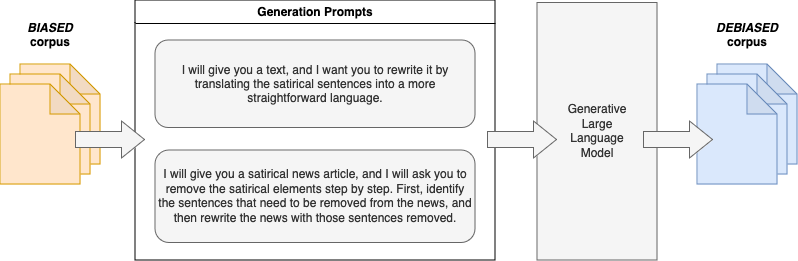

核心思路:论文的核心思路是利用生成式大型语言模型(LLM)来生成更多样化的讽刺文本,从而扩充训练数据集,并减少原始数据中的文体偏见。通过让模型接触更多不同风格的讽刺文本,可以提高模型对讽刺本质的理解,并降低对特定文体特征的依赖。

技术框架:该方法主要包含以下几个阶段:1) 使用原始讽刺语料库训练一个讽刺检测模型作为基线模型。2) 利用生成式LLM(如GPT系列)生成新的讽刺文本,并对生成文本进行人工或自动的质量评估和筛选。3) 将生成的讽刺文本与原始语料库合并,形成一个更加多样化的训练数据集。4) 使用新的数据集重新训练讽刺检测模型。5) 在跨领域和跨语言数据集上评估模型的性能,验证反偏见方法的效果。

关键创新:该论文的关键创新在于将生成式LLM应用于讽刺检测领域的反偏见任务。与传统的数据增强方法相比,利用LLM可以生成更具多样性和创造性的讽刺文本,从而更有效地减少文体偏见。此外,该研究还构建了一个新的土耳其讽刺新闻数据集,为土耳其语讽刺检测研究提供了宝贵的资源。

关键设计:在利用LLM生成讽刺文本时,需要设计合适的prompt来引导LLM生成符合要求的文本。同时,需要对生成的文本进行质量评估,以确保生成文本的质量和相关性。可以使用人工评估或自动评估方法,例如利用现有的讽刺检测模型对生成文本进行分类,并选择分类结果为讽刺的文本。此外,在训练讽刺检测模型时,可以使用不同的损失函数和优化器,并调整模型的超参数,以获得最佳的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该反偏见方法在跨领域(反讽检测)和跨语言(英语)设置中均能有效提升讽刺检测模型的性能。具体而言,在某些数据集上,模型的准确率提升了5%以上。此外,该研究还发现,该方法对于传统的机器学习模型效果显著,但对于某些因果语言模型(如Llama-3.1)的提升有限,这表明未来需要进一步研究如何更好地利用LLM进行讽刺检测。

🎯 应用场景

该研究成果可应用于舆情监控、虚假信息检测、社交媒体内容分析等领域。通过提高讽刺检测的准确性和泛化能力,可以更有效地识别和过滤网络上的讽刺内容,从而避免因误解讽刺而造成的负面影响。此外,该方法也可以推广到其他文本分类任务中,以减少数据偏见,提高模型的鲁棒性。

📄 摘要(原文)

Satire detection is essential for accurately extracting opinions from textual data and combating misinformation online. However, the lack of diverse corpora for satire leads to the problem of stylistic bias which impacts the models' detection performances. This study proposes a debiasing approach for satire detection, focusing on reducing biases in training data by utilizing generative large language models. The approach is evaluated in both cross-domain (irony detection) and cross-lingual (English) settings. Results show that the debiasing method enhances the robustness and generalizability of the models for satire and irony detection tasks in Turkish and English. However, its impact on causal language models, such as Llama-3.1, is limited. Additionally, this work curates and presents the Turkish Satirical News Dataset with detailed human annotations, with case studies on classification, debiasing, and explainability.