CleanComedy: Creating Friendly Humor through Generative Techniques

作者: Dmitry Vikhorev, Daria Galimzianova, Svetlana Gorovaia, Elizaveta Zhemchuzhina, Ivan P. Yamshchikov

分类: cs.CL

发布日期: 2024-12-12

💡 一句话要点

CleanComedy:通过生成技术创建友好的幽默内容

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 幽默生成 自然语言处理 数据过滤 毒性检测 语料库构建

📋 核心要点

- 现有幽默数据集存在毒性和重复性问题,阻碍了高质量幽默生成模型的训练。

- CleanComedy通过毒性过滤构建高质量笑话语料库,为幽默生成提供更清洁的数据。

- 通过对比实验,评估了CleanComedy数据集训练的生成模型与人类创作的幽默效果。

📝 摘要(中文)

幽默生成是自然语言处理中一项具有挑战性的任务,原因在于资源有限以及现有数据集的质量不高。现有的幽默语言资源通常存在毒性和重复性问题,限制了其在训练鲁棒模型方面的有效性。本文提出了CleanComedy,这是一个专门的、部分标注的、经过毒性过滤的英语和俄语笑话语料库,这些笑话来自各种来源。我们通过对不同笑话组的幽默和毒性水平的调查,研究了我们的数据过滤方法的有效性。此外,我们通过比较人类编写的笑话与各种生成笑话(包括我们基于CleanComedy数据集训练的基线模型生成的笑话)来研究计算机幽默生成的进展。

🔬 方法详解

问题定义:论文旨在解决幽默生成领域中数据集质量不高的问题。现有的幽默数据集通常包含大量有毒和重复的内容,这严重影响了训练出的幽默生成模型的质量和鲁棒性。这些低质量的数据使得模型难以学习到真正幽默的表达方式,甚至可能生成不恰当或冒犯性的内容。

核心思路:论文的核心思路是通过构建一个经过严格毒性过滤的笑话语料库CleanComedy,来提供更干净、更高质量的训练数据。通过减少数据集中的毒性和重复内容,期望能够训练出更安全、更友好的幽默生成模型。这种方法侧重于数据质量的提升,而非模型结构的复杂化。

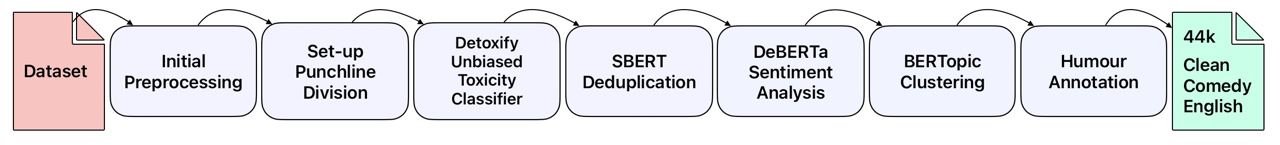

技术框架:CleanComedy的构建流程主要包括以下几个阶段:1) 数据收集:从各种来源收集大量的英语和俄语笑话。2) 毒性过滤:使用自动化的毒性检测工具和人工审核相结合的方式,对收集到的笑话进行毒性过滤。3) 数据标注:对部分数据进行幽默程度和毒性程度的标注,用于后续的分析和评估。4) 模型训练:使用CleanComedy数据集训练基线幽默生成模型。5) 评估:通过人工评估和自动指标相结合的方式,评估生成模型的性能。

关键创新:该论文的关键创新在于提出了CleanComedy数据集,这是一个专门针对幽默生成任务而构建的、经过毒性过滤的高质量语料库。与以往的幽默数据集相比,CleanComedy更加注重数据的质量和安全性,从而为训练更友好的幽默生成模型提供了基础。此外,论文还对数据过滤方法的有效性进行了深入的分析和评估。

关键设计:论文中关于毒性过滤的具体方法和阈值选择是关键设计。自动化毒性检测工具的选择、人工审核的标准、以及如何平衡毒性过滤的严格程度和数据量的保留,都会直接影响到CleanComedy数据集的质量。此外,基线幽默生成模型的选择和训练策略,以及评估指标的选择,也会影响到实验结果的可靠性。

🖼️ 关键图片

📊 实验亮点

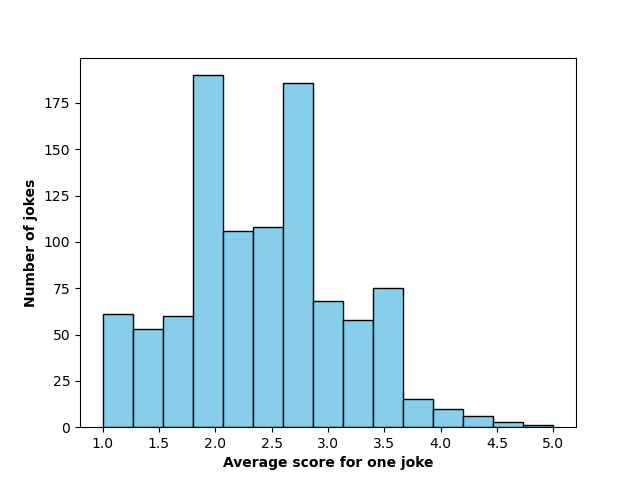

论文通过人工评估验证了CleanComedy数据集的有效性,表明经过毒性过滤后的数据集能够显著降低生成内容的毒性。对比实验显示,基于CleanComedy训练的基线模型在生成幽默内容时,能够产生更符合人类价值观的输出,减少了不恰当或冒犯性言论的出现。

🎯 应用场景

该研究成果可应用于智能聊天机器人、社交媒体内容生成、娱乐应用等领域。通过生成更友好、更安全的幽默内容,可以提升用户体验,避免不必要的冒犯和争议。未来,该技术有望应用于教育领域,帮助学生更好地理解和运用幽默。

📄 摘要(原文)

Humor generation is a challenging task in natural language processing due to limited resources and the quality of existing datasets. Available humor language resources often suffer from toxicity and duplication, limiting their effectiveness for training robust models. This paper proposes CleanComedy, a specialized, partially annotated toxicity-filtered corpus of English and Russian jokes collected from various sources. We study the effectiveness of our data filtering approach through a survey on humor and toxicity levels in various joke groups. In addition, we study advances in computer humor generation by comparing jokes written by humans with various groups of generative jokes, including our baseline models trained on the CleanComedy datasets.