Forest-of-Thought: Scaling Test-Time Compute for Enhancing LLM Reasoning

作者: Zhenni Bi, Kai Han, Chuanjian Liu, Yehui Tang, Yunhe Wang

分类: cs.CL, cs.AI

发布日期: 2024-12-12 (更新: 2025-04-01)

备注: Preprint

🔗 代码/项目: GITHUB

💡 一句话要点

提出Forest-of-Thought框架,提升LLM在复杂推理任务中的精度和效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 复杂推理 思维森林 集体决策 稀疏激活 动态自校正 共识机制

📋 核心要点

- 现有CoT和ToT方法在复杂推理中存在单次推理和无法回溯错误路径的局限性。

- FoT框架通过集成多个推理树,利用集体决策和稀疏激活策略来提升推理能力。

- 实验表明,FoT框架结合动态自校正和共识引导决策,显著提升了LLM的推理精度和效率。

📝 摘要(中文)

大型语言模型(LLMs)在各种语言任务中表现出卓越的能力,但解决复杂的推理问题仍然是一个重大挑战。现有的方法,如思维链(CoT)和思维树(ToT),通过分解问题或构建提示来增强推理能力,但它们通常执行单次推理,并且可能无法重新审视有缺陷的路径,从而影响准确性。为了解决这个局限性,我们提出了一种新的推理框架,称为Forest-of-Thought(FoT),它集成了多个推理树,以利用集体决策来解决复杂的逻辑问题。FoT采用稀疏激活策略来选择最相关的推理路径,从而提高效率和准确性。此外,我们引入了一种动态自校正策略,可以实现实时错误纠正,以及共识引导的决策策略,以优化正确性和计算资源。实验结果表明,FoT框架结合这些策略,显著增强了LLMs的推理能力,使其能够以更高的精度和效率解决复杂的任务。

🔬 方法详解

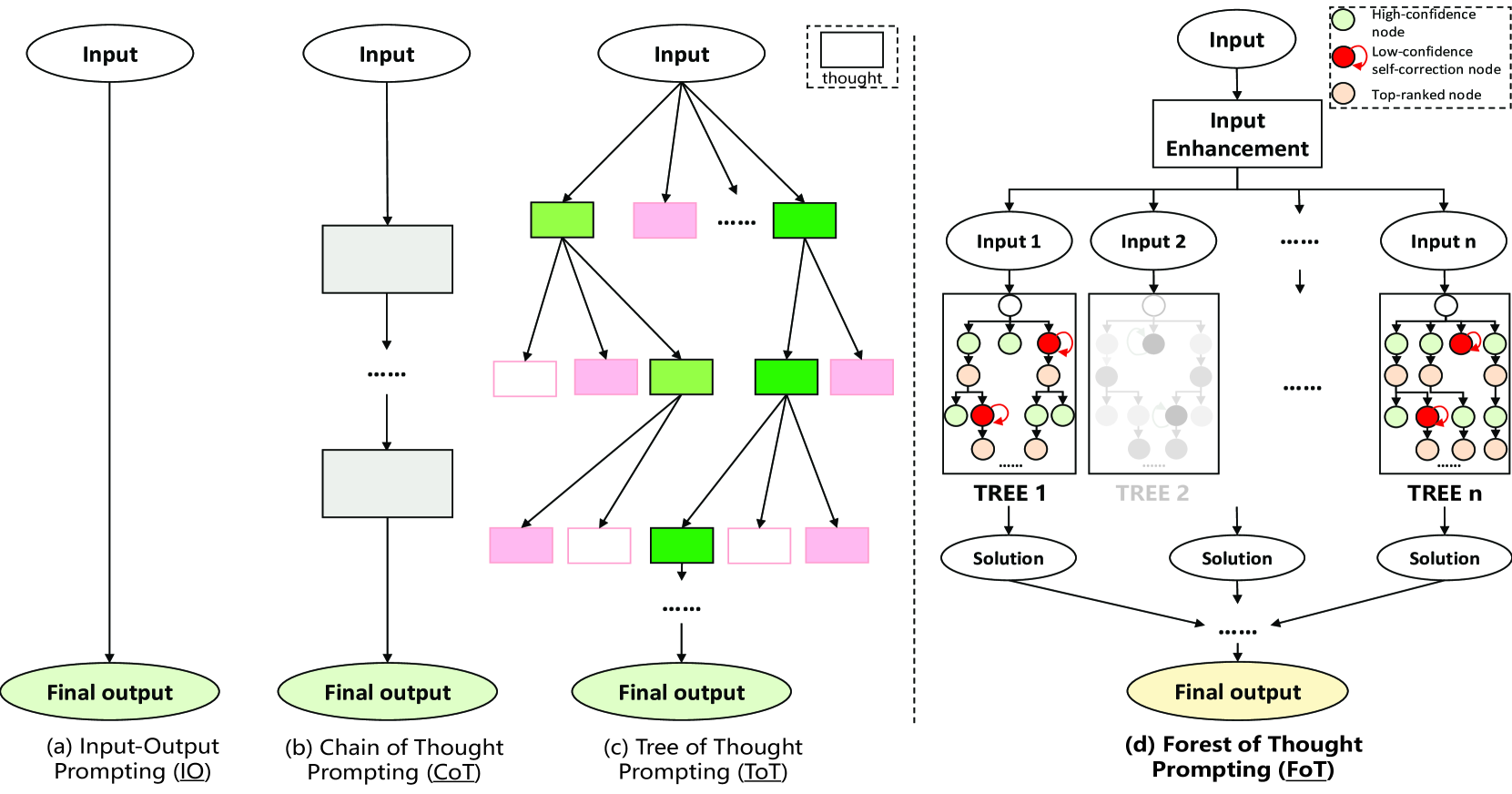

问题定义:论文旨在解决大型语言模型在复杂推理任务中准确率不高的问题。现有的Chain-of-Thought (CoT) 和 Tree-of-Thought (ToT) 方法虽然能分解问题或构建提示,但通常只进行单次推理,无法回溯和修正错误的推理路径,导致最终结果不准确。

核心思路:论文的核心思路是构建一个“思维森林”(Forest-of-Thought),即多个并行的推理树。每个树代表一种可能的推理路径,通过集体决策的方式,综合多个推理路径的结果,从而提高整体的推理准确性。同时,采用稀疏激活策略,只选择最相关的推理路径,提高效率。

技术框架:FoT框架包含以下几个主要模块:1) 多个推理树生成:针对同一个问题,生成多个不同的推理树,每棵树代表一种可能的推理路径。2) 稀疏激活:根据一定的策略(例如,基于置信度或相关性),选择激活部分推理树,减少计算量。3) 动态自校正:在推理过程中,实时检测和纠正错误,避免错误传播。4) 共识引导决策:综合多个推理树的结果,通过共识机制(例如,投票或加权平均)做出最终决策。

关键创新:FoT的关键创新在于将多个推理树集成到一个框架中,通过集体决策的方式提高推理准确性。与传统的单次推理方法相比,FoT能够探索更多的推理路径,并纠正错误,从而获得更可靠的结果。此外,稀疏激活策略和动态自校正策略进一步提高了效率和准确性。

关键设计:稀疏激活策略可以基于多种指标,例如,每个推理步骤的置信度、不同推理树之间的相关性等。动态自校正策略可以通过比较不同推理路径的结果,或者利用外部知识库进行验证。共识引导决策可以采用简单的投票机制,也可以采用更复杂的加权平均或专家系统。

🖼️ 关键图片

📊 实验亮点

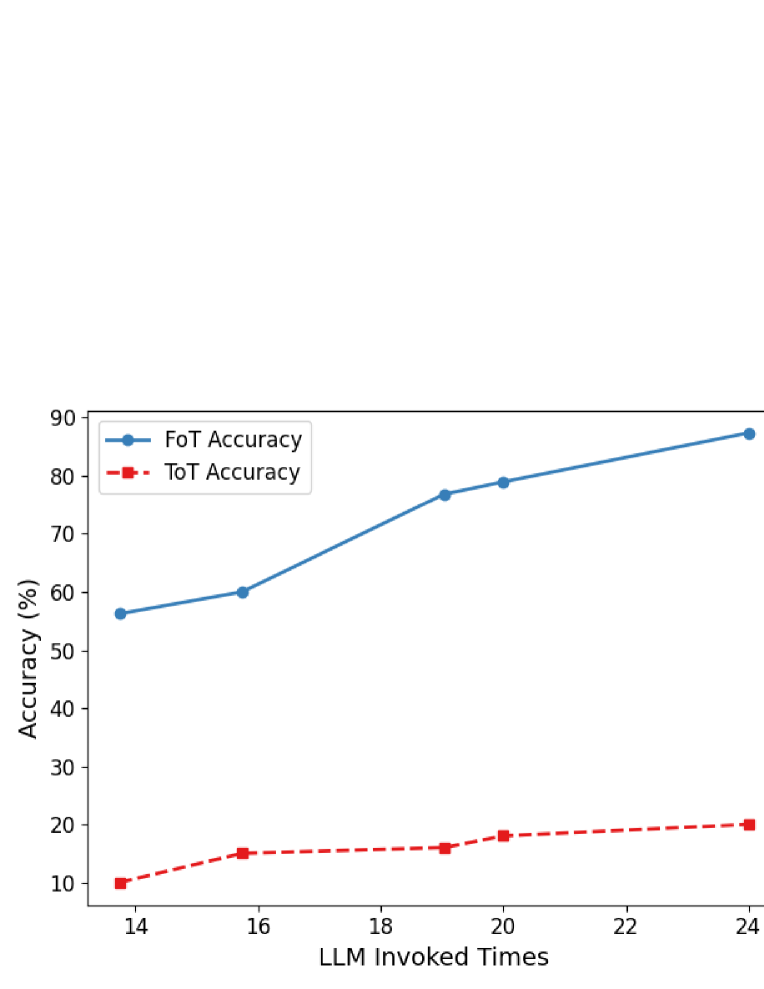

实验结果表明,FoT框架显著提升了LLM在复杂推理任务中的性能。例如,在某些benchmark上,FoT将LLM的准确率提高了10%-20%,并且在保证准确率的同时,显著降低了计算成本。这些结果表明,FoT是一种有效的提升LLM推理能力的方法。

🎯 应用场景

Forest-of-Thought框架可应用于需要复杂推理的各种场景,例如:智能问答、代码生成、数学问题求解、策略规划等。该框架能够提升LLM在这些领域的性能,使其能够更准确、更可靠地解决复杂问题。未来,FoT有望成为提升通用人工智能推理能力的重要技术。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable abilities across various language tasks, but solving complex reasoning problems remains a significant challenge. While existing methods, such as Chain-of-Thought (CoT) and Tree-of-Thought (ToT), enhance reasoning by decomposing problems or structuring prompts, they typically perform a single pass of reasoning and may fail to revisit flawed paths, compromising accuracy. To address this limitation, we propose a novel reasoning framework called Forest-of-Thought (FoT), which integrates multiple reasoning trees to leverage collective decision-making for solving complex logical problems. FoT employs sparse activation strategies to select the most relevant reasoning paths, improving both efficiency and accuracy. Additionally, we introduce a dynamic self-correction strategy that enables real-time error correction, along with consensus-guided decision-making strategies to optimize both correctness and computational resources. Experimental results demonstrate that the FoT framework, combined with these strategies, significantly enhances the reasoning capabilities of LLMs, enabling them to solve complex tasks with greater precision and efficiency. Code will be available at https://github.com/iamhankai/Forest-of-Thought.