EmoVerse: Exploring Multimodal Large Language Models for Sentiment and Emotion Understanding

作者: Ao Li, Longwei Xu, Chen Ling, Jinghui Zhang, Pengwei Wang

分类: cs.CL

发布日期: 2024-12-11 (更新: 2025-03-31)

DOI: 10.1016/j.neucom.2025.130810

🔗 代码/项目: GITHUB

💡 一句话要点

提出EmoVerse:用于情感理解的多模态大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 情感计算 多任务学习 情感分析 情感识别 面部表情识别 情感推理 人机交互

📋 核心要点

- 现有MLLM在情感计算领域,尤其是在细微表情识别和复杂情感推理方面存在不足。

- EmoVerse通过多任务训练策略,构建统一的MLLM,以处理情感和情绪相关任务。

- EmoVerse在情感分析、情感识别等任务上超越现有方法,达到state-of-the-art水平。

📝 摘要(中文)

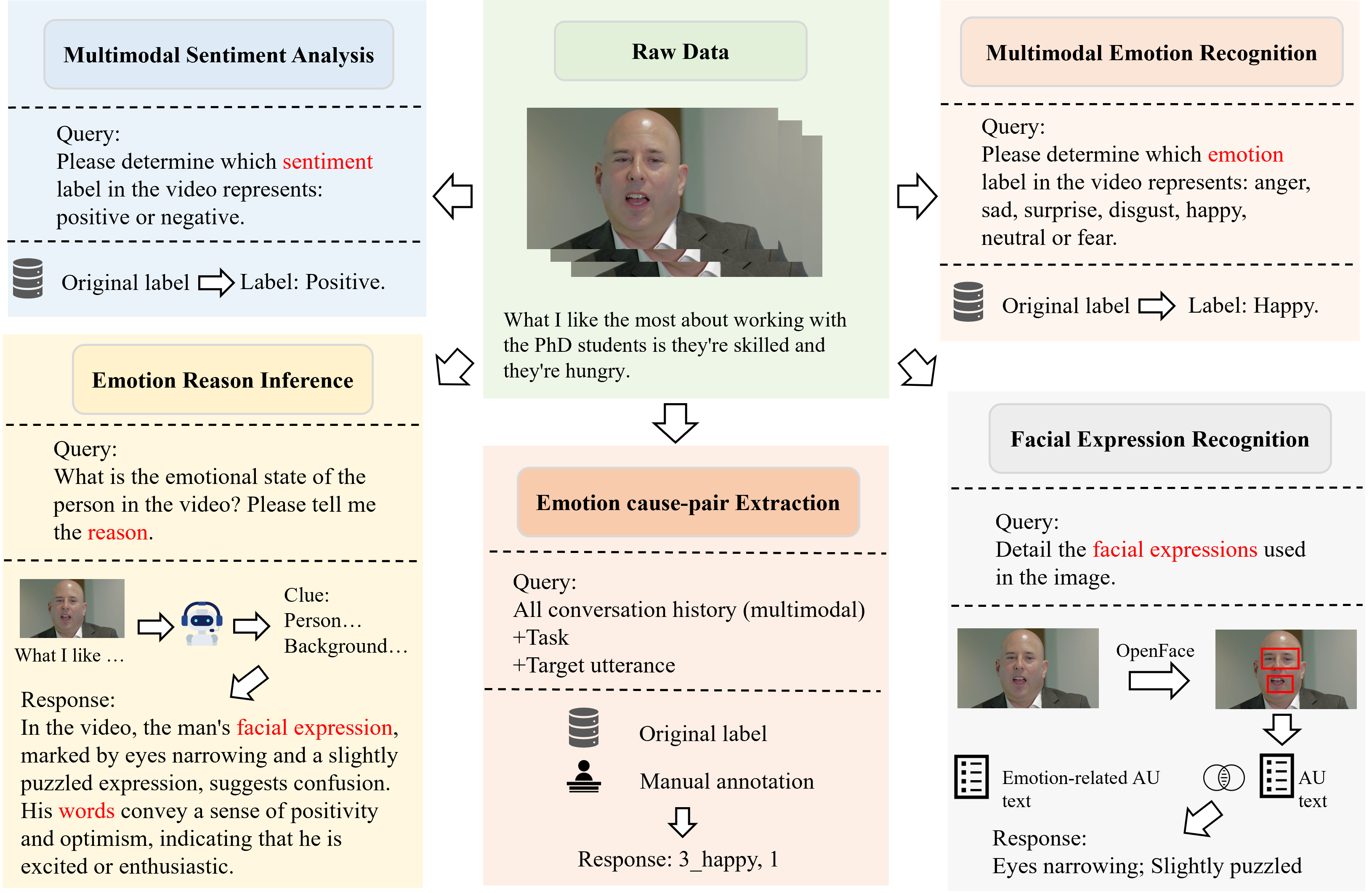

情感理解对于人机交互和抑郁症检测等应用至关重要。尽管多模态大语言模型(MLLM)展现了强大的通用能力,但在情感计算领域,尤其是在检测细微面部表情和处理复杂的情感相关任务(如情感推理和长文本情感理解)方面,它们面临着巨大的挑战。此外,目前缺乏能够有效处理情感和情绪相关任务的统一MLLM。为了应对这些挑战,我们探索了情感计算中MLLM的多任务训练策略,并推出了情感宇宙(EmoVerse),这是一个旨在处理广泛情感和情绪相关任务的MLLM。此外,EmoVerse能够深入分析情绪状态的根本原因。我们还引入了情感多任务(AMT)数据集,该数据集支持多模态情感分析、多模态情感识别、面部表情识别、情感原因推理和情感原因对提取任务。大量实验表明,EmoVerse优于现有方法,在情感和情绪相关任务中取得了最先进的结果。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型在情感计算领域,特别是细微面部表情识别、复杂情感推理以及长文本情感理解方面的不足。现有方法难以有效处理情感和情绪相关任务,缺乏统一的MLLM模型。

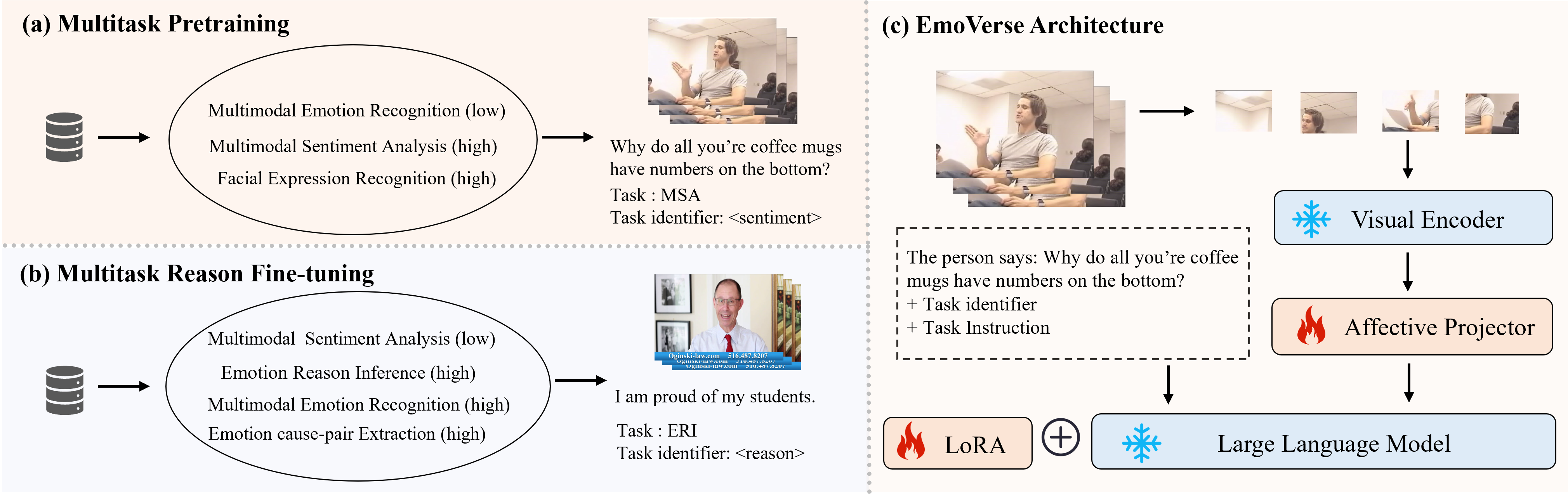

核心思路:论文的核心思路是利用多任务学习,训练一个统一的MLLM模型EmoVerse,使其能够同时处理多种情感相关的任务,包括情感分析、情感识别、面部表情识别、情感原因推理和情感原因对提取。通过共享底层表示,提高模型在不同任务上的泛化能力。

技术框架:EmoVerse的技术框架主要包括视觉编码器(用于处理图像和视频输入)、文本编码器(用于处理文本输入)以及一个大型语言模型(LLM)。视觉和文本编码器将多模态输入转换为统一的特征表示,然后输入到LLM中进行情感分析和推理。整个框架采用端到端的方式进行训练。

关键创新:论文的关键创新在于提出了一个统一的多模态大语言模型EmoVerse,能够同时处理多种情感相关的任务。此外,论文还构建了一个新的情感多任务数据集AMT,该数据集包含了多种情感相关的标注,为模型的训练和评估提供了支持。

关键设计:EmoVerse的关键设计包括:1) 采用预训练的视觉和文本编码器,以提高特征提取的效率;2) 使用多任务学习策略,联合训练模型在不同任务上的性能;3) 设计了特定的损失函数,以优化模型在情感分析和推理方面的表现;4) 构建了包含多种情感标注的AMT数据集,为模型的训练和评估提供支持。具体的网络结构和参数设置在论文中有详细描述,但此处未给出具体数值。

🖼️ 关键图片

📊 实验亮点

EmoVerse在多项情感计算任务上取得了state-of-the-art的结果。例如,在多模态情感分析任务上,EmoVerse的性能显著优于现有方法。具体的数据指标和提升幅度可以在论文的实验部分找到。AMT数据集的构建也为情感计算领域的研究提供了新的资源。

🎯 应用场景

EmoVerse在人机交互、心理健康评估、抑郁症检测、智能客服等领域具有广泛的应用前景。它可以帮助机器更好地理解人类的情感,从而提供更个性化、更贴心的服务。未来,EmoVerse可以应用于社交媒体情感分析、舆情监控、电影推荐等领域,具有重要的实际价值和深远影响。

📄 摘要(原文)

Sentiment and emotion understanding are essential to applications such as human-computer interaction and depression detection. While Multimodal Large Language Models (MLLMs) demonstrate robust general capabilities, they face considerable challenges in the field of affective computing, particularly in detecting subtle facial expressions and handling complex emotion-related tasks, such as emotion reason inference and understanding emotions in long-context scenarios. Furthermore, there is a lack of a unified MLLM that can effectively handle both sentiment and emotion-related tasks. To address these challenges, we explore multi-task training strategies for MLLMs in affective computing and introduce Emotion Universe (EmoVerse), an MLLM designed to handle a broad spectrum of sentiment and emotion-related tasks. In addition, EmoVerse is capable of deeply analyzing the underlying causes of emotional states. We also introduce the Affective Multitask (AMT) Dataset, which supports multimodal sentiment analysis, multimodal emotion recognition, facial expression recognition, emotion reason inference, and emotion cause-pair extraction tasks. Extensive experiments demonstrate that EmoVerse outperforms existing methods, achieving state-of-the-art results in sentiment and emotion-related tasks. The code is available at https://github.com/liaolea/EmoVerse.