Identifying and Manipulating Personality Traits in LLMs Through Activation Engineering

作者: Rumi Allbert, James K. Wiles, Vlad Grankovsky

分类: cs.CL, cs.AI

发布日期: 2024-12-10 (更新: 2025-01-10)

💡 一句话要点

通过激活工程识别和操纵LLM中的人格特质

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 人格特质 激活工程 可解释性 动态调整

📋 核心要点

- 现有LLM人格调整方法缺乏细粒度和动态性,难以精确控制模型的人格特质。

- 该论文提出利用激活工程,通过识别和调整与特定人格特质相关的激活方向,实现LLM人格的动态微调。

- 研究旨在提升LLM的可解释性,并探讨人格调整技术可能带来的伦理问题,为安全使用LLM奠定基础。

📝 摘要(中文)

近年来,大型语言模型(LLM)领域发展迅速,其驱动力是对更高效率、可解释性和安全使用的追求。本研究建立在“激活工程”这一新颖方法的基础上,探索LLM中的人格修改,并借鉴了诸如《LLM中的拒绝行为由单一方向介导》和《通过对比激活添加来引导Llama 2》等研究。我们利用激活工程开发了一种识别和调整与人格特质相关的激活方向的方法,这可能允许动态的LLM人格微调。这项工作旨在进一步加深我们对LLM可解释性的理解,同时考察此类发展的伦理影响。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)人格特质难以精确控制和动态调整的问题。现有方法通常依赖于微调或提示工程,但这些方法缺乏细粒度和可解释性,难以针对特定人格特质进行有效干预。此外,现有方法往往是静态的,无法根据实际需求动态调整LLM的人格。

核心思路:论文的核心思路是利用激活工程,通过识别LLM内部与特定人格特质相关的激活方向,并对这些方向进行操纵,从而实现对LLM人格的精确控制和动态调整。这种方法借鉴了神经科学中对大脑特定区域激活与特定行为关联的研究,将LLM的内部激活视为一种可操纵的信号。

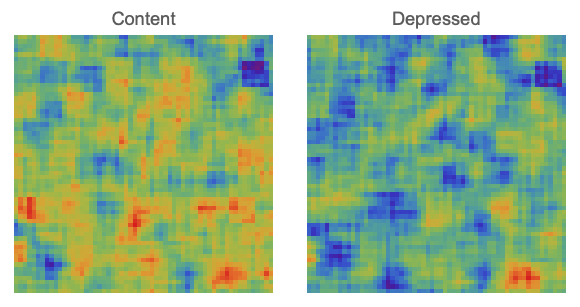

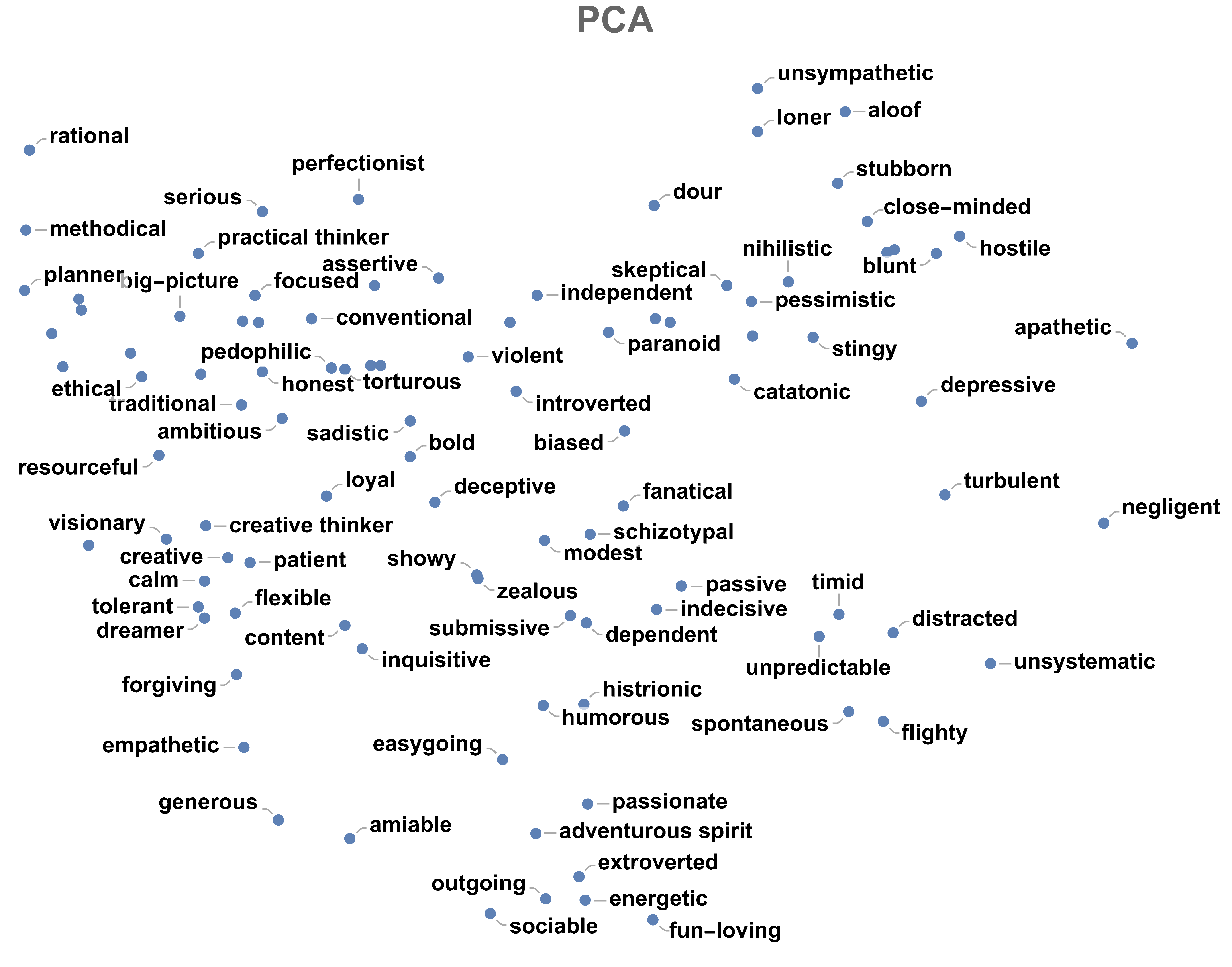

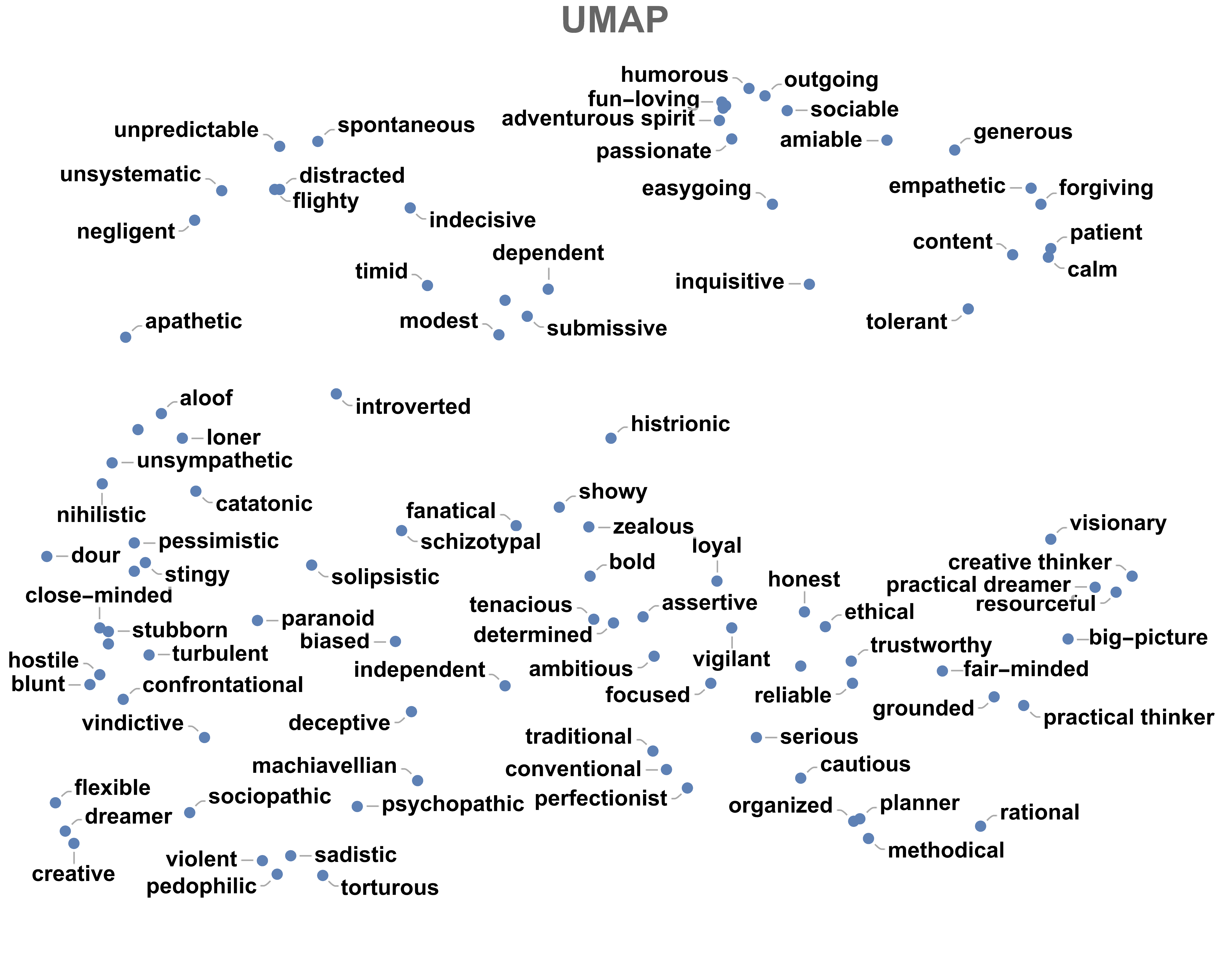

技术框架:该研究的技术框架主要包含以下几个阶段:1) 人格特质识别:通过实验或分析,确定LLM中与特定人格特质相关的激活方向。这可能涉及使用对比学习或梯度分析等技术。2) 激活方向操纵:设计算法或策略,对识别出的激活方向进行调整,以增强或减弱相应的人格特质。这可以通过直接修改激活值或添加/减去激活向量来实现。3) 效果评估:使用一系列指标评估人格调整的效果,例如,通过分析LLM生成的文本的风格、情感或行为模式。4) 伦理考量:分析人格调整技术可能带来的伦理风险,例如,滥用LLM进行欺骗或操纵。

关键创新:该论文的关键创新在于将激活工程应用于LLM人格特质的操纵。与传统的微调或提示工程相比,激活工程具有更高的细粒度和可解释性,可以直接干预LLM的内部状态,从而实现更精确的人格控制。此外,该方法还具有动态调整的潜力,可以根据实际需求实时修改LLM的人格。

关键设计:论文的关键设计可能包括:1) 激活方向识别方法:例如,使用对比学习训练一个分类器,区分具有不同人格特质的LLM的激活向量。2) 激活方向操纵策略:例如,使用梯度上升法找到能够最大化或最小化特定人格特质的激活向量。3) 评估指标:例如,使用情感分析工具评估LLM生成文本的情感倾向,或使用行为测试评估LLM在特定任务中的行为模式。具体的参数设置、损失函数和网络结构等技术细节未知,需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

由于论文是预印本,具体的实验结果未知。但可以推测,实验亮点可能包括:证明了激活工程可以有效地操纵LLM的人格特质;展示了该方法在不同LLM上的泛化能力;量化了人格调整对LLM行为的影响;并提出了缓解潜在伦理风险的策略。具体的性能数据、对比基线和提升幅度未知,需要参考论文原文。

🎯 应用场景

该研究成果可应用于多个领域,例如,可以用于创建具有特定人格特征的虚拟助手或游戏角色,也可以用于提高LLM在特定任务中的表现,例如,在客户服务中,可以根据客户的情绪调整LLM的回应方式。此外,该研究还有助于我们更好地理解LLM的内部机制,为开发更安全、更可控的LLM奠定基础。

📄 摘要(原文)

The field of large language models (LLMs) has grown rapidly in recent years, driven by the desire for better efficiency, interpretability, and safe use. Building on the novel approach of "activation engineering," this study explores personality modification in LLMs, drawing inspiration from research like Refusal in LLMs Is Mediated by a Single Direction (arXiv:2406.11717) and Steering Llama 2 via Contrastive Activation Addition (arXiv:2312.06681). We leverage activation engineering to develop a method for identifying and adjusting activation directions related to personality traits, which may allow for dynamic LLM personality fine-tuning. This work aims to further our understanding of LLM interpretability while examining the ethical implications of such developments.