Algorithmic Phase Transitions in Language Models: A Mechanistic Case Study of Arithmetic

作者: Alan Sun, Ethan Sun, Warren Shepard

分类: cs.CL

发布日期: 2024-12-10

备注: 10 pages, 5 figures

💡 一句话要点

揭示语言模型算术能力相变:Gemma-2-2b在不同位数加法中采用不同策略

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 算法稳定性 零样本学习 算术推理 Gemma-2-2b 泛化能力 逻辑推理

📋 核心要点

- 大型语言模型在逻辑推理任务中表现不稳定,难以在不同难度子任务间泛化。

- 通过研究模型在算术任务中的算法稳定性,揭示其问题解决策略的转变。

- 实验发现Gemma-2-2b在不同位数加法中采用不同计算模型,表明算法不稳定性是性能瓶颈。

📝 摘要(中文)

大型语言模型的零样本能力使其成为解决各种任务的强大工具,无需显式训练。然而,这些模型如何实现这种性能,或者为什么它们可以零样本某些任务而不能零样本其他任务,仍然不清楚。本文通过定义和研究语言模型中的算法稳定性来阐明这种现象——模型因任务规范的变化而采用的问题解决策略的变化。我们专注于一个需要算法稳定性才能泛化的任务:双操作数算术。令人惊讶的是,我们发现Gemma-2-2b在密切相关的子任务(即四位数与八位数加法)上采用了截然不同的计算模型。我们的研究结果表明,算法不稳定性可能是语言模型在某些逻辑推理任务中零样本性能较差的一个促成因素,因为它们难以抽象不同的问题解决策略并在它们之间平稳过渡。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在零样本学习中,尤其是在逻辑推理任务中表现出的泛化能力不足的问题。现有方法缺乏对模型内部问题解决策略稳定性的深入理解,导致无法解释模型在不同难度子任务上的性能差异。具体到算术任务,模型可能在简单情况下表现良好,但在复杂情况下性能急剧下降,这表明模型采用的算法策略可能不稳定。

核心思路:论文的核心思路是通过研究语言模型在算术任务中的“算法稳定性”来揭示其泛化能力不足的原因。算法稳定性指的是模型在面对任务规范的微小变化时,其内部问题解决策略是否会发生显著改变。如果模型在相似任务上采用截然不同的算法,则认为其算法不稳定,这可能导致泛化能力下降。

技术框架:论文主要通过实验分析Gemma-2-2b模型在不同位数加法任务上的表现来研究算法稳定性。具体流程包括:1) 设计不同位数的加法任务(例如,四位数加法和八位数加法);2) 使用Gemma-2-2b模型进行零样本推理;3) 分析模型在不同任务上的输出结果,判断其采用的计算模型是否一致;4) 通过对比不同任务上的模型行为,评估其算法稳定性。

关键创新:论文最重要的技术创新点在于提出了“算法稳定性”这一概念,并将其作为评估语言模型泛化能力的重要指标。与以往关注模型整体性能的评估方法不同,该研究深入分析了模型内部的问题解决策略,从而更细粒度地理解了模型的行为。此外,论文还发现即使是相对较小的模型(如Gemma-2-2b)也可能在相似任务上采用不同的算法,这挑战了以往对大型语言模型泛化能力的认知。

关键设计:论文的关键设计在于选择双操作数加法作为研究对象,因为它是一个相对简单但又需要一定逻辑推理能力的算术任务。通过控制操作数的位数,可以方便地调整任务的难度,从而观察模型在不同难度下的算法策略变化。此外,论文还关注模型输出结果的正确性,以及模型生成中间步骤(如果存在)的合理性,从而更全面地评估模型的算法稳定性。具体的参数设置和损失函数等技术细节未在摘要中提及,未知。

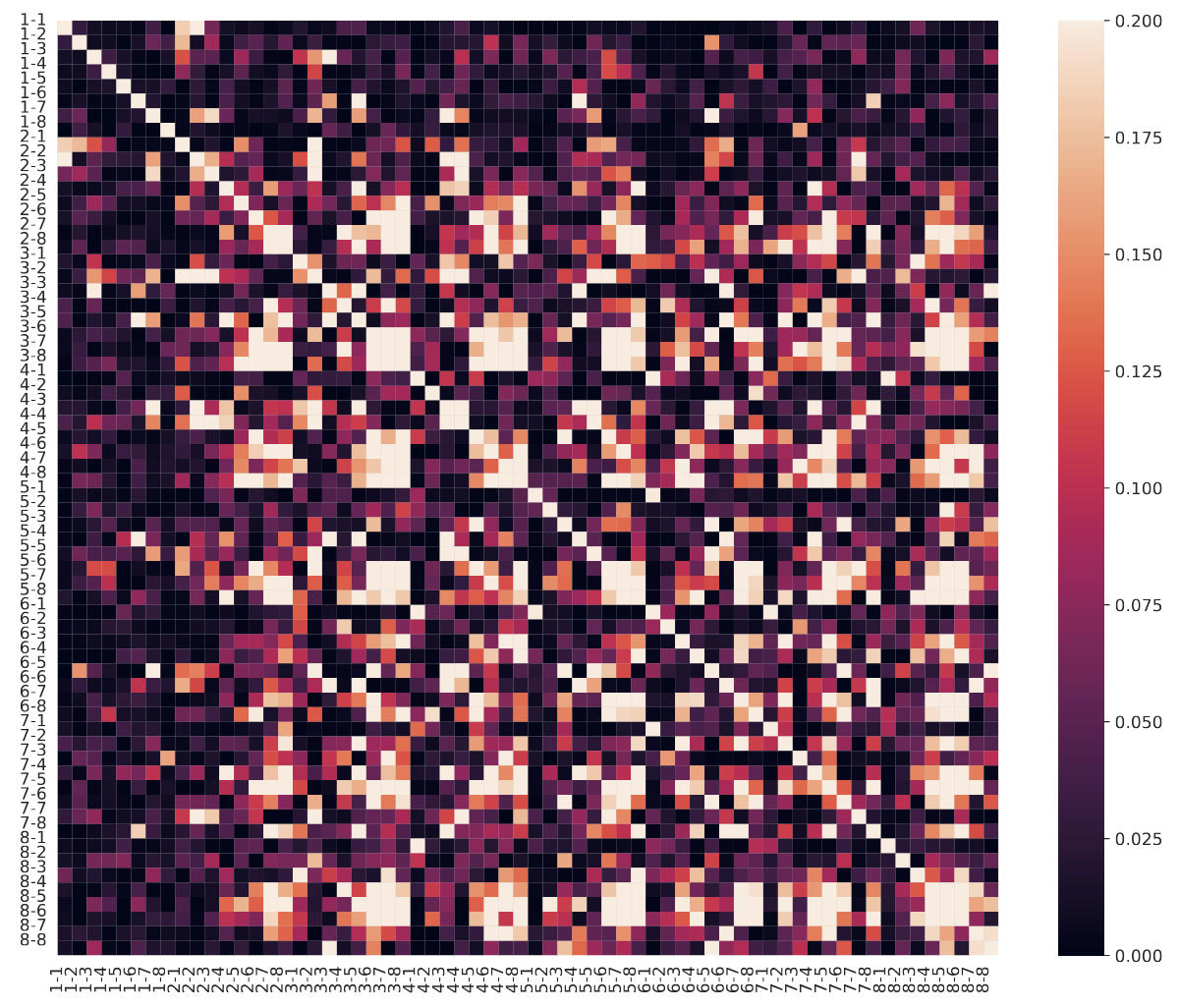

🖼️ 关键图片

📊 实验亮点

实验结果表明,Gemma-2-2b模型在四位数加法和八位数加法任务中采用了显著不同的计算模型,揭示了其算法不稳定性。具体性能数据和对比基线未在摘要中提及,未知。该发现强调了算法稳定性对语言模型泛化能力的重要性。

🎯 应用场景

该研究成果可应用于提升语言模型在逻辑推理、数学计算等领域的零样本泛化能力。通过提高模型的算法稳定性,可以使其在面对复杂或未知的任务时表现更佳。此外,该研究也为模型的可解释性研究提供了新的视角,有助于理解模型内部的推理过程。

📄 摘要(原文)

Zero-shot capabilities of large language models make them powerful tools for solving a range of tasks without explicit training. It remains unclear, however, how these models achieve such performance, or why they can zero-shot some tasks but not others. In this paper, we shed some light on this phenomenon by defining and investigating algorithmic stability in language models -- changes in problem-solving strategy employed by the model as a result of changes in task specification. We focus on a task where algorithmic stability is needed for generalization: two-operand arithmetic. Surprisingly, we find that Gemma-2-2b employs substantially different computational models on closely related subtasks, i.e. four-digit versus eight-digit addition. Our findings suggest that algorithmic instability may be a contributing factor to language models' poor zero-shot performance across certain logical reasoning tasks, as they struggle to abstract different problem-solving strategies and smoothly transition between them.