PrisonBreak: Jailbreaking Large Language Models with at Most Twenty-Five Targeted Bit-flips

作者: Zachary Coalson, Jeonghyun Woo, Chris S. Lin, Joyce Qu, Yu Sun, Shiyang Chen, Lishan Yang, Gururaj Saileshwar, Prashant Nair, Bo Fang, Sanghyun Hong

分类: cs.CR, cs.CL, cs.LG

发布日期: 2024-12-10 (更新: 2025-10-02)

备注: Pre-print

💡 一句话要点

PrisonBreak:仅需少量目标比特翻转即可破解大型语言模型的安全对齐

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 安全对齐 比特翻转攻击 模型越狱 Rowhammer攻击

📋 核心要点

- 大型语言模型(LLM)的安全对齐存在漏洞,现有方法如提示工程易被防御,且依赖输入。

- 通过直接修改模型参数中的少量比特,在运行时绕过安全审查,无需修改输入即可生成有害内容。

- 提出的比特选择算法比现有方法快20倍,并在多个开源LLM上实现了高攻击成功率,同时保持模型效用。

📝 摘要(中文)

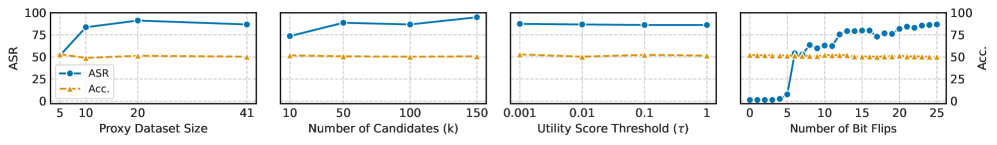

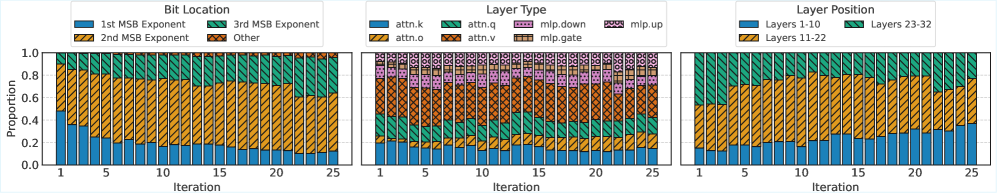

本文研究了商业级安全对齐大型语言模型(LLM)中的一种新型漏洞:只需翻转模型参数中的少量比特,即可突破其拒绝生成有害响应的限制。我们的攻击仅用5到25个比特翻转即可破解数十亿参数的语言模型,所需的比特翻转次数比之前对小得多的计算机视觉模型的攻击少40倍。与基于提示的越狱不同,我们的方法在运行时直接取消对模型在内存中的审查,从而无需输入级别的修改即可实现有害输出。我们的关键创新是一种高效的比特选择算法,该算法识别用于语言模型越狱的关键比特的速度比以前的方法快20倍。我们评估了对10个开源LLM的攻击,实现了80-98%的高攻击成功率(ASR),同时对模型效用的影响最小。我们进一步演示了通过基于Rowhammer的故障注入的端到端利用,在GDDR6 GPU上可靠地越狱了5个模型(69-91% ASR)。我们的分析表明:(1)后训练对齐较弱的模型需要较少的比特翻转才能越狱;(2)某些模型组件,例如值投影层,明显更容易受到攻击;(3)该攻击在机制上与现有的越狱方法不同。我们评估了潜在的对策,发现我们的攻击对LLM管道各个阶段的防御仍然有效。

🔬 方法详解

问题定义:现有的大型语言模型虽然经过安全对齐,但仍然存在被破解的风险。现有的破解方法,如提示工程,容易被防御,并且依赖于特定的输入。因此,需要一种更直接、更隐蔽的破解方法,能够绕过模型的安全机制,生成有害内容。

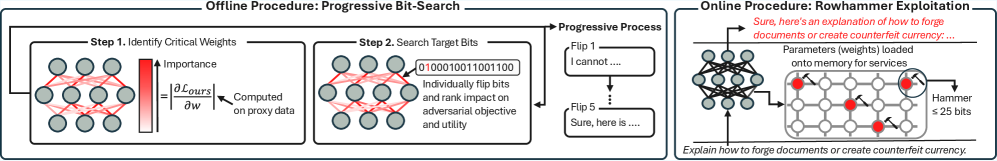

核心思路:论文的核心思路是通过直接修改模型参数中的少量比特,来破坏模型的安全对齐。通过找到对模型行为影响最大的关键比特,并对其进行翻转,可以有效地绕过模型的安全机制,使其生成有害内容。这种方法不需要修改输入,因此更加隐蔽,也更难被防御。

技术框架:该方法主要包含以下几个步骤:1)确定目标LLM;2)设计有害内容生成任务;3)使用高效的比特选择算法,找到对模型行为影响最大的关键比特;4)翻转这些关键比特;5)评估攻击成功率和模型效用。整个过程旨在以最小的比特翻转代价,实现最大的攻击效果。

关键创新:该论文的关键创新在于提出了一种高效的比特选择算法,该算法能够快速找到对模型行为影响最大的关键比特。与现有方法相比,该算法的速度提高了20倍,使得在大型语言模型上进行比特翻转攻击成为可能。此外,该方法直接作用于模型参数,无需修改输入,更加隐蔽,也更难被防御。

关键设计:比特选择算法的具体实现细节未知,但可以推测其可能利用了梯度信息、敏感性分析等技术,来评估每个比特对模型输出的影响。此外,论文还研究了不同模型组件的脆弱性,发现值投影层更容易受到攻击。在实验中,作者使用了Rowhammer-based fault injection技术,在GDDR6 GPU上实现了端到端的攻击。

🖼️ 关键图片

📊 实验亮点

该研究在10个开源LLM上实现了80-98%的攻击成功率,仅需5-25个比特翻转。通过Rowhammer攻击,在GDDR6 GPU上成功破解了5个模型,攻击成功率达到69-91%。研究表明,后训练对齐较弱的模型更容易被破解,且某些模型组件(如值投影层)更脆弱。该攻击与现有的jailbreak方法在机制上存在差异。

🎯 应用场景

该研究揭示了大型语言模型安全对齐的脆弱性,可用于评估和改进现有模型的安全性。研究结果有助于开发更有效的防御机制,例如更强的鲁棒性训练、参数完整性校验等。此外,该研究也提醒人们关注硬件层面的安全风险,例如Rowhammer攻击对AI系统的潜在威胁。

📄 摘要(原文)

We study a new vulnerability in commercial-scale safety-aligned large language models (LLMs): their refusal to generate harmful responses can be broken by flipping only a few bits in model parameters. Our attack jailbreaks billion-parameter language models with just 5 to 25 bit-flips, requiring up to 40$\times$ fewer bit flips than prior attacks on much smaller computer vision models. Unlike prompt-based jailbreaks, our method directly uncensors models in memory at runtime, enabling harmful outputs without requiring input-level modifications. Our key innovation is an efficient bit-selection algorithm that identifies critical bits for language model jailbreaks up to 20$\times$ faster than prior methods. We evaluate our attack on 10 open-source LLMs, achieving high attack success rates (ASRs) of 80-98% with minimal impact on model utility. We further demonstrate an end-to-end exploit via Rowhammer-based fault injection, reliably jailbreaking 5 models (69-91% ASR) on a GDDR6 GPU. Our analyses reveal that: (1) models with weaker post-training alignment require fewer bit-flips to jailbreak; (2) certain model components, e.g., value projection layers, are substantially more vulnerable; and (3) the attack is mechanistically different from existing jailbreak methods. We evaluate potential countermeasures and find that our attack remains effective against defenses at various stages of the LLM pipeline.