A Comparative Study on Code Generation with Transformers

作者: Namrata Das, Rakshya Panta, Neelam Karki, Ruchi Manandhar, Dinesh Baniya Kshatri

分类: cs.CL, cs.AI

发布日期: 2024-12-07

💡 一句话要点

研究Transformer架构在代码生成中的性能差异与鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 Transformer C++ 自然语言处理 模型对比 自动化编程

📋 核心要点

- 现有代码生成研究过度关注大型语言模型,缺乏对不同Transformer架构复杂度的性能对比。

- 提出一种基于Transformer架构和NLP方法的模型,用于自动生成C++源代码。

- 通过对比实验,评估了不同Transformer模型在处理不同复杂度问题时的鲁棒性。

📝 摘要(中文)

在自然语言处理(NLP)广泛影响的时代,越来越多的研究致力于用自动化系统取代传统的手动编码技术,以自主生成解决方案。随着代码生成领域的快速发展以及对大型语言模型的过度关注,有必要比较和评估基于Transformer架构的模型在不同复杂度下的性能。本文介绍了一个名为“Transformer代码生成对比研究”的概念,该模型基于Transformer架构和NLP方法,能够自动生成针对不同问题的C++源代码。本文进行了一项对比研究,以评估基于Transformer的模型在架构复杂性和处理从基本算术到复杂计算等不同问题集的能力方面的鲁棒性。

🔬 方法详解

问题定义:论文旨在解决代码自动生成的问题,特别是针对C++语言。现有方法,尤其是对大型语言模型的过度依赖,忽略了模型架构复杂性对代码生成质量的影响,缺乏对不同Transformer架构的系统性比较和评估。

核心思路:论文的核心思路是通过对比不同复杂度的Transformer模型在代码生成任务上的表现,来评估其鲁棒性和适用性。通过分析不同架构在处理不同难度问题时的性能差异,为选择合适的Transformer模型用于代码生成提供指导。

技术框架:论文构建了一个基于Transformer架构的代码生成系统。该系统接收问题描述作为输入,经过Transformer模型处理后,生成相应的C++源代码。具体的技术框架细节,例如采用的具体Transformer变体(如BERT、GPT等)以及训练流程,在摘要中没有明确提及,属于未知信息。

关键创新:论文的关键创新在于其对比研究的方法。它不是简单地提出一个新的代码生成模型,而是着重于分析现有Transformer架构在代码生成任务中的性能差异,从而为模型选择和优化提供依据。这种对比研究的思路在代码生成领域具有一定的参考价值。

关键设计:摘要中没有提供关于关键参数设置、损失函数、网络结构等技术细节的具体信息。这些细节可能在论文正文中有所描述,但根据摘要无法得知。

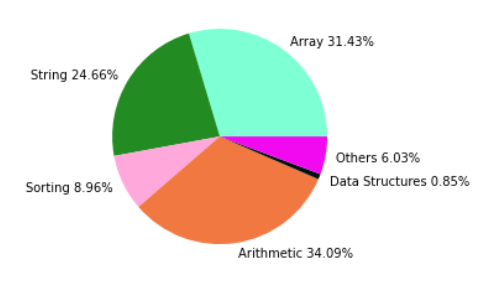

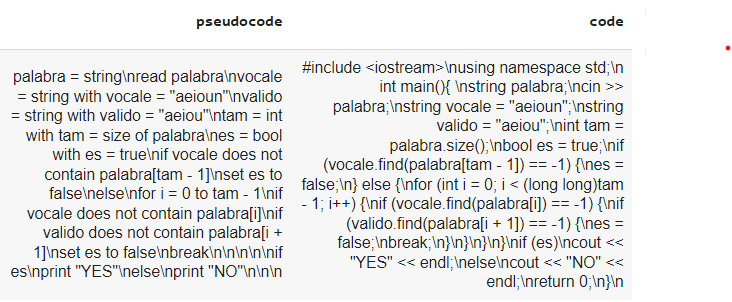

🖼️ 关键图片

📊 实验亮点

摘要中没有提供具体的实验结果数据,例如性能指标、对比基线、提升幅度等。因此,无法总结实验亮点。论文主要贡献在于提出了一个对比研究的框架,用于评估不同Transformer模型在代码生成任务中的性能。

🎯 应用场景

该研究成果可应用于自动化软件开发、教育编程辅助、以及快速原型设计等领域。通过自动生成代码,可以提高开发效率,降低开发成本,并为非专业人士提供编程支持。未来的影响在于推动软件开发的自动化和智能化。

📄 摘要(原文)

In an era of widespread influence of Natural Language Processing (NLP), there have been multiple research efforts to supplant traditional manual coding techniques with automated systems capable of generating solutions autonomously. With rapid research for code generation and a sole focus on large language models, there emerges a need to compare and evaluate the performance of transformer architectures based on several complexities of the model. This paper introduces the concept of a "A Comparative Study on Code Generation with Transformers," a model based on Transformer architecture, and NLP methodologies to automatically generate C++ source code for different varieties of problems. Here, a comparative study is performed to evaluate the robustness of transformer-based models on the basis of their architecture complexities and their capability to handle diverse problem sets, from basic arithmetic to complex computations.