Explingo: Explaining AI Predictions using Large Language Models

作者: Alexandra Zytek, Sara Pido, Sarah Alnegheimish, Laure Berti-Equille, Kalyan Veeramachaneni

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-12-06

备注: To be presented in the 2024 IEEE International Conference on Big Data (IEEE BigData)

💡 一句话要点

Explingo:利用大型语言模型将AI预测解释转化为自然语言叙述

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释AI 大型语言模型 自然语言生成 模型解释 AI信任

📋 核心要点

- 现有的可解释AI方法(如SHAP)生成的解释难以理解,阻碍了用户基于AI输出进行决策。

- Explingo利用大型语言模型将这些解释转化为自然语言叙述,使其更易于理解和使用。

- 实验表明,Explingo能够生成高质量的叙述,并在准确性、完整性、流畅性和简洁性方面表现出色。

📝 摘要(中文)

本文探讨了大型语言模型(LLMs)在将可解释人工智能(XAI)技术(如SHAP)生成的模型预测解释转化为人类可读的叙述格式方面的潜力,这些叙述格式与自然交流相一致。我们研究了两个关键问题:(1)LLMs能否可靠地将传统解释转化为高质量的叙述?(2)我们如何有效地评估叙述性解释的质量?为了回答这些问题,我们提出了Explingo,它由两个基于LLM的子系统组成:叙述器(Narrator)和评分器(Grader)。叙述器接收ML解释并将其转化为自然语言描述。评分器根据一系列指标(包括准确性、完整性、流畅性和简洁性)对这些叙述进行评分。实验表明,LLMs可以生成高质量的叙述,并在所有指标上都获得高分,尤其是在少量人工标注和自举示例的指导下。我们还确定了仍然具有挑战性的领域,特别是在有效评分复杂领域的叙述方面。这项工作的发现已集成到一个开源工具中,该工具使叙述性解释可用于进一步的应用。

🔬 方法详解

问题定义:现有的可解释AI(XAI)技术,例如SHAP,虽然能够提供模型预测的解释,但这些解释通常以特征重要性或其他技术指标的形式呈现,对于非专业人士来说难以理解和应用。这限制了用户对AI模型的信任和有效利用。因此,需要一种方法将这些技术解释转化为更易于理解的自然语言叙述。

核心思路:本文的核心思路是利用大型语言模型(LLMs)强大的自然语言生成能力,将XAI技术产生的解释转化为人类可读的叙述。通过将技术性的解释转化为自然语言,可以显著提高用户对AI模型预测的理解和信任。

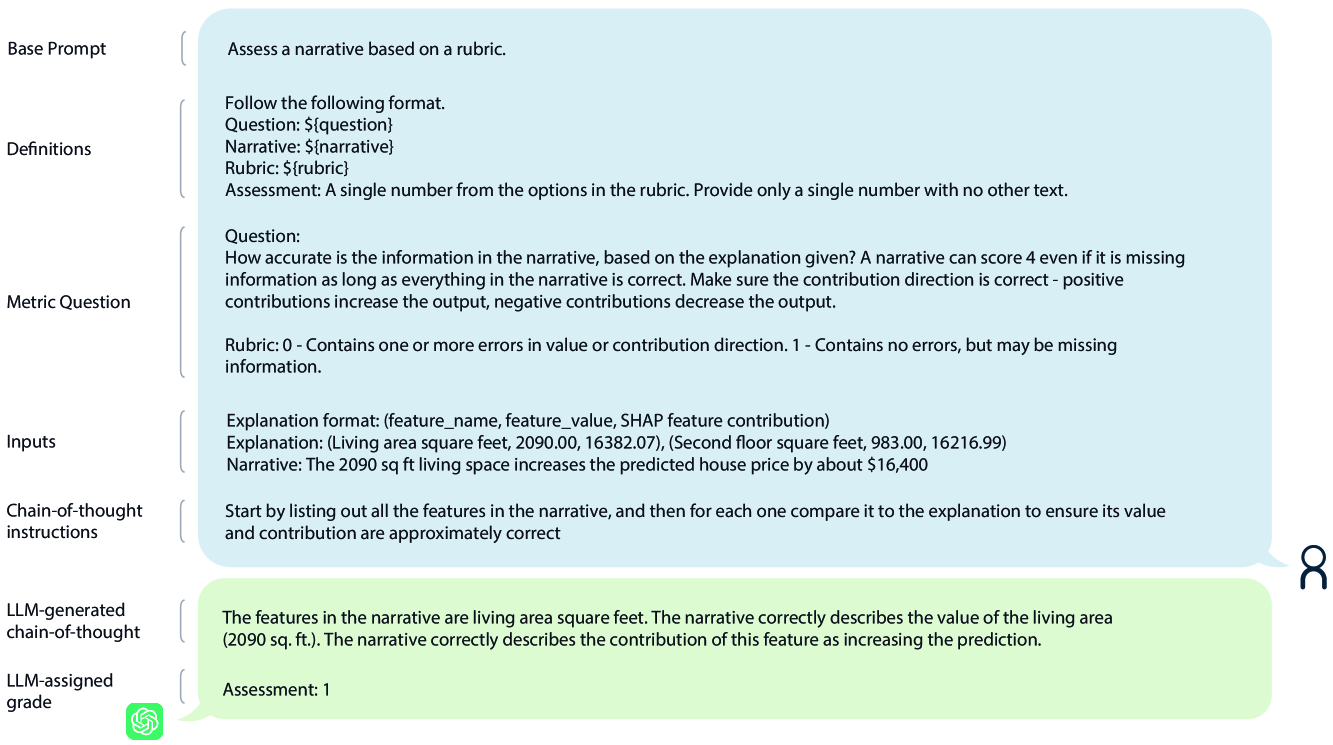

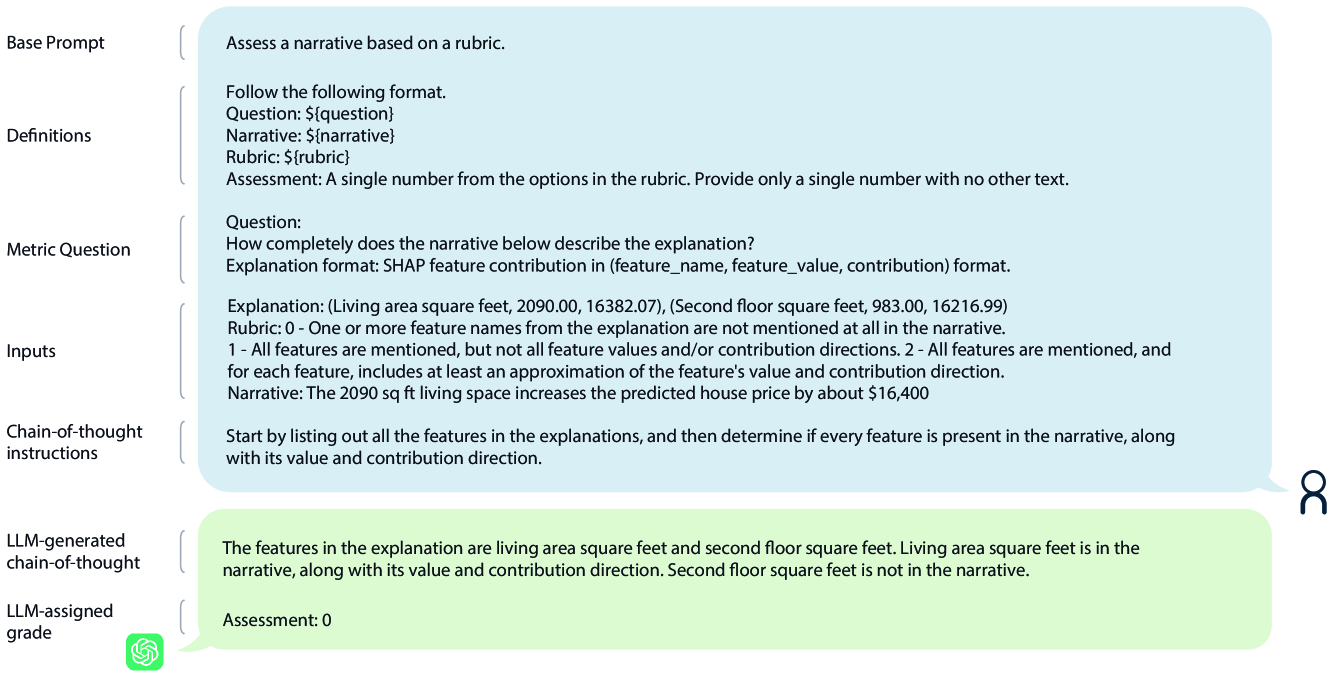

技术框架:Explingo包含两个主要模块:叙述器(Narrator)和评分器(Grader)。叙述器负责将XAI解释(例如SHAP值)作为输入,并使用LLM生成相应的自然语言叙述。评分器则使用另一个LLM对叙述器生成的叙述进行评估,评估指标包括准确性、完整性、流畅性和简洁性。整个框架通过迭代优化,提高叙述的质量。

关键创新:Explingo的关键创新在于将LLM应用于XAI解释的自然语言生成和评估。与传统的XAI方法相比,Explingo能够提供更易于理解的解释,从而提高用户对AI模型的信任和利用率。此外,Explingo的评分器模块能够自动评估叙述的质量,从而实现自动化和可扩展的解释生成。

关键设计:叙述器和评分器都基于大型语言模型。叙述器的关键设计在于如何有效地将XAI解释作为LLM的输入,并指导LLM生成高质量的叙述。这可能涉及到特定的prompt工程和微调策略。评分器的关键设计在于如何定义和量化叙述的质量指标,并训练LLM能够准确地评估这些指标。此外,如何利用少量人工标注数据进行自举学习,以提高LLM的性能,也是一个关键的设计考虑。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Explingo能够生成高质量的叙述,并在准确性、完整性、流畅性和简洁性方面都获得高分。特别是在少量人工标注和自举示例的指导下,Explingo的性能得到了显著提升。这些结果表明,LLMs在将XAI解释转化为自然语言叙述方面具有巨大的潜力。

🎯 应用场景

Explingo可应用于各种需要向用户解释AI模型预测的场景,例如金融风险评估、医疗诊断辅助、欺诈检测等。通过提供易于理解的自然语言解释,Explingo可以提高用户对AI模型的信任,并促进AI技术在各个领域的应用。未来,Explingo可以进一步扩展到支持更复杂的解释场景,例如多模态解释和因果解释。

📄 摘要(原文)

Explanations of machine learning (ML) model predictions generated by Explainable AI (XAI) techniques such as SHAP are essential for people using ML outputs for decision-making. We explore the potential of Large Language Models (LLMs) to transform these explanations into human-readable, narrative formats that align with natural communication. We address two key research questions: (1) Can LLMs reliably transform traditional explanations into high-quality narratives? and (2) How can we effectively evaluate the quality of narrative explanations? To answer these questions, we introduce Explingo, which consists of two LLM-based subsystems, a Narrator and Grader. The Narrator takes in ML explanations and transforms them into natural-language descriptions. The Grader scores these narratives on a set of metrics including accuracy, completeness, fluency, and conciseness. Our experiments demonstrate that LLMs can generate high-quality narratives that achieve high scores across all metrics, particularly when guided by a small number of human-labeled and bootstrapped examples. We also identified areas that remain challenging, in particular for effectively scoring narratives in complex domains. The findings from this work have been integrated into an open-source tool that makes narrative explanations available for further applications.