Hostility Detection in UK Politics: A Dataset on Online Abuse Targeting MPs

作者: Mugdha Pandya, Mali Jin, Kalina Bontcheva, Diana Maynard

分类: cs.CL

发布日期: 2024-12-05

💡 一句话要点

构建针对英国议员的在线恶意言论数据集,用于政治语境下的敌意检测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 敌意检测 政治语境 在线恶意言论 英国议员 数据集构建

📋 核心要点

- 现有敌意检测模型缺乏针对政治语境的特异性,难以有效识别针对政治人物的恶意言论。

- 构建针对英国议员的恶意言论数据集,并分析其语言和主题特征,为政治语境下的敌意检测提供数据基础。

- 评估了预训练语言模型和大型语言模型在敌意检测和身份类型分类任务上的性能,为后续模型选择提供参考。

📝 摘要(中文)

为了弥补现有通用敌意检测模型在政治语境下的不足,本文构建了一个包含3320条英语推文的数据集,这些推文跨越两年时间,并经过人工标注,用于检测针对英国议员的敌意言论。该数据集还捕获了恶意推文所针对的身份特征(种族、性别、宗教、无)。我们进行了语言和主题分析,深入研究了英国政治数据的独特内容。最后,我们评估了预训练语言模型和大型语言模型在二元敌意检测和多类目标身份类型分类任务中的性能。本研究为未来研究英国政治相关的敌意言论的普遍性和性质提供了有价值的数据和见解。

🔬 方法详解

问题定义:论文旨在解决现有敌意检测模型在政治语境下表现不佳的问题,尤其是在检测针对英国议员的在线恶意言论时。现有方法通常缺乏对政治领域特定语言和议题的理解,导致检测效果不佳。此外,缺乏高质量的政治领域恶意言论数据集也限制了相关研究的进展。

核心思路:论文的核心思路是构建一个专门针对英国政治人物的在线恶意言论数据集,并利用该数据集训练和评估现有的语言模型。通过人工标注,数据集包含了敌意言论的标签以及目标身份特征,从而能够更精确地识别和分类政治语境下的恶意言论。

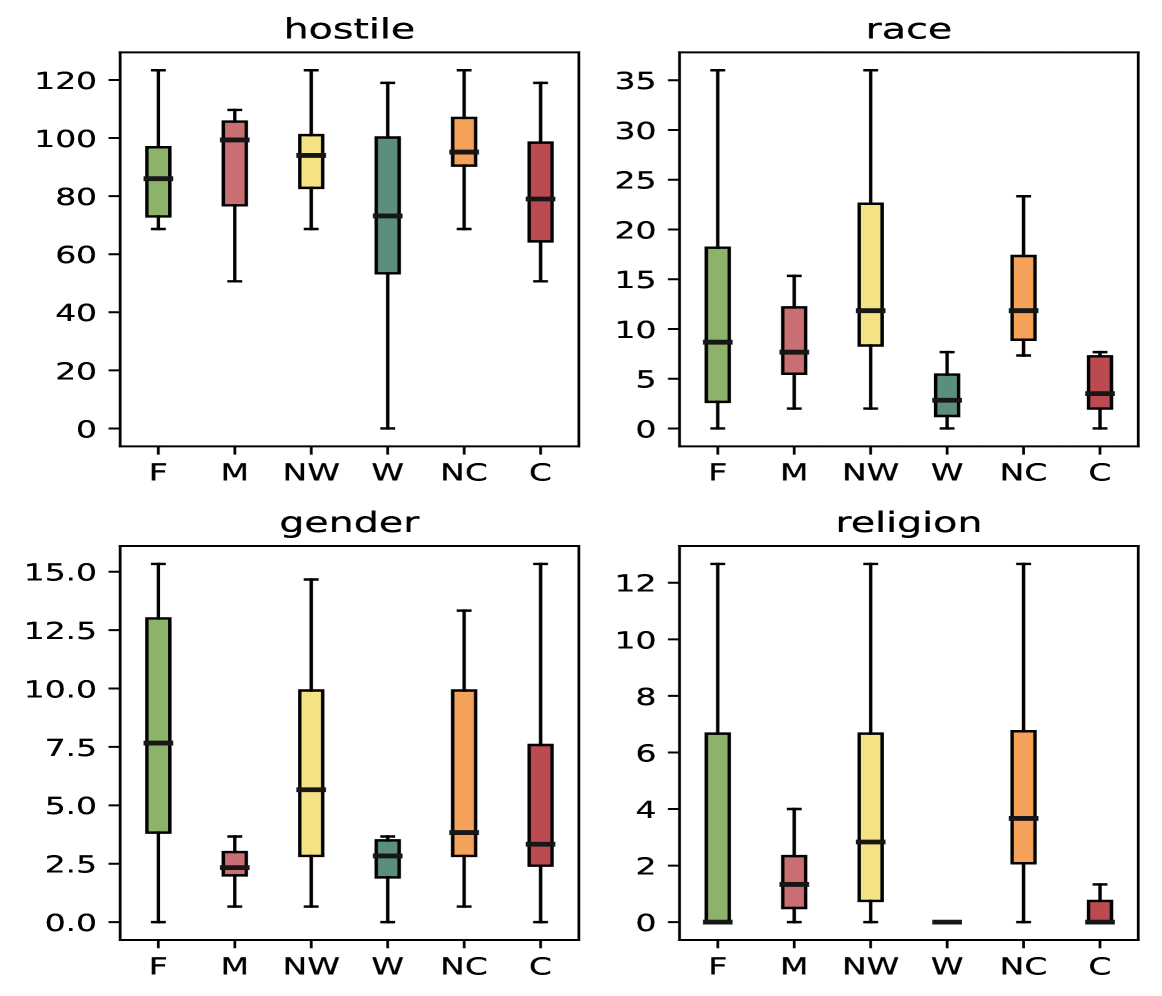

技术框架:该研究的技术框架主要包括以下几个阶段:1) 数据收集:收集过去两年内涉及英国议员的推文。2) 数据标注:人工标注推文是否包含敌意言论,并标注目标身份特征(种族、性别、宗教、无)。3) 数据分析:对数据集进行语言和主题分析,了解英国政治语境下恶意言论的特点。4) 模型评估:使用预训练语言模型和大型语言模型在数据集上进行二元敌意检测和多类目标身份类型分类任务,并评估其性能。

关键创新:该研究的关键创新在于构建了一个专门针对英国政治人物的在线恶意言论数据集。该数据集不仅包含了敌意言论的标签,还标注了目标身份特征,这使得研究人员能够更深入地了解政治语境下恶意言论的特点和影响。此外,该研究还对数据集进行了详细的语言和主题分析,为后续研究提供了有价值的见解。

关键设计:数据集包含3320条英语推文,跨越两年时间。标注过程由人工完成,确保了标注的准确性。在模型评估阶段,使用了多种预训练语言模型和大型语言模型,例如BERT、RoBERTa等。评估指标包括准确率、精确率、召回率和F1值等。

🖼️ 关键图片

📊 实验亮点

该研究构建了一个包含3320条推文的英国政治恶意言论数据集,并进行了详细的语言和主题分析。实验结果表明,预训练语言模型在二元敌意检测任务上取得了较好的性能,但对于多类目标身份类型分类任务仍有提升空间。该数据集和实验结果为后续研究提供了重要的基准和参考。

🎯 应用场景

该研究成果可应用于在线社交平台的内容审核,帮助识别和过滤针对政治人物的恶意言论,从而改善政治人物的在线交流环境。此外,该数据集和分析结果可用于研究政治极化、网络暴力等社会问题,为政策制定提供参考。未来,可以扩展该数据集到其他国家或地区,构建更通用的政治恶意言论检测系统。

📄 摘要(原文)

Numerous politicians use social media platforms, particularly X, to engage with their constituents. This interaction allows constituents to pose questions and offer feedback but also exposes politicians to a barrage of hostile responses, especially given the anonymity afforded by social media. They are typically targeted in relation to their governmental role, but the comments also tend to attack their personal identity. This can discredit politicians and reduce public trust in the government. It can also incite anger and disrespect, leading to offline harm and violence. While numerous models exist for detecting hostility in general, they lack the specificity required for political contexts. Furthermore, addressing hostility towards politicians demands tailored approaches due to the distinct language and issues inherent to each country (e.g., Brexit for the UK). To bridge this gap, we construct a dataset of 3,320 English tweets spanning a two-year period manually annotated for hostility towards UK MPs. Our dataset also captures the targeted identity characteristics (race, gender, religion, none) in hostile tweets. We perform linguistic and topical analyses to delve into the unique content of the UK political data. Finally, we evaluate the performance of pre-trained language models and large language models on binary hostility detection and multi-class targeted identity type classification tasks. Our study offers valuable data and insights for future research on the prevalence and nature of politics-related hostility specific to the UK.