Improving Linguistic Diversity of Large Language Models with Possibility Exploration Fine-Tuning

作者: Long Mai, Julie Carson-Berndsen

分类: cs.CL, cs.AI

发布日期: 2024-12-04

🔗 代码/项目: GITHUB

💡 一句话要点

提出Possibility Exploration Fine-Tuning (PEFT)以提升大语言模型输出的语言多样性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言多样性 大语言模型 微调 文本生成 对话系统 可能性探索 低延迟 语义多样性

📋 核心要点

- 现有大语言模型输出的语言多样性降低,导致观点同质化和特定群体代表性不足,而现有微调方法计算成本高,难以应用于低延迟场景。

- 论文提出Possibility Exploration Fine-Tuning (PEFT),通过可控的可能性编号,使模型在相同提示下生成多个不同的响应,提升语义多样性。

- 实验表明,PEFT显著提高了LLM输出的多样性,降低了候选响应之间的相似性,并能有效减少对话系统中的人口统计偏差。

📝 摘要(中文)

大型语言模型(LLMs)在复制类人能力方面取得了显著进展,但其输出的语言多样性降低的问题日益突出。这导致观点和视角的同质化,以及特定人口群体的代表性不足。虽然已经提出了一些微调和提示技术来解决这个问题,但它们通常是为特定任务定制的,或者伴随着计算成本和延迟的大幅增加。这使得它们难以应用于对延迟要求非常高的应用程序,如聊天机器人和虚拟助手。我们提出了一种与任务无关的框架——可能性探索微调(PEFT),它可以在不增加延迟或计算成本的情况下增强LLM的文本多样性。给定相同的提示,使用PEFT微调的模型可以同时生成多个不同的响应,每个响应对应于一个可控的可能性编号。在对话和故事生成任务上的实验表明,PEFT显著提高了LLM输出的多样性,候选响应之间的相似性明显降低。由于PEFT强调语义多样性而非词汇多样性,因此它还可以显著减少对话系统中的人口统计偏差。我们的代码和数据集已在GitHub上开源。

🔬 方法详解

问题定义:现有的大语言模型在生成文本时,存在语言多样性不足的问题,导致输出结果趋于同质化,缺乏不同的视角和表达方式。现有的微调方法虽然可以改善这一问题,但往往需要大量的计算资源和时间,增加了延迟,不适用于对实时性要求高的应用场景,例如聊天机器人。

核心思路:论文的核心思路是通过一种新的微调方法,即Possibility Exploration Fine-Tuning (PEFT),来提升大语言模型输出的语言多样性,同时保持较低的计算成本和延迟。PEFT的核心在于让模型能够探索不同的可能性,并生成与之对应的多样化文本。

技术框架:PEFT框架主要包含以下几个步骤:1. 准备训练数据,包括prompt和对应的多个不同回复;2. 使用prompt作为输入,让模型生成多个候选回复;3. 通过设计的损失函数,鼓励模型生成的不同回复之间的差异性,同时保证回复的质量;4. 通过调整“可能性编号”这一控制变量,可以控制模型生成不同风格和内容的回复。

关键创新:PEFT的关键创新在于其任务无关性(task-agnostic)和低成本。与以往针对特定任务的微调方法不同,PEFT可以应用于各种文本生成任务,而无需针对每个任务进行定制。此外,PEFT在微调过程中引入了“可能性编号”这一控制变量,使得用户可以灵活地控制模型生成不同风格和内容的回复。与现有方法相比,PEFT在提升语言多样性的同时,不会显著增加计算成本和延迟。

关键设计:PEFT的关键设计包括:1. 使用对比学习损失函数,鼓励模型生成不同回复之间的差异性;2. 引入“可能性编号”作为控制变量,影响模型生成回复的风格和内容;3. 采用轻量级的微调策略,避免引入过多的计算负担。具体的损失函数和网络结构细节在论文中进行了详细描述(未知)。

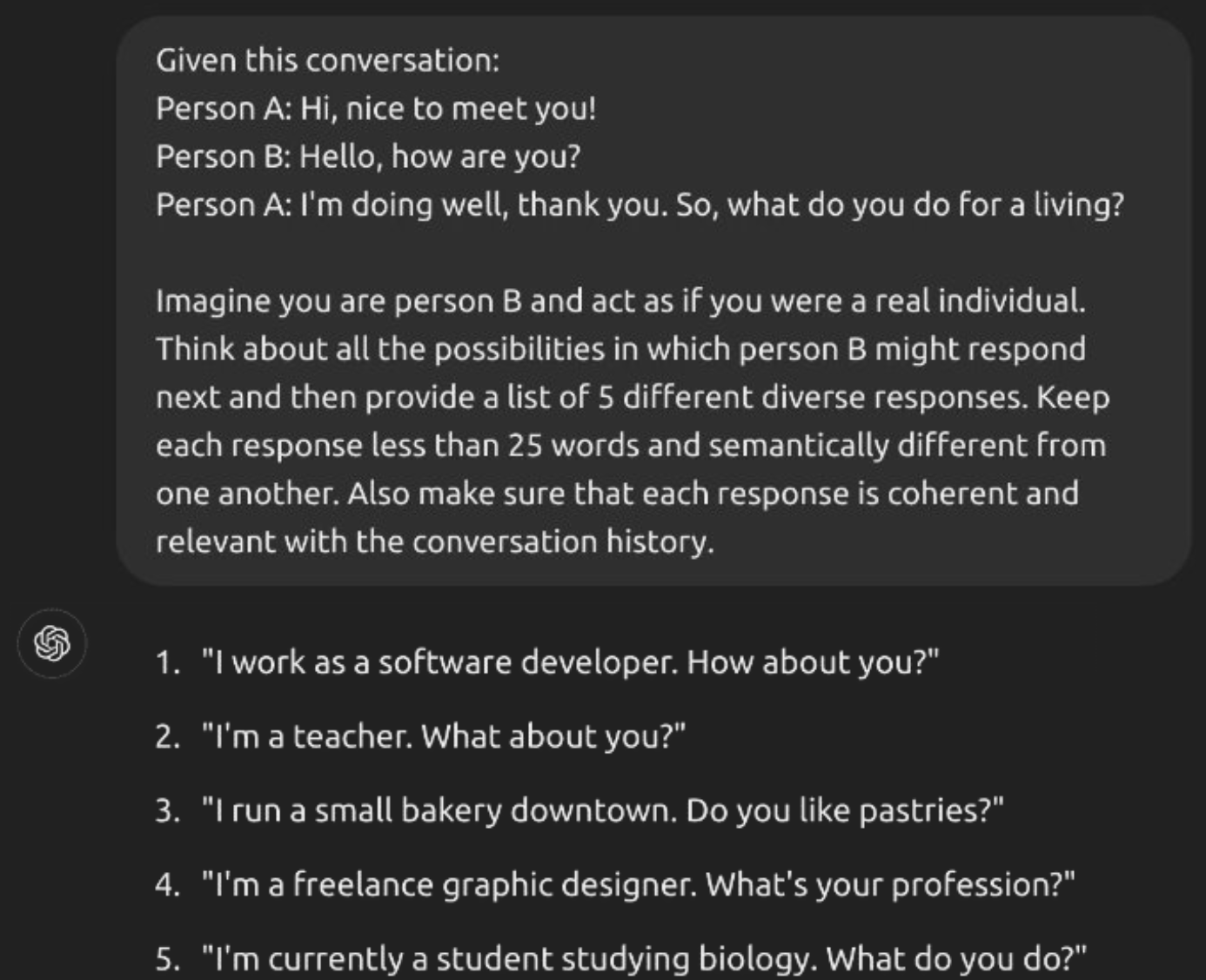

🖼️ 关键图片

📊 实验亮点

实验结果表明,PEFT能够显著提高LLM输出的语言多样性,降低候选响应之间的相似性。在对话和故事生成任务中,PEFT微调的模型在多样性指标上优于基线模型。此外,PEFT还能有效减少对话系统中的人口统计偏差,提升公平性。具体的性能数据和提升幅度在论文中进行了详细展示(未知)。

🎯 应用场景

该研究成果可广泛应用于各种需要生成多样化文本的场景,例如聊天机器人、虚拟助手、故事生成、内容创作等。通过提升语言多样性,可以使这些应用更具个性化和吸引力,并减少潜在的偏见。未来,该技术有望应用于更广泛的自然语言处理任务,例如机器翻译、文本摘要等,提升生成文本的质量和多样性。

📄 摘要(原文)

While Large Language Models (LLMs) have made significant strides in replicating human-like abilities, there are concerns about a reduction in the linguistic diversity of their outputs. This results in the homogenization of viewpoints and perspectives, as well as the underrepresentation of specific demographic groups. Although several fine-tuning and prompting techniques have been suggested to tackle the issue, they are often tailored to specific tasks or come with a substantial increase in computational cost and latency. This makes them challenging to apply to applications that demand very low latency, such as chatbots and virtual assistants. We propose Possibility Exploration Fine-Tuning (PEFT), a task-agnostic framework that enhances the text diversity of LLMs without increasing latency or computational cost. Given the same prompt, models fine-tuned with PEFT can simultaneously generate multiple diverse responses, each corresponding with a controllable possibility number. Experiments on dialogue and story generation tasks demonstrate that PEFT significantly enhances the diversity of LLM outputs, as evidenced by lower similarity between candidate responses. Since PEFT emphasizes semantic diversity over lexical diversity, it can also notably reduce demographic bias in dialogue systems. The implementations and datasets are available in our repository: https://github.com/mailong25/peft_diversity