AntLM: Bridging Causal and Masked Language Models

作者: Xinru Yu, Bin Guo, Shiwei Luo, Jie Wang, Tao Ji, Yuanbin Wu

分类: cs.CL

发布日期: 2024-12-04

备注: CoNLL Shared Task BabyLM Challenge

💡 一句话要点

AntLM:融合因果语言模型与掩码语言模型,提升预训练性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 预训练 因果语言模型 掩码语言模型 Transformer 混合训练 BabyLM

📋 核心要点

- 现有语言模型训练方法,如CLM和MLM,各有优缺点,单一模型难以兼顾收敛速度和最终性能。

- AntLM通过交替使用CLM和MLM训练目标,以及对应的注意力掩码,融合两种模型的优势。

- 实验表明,AntLM在BabyLlama和LTG-BERT上均取得了性能提升,验证了该方法的有效性。

📝 摘要(中文)

因果语言模型(CLM)和掩码语言模型(MLM)是两种基于Transformer网络的主流学习范式,分别对应Decoder-only和Encoder-only架构。这两种范式在下游任务中各有优缺点。在过去的BabyLM Challenge 2023中,虽然MLM范式取得了最佳平均性能,但CLM范式表现出明显更快的收敛速度。针对BabyLM Challenge 2024,我们提出了一种名为$ extbf{AntLM}$的新型语言建模范式,它集成了CLM和MLM,以利用这两种经典范式的优势。我们选择了strict-small赛道,并在两个基础模型上进行了实验:BabyLlama(代表CLM)和LTG-BERT(代表MLM)。在特定基础模型的训练过程中,我们交替应用CLM或MLM训练目标以及因果或双向注意力掩码。实验结果表明,结合这两种预训练目标可以发挥各自的优势,从而提高整体训练性能。在相同的epoch下,$AntLM_{BabyLlama}$的Macro-average提高了1%,$AntLM_{LTG-BERT}$的Macro-average比基线提高了2.2%。

🔬 方法详解

问题定义:现有因果语言模型(CLM)和掩码语言模型(MLM)各有优缺点。CLM通常收敛速度快,但最终性能可能不如MLM。MLM虽然性能潜力高,但训练效率较低。因此,如何结合两者的优势,提升整体训练效率和模型性能是一个关键问题。

核心思路:AntLM的核心思路是交替使用CLM和MLM的训练目标和注意力机制。通过这种方式,模型可以在训练初期利用CLM的快速收敛特性,并在后期利用MLM的性能优势,从而实现更快的收敛速度和更高的最终性能。这种交替训练的方式旨在弥合两种范式之间的差距,充分利用各自的优点。

技术框架:AntLM的整体框架是在预训练阶段,交替使用CLM和MLM的训练目标。具体来说,在每个训练迭代中,模型会随机选择使用CLM或MLM目标进行训练。同时,注意力掩码也会根据选择的训练目标进行切换,CLM使用因果注意力掩码,MLM使用双向注意力掩码。这种交替训练的方式可以看作是一种集成学习策略,将两种不同的模型训练方式融合在一起。

关键创新:AntLM的关键创新在于提出了交替训练的策略,将CLM和MLM两种预训练目标有机结合。与传统的单一使用CLM或MLM的方法不同,AntLM能够动态地调整训练过程,从而更好地利用两种范式的优势。这种交替训练的策略可以应用于不同的Transformer模型架构,具有较强的通用性。

关键设计:AntLM的关键设计在于交替训练的频率和方式。论文中提到在训练过程中交替应用CLM或MLM训练目标以及因果或双向注意力掩码,但具体交替的频率(例如,每多少个batch切换一次)以及如何决定使用CLM还是MLM(例如,随机选择还是基于某种策略)等细节,论文中没有明确说明。损失函数方面,CLM和MLM分别使用各自的标准损失函数(例如,交叉熵损失)。

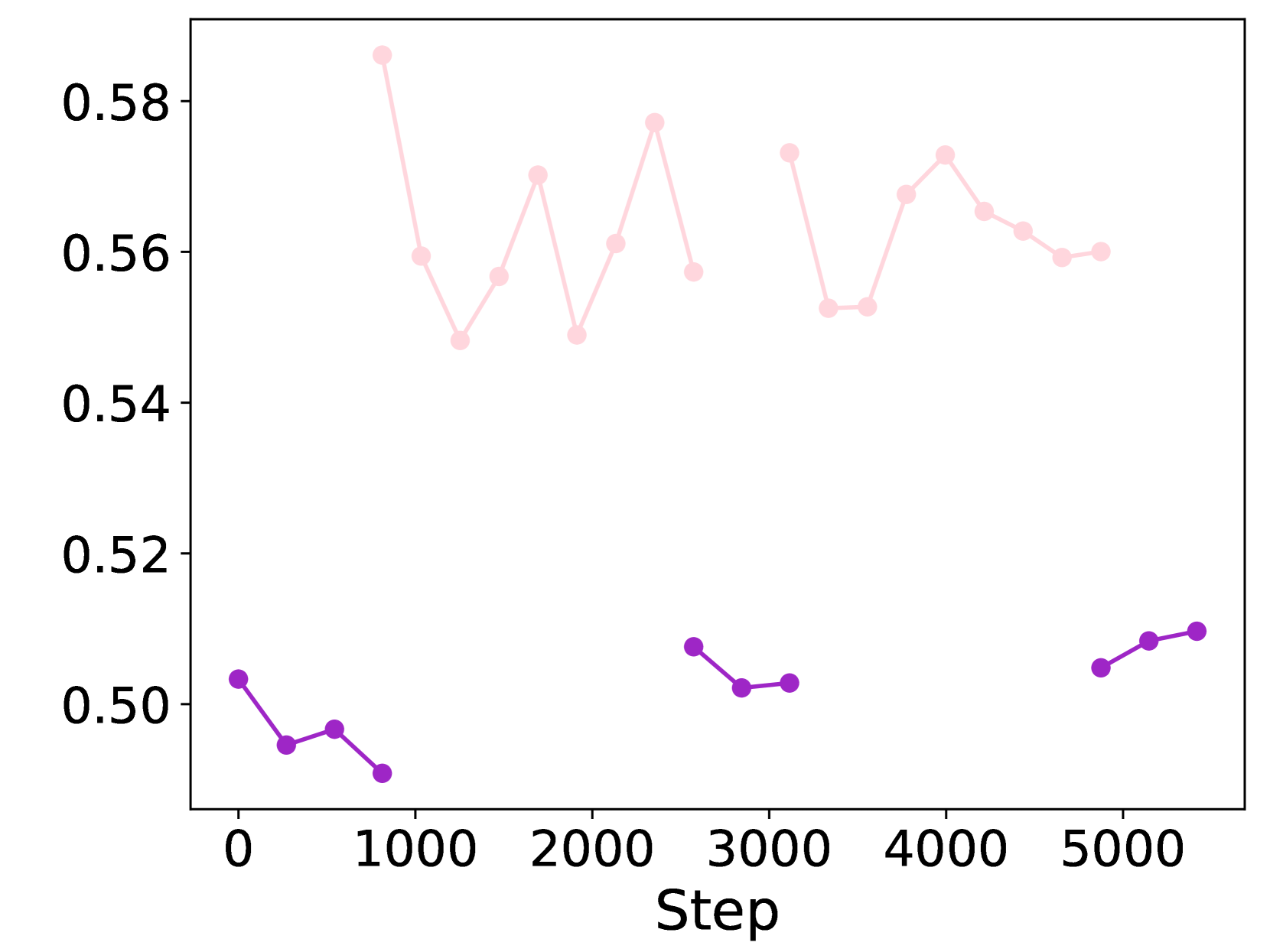

🖼️ 关键图片

📊 实验亮点

实验结果表明,AntLM在BabyLlama和LTG-BERT两个基础模型上均取得了显著的性能提升。在相同的训练epoch下,$AntLM_{BabyLlama}$的Macro-average提高了1%,$AntLM_{LTG-BERT}$的Macro-average比基线提高了2.2%。这些结果表明,AntLM能够有效地结合CLM和MLM的优势,提升整体训练性能。

🎯 应用场景

AntLM具有广泛的应用前景,可用于提升各种基于Transformer的语言模型的预训练效果,尤其是在计算资源受限的情况下,可以加速模型收敛并提高性能。该方法适用于各种自然语言处理任务,如文本生成、文本分类、机器翻译等。未来,AntLM可以进一步扩展到多模态学习领域,融合视觉、语音等信息,提升多模态模型的性能。

📄 摘要(原文)

Causal Language Modeling (CLM) and Masked Language Modeling (MLM) are two mainstream learning paradigms based on Transformer networks, specifically the Decoder-only and Encoder-only architectures. The strengths of each paradigm in downstream tasks have shown a mix of advantages and disadvantages. In the past BabyLM Challenge 2023, although the MLM paradigm achieved the best average performance, the CLM paradigm demonstrated significantly faster convergence rates. For the BabyLM Challenge 2024, we propose a novel language modeling paradigm named $\textbf{AntLM}$, which integrates both CLM and MLM to leverage the advantages of these two classic paradigms. We chose the strict-small track and conducted experiments on two foundation models: BabyLlama, representing CLM, and LTG-BERT, representing MLM. During the training process for specific foundation models, we alternate between applying CLM or MLM training objectives and causal or bidirectional attention masks. Experimental results show that combining the two pretraining objectives leverages their strengths, enhancing overall training performance. Under the same epochs, $AntLM_{BabyLlama}$ improves Macro-average by 1%, and $AntLM_{LTG-BERT}$ achieves a 2.2% increase over the baselines.