Time-Reversal Provides Unsupervised Feedback to LLMs

作者: Yerram Varun, Rahul Madhavan, Sravanti Addepalli, Arun Suggala, Karthikeyan Shanmugam, Prateek Jain

分类: cs.CL, cs.AI

发布日期: 2024-12-03 (更新: 2025-02-02)

备注: Accepted as a spotlight in NeurIPS 2024

期刊: The Thirty-Eighth Annual Conference on Neural Information Processing Systems (NeurIPS), 2024

💡 一句话要点

提出时间反转语言模型以增强LLM的无监督反馈能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间反转模型 无监督学习 自我反馈 自然语言处理 生成模型

📋 核心要点

- 现有的LLMs主要依赖正向预测,缺乏有效的自我反馈机制,导致生成质量受限。

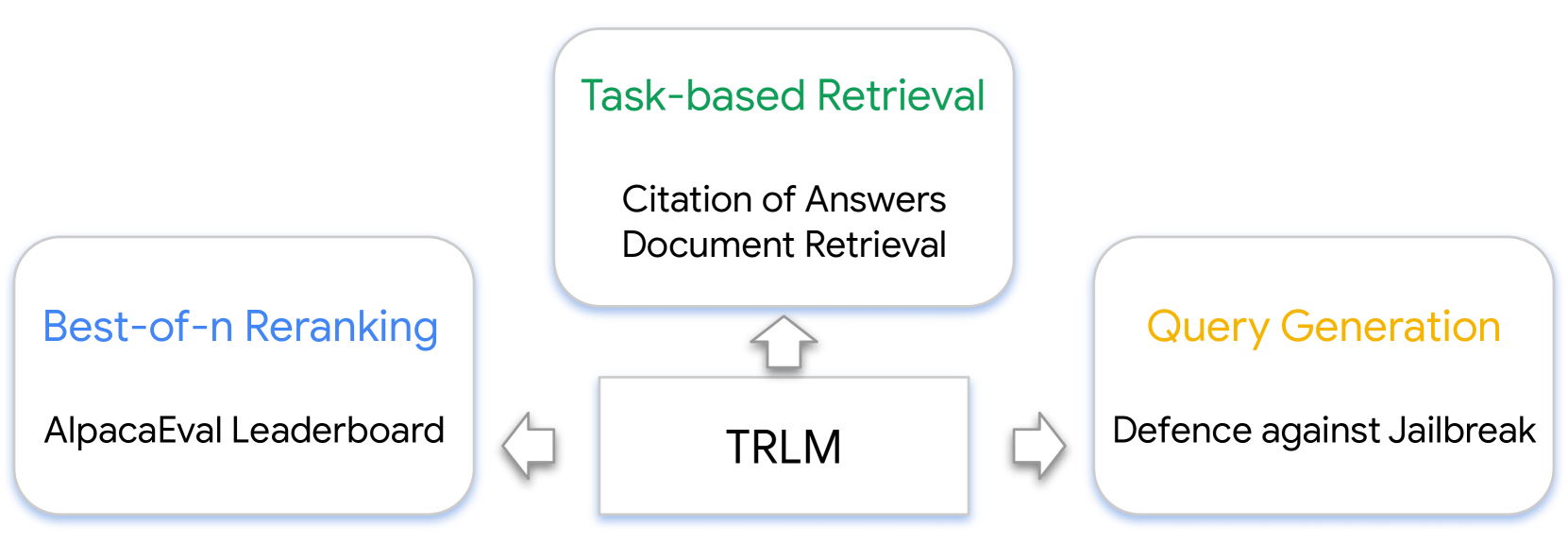

- 论文提出时间反转语言模型(TRLMs),使模型能够在反向时间中评分和生成查询,从而提供无监督反馈。

- 实验结果显示,TRLM在AlpacaEval排行榜上相较于最佳基线提升了5%,并在引用生成和段落检索中表现优越。

📝 摘要(中文)

大型语言模型(LLMs)通常在时间的正向方向上进行训练。然而,最近的研究表明,促使这些模型回顾并批评自己的生成内容可以产生有用的反馈。基于此,我们探讨了LLMs是否能够反向思考(预测和评分),以提供补充正向LLMs的无监督反馈。为此,我们引入了时间反转语言模型(TRLMs),它们可以在响应条件下评分和生成查询,有效地在时间的反向方向上运作。我们通过实证(以及在特定设置下的理论分析)表明,时间反转模型确实可以在对多个正向生成进行重新排序时补充正向模型的预测。我们在广泛使用的AlpacaEval排行榜上获得了最高5%的提升,并展示了TRLM评分在引用生成和段落检索等应用中的显著优势。

🔬 方法详解

问题定义:本论文旨在解决现有大型语言模型在生成内容时缺乏有效自我反馈的问题。现有方法主要依赖正向预测,难以充分利用模型的生成能力进行自我评估。

核心思路:论文提出的时间反转语言模型(TRLMs)通过反向思考(即在生成后进行评分)来增强LLMs的反馈能力,旨在提供更全面的生成质量评估。

技术框架:TRLM的整体架构包括预训练和微调阶段,模型在反向标记顺序下进行训练,确保其能够有效地处理反向生成任务。主要模块包括查询生成、响应评分和反馈机制。

关键创新:TRLMs的核心创新在于其反向评分机制,这与传统的正向评分方法本质上不同,能够更好地捕捉生成内容的质量和一致性。

关键设计:在模型设计中,采用了反向标记顺序的训练策略,并使用自我对数困惑度作为损失函数,确保模型在评分时能够有效评估生成内容的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TRLM在AlpacaEval排行榜上相较于最佳基线提升了5%,并在引用生成和段落检索中表现出显著的优势,尤其是在降低假阴性率方面,几乎不影响假阳性率。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理中的内容生成、信息检索和安全过滤等。通过增强LLMs的自我反馈能力,可以显著提高生成内容的质量和安全性,未来可能在多个行业中发挥重要作用。

📄 摘要(原文)

Large Language Models (LLMs) are typically trained to predict in the forward direction of time. However, recent works have shown that prompting these models to look back and critique their own generations can produce useful feedback. Motivated by this, we explore the question of whether LLMs can be empowered to think (predict and score) backwards to provide unsupervised feedback that complements forward LLMs. Towards this, we introduce Time Reversed Language Models (TRLMs), which can score and generate queries when conditioned on responses, effectively functioning in the reverse direction of time. Further, to effectively infer in the response to query direction, we pre-train and fine-tune a language model (TRLM-Ba) in the reverse token order from scratch. We show empirically (and theoretically in a stylized setting) that time-reversed models can indeed complement forward model predictions when used to score the query given response for re-ranking multiple forward generations. We obtain up to 5\% improvement on the widely used AlpacaEval Leaderboard over the competent baseline of best-of-N re-ranking using self log-perplexity scores. We further show that TRLM scoring outperforms conventional forward scoring of response given query, resulting in significant gains in applications such as citation generation and passage retrieval. We next leverage the generative ability of TRLM to augment or provide unsupervised feedback to input safety filters of LLMs, demonstrating a drastic reduction in false negative rate with negligible impact on false positive rates against several attacks published on the popular JailbreakBench leaderboard.