Patent-CR: A Dataset for Patent Claim Revision

作者: Lekang Jiang, Pascal A Scherz, Stephan Goetz

分类: cs.CL

发布日期: 2024-12-03 (更新: 2025-05-25)

备注: Accepted to NAACL 2025. 15 pages, 6 tables, 3 figures

期刊: Proceedings of the 2025 Conference of the Nations of the Americas Chapter of the Association for Computational Linguistics: Human Language Technologies (Volume 1: Long Papers), pages 2300-2314

💡 一句话要点

构建专利权利要求修改数据集Patent-CR,用于评估和提升LLM在专利领域的文本修订能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 专利权利要求修改 大型语言模型 数据集构建 文本修订 领域特定模型

📋 核心要点

- 现有文本修订任务主要关注语法和流畅性,忽略了专利权利要求修订中对法律标准和技术细节的严格要求。

- Patent-CR数据集通过对比驳回和授权的专利版本,为LLM提供学习专利权利要求修改规则和策略的语料。

- 实验表明,通用LLM在专利修订任务中表现不佳,领域特定模型和微调方法展现潜力,GPT-4表现最佳但仍需改进。

📝 摘要(中文)

本文提出了首个用于英文专利权利要求修改任务的数据集Patent-CR。该数据集包含被专利审查员驳回的初始专利申请版本以及最终授权版本。与侧重于提升句子质量(如语法纠正和连贯性改进)的普通文本修订任务不同,专利权利要求修改旨在确保权利要求满足严格的法律标准,这些标准不仅包括新颖性和创造性,还包括范围的清晰性、技术准确性、语言精确性和法律稳健性。我们通过专业的人工评估来评估各种大型语言模型(LLM),包括不同规模和架构的通用LLM、文本修订模型和领域特定模型。结果表明,LLM的编辑常常无效,偏离了目标修订。此外,领域特定模型和微调方法显示出有希望的结果。值得注意的是,GPT-4优于其他测试的LLM,但仍需进一步修改才能达到审查标准。此外,我们证明了自动评估和人工评估结果之间的不一致性,表明基于GPT-4的自动评估与人工判断的相关性最高。该数据集以及我们的初步实证研究为进一步探索专利权利要求修改提供了宝贵的见解。

🔬 方法详解

问题定义:论文旨在解决专利权利要求修改的自动化问题。现有方法,特别是通用大型语言模型(LLM),在处理专利文本时,无法满足专利领域对法律标准、技术准确性和语言精确性的严格要求。现有文本修订任务主要关注语法和流畅性,忽略了专利权利要求修改的特殊性。

核心思路:论文的核心思路是构建一个高质量的专利权利要求修改数据集Patent-CR,并利用该数据集评估和提升LLM在专利领域的文本修订能力。通过对比被驳回和授权的专利版本,使LLM能够学习专利权利要求修改的规则和策略。

技术框架:该研究主要分为两个阶段。第一阶段是构建Patent-CR数据集,该数据集包含被专利审查员驳回的初始专利申请版本以及最终授权版本。第二阶段是利用Patent-CR数据集评估各种LLM在专利权利要求修改任务中的表现,包括通用LLM、文本修订模型和领域特定模型。评估方法包括人工评估和自动评估,并分析了两种评估方法之间的相关性。

关键创新:该论文的关键创新在于构建了首个用于英文专利权利要求修改任务的数据集Patent-CR。该数据集的构建为研究人员提供了一个标准化的平台,用于评估和比较不同的LLM在专利领域的文本修订能力。此外,该研究还揭示了通用LLM在专利修订任务中的局限性,并指出了领域特定模型和微调方法的潜在优势。

关键设计:Patent-CR数据集包含初始驳回的专利申请和最终授权版本,形成修订对。实验评估了不同规模和架构的通用LLM,以及专门的文本修订模型和领域特定模型。评估指标包括人工评估(由专业人士进行)和基于GPT-4的自动评估。研究还分析了不同评估方法之间的相关性,以确定更可靠的评估指标。

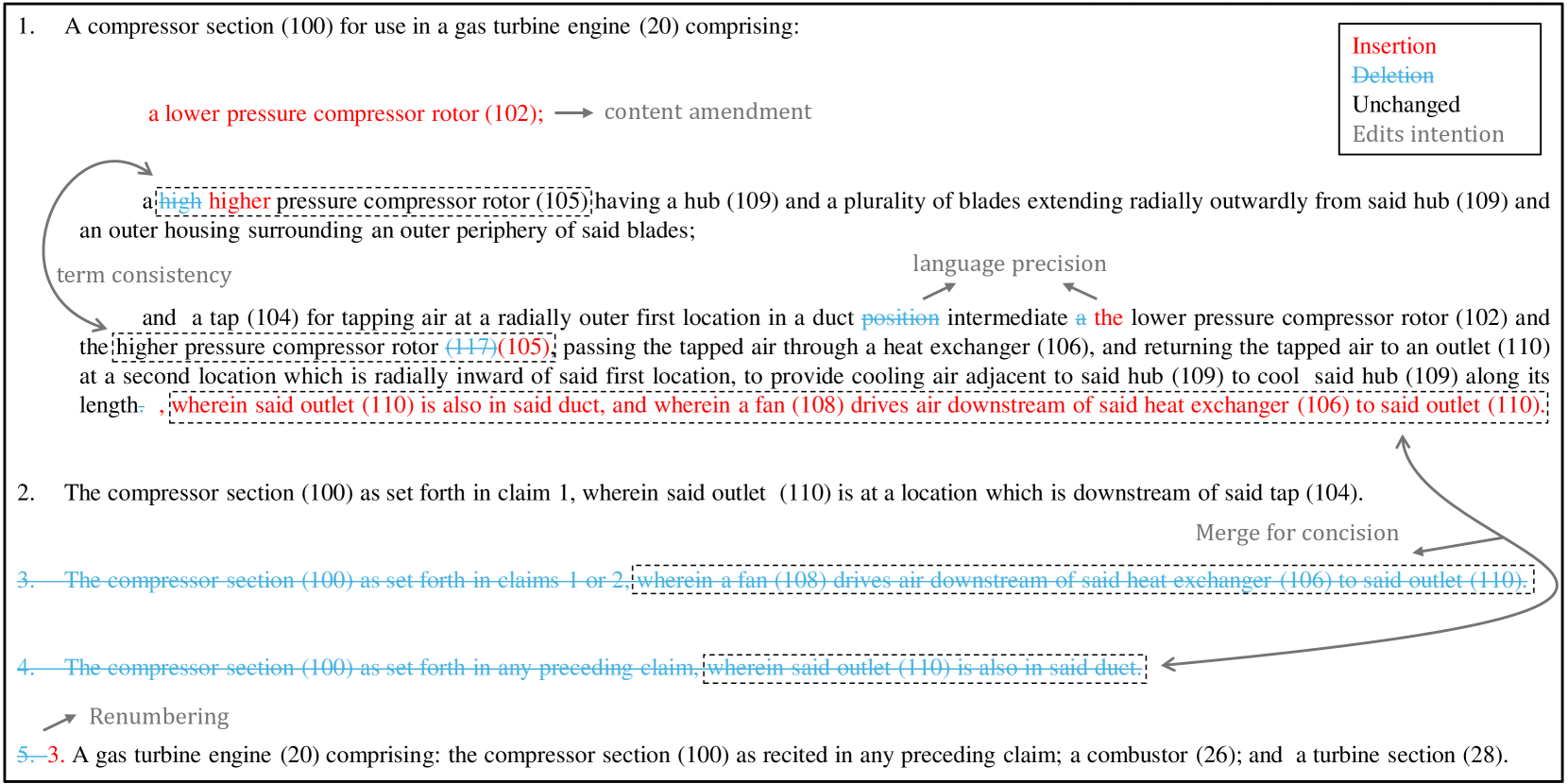

🖼️ 关键图片

📊 实验亮点

实验结果表明,通用LLM在专利权利要求修改任务中表现不佳,表明需要针对专利领域进行专门的训练和优化。领域特定模型和微调方法展现出一定的潜力。GPT-4在所有测试的LLM中表现最佳,但仍需要进一步的修改才能达到审查标准。基于GPT-4的自动评估与人工判断的相关性最高,表明其在专利领域具有一定的应用前景。

🎯 应用场景

该研究成果可应用于专利撰写辅助工具的开发,帮助专利工程师和律师更高效地撰写高质量的专利权利要求,提高专利申请的成功率。此外,该数据集和评估方法可用于训练和优化专门的专利领域LLM,提升其在专利文本处理方面的能力,例如专利检索、专利分析和侵权判定。

📄 摘要(原文)

This paper presents Patent-CR, the first dataset created for the patent claim revision task in English. It includes both initial patent applications rejected by patent examiners and the final granted versions. Unlike normal text revision tasks that predominantly focus on enhancing sentence quality, such as grammar correction and coherence improvement, patent claim revision aims at ensuring the claims meet stringent legal criteria. These criteria are beyond novelty and inventiveness, including clarity of scope, technical accuracy, language precision, and legal robustness. We assess various large language models (LLMs) through professional human evaluation, including general LLMs with different sizes and architectures, text revision models, and domain-specific models. Our results indicate that LLMs often bring ineffective edits that deviate from the target revisions. In addition, domain-specific models and the method of fine-tuning show promising results. Notably, GPT-4 outperforms other tested LLMs, but further revisions are still necessary to reach the examination standard. Furthermore, we demonstrate the inconsistency between automated and human evaluation results, suggesting that GPT-4-based automated evaluation has the highest correlation with human judgment. This dataset, along with our preliminary empirical research, offers invaluable insights for further exploration in patent claim revision.