A Comprehensive Evaluation of Large Language Models on Aspect-Based Sentiment Analysis

作者: Changzhi Zhou, Dandan Song, Yuhang Tian, Zhijing Wu, Hao Wang, Xinyu Zhang, Jun Yang, Ziyi Yang, Shuhao Zhang

分类: cs.CL, cs.AI

发布日期: 2024-12-03

💡 一句话要点

针对ABSA任务,论文全面评估了大语言模型在不同范式下的性能表现。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感分析 方面级情感分析 大型语言模型 上下文学习 参数高效微调

📋 核心要点

- 现有ABSA任务对LLM的探索不足,仅使用随机样本进行ICL,评估不全面。

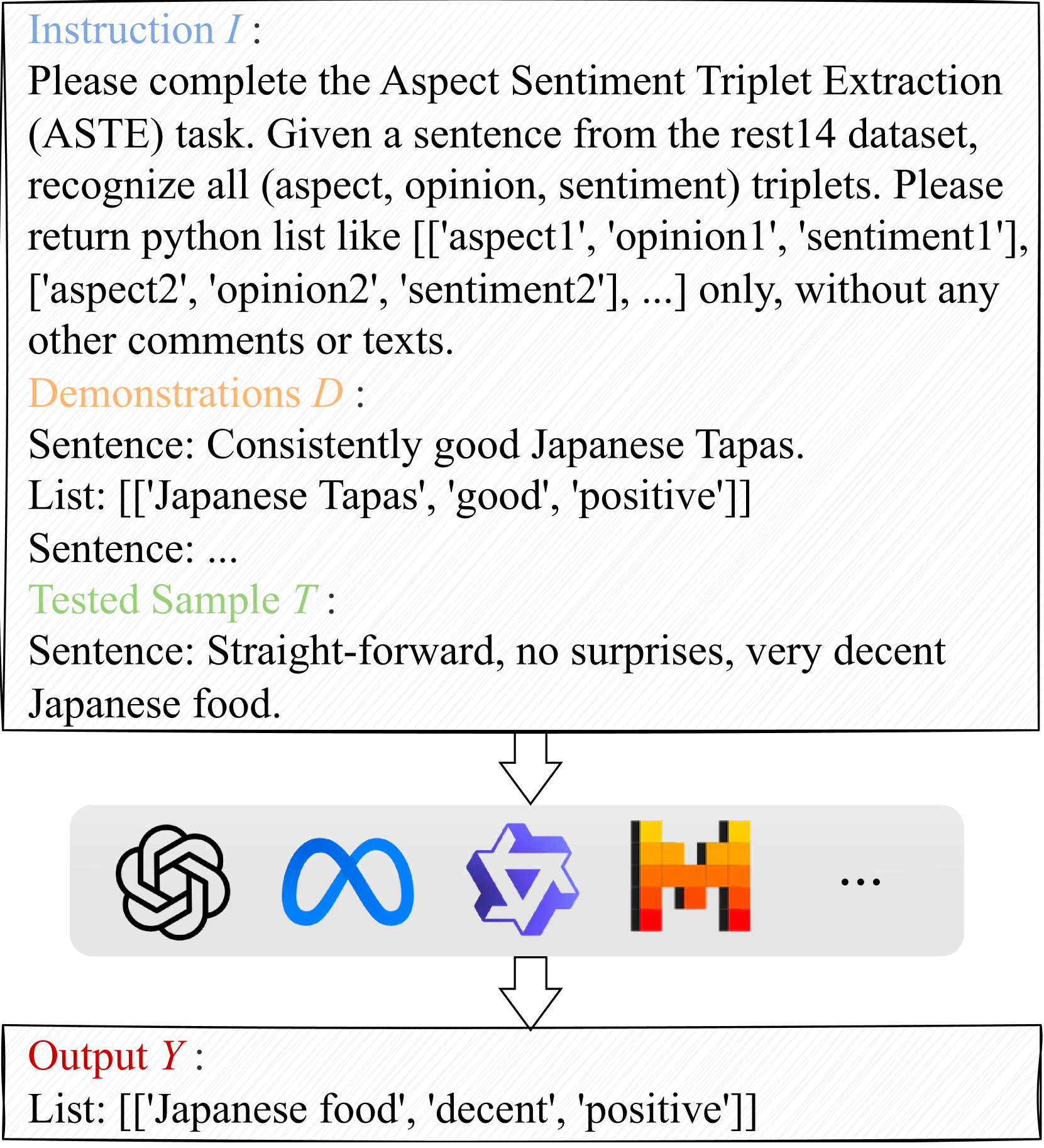

- 论文提出统一的任务公式,涵盖多种LLM、ABSA子任务和学习范式,并设计演示选择策略。

- 实验表明,LLM在微调和非微调范式下均表现出色,甚至在非微调场景下可与微调的SLM竞争。

📝 摘要(中文)

近年来,大型语言模型(LLMs)在自然语言处理领域备受关注,其强大的推理和生成能力彻底改变了众多下游任务。例如,上下文学习(ICL)引入了一种无需微调的范式,允许开箱即用的LLMs通过类比学习执行下游任务,而无需任何微调。此外,在存在大量训练数据的依赖于微调的范式中,参数高效微调(PEFT)作为一种经济高效的方法,使LLMs能够实现与完全微调相当的卓越性能。然而,LLMs所采用的这些引人入胜的技术尚未在ABSA领域得到充分利用。以往的研究仅仅使用随机选择的输入-输出对作为ICL中的演示来探索LLMs在ABSA中的应用,导致评估不完整和表面化。在本文中,我们对LLMs在ABSA领域进行了全面评估,涉及13个数据集、8个ABSA子任务和6个LLMs。具体来说,我们设计了一个统一的任务公式,以统一“多个LLMs用于多个范式中的多个ABSA子任务”。对于依赖于微调的范式,我们使用基于指令的多任务学习来高效地微调LLMs。对于无需微调的范式,我们提出了3种演示选择策略来激发LLMs的少样本能力。我们广泛的实验表明,在依赖于微调的范式中,与微调的小型语言模型(SLMs)相比,LLMs实现了新的最先进的性能。更重要的是,在SLMs无效的无需微调的范式中,具有ICL的LLMs仍然表现出令人印象深刻的潜力,甚至在某些ABSA子任务上与微调的SLMs竞争。

🔬 方法详解

问题定义:论文旨在解决现有ABSA研究中对大型语言模型(LLMs)评估不充分的问题。以往研究通常采用随机选择的输入-输出对作为上下文学习(ICL)的示例,导致评估结果具有局限性,无法全面反映LLMs在ABSA任务上的潜力。现有方法未能充分利用LLMs的推理和生成能力,也缺乏对不同学习范式(如微调和非微调)的系统性比较。

核心思路:论文的核心思路是对LLMs在ABSA任务上进行全面、系统的评估。通过设计统一的任务公式,将多个LLMs应用于多个ABSA子任务,并涵盖不同的学习范式(包括依赖微调和非微调)。针对非微调范式,提出了多种演示选择策略,以提升LLMs的少样本学习能力。通过对比LLMs与小型语言模型(SLMs)在不同范式下的性能,深入分析LLMs在ABSA任务中的优势和局限性。

技术框架:论文构建了一个统一的ABSA任务评估框架,主要包括以下几个模块: 1. 数据准备:收集并整理了13个ABSA数据集,涵盖8个不同的ABSA子任务。 2. 模型选择:选择了6个具有代表性的大型语言模型(LLMs)进行评估。 3. 任务公式化:设计了一个统一的任务公式,将不同的ABSA子任务转化为统一的文本生成或分类问题。 4. 学习范式:考虑了两种主要的学习范式:依赖微调的范式(使用参数高效微调PEFT)和非微调的范式(使用上下文学习ICL)。 5. 评估指标:采用标准的ABSA评估指标,如准确率、F1值等,对模型性能进行评估。

关键创新:论文的主要创新点在于: 1. 全面的ABSA评估:首次对LLMs在ABSA任务上进行了全面、系统的评估,涵盖了多个数据集、子任务和学习范式。 2. 统一的任务公式:设计了一个统一的任务公式,简化了不同ABSA子任务的处理流程,方便了LLMs的应用。 3. 演示选择策略:针对非微调范式,提出了多种演示选择策略,有效提升了LLMs的少样本学习能力。

关键设计:在依赖微调的范式中,采用了基于指令的多任务学习方法,将不同的ABSA子任务转化为指令跟随任务,并使用参数高效微调(PEFT)技术对LLMs进行微调。在非微调的范式中,设计了三种演示选择策略: 1. 随机选择:随机选择输入-输出对作为演示。 2. 相似度选择:选择与输入样本相似的样本作为演示。 3. 多样性选择:选择具有多样性的样本作为演示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在依赖微调的范式中,LLMs在ABSA任务上取得了新的state-of-the-art性能,显著优于微调的SLMs。更重要的是,在非微调的范式中,LLMs通过上下文学习(ICL)展现出强大的潜力,在某些ABSA子任务上甚至可以与微调的SLMs相媲美。这表明LLMs在缺乏训练数据的情况下,仍然可以通过少样本学习实现良好的性能。

🎯 应用场景

该研究成果可应用于情感分析、舆情监控、产品评论分析等领域。通过利用大型语言模型在ABSA任务上的强大能力,可以更准确地识别文本中不同方面的情感倾向,为企业决策、产品改进和用户体验优化提供有力支持。未来,该研究可以进一步扩展到其他自然语言处理任务,推动人工智能技术在更广泛领域的应用。

📄 摘要(原文)

Recently, Large Language Models (LLMs) have garnered increasing attention in the field of natural language processing, revolutionizing numerous downstream tasks with powerful reasoning and generation abilities. For example, In-Context Learning (ICL) introduces a fine-tuning-free paradigm, allowing out-of-the-box LLMs to execute downstream tasks by analogy learning without any fine-tuning. Besides, in a fine-tuning-dependent paradigm where substantial training data exists, Parameter-Efficient Fine-Tuning (PEFT), as the cost-effective methods, enable LLMs to achieve excellent performance comparable to full fine-tuning. However, these fascinating techniques employed by LLMs have not been fully exploited in the ABSA field. Previous works probe LLMs in ABSA by merely using randomly selected input-output pairs as demonstrations in ICL, resulting in an incomplete and superficial evaluation. In this paper, we shed light on a comprehensive evaluation of LLMs in the ABSA field, involving 13 datasets, 8 ABSA subtasks, and 6 LLMs. Specifically, we design a unified task formulation to unify ``multiple LLMs for multiple ABSA subtasks in multiple paradigms.'' For the fine-tuning-dependent paradigm, we efficiently fine-tune LLMs using instruction-based multi-task learning. For the fine-tuning-free paradigm, we propose 3 demonstration selection strategies to stimulate the few-shot abilities of LLMs. Our extensive experiments demonstrate that LLMs achieve a new state-of-the-art performance compared to fine-tuned Small Language Models (SLMs) in the fine-tuning-dependent paradigm. More importantly, in the fine-tuning-free paradigm where SLMs are ineffective, LLMs with ICL still showcase impressive potential and even compete with fine-tuned SLMs on some ABSA subtasks.