Yi-Lightning Technical Report

作者: Alan Wake, Bei Chen, C. X. Lv, Chao Li, Chengen Huang, Chenglin Cai, Chujie Zheng, Daniel Cooper, Fan Zhou, Feng Hu, Ge Zhang, Guoyin Wang, Heng Ji, Howard Qiu, Jiangcheng Zhu, Jun Tian, Katherine Su, Lihuan Zhang, Liying Li, Ming Song, Mou Li, Peng Liu, Qicheng Hu, Shawn Wang, Shijun Zhou, Shiming Yang, Shiyong Li, Tianhang Zhu, Wen Xie, Wenhao Huang, Xiang He, Xiaobo Chen, Xiaohui Hu, Xiaoyi Ren, Xinyao Niu, Yanpeng Li, Yongke Zhao, Yongzhen Luo, Yuchi Xu, Yuxuan Sha, Zhaodong Yan, Zhiyuan Liu, Zirui Zhang, Zonghong Dai

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-12-02 (更新: 2025-01-22)

💡 一句话要点

Yi-Lightning:基于增强型MoE架构的大语言模型,在中文、数学、编程等领域表现卓越。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 混合专家模型 MoE 强化学习 人类反馈 KV-caching 中文 安全AI

📋 核心要点

- 现有大语言模型在特定领域(如中文、数学、编程)的性能仍有提升空间,且训练和部署成本高昂。

- Yi-Lightning采用增强型MoE架构,优化专家分割和路由机制,并结合KV-caching技术,提升模型性能并降低成本。

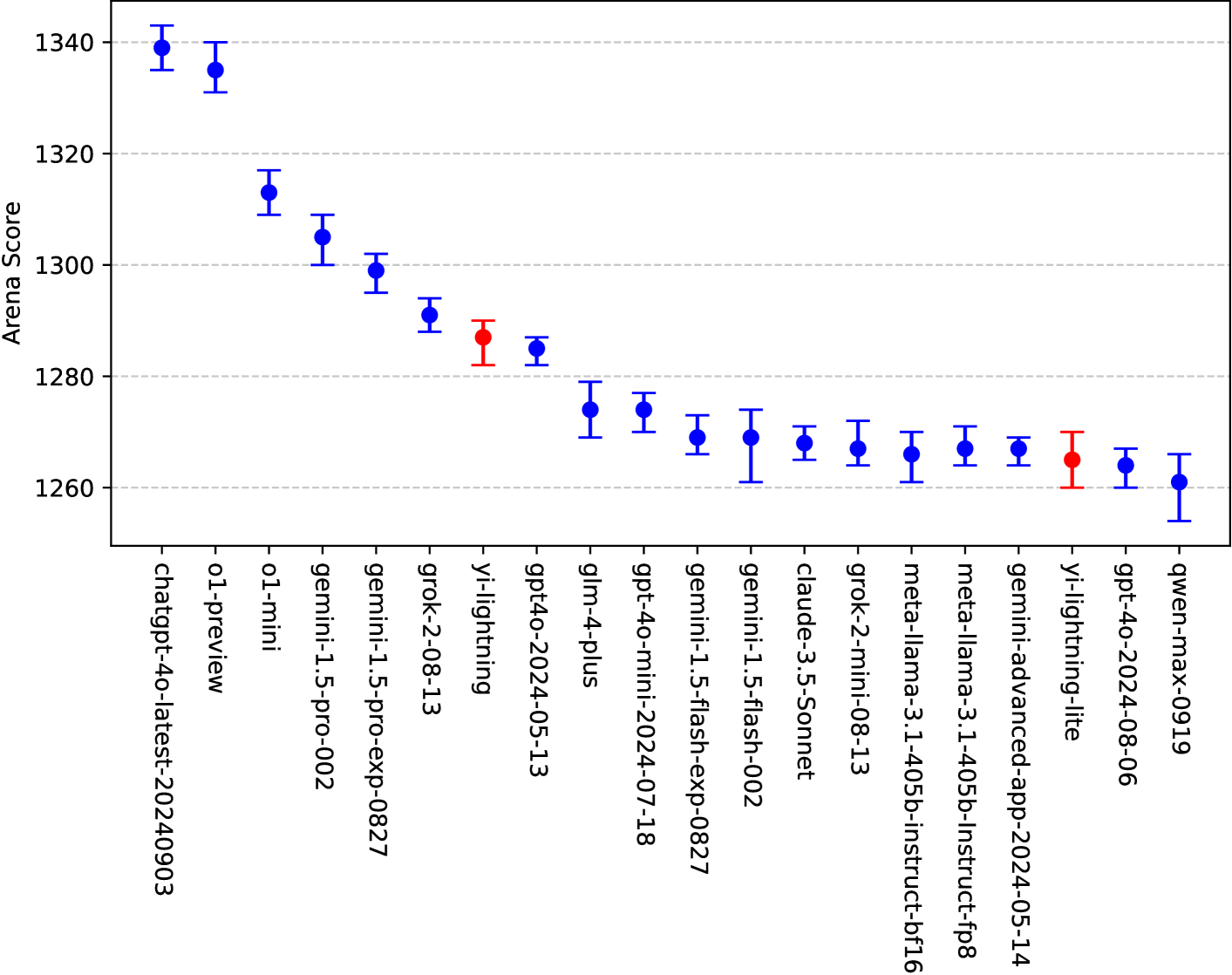

- 实验表明,Yi-Lightning在Chatbot Arena中排名第6,并在特定领域表现突出,同时降低了训练、部署和推理成本。

📝 摘要(中文)

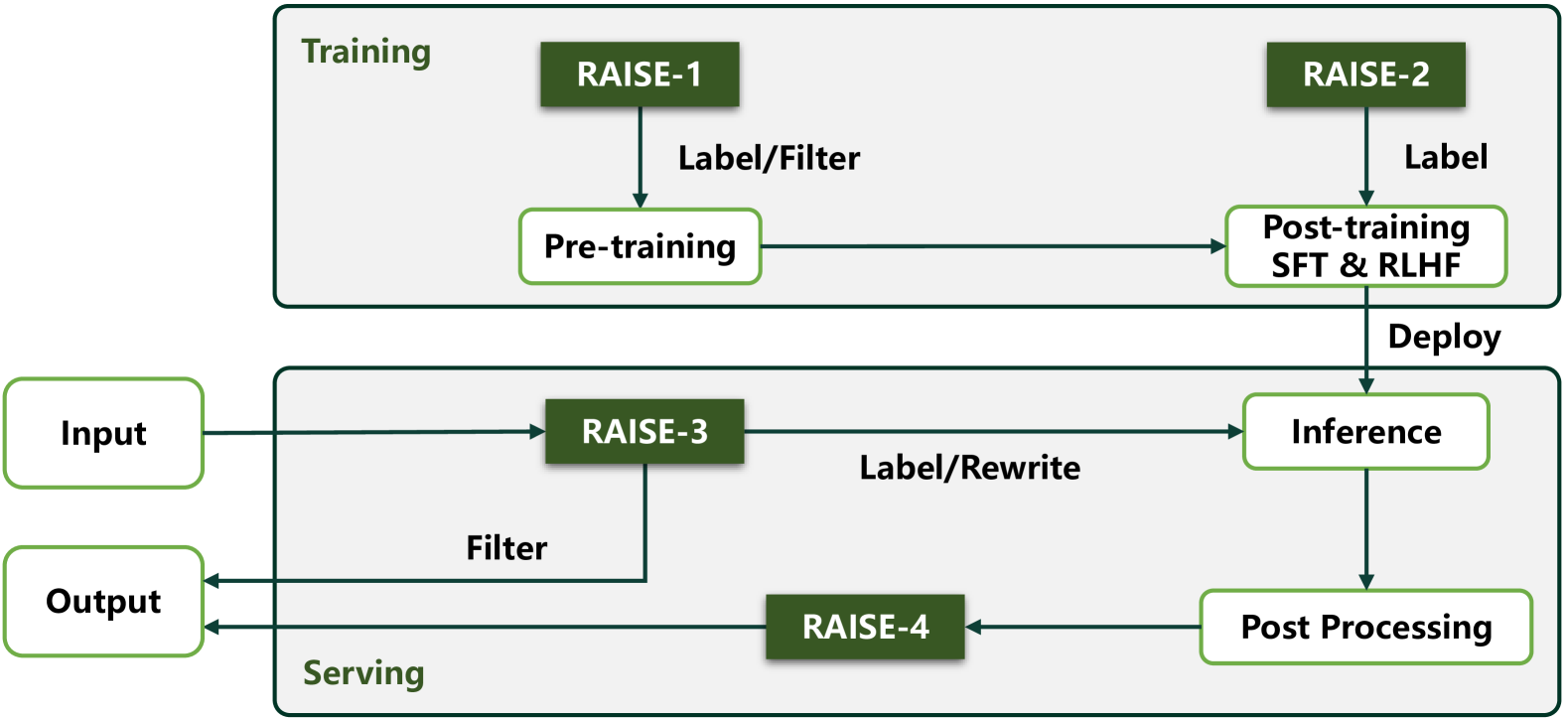

本技术报告介绍了我们最新的旗舰大语言模型Yi-Lightning。它取得了卓越的性能,在Chatbot Arena中总体排名第6,并在中文、数学、编程和Hard Prompts等专业类别中取得了特别优异的成绩(排名第2至第4)。Yi-Lightning利用增强的混合专家(MoE)架构,具有先进的专家分割和路由机制,并结合了优化的KV-caching技术。我们的开发过程包括全面的预训练、监督微调(SFT)和基于人类反馈的强化学习(RLHF),我们为多阶段训练、合成数据构建和奖励建模设计了周密的策略。此外,我们实施了RAISE(负责任的AI安全引擎),这是一个四组件框架,用于解决预训练、后训练和服务阶段的安全问题。在可扩展的超级计算基础设施的支持下,所有这些创新都大大降低了训练、部署和推理成本,同时保持了高性能标准。通过对公共学术基准的进一步评估,Yi-Lightning展示了与顶级LLM相比具有竞争力的性能,同时我们观察到传统静态基准结果与真实动态人类偏好之间存在显着差异。这一观察促使我们重新评估传统基准在指导开发更智能、更强大的AI系统以用于实际应用中的效用。Yi-Lightning现在可以通过我们的开发者平台https://platform.lingyiwanwu.com获得。

🔬 方法详解

问题定义:现有的大语言模型在特定领域,例如中文理解、数学推理、代码生成等方面,仍然存在性能瓶颈。同时,训练和部署这些大型模型需要巨大的计算资源,导致成本高昂。传统静态benchmark与真实人类偏好存在差异,难以有效指导模型优化。

核心思路:Yi-Lightning的核心思路是利用增强的混合专家(MoE)架构,通过更有效的专家分割和路由机制,使模型能够更好地利用参数,从而在特定领域获得更高的性能。同时,通过优化的KV-caching技术,降低推理过程中的计算成本。此外,通过多阶段训练和负责任的AI安全引擎(RAISE),提升模型的安全性和可靠性。

技术框架:Yi-Lightning的整体框架包括预训练、监督微调(SFT)和基于人类反馈的强化学习(RLHF)三个主要阶段。在预训练阶段,模型学习通用的语言知识。在SFT阶段,模型通过有监督的数据进行微调,以提升特定任务的性能。在RLHF阶段,模型通过人类反馈进行强化学习,以更好地对齐人类偏好。此外,RAISE贯穿整个流程,保障模型的安全性。

关键创新:Yi-Lightning的关键创新在于增强的MoE架构,包括先进的专家分割和路由机制。传统的MoE模型可能存在专家利用不均衡的问题,导致部分专家未被充分训练。Yi-Lightning通过更智能的路由机制,确保每个专家都能得到充分的训练,从而提升整体性能。此外,优化的KV-caching技术也是一个重要的创新点,它可以显著降低推理过程中的内存占用和计算成本。

关键设计:报告中没有详细说明关键参数设置、损失函数、网络结构等技术细节。但提及了多阶段训练策略、合成数据构建方法和奖励模型设计,这些都是影响模型性能的关键因素。RAISE安全引擎包含四个组件,具体细节未知。

🖼️ 关键图片

📊 实验亮点

Yi-Lightning在Chatbot Arena中总体排名第6,并在中文、数学、编程和Hard Prompts等专业类别中取得了第2至第4名的好成绩。该模型通过增强的MoE架构和优化的KV-caching技术,显著降低了训练、部署和推理成本,同时保持了高性能标准。论文还强调了传统benchmark与人类偏好之间的差异,提示需要重新评估benchmark的有效性。

🎯 应用场景

Yi-Lightning可广泛应用于智能客服、教育辅导、代码生成、内容创作等领域。其在中文、数学、编程等领域的卓越性能使其能够更好地服务于中文用户,并解决特定领域的实际问题。通过降低训练和部署成本,Yi-Lightning有望加速大语言模型在各行业的普及应用。

📄 摘要(原文)

This technical report presents Yi-Lightning, our latest flagship large language model (LLM). It achieves exceptional performance, ranking 6th overall on Chatbot Arena, with particularly strong results (2nd to 4th place) in specialized categories including Chinese, Math, Coding, and Hard Prompts. Yi-Lightning leverages an enhanced Mixture-of-Experts (MoE) architecture, featuring advanced expert segmentation and routing mechanisms coupled with optimized KV-caching techniques. Our development process encompasses comprehensive pre-training, supervised fine-tuning (SFT), and reinforcement learning from human feedback (RLHF), where we devise deliberate strategies for multi-stage training, synthetic data construction, and reward modeling. Furthermore, we implement RAISE (Responsible AI Safety Engine), a four-component framework to address safety issues across pre-training, post-training, and serving phases. Empowered by our scalable super-computing infrastructure, all these innovations substantially reduce training, deployment and inference costs while maintaining high-performance standards. With further evaluations on public academic benchmarks, Yi-Lightning demonstrates competitive performance against top-tier LLMs, while we observe a notable disparity between traditional, static benchmark results and real-world, dynamic human preferences. This observation prompts a critical reassessment of conventional benchmarks' utility in guiding the development of more intelligent and powerful AI systems for practical applications. Yi-Lightning is now available through our developer platform at https://platform.lingyiwanwu.com.