Enhancing Function-Calling Capabilities in LLMs: Strategies for Prompt Formats, Data Integration, and Multilingual Translation

作者: Yi-Chang Chen, Po-Chun Hsu, Chan-Jan Hsu, Da-shan Shiu

分类: cs.CL

发布日期: 2024-12-02 (更新: 2024-12-04)

💡 一句话要点

通过优化Prompt、数据集成和多语言翻译增强LLM的函数调用能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 函数调用 Prompt工程 多语言翻译 指令遵循 决策Token 零样本学习

📋 核心要点

- 现有LLM在函数调用中面临准确性和相关性挑战,尤其是在处理多语言任务时。

- 论文提出通过优化prompt格式、集成数据和引入决策Token来增强LLM的函数调用能力。

- 实验表明,该方法在提高函数调用准确性、相关性检测以及多语言翻译方面取得了显著进展。

📝 摘要(中文)

大型语言模型(LLMs)显著推动了自主代理的发展,尤其是在零样本工具使用(也称为函数调用)方面。本研究深入探讨了通过不同方法增强LLM的函数调用能力,包括集成函数描述的prompt格式、混合函数调用和指令遵循数据、引入用于条件prompt的新型决策Token、利用思维链推理以及通过翻译pipeline克服多语言挑战。我们的主要发现和贡献如下:(1)指令遵循数据提高了函数调用准确性和相关性检测。(2)使用新提出的决策Token,结合合成的非函数调用数据,增强了相关性检测。(3)定制的翻译pipeline有效地克服了多语言限制,在繁体中文方面表现出显著改进。这些见解突出了LLM在改进函数调用能力和多语言应用方面的潜力。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在函数调用任务中的准确性和相关性问题,尤其是在处理多语言环境时。现有的LLM在零样本函数调用中表现出一定的局限性,例如难以准确判断何时应该调用函数,以及在不同语言环境下函数调用效果不佳。

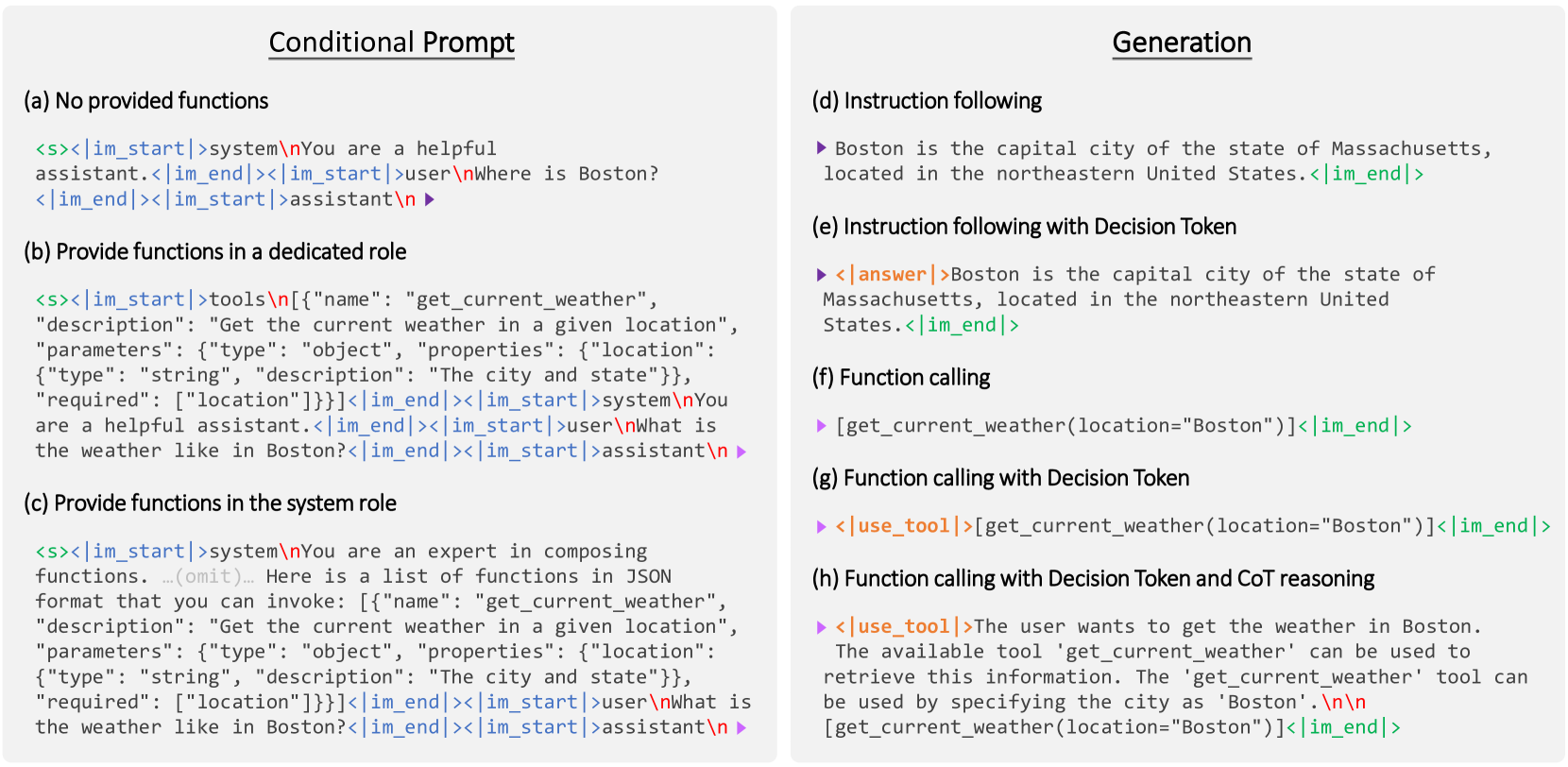

核心思路:论文的核心思路是通过优化prompt格式、集成函数调用和指令遵循数据、引入决策Token以及构建翻译pipeline来提升LLM的函数调用能力。通过更清晰的prompt指导模型,利用指令遵循数据增强模型的理解能力,使用决策Token显式控制函数调用,并通过翻译pipeline解决多语言问题。

技术框架:整体框架包括以下几个主要模块:1) Prompt格式优化模块,设计不同的prompt格式以更好地集成函数描述。2) 数据集成模块,混合函数调用和指令遵循数据以提高模型的泛化能力。3) 决策Token模块,引入新型决策Token用于条件prompt,增强相关性检测。4) 多语言翻译模块,构建定制的翻译pipeline以克服多语言限制。

关键创新:论文的关键创新点在于:1) 提出了决策Token的概念,用于显式地控制LLM是否进行函数调用,从而提高了相关性检测的准确性。2) 构建了一个定制的翻译pipeline,能够有效地将函数调用任务翻译成目标语言,从而解决了LLM在多语言环境下的函数调用问题。

关键设计:在prompt格式方面,论文尝试了不同的函数描述集成方式,例如将函数描述放在指令之前或之后。在数据集成方面,论文采用了合成数据的方法,生成了大量的非函数调用数据,用于训练模型的相关性检测能力。在翻译pipeline方面,论文针对函数调用任务的特点,选择了合适的翻译模型和翻译策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,指令遵循数据能够显著提高函数调用准确性和相关性检测能力。引入决策Token后,相关性检测能力得到进一步提升。定制的翻译pipeline在繁体中文上的函数调用性能取得了显著改进,验证了该方法在多语言环境下的有效性。具体性能数据未知。

🎯 应用场景

该研究成果可广泛应用于智能助手、自动化工作流程、多语言客户服务等领域。通过提升LLM的函数调用能力,可以实现更智能、更高效的任务自动化,并为不同语言的用户提供更好的服务。未来,该技术有望进一步应用于跨语言信息检索、机器翻译等领域。

📄 摘要(原文)

Large language models (LLMs) have significantly advanced autonomous agents, particularly in zero-shot tool usage, also known as function calling. This research delves into enhancing the function-calling capabilities of LLMs by exploring different approaches, including prompt formats for integrating function descriptions, blending function-calling and instruction-following data, introducing a novel Decision Token for conditional prompts, leveraging chain-of-thought reasoning, and overcoming multilingual challenges with a translation pipeline. Our key findings and contributions are as follows: (1) Instruction-following data improves both function-calling accuracy and relevance detection. (2) The use of the newly proposed Decision Token, combined with synthetic non-function-call data, enhances relevance detection. (3) A tailored translation pipeline effectively overcomes multilingual limitations, demonstrating significant improvements in Traditional Chinese. These insights highlight the potential for improved function-calling capabilities and multilingual applications in LLMs.