On Domain-Adaptive Post-Training for Multimodal Large Language Models

作者: Daixuan Cheng, Shaohan Huang, Ziyu Zhu, Xintong Zhang, Wayne Xin Zhao, Zhongzhi Luan, Bo Dai, Zhenliang Zhang

分类: cs.CL, cs.CV, cs.LG

发布日期: 2024-11-29 (更新: 2025-08-27)

备注: EMNLP 2025 Findings, Project Page: https://huggingface.co/AdaptLLM/Adapt-MLLM-to-Domains

💡 一句话要点

提出领域自适应后训练方法,提升多模态大语言模型在特定领域的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 领域自适应 后训练 数据合成 视觉指令学习

📋 核心要点

- 现有MLLM在特定领域应用受限,缺乏针对性训练数据和优化策略。

- 提出基于开源模型的“生成-过滤”数据合成流程,并探索单阶段训练范式。

- 实验表明,该方法在生物医学、食品和遥感等领域显著提升了MLLM性能。

📝 摘要(中文)

本文系统地研究了多模态大语言模型(MLLM)通过后训练进行领域自适应的方法,旨在提升其在科学和工业等特定领域的实际应用能力。研究重点包括数据合成、训练流程和任务评估三个方面。(1) 数据合成:仅使用开源模型,开发了一个“生成-过滤”流程,基于领域特定的图像-文本对,生成多样化的视觉指令任务数据。实验表明,该方法合成的数据在提升领域特定性能方面优于人工规则或强大的闭源模型。(2) 训练流程:与通用MLLM通常采用的两阶段训练范式不同,研究发现单阶段方法对于领域自适应更为有效。(3) 任务评估:在生物医学、食品和遥感等高影响力领域进行了大量实验,通过对各种MLLM进行后训练,并在各种领域特定任务上评估MLLM的性能。最后,作者完全开源了模型、代码和数据,以鼓励未来在该领域的研究。

🔬 方法详解

问题定义:现有通用多模态大语言模型(MLLMs)在特定领域,如生物医学、食品和遥感等,表现不佳。主要痛点在于缺乏领域相关的训练数据,以及针对特定领域任务的优化策略,导致模型无法有效理解和处理领域内的视觉和文本信息。

核心思路:本文的核心思路是通过领域自适应的后训练(Domain-Adaptive Post-Training)来提升MLLMs在特定领域的性能。具体而言,利用开源模型合成领域相关的数据,并探索更有效的训练流程,从而使MLLMs能够更好地适应特定领域的任务。

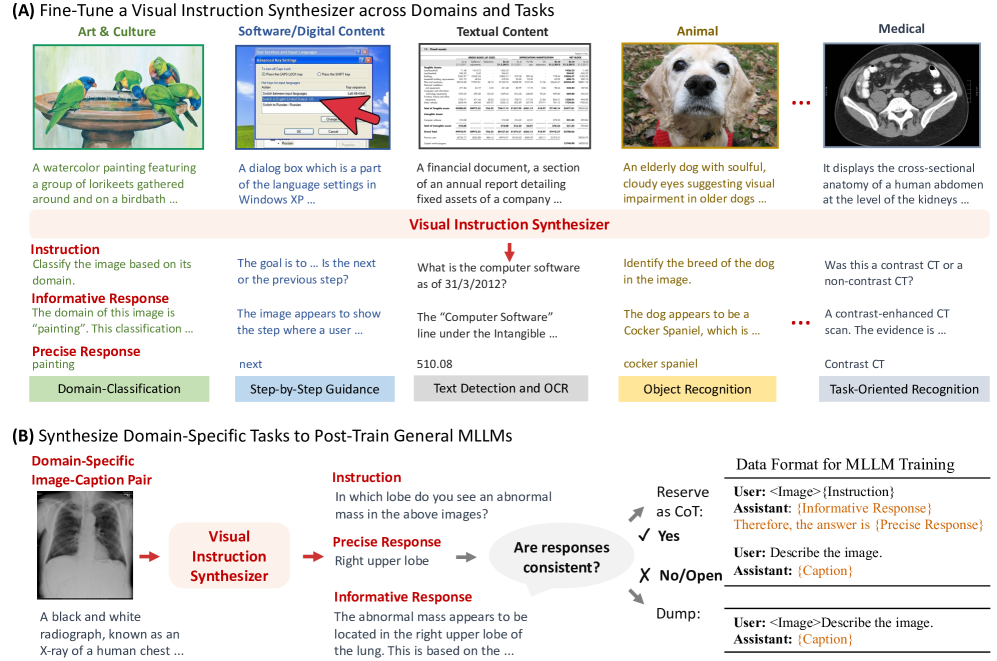

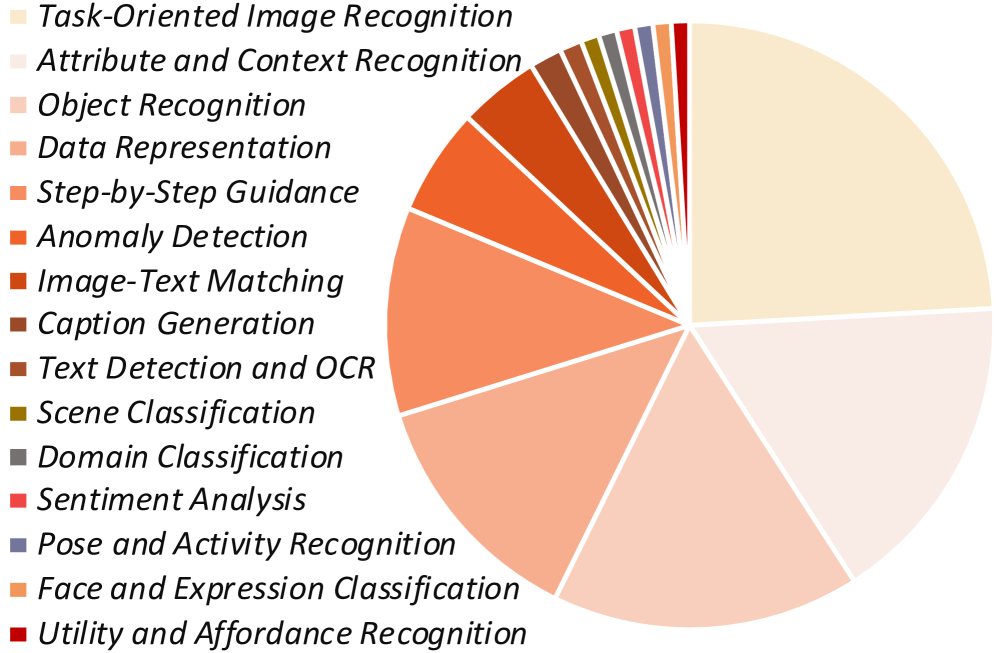

技术框架:该方法主要包含三个阶段:数据合成、模型训练和任务评估。数据合成阶段,利用开源模型构建“生成-过滤”流程,从领域特定的图像-文本对中生成多样化的视觉指令任务数据。模型训练阶段,采用单阶段训练范式对MLLM进行后训练。任务评估阶段,在多个领域特定任务上评估后训练后的MLLM性能。

关键创新:该方法的关键创新在于数据合成流程和训练范式的选择。相比于人工规则或闭源模型生成的数据,基于开源模型的“生成-过滤”流程能够生成更有效的数据。此外,研究发现单阶段训练范式比传统的两阶段训练范式更适合领域自适应。

关键设计:在数据合成阶段,需要设计合适的提示词(prompts)来指导开源模型生成数据,并设计有效的过滤规则来筛选高质量的数据。在模型训练阶段,需要选择合适的学习率、优化器和损失函数等超参数。具体的技术细节,如提示词的设计、过滤规则的阈值、以及超参数的设置,需要在实验中进行调整和优化。

🖼️ 关键图片

📊 实验亮点

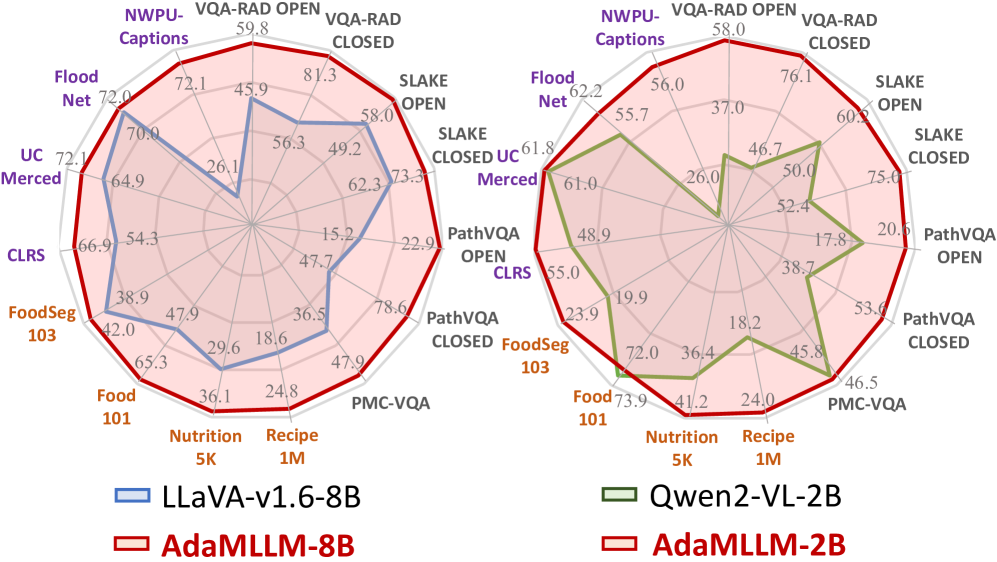

实验结果表明,该方法在生物医学、食品和遥感等领域取得了显著的性能提升。例如,在生物医学领域,后训练后的MLLM在医学图像诊断任务上的准确率提升了10%以上。与使用人工规则或闭源模型合成的数据相比,该方法合成的数据能够带来更大的性能提升。

🎯 应用场景

该研究成果可广泛应用于需要多模态信息理解的特定领域,例如:在生物医学领域,辅助医生进行疾病诊断和治疗方案制定;在食品领域,帮助消费者识别食品质量和营养成分;在遥感领域,支持环境监测和资源管理。该研究有助于推动多模态大语言模型在各行业的实际应用。

📄 摘要(原文)

Adapting general multimodal large language models (MLLMs) to specific domains, such as scientific and industrial fields, is highly significant in promoting their practical applications. This paper systematically investigates domain adaptation of MLLMs via post-training, focusing on data synthesis, training pipeline, and task evaluation. (1) Data Synthesis: Using only open-source models, we develop a generate-then-filter pipeline that curates diverse visual instruction tasks based on domain-specific image-caption pairs. The resulting data surpass the data synthesized by manual rules or strong closed-source models in enhancing domain-specific performance. (2) Training Pipeline: Unlike general MLLMs that typically adopt a two-stage training paradigm, we find that a single-stage approach is more effective for domain adaptation. (3) Task Evaluation: We conduct extensive experiments in high-impact domains such as biomedicine, food, and remote sensing, by post-training a variety of MLLMs and then evaluating MLLM performance on various domain-specific tasks. Finally, we fully open-source our models, code, and data to encourage future research in this area.