An Extensive Evaluation of Factual Consistency in Large Language Models for Data-to-Text Generation

作者: Joy Mahapatra, Utpal Garain

分类: cs.CL

发布日期: 2024-11-28

备注: 15 pages

💡 一句话要点

针对数据到文本生成,论文深入评估大型语言模型的事实一致性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数据到文本生成 事实一致性 自动评估 人工评估 模型评估 自然语言处理

📋 核心要点

- 大型语言模型在数据到文本生成任务中面临事实一致性的挑战,现有研究缺乏对此的深入评估。

- 该研究通过广泛的实验,评估了多个LLM家族在不同数据集上的事实一致性表现,并分析了影响因素。

- 实验结果表明,Llama 2通常表现最佳,模型大小的增加通常能提高事实一致性,源-参考差异会降低事实一致性。

📝 摘要(中文)

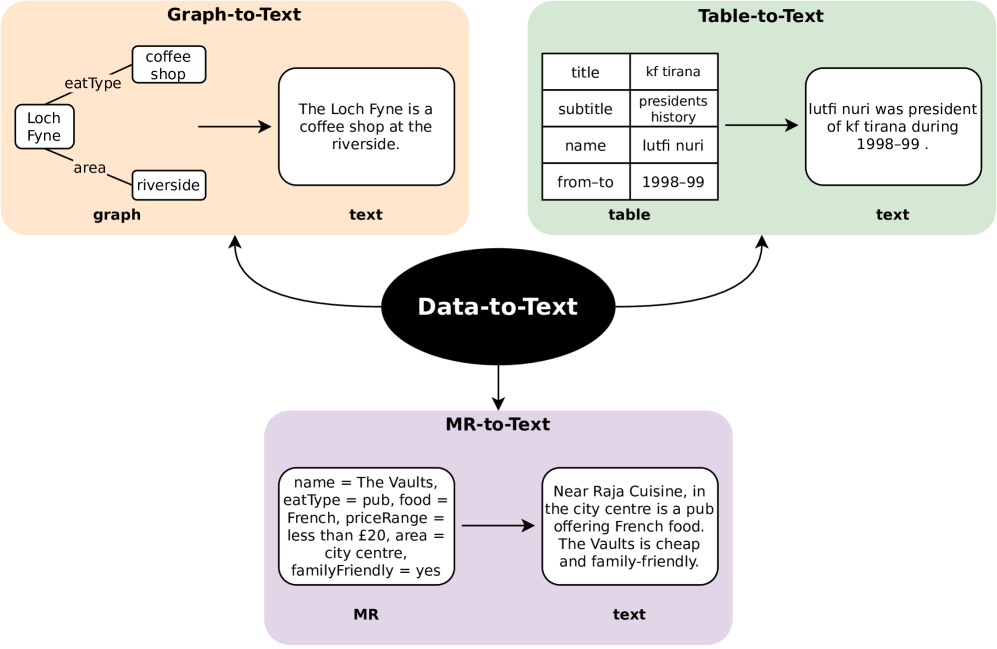

大型语言模型(LLMs)在各种数据到文本生成(DTG)任务中表现出卓越的性能。然而,在DTG中生成事实一致的文本对于LLM来说仍然具有挑战性。尽管如此,目前文献中仍然缺乏对LLM在DTG中事实一致性的深入评估。本文通过对LLM在DTG中的事实一致性进行广泛评估来解决这一差距。我们的评估涵盖了五个广泛使用的DTG数据集(E2E、ViGGo、WikiTableText、DART和WebNLG)和五个著名的LLM家族(T5、BART、OPT、BLOOM和Llama 2)。为了确保对事实一致性的全面评估,我们使用了四种最先进的自动指标,并包括必要的人工评估。我们广泛的评估揭示了关于LLM在DTG中事实一致性的三个关键发现。首先,Llama 2通常擅长生成事实一致的文本,尽管像T5和BART这样较小的模型可以在较大、词汇多样性较低的数据集上实现强大的事实一致性。其次,平均变化率(AROC)表明,增加模型大小(模型可训练参数的数量)通常会提高LLM在DTG中的事实一致性。第三,我们观察到,源-参考差异(即,当参考文本在语义上与源文本不同时)通常会降低LLM在DTG中的事实一致性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在数据到文本生成(DTG)任务中生成事实一致文本的难题。现有方法缺乏对LLM在DTG中事实一致性的全面评估,无法有效衡量和提升模型生成文本的可靠性。

核心思路:论文的核心思路是通过对多个LLM家族在不同DTG数据集上进行广泛的实验评估,深入分析影响事实一致性的因素,从而为提升LLM在DTG任务中的可靠性提供指导。这种方法旨在通过实证研究揭示LLM的优势和不足,并为未来的研究方向提供依据。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 选择五个广泛使用的DTG数据集(E2E、ViGGo、WikiTableText、DART和WebNLG);2) 选择五个著名的LLM家族(T5、BART、OPT、BLOOM和Llama 2);3) 使用四种最先进的自动指标和人工评估来衡量事实一致性;4) 分析实验结果,揭示影响事实一致性的关键因素,如模型大小和源-参考差异。

关键创新:该研究的关键创新在于其对LLM在DTG任务中事实一致性的全面和深入评估。与现有研究相比,该研究覆盖了更多的数据集和模型,并采用了多种评估指标,从而提供了更可靠和全面的结果。此外,该研究还揭示了模型大小和源-参考差异等影响事实一致性的关键因素,为未来的研究提供了新的视角。

关键设计:研究中使用了平均变化率(AROC)来衡量模型大小与事实一致性之间的关系。此外,研究还特别关注了源-参考差异对事实一致性的影响,并分析了不同数据集和模型在这一方面的表现。具体的技术细节,如自动评估指标的选择和人工评估的标准,在论文中应该有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Llama 2在生成事实一致的文本方面通常表现出色。研究还发现,增加模型大小(通过平均变化率AROC衡量)通常会提高LLM在DTG中的事实一致性。此外,源-参考差异的增加会降低LLM在DTG中的事实一致性。较小的模型如T5和BART在较大、词汇多样性较低的数据集上也能实现较强的事实一致性。

🎯 应用场景

该研究成果可应用于各种需要从数据生成文本的场景,例如自动报告生成、智能客服、内容创作等。提升LLM在DTG任务中的事实一致性,可以提高生成文本的可靠性和实用性,减少错误信息的传播,从而提升用户体验和决策质量。未来,该研究可以进一步扩展到其他语言和领域,并探索更有效的提升事实一致性的方法。

📄 摘要(原文)

Large Language Models (LLMs) have shown exceptional performance across various Data-to-Text Generation (DTG) tasks. However, generating factually consistent text in DTG remains challenging for LLMs. Despite this, in-depth evaluations of LLM factual consistency for DTG remain missing in the current literature. This paper addresses this gap by providing an extensive evaluation of factual consistency in LLMs for DTG. Our evaluation covers five widely used DTG datasets (E2E, ViGGo, WikiTableText, DART, and WebNLG) and five prominent LLM families (T5, BART, OPT, BLOOM, and Llama 2). To ensure a thorough evaluation of factual consistency, we use four state-of-the-art automatic metrics and include essential human assessments. Our extensive evaluations reveals three key findings regarding factual consistency in LLMs for DTG. First, Llama 2 often excels in generating factually consistent text, although smaller models like T5 and BART can achieve strong factual consistency on larger, lexically less-diverse datasets. Second, the average rate of change (AROC) indicates that increasing model size (number of model trainable parameters) generally enhances factual consistency of LLMs in DTG. Third, we observe that source-reference divergence (i.e., when the reference text diverges semantically from the source) typically reduces the factual consistency of LLMs in DTG.