Hidden Data Privacy Breaches in Federated Learning

作者: Xueluan Gong, Yuji Wang, Shuaike Li, Mengyuan Sun, Songze Li, Qian Wang, Kwok-Yan Lam, Chen Chen

分类: cs.CL, cs.CR

发布日期: 2024-11-27

💡 一句话要点

提出一种隐蔽的联邦学习数据重建攻击,可高效窃取高分辨率隐私数据。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 联邦学习 数据重建攻击 隐私泄露 恶意代码注入 参数共享

📋 核心要点

- 现有联邦学习攻击方法存在窃取数据量小、分辨率低,且易被梯度或权重异常检测发现等问题。

- 该论文提出一种基于恶意代码注入的数据重建攻击,通过参数共享隐蔽地嵌入隐藏模型,系统性提取敏感数据。

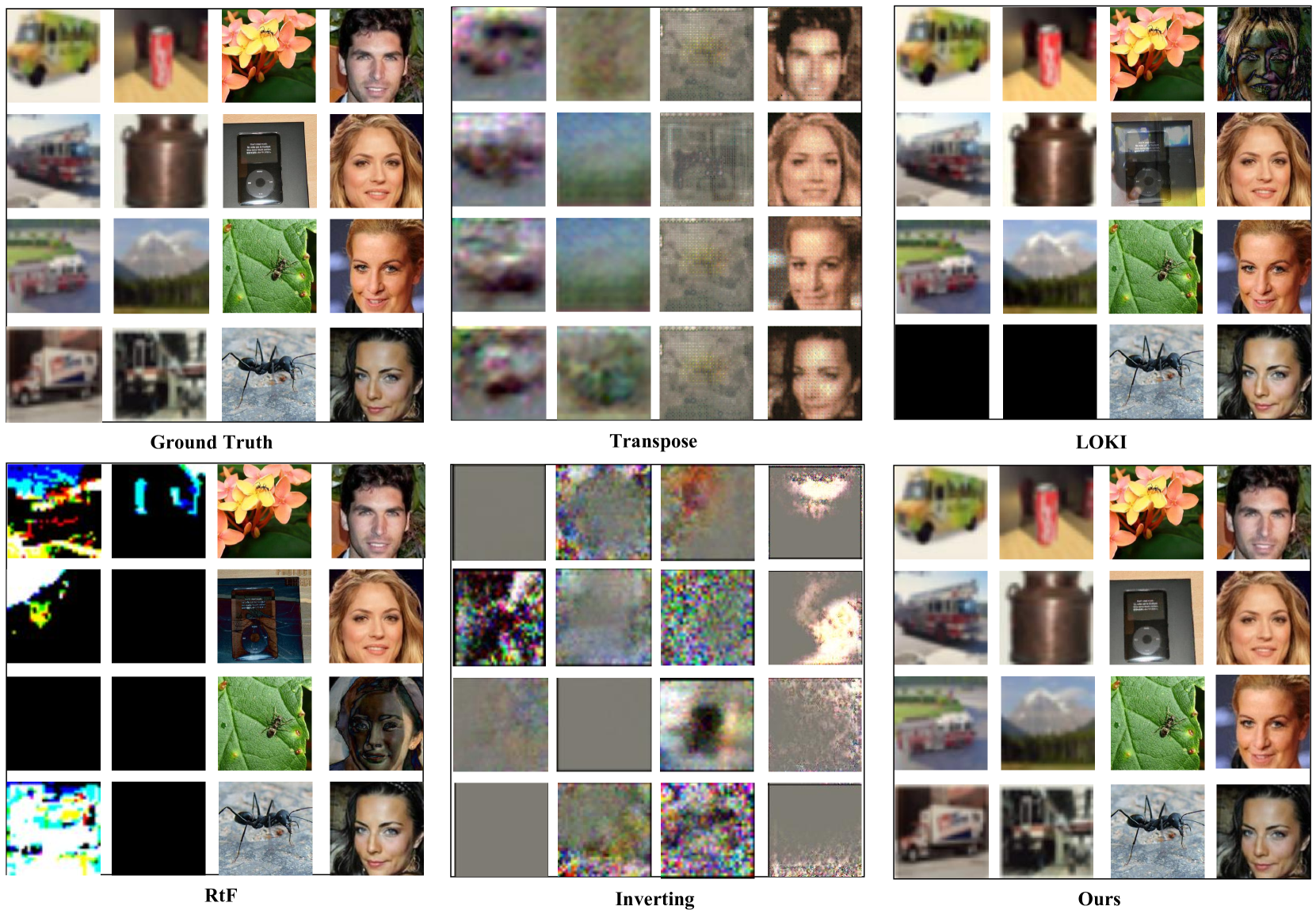

- 实验表明,该方法优于现有数据重建攻击,能处理大规模高分辨率数据,且不易被现有防御方法检测。

📝 摘要(中文)

联邦学习(FL)作为一种在广泛和分散的数据集上进行机器学习的范例而出现,它承诺通过消除直接数据共享的需求来增强隐私。然而,最近的研究表明,攻击者可以通过模型操纵或梯度分析来窃取私人数据。现有的攻击受到盗取数量少或数据分辨率低的限制,并且通常通过梯度或权重中的异常监控来检测。在本文中,我们提出了一种新颖的数据重建攻击,该攻击利用恶意代码注入,并由两项关键技术支持,即独特而稀疏的编码设计和块分区。与需要对模型进行可检测更改的传统方法不同,我们的方法使用参数共享隐蔽地嵌入隐藏模型,以系统地提取敏感数据。基于斐波那契的索引设计确保了对记忆数据的有效、结构化检索,而块分区方法通过将高分辨率图像划分为更小、更易于管理的单元来增强我们处理高分辨率图像的能力。在4个数据集上进行的大量实验证实,我们的方法优于五种最先进的数据重建攻击以及五种相应的检测方法。我们的方法可以处理大规模和高分辨率数据,而不会被最先进的数据重建防御方法检测或缓解。与基线相比,我们的方法可以直接应用于FedAVG和FedSGD场景,突显了开发人员需要设计新的防御措施来应对此类漏洞。我们将在接受后开源我们的代码。

🔬 方法详解

问题定义:联邦学习虽然旨在保护用户隐私,但现有的攻击方法仍然可以窃取用户数据。然而,这些攻击通常存在局限性,例如窃取的数据量较小、数据分辨率较低,或者容易被梯度或权重的异常检测机制发现。因此,如何在联邦学习中隐蔽且高效地窃取高分辨率的隐私数据是一个重要的研究问题。

核心思路:该论文的核心思路是利用恶意代码注入,在联邦学习模型中嵌入一个隐藏的模型,该模型通过参数共享的方式与主模型连接,从而可以在不引起明显异常的情况下,系统性地提取敏感数据。这种方法的关键在于如何设计隐藏模型的结构和编码方式,使其既能高效地存储和检索数据,又能保持隐蔽性。

技术框架:该攻击方法主要包含以下几个阶段:1) 恶意客户端注入:攻击者控制一个或多个客户端,将恶意代码注入到本地模型中。2) 隐藏模型嵌入:恶意代码在本地模型中嵌入一个隐藏模型,该模型通过参数共享与主模型连接。3) 数据编码:将需要窃取的数据编码成特定的格式,并存储在隐藏模型中。4) 模型训练:参与联邦学习的正常训练过程,隐藏模型也在同步更新。5) 数据提取:攻击者通过分析全局模型或本地模型,提取隐藏模型中存储的编码数据,并进行解码,从而恢复原始数据。

关键创新:该方法最重要的技术创新点在于其隐蔽性和高效性。与传统的攻击方法相比,该方法不需要对模型进行明显的修改,而是通过参数共享的方式嵌入隐藏模型,从而降低了被检测的风险。此外,该方法采用了基于斐波那契数列的索引设计和块分区方法,可以高效地存储和检索高分辨率的数据。

关键设计:1) 斐波那契索引:使用斐波那契数列作为索引,将数据分散存储在隐藏模型中,提高数据的检索效率。2) 块分区:将高分辨率图像分割成小的块,分别进行编码和存储,降低了单个块的数据量,提高了存储效率。3) 参数共享:隐藏模型与主模型共享部分参数,降低了隐藏模型对整体模型的影响,提高了隐蔽性。4) 损失函数:设计特定的损失函数,用于训练隐藏模型,使其能够有效地存储和检索数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在四个数据集上均优于五种最先进的数据重建攻击,且能够有效抵抗五种相应的检测方法。该方法能够处理大规模和高分辨率数据,且不易被现有的数据重建防御方法检测或缓解。与基线方法相比,该方法可以直接应用于FedAVG和FedSGD两种联邦学习场景。

🎯 应用场景

该研究揭示了联邦学习中一种新的隐私泄露风险,强调了在实际应用中加强联邦学习安全性的重要性。研究成果可用于开发更强大的防御机制,例如更精细的异常检测方法、模型审计技术和差分隐私保护机制,从而提升联邦学习系统的安全性,保护用户隐私数据。

📄 摘要(原文)

Federated Learning (FL) emerged as a paradigm for conducting machine learning across broad and decentralized datasets, promising enhanced privacy by obviating the need for direct data sharing. However, recent studies show that attackers can steal private data through model manipulation or gradient analysis. Existing attacks are constrained by low theft quantity or low-resolution data, and they are often detected through anomaly monitoring in gradients or weights. In this paper, we propose a novel data-reconstruction attack leveraging malicious code injection, supported by two key techniques, i.e., distinctive and sparse encoding design and block partitioning. Unlike conventional methods that require detectable changes to the model, our method stealthily embeds a hidden model using parameter sharing to systematically extract sensitive data. The Fibonacci-based index design ensures efficient, structured retrieval of memorized data, while the block partitioning method enhances our method's capability to handle high-resolution images by dividing them into smaller, manageable units. Extensive experiments on 4 datasets confirmed that our method is superior to the five state-of-the-art data-reconstruction attacks under the five respective detection methods. Our method can handle large-scale and high-resolution data without being detected or mitigated by state-of-the-art data reconstruction defense methods. In contrast to baselines, our method can be directly applied to both FedAVG and FedSGD scenarios, underscoring the need for developers to devise new defenses against such vulnerabilities. We will open-source our code upon acceptance.