Enhancing LLM Reasoning via Critique Models with Test-Time and Training-Time Supervision

作者: Zhiheng Xi, Dingwen Yang, Jixuan Huang, Jiafu Tang, Guanyu Li, Yiwen Ding, Wei He, Boyang Hong, Shihan Do, Wenyu Zhan, Xiao Wang, Rui Zheng, Tao Ji, Xiaowei Shi, Yitao Zhai, Rongxiang Weng, Jingang Wang, Xunliang Cai, Tao Gui, Zuxuan Wu, Qi Zhang, Xipeng Qiu, Xuanjing Huang, Yu-Gang Jiang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-11-25

备注: Preprint

💡 一句话要点

提出基于批判模型的LLM推理增强方法,提升复杂推理任务性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理增强 批判模型 自训练 数学推理

📋 核心要点

- 现有自反思和自纠正机制依赖于模型评估自身表现的能力,易受初始准确率、问题难度和缺乏外部反馈等因素限制。

- 论文提出分离推理和批判模型,批判模型提供步骤级反馈,在测试和训练时监督推理模型,提升复杂推理能力。

- 实验表明,该方法在困难问题上显著提升了推理模型的性能,尤其是在增加推理计算量和引入自训练过程后。

📝 摘要(中文)

本文提出了一种通过批判模型增强大型语言模型(LLM)推理能力的方法,尤其是在科学、编码和数学等复杂推理任务中。该方法采用双人博弈范式,将推理模型(actor)和批判模型分离,批判模型提供步骤级别的反馈,在测试和训练阶段监督推理模型。首先,提出了AutoMathCritique框架,用于自动收集批判数据,构建了一个包含76,321个响应和步骤级别反馈的数据集。使用该数据集微调语言模型,使其能够为数学推理生成自然语言反馈。实验表明,批判模型在测试时能够持续提高actor在困难问题上的性能,尤其是在增加推理计算量时。受此启发,将基于批判的监督引入actor的自训练过程,提出了一种循环批判的自提升方法,提高了actor的探索效率和解题多样性,从而构建了更强大的推理模型。最后,初步探索了通过批判监督训练自言自语推理模型,并展示了其潜力。

🔬 方法详解

问题定义:大型语言模型在解决科学、编码和数学等复杂推理任务时,需要进行深入的思考和反思。然而,现有方法如自反思和自纠正,依赖于模型自身评估其表现的能力,这会受到初始准确率、问题难度以及缺乏外部反馈等因素的限制,导致模型难以有效地进行推理。

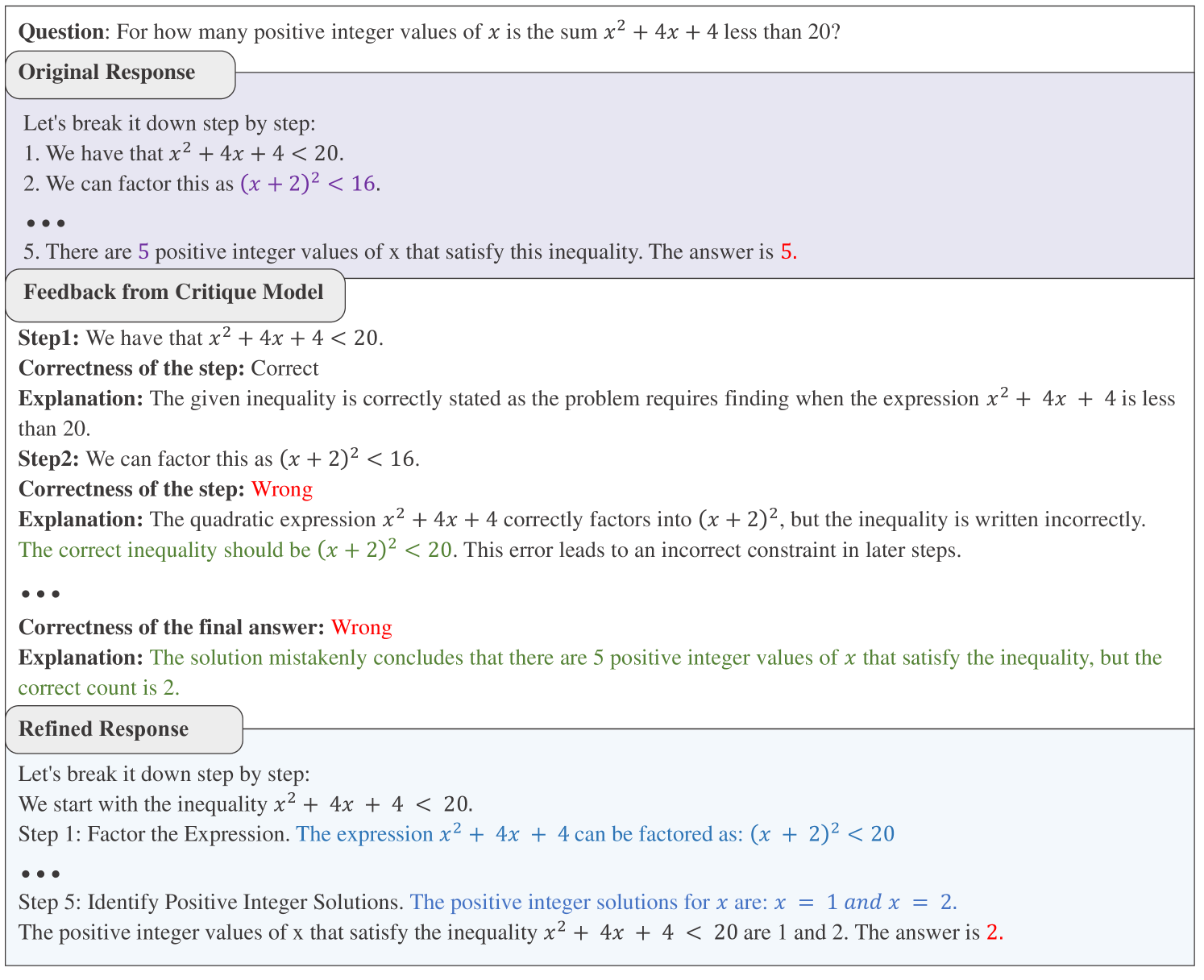

核心思路:论文的核心思路是将推理过程分解为两个角色:推理模型(actor)负责生成答案,批判模型负责对推理过程进行评估和提供反馈。通过这种分离,批判模型可以专注于识别推理过程中的错误和不足,并为推理模型提供更准确和有针对性的指导,从而提升整体的推理能力。

技术框架:整体框架包含两个主要模块:推理模型(Actor)和批判模型(Critique)。在测试阶段,Actor首先生成答案,然后Critique模型对Actor的推理步骤进行评估,并提供反馈。Actor根据反馈进行修正,重复此过程多次以优化答案。在训练阶段,利用AutoMathCritique框架自动生成批判数据,并使用这些数据微调Critique模型。然后,将Critique模型的反馈融入到Actor的自训练过程中,形成一个循环批判的自提升方法。

关键创新:该方法最重要的创新点在于引入了独立的批判模型,并将其与推理模型分离。这种分离使得批判模型能够更专注于评估推理过程,并提供更准确的反馈。此外,AutoMathCritique框架的提出,使得能够自动且大规模地生成批判数据,为训练批判模型提供了充足的资源。

关键设计:AutoMathCritique框架的设计是关键。它需要能够自动分析推理步骤,识别错误,并生成有意义的反馈。此外,在自训练过程中,如何有效地将批判模型的反馈融入到推理模型的训练中也是一个关键设计。例如,可以通过调整损失函数,使得推理模型更加关注批判模型的反馈,或者通过强化学习等方法,鼓励推理模型生成更符合批判模型期望的答案。

🖼️ 关键图片

📊 实验亮点

论文提出了AutoMathCritique框架,构建了一个包含76,321个响应和步骤级别反馈的数据集。实验结果表明,使用批判模型可以显著提高推理模型在困难问题上的性能。例如,在测试时,批判模型能够持续提高actor的性能,尤其是在增加推理计算量时。此外,通过循环批判的自提升方法,actor的探索效率和解题多样性得到了显著提升。

🎯 应用场景

该研究成果可广泛应用于需要复杂推理能力的领域,如自动化数学解题、代码生成、科学研究等。通过提升LLM的推理能力,可以提高自动化系统的准确性和效率,降低人工干预的需求。未来,该方法有望应用于教育领域,为学生提供个性化的学习辅导和反馈。

📄 摘要(原文)

Training large language models (LLMs) to spend more time thinking and reflection before responding is crucial for effectively solving complex reasoning tasks in fields such as science, coding, and mathematics. However, the effectiveness of mechanisms like self-reflection and self-correction depends on the model's capacity to accurately assess its own performance, which can be limited by factors such as initial accuracy, question difficulty, and the lack of external feedback. In this paper, we delve into a two-player paradigm that separates the roles of reasoning and critique models, where the critique model provides step-level feedback to supervise the reasoning (actor) model during both test-time and train-time. We first propose AutoMathCritique, an automated and scalable framework for collecting critique data, resulting in a dataset of $76,321$ responses paired with step-level feedback. Fine-tuning language models with this dataset enables them to generate natural language feedback for mathematical reasoning. We demonstrate that the critique models consistently improve the actor's performance on difficult queries at test-time, especially when scaling up inference-time computation. Motivated by these findings, we introduce the critique-based supervision to the actor's self-training process, and propose a critique-in-the-loop self-improvement method. Experiments show that the method improves the actor's exploration efficiency and solution diversity, especially on challenging queries, leading to a stronger reasoning model. Lastly, we take the preliminary step to explore training self-talk reasoning models via critique supervision and showcase its potential. Our code and datasets are at \href{https://mathcritique.github.io/}{https://mathcritique.github.io/}.