EnStack: An Ensemble Stacking Framework of Large Language Models for Enhanced Vulnerability Detection in Source Code

作者: Shahriyar Zaman Ridoy, Md. Shazzad Hossain Shaon, Alfredo Cuzzocrea, Mst Shapna Akter

分类: cs.SE, cs.CL

发布日期: 2024-11-25

备注: Accepted in 2024 IEEE International Conference on Big Data (IEEE BigData 2024)

💡 一句话要点

EnStack:一种基于大语言模型集成堆叠的源代码漏洞检测框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 漏洞检测 大语言模型 集成学习 代码分析 自然语言处理 软件安全 元分类器

📋 核心要点

- 现有软件漏洞检测方法难以应对现代代码库的复杂性和多样性,导致检测效果不佳。

- EnStack框架通过集成多个预训练大语言模型,并使用元分类器融合结果,提升漏洞检测能力。

- 实验表明,EnStack在准确率、精确率、召回率和F1分数上均显著优于现有方法。

📝 摘要(中文)

本文提出了一种名为EnStack的新型集成堆叠框架,旨在利用自然语言处理(NLP)技术增强软件漏洞的自动检测能力。该方法协同了多个预训练的大语言模型(LLM),包括用于语义分析的CodeBERT、用于结构表示的GraphCodeBERT以及用于跨模态能力的UniXcoder。通过在Draper VDISC数据集上对这些模型进行微调,并使用Logistic Regression、Support Vector Machines (SVM)、Random Forest和XGBoost等元分类器整合它们的输出,EnStack能够有效地捕获单个模型可能忽略的复杂代码模式和漏洞。元分类器整合了每个LLM的优势,形成了一个全面的模型,擅长检测各种编程环境中细微而复杂的漏洞。实验结果表明,EnStack显著优于现有方法,在准确率、精确率、召回率和F1分数方面均取得了显著提升。这项工作突出了集成LLM方法在代码分析任务中的潜力,并为应用NLP技术推进自动漏洞检测提供了有价值的见解。

🔬 方法详解

问题定义:论文旨在解决现有软件漏洞自动检测方法在处理复杂和多样化代码库时表现不佳的问题。现有方法难以有效捕获代码中细微和复杂的漏洞模式,导致检测准确率和召回率较低。

核心思路:论文的核心思路是利用集成学习的思想,将多个在代码理解方面具有不同优势的大语言模型(LLM)进行集成,通过元分类器融合它们的预测结果,从而综合利用各个模型的优点,提高漏洞检测的准确性和鲁棒性。这种方法旨在克服单个模型可能存在的局限性,更全面地理解代码的语义和结构信息。

技术框架:EnStack框架主要包含以下几个阶段:1) 选择并微调多个预训练的大语言模型,包括CodeBERT、GraphCodeBERT和UniXcoder,使其适应漏洞检测任务。2) 使用微调后的LLM对输入代码进行分析,得到各自的预测结果。3) 使用元分类器(如Logistic Regression、SVM、Random Forest、XGBoost)将各个LLM的预测结果进行融合,得到最终的漏洞检测结果。

关键创新:EnStack的关键创新在于其集成了多个具有不同代码理解能力的大语言模型,并使用元分类器进行融合。与传统的单一模型方法相比,EnStack能够更全面地捕获代码的语义和结构信息,从而提高漏洞检测的准确性。此外,使用元分类器进行融合可以有效地平衡各个模型的贡献,避免某个模型的偏差对最终结果产生过大的影响。

关键设计:论文的关键设计包括:1) 选择合适的预训练大语言模型,并根据漏洞检测任务进行微调。2) 选择合适的元分类器,并对其参数进行优化,以实现最佳的融合效果。3) 使用Draper VDISC数据集进行训练和评估,该数据集包含各种类型的软件漏洞,可以有效地评估模型的泛化能力。具体的损失函数和网络结构细节在论文中可能没有详细描述,属于未知信息。

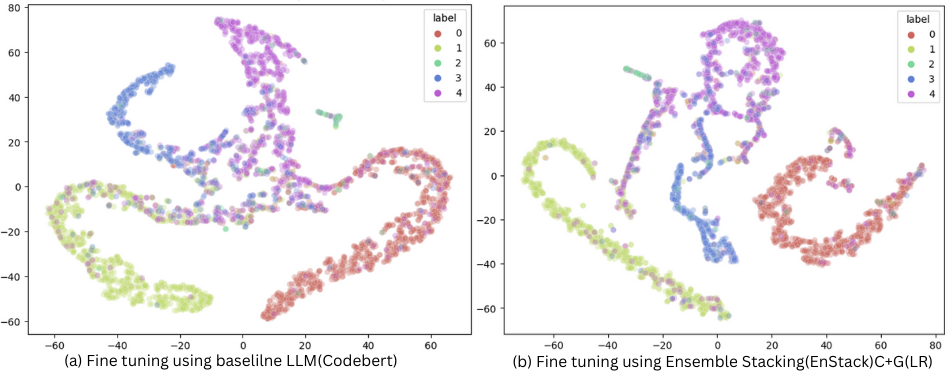

🖼️ 关键图片

📊 实验亮点

实验结果表明,EnStack框架在Draper VDISC数据集上取得了显著的性能提升,在准确率、精确率、召回率和F1分数方面均优于现有方法。具体的性能数据和提升幅度在摘要中有所提及,但未给出具体数值。EnStack的成功验证了集成LLM方法在代码分析任务中的有效性。

🎯 应用场景

EnStack框架可应用于软件开发生命周期的各个阶段,例如代码审查、静态代码分析和安全测试。它可以帮助开发人员和安全专家更有效地检测和修复软件漏洞,从而提高软件的安全性和可靠性。该研究的成果有助于推动自动漏洞检测技术的发展,并为构建更安全的软件系统提供有力支持。

📄 摘要(原文)

Automated detection of software vulnerabilities is critical for enhancing security, yet existing methods often struggle with the complexity and diversity of modern codebases. In this paper, we introduce EnStack, a novel ensemble stacking framework that enhances vulnerability detection using natural language processing (NLP) techniques. Our approach synergizes multiple pre-trained large language models (LLMs) specialized in code understanding CodeBERT for semantic analysis, GraphCodeBERT for structural representation, and UniXcoder for cross-modal capabilities. By fine-tuning these models on the Draper VDISC dataset and integrating their outputs through meta-classifiers such as Logistic Regression, Support Vector Machines (SVM), Random Forest, and XGBoost, EnStack effectively captures intricate code patterns and vulnerabilities that individual models may overlook. The meta-classifiers consolidate the strengths of each LLM, resulting in a comprehensive model that excels in detecting subtle and complex vulnerabilities across diverse programming contexts. Experimental results demonstrate that EnStack significantly outperforms existing methods, achieving notable improvements in accuracy, precision, recall, and F1-score. This work highlights the potential of ensemble LLM approaches in code analysis tasks and offers valuable insights into applying NLP techniques for advancing automated vulnerability detection.