SAGEval: The frontiers of Satisfactory Agent based NLG Evaluation for reference-free open-ended text

作者: Reshmi Ghosh, Tianyi Yao, Lizzy Chen, Sadid Hasan, Tianwei Chen, Dario Bernal, Huitian Jiao, H M Sajjad Hossain

分类: cs.CL, cs.MA

发布日期: 2024-11-25

💡 一句话要点

提出SAGEval框架,利用批判Agent提升无参考开放文本生成评估质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自然语言生成评估 无参考评估 大型语言模型 批判Agent 文本质量评估

📋 核心要点

- 现有NLG评估方法依赖参考标签,但在开放式文本生成场景中,参考标签往往缺失或不足,限制了评估的有效性。

- SAGEval框架引入批判Agent,通过对LLM评估器输出的分数进行反馈和修正,从而在无参考标签的情况下提升评估质量。

- 实验表明,SAGEval框架能够有效纠正LLM评估器的评分偏差,降低对标注数据的依赖,尤其适用于复杂NLG评估场景。

📝 摘要(中文)

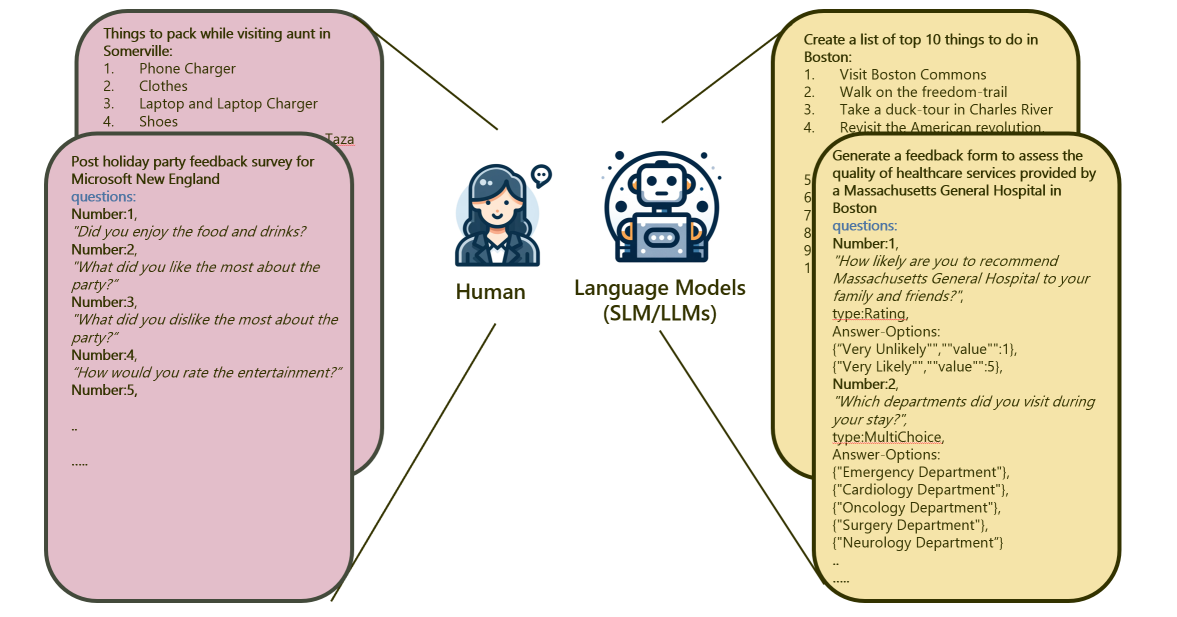

大型语言模型(LLM)集成到Microsoft365和Google Workspace等应用程序中,用于创建/处理文档、电子邮件、演示文稿等,显著提高了生产力和节省了时间。但随着这些集成变得越来越复杂,确保LLM集成应用程序的输出质量与使用相关且适当至关重要。本文针对自然语言生成开发稳健的评估方法的需求,在没有参考/ground truth标签或标签不充足的情况下,引入了一种名为“SAGEval”的新框架,该框架利用批判Agent来提供对LLM评估器生成的分数的反馈。我们表明,在没有参考/ground-truth标签的情况下,批判Agent能够纠正LLM评估器的分数,从而减少了对标记数据的需求,即使对于复杂的NLG评估场景,例如生成具有不同风格响应(如多项选择、李克特量表、单选题等)的JSON结构化表单/调查。

🔬 方法详解

问题定义:论文旨在解决在缺乏参考标签的情况下,如何对开放式自然语言生成(NLG)任务进行有效评估的问题。现有方法依赖于人工标注或参考文本,但在许多实际应用场景中,获取高质量的参考文本成本高昂或根本不可行,导致评估结果不准确或不可靠。

核心思路:SAGEval的核心思路是引入一个批判Agent,该Agent能够对LLM评估器给出的评分进行审查和修正。批判Agent通过分析生成文本的质量和一致性,识别LLM评估器可能存在的偏差,并对评分进行调整,从而提高评估的准确性和可靠性。这种方法模拟了人工评估的过程,但避免了人工标注的成本和主观性。

技术框架:SAGEval框架主要包含两个模块:LLM评估器和批判Agent。LLM评估器负责对生成的文本进行初步评分,可以使用各种现有的LLM评估模型。批判Agent接收LLM评估器的评分和生成的文本作为输入,然后利用自身的知识和推理能力对评分进行修正。批判Agent的输出是最终的评估分数。整个流程无需参考文本,实现了无参考的NLG评估。

关键创新:SAGEval的关键创新在于引入了批判Agent,该Agent能够模拟人工评估的过程,对LLM评估器的评分进行审查和修正。这种方法有效地解决了在缺乏参考标签的情况下进行NLG评估的难题,降低了对标注数据的依赖。此外,SAGEval框架具有很强的通用性,可以与各种LLM评估器结合使用,适用于不同的NLG任务和场景。

关键设计:批判Agent的设计是SAGEval框架的关键。论文中,批判Agent通常采用一个预训练的语言模型,并使用少量标注数据进行微调,使其能够识别LLM评估器可能存在的偏差。批判Agent的损失函数通常包括两部分:一部分是与人工评估结果的差异,另一部分是与LLM评估器评分的差异。通过优化损失函数,批判Agent能够学习到如何有效地修正LLM评估器的评分。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了SAGEval框架的有效性。实验结果表明,在缺乏参考标签的情况下,SAGEval框架能够显著提高NLG评估的准确性和可靠性。与传统的LLM评估器相比,SAGEval框架能够更准确地识别生成文本的质量问题,并给出更合理的评分。此外,实验还表明,SAGEval框架能够有效地降低对标注数据的依赖,减少人工评估的成本。

🎯 应用场景

SAGEval框架可广泛应用于各种自然语言生成任务的评估,例如机器翻译、文本摘要、对话生成等。尤其适用于那些缺乏参考标签或难以获取高质量参考标签的场景。该框架可以帮助开发者快速评估和改进NLG模型,提高生成文本的质量和用户体验。此外,SAGEval还可以用于自动化评估流程,降低人工评估的成本和时间。

📄 摘要(原文)

Large Language Model (LLM) integrations into applications like Microsoft365 suite and Google Workspace for creating/processing documents, emails, presentations, etc. has led to considerable enhancements in productivity and time savings. But as these integrations become more more complex, it is paramount to ensure that the quality of output from the LLM-integrated applications are relevant and appropriate for use. Identifying the need to develop robust evaluation approaches for natural language generation, wherein references/ground labels doesn't exist or isn't amply available, this paper introduces a novel framework called "SAGEval" which utilizes a critiquing Agent to provide feedback on scores generated by LLM evaluators. We show that the critiquing Agent is able to rectify scores from LLM evaluators, in absence of references/ground-truth labels, thereby reducing the need for labeled data even for complex NLG evaluation scenarios, like the generation of JSON-structured forms/surveys with responses in different styles like multiple choice, likert ratings, single choice questions, etc.