Generative Prompt Internalization

作者: Haebin Shin, Lei Ji, Yeyun Gong, Sungdong Kim, Eunbi Choi, Minjoon Seo

分类: cs.CL, cs.AI

发布日期: 2024-11-24 (更新: 2025-03-25)

备注: NAACL 2025 (Main Conference)

💡 一句话要点

提出生成式Prompt内化方法GenPI,解决大模型应用中Prompt过长导致的计算开销问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Prompt内化 生成式模型 大型语言模型 Agent应用 数据合成 联合训练 计算效率

📋 核心要点

- 现有大模型应用Prompt固定且冗长,导致计算开销大,限制了实际应用。

- GenPI通过联合训练,使模型不仅模仿带Prompt的行为,还能生成Prompt内容及其影响原因。

- GenPI无需显式Prompt即可实现高性能推理,并通过数据合成技术解决训练数据不足问题。

📝 摘要(中文)

本文提出了一种轻量级方法——生成式Prompt内化(GenPI),它采用联合训练方法,旨在解决基于大型语言模型的应用中Prompt固定且冗长导致计算开销大的问题。GenPI不仅能够复现带Prompt输入模型的行为,还能生成Prompt的内容以及模型行为相应改变的原因。实验表明,该方法能够有效地内化各种基于Agent的应用场景中的复杂Prompt。为了在没有与专用环境交互的情况下进行有效训练,我们引入了一种数据合成技术,通过交换Agent和环境的角色来自动收集对话数据集。这种方法在只有预定义Prompt而没有相应训练数据集的情况下尤其有用。通过内化复杂Prompt,生成式Prompt内化能够在不需要显式Prompt的情况下实现高性能和高效推理。

🔬 方法详解

问题定义:论文旨在解决大型语言模型应用中,由于Prompt通常是固定且冗长的,导致计算开销显著增加的问题。现有方法依赖于显式的Prompt输入,这在资源受限的环境中变得难以接受,并且限制了模型的部署效率。

核心思路:GenPI的核心思路是将Prompt的信息“内化”到模型参数中,使其能够在没有显式Prompt的情况下,也能表现出与使用Prompt时相似的行为。通过让模型学习生成Prompt本身以及Prompt对行为的影响,从而实现对Prompt的隐式编码。

技术框架:GenPI采用联合训练框架。该框架包含两个主要部分:一是行为复制模块,用于模仿带Prompt的模型的行为;二是Prompt生成模块,用于生成Prompt的内容以及解释Prompt对模型行为的影响。此外,论文还提出了一种数据合成技术,通过交换Agent和环境的角色来自动生成对话数据集,以解决缺乏训练数据的问题。

关键创新:GenPI的关键创新在于它能够让模型学习生成Prompt,并理解Prompt对行为的影响。这与传统的Prompt工程方法不同,后者通常需要人工设计和调整Prompt。GenPI通过学习Prompt的内在逻辑,实现了Prompt的自动化和内化,从而提高了模型的效率和泛化能力。

关键设计:GenPI的关键设计包括:1) 联合训练目标,同时优化行为复制和Prompt生成;2) 数据合成策略,用于生成高质量的训练数据;3) 模型架构,需要能够同时处理行为预测和Prompt生成任务。具体的损失函数和网络结构细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

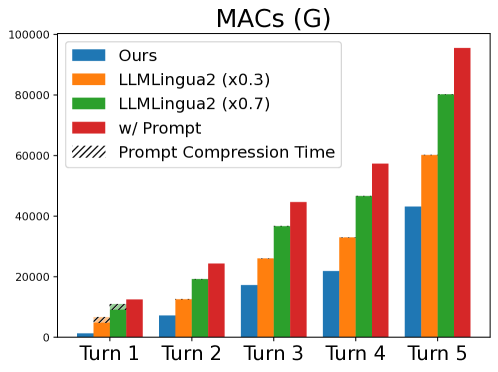

论文通过实验证明,GenPI能够有效地内化复杂Prompt,并在各种Agent应用场景中实现高性能和高效推理。具体的性能数据(如准确率、推理速度等)以及与基线方法的对比结果(如不使用GenPI的模型)需要在论文中查找(未知)。实验结果表明,GenPI能够在不牺牲性能的前提下,显著降低计算开销。

🎯 应用场景

GenPI可应用于各种Agent相关的应用场景,例如对话系统、游戏AI、智能助手等。通过内化Prompt,可以降低计算成本,提高推理效率,使得大模型能够部署在资源受限的设备上。此外,GenPI还可以用于Prompt工程的自动化,帮助研究人员更好地理解Prompt的作用机制,并设计更有效的Prompt。

📄 摘要(原文)

Prompts used in recent large language model based applications are often fixed and lengthy, leading to significant computational overhead. To address this challenge, we propose Generative Prompt Internalization (GenPI), a lightweight method that employs a joint training approach. GenPI not only replicates the behavior of models with prompt inputs but also generates the content of the prompt along with reasons for why the model's behavior should change accordingly. We demonstrate that our approach effectively internalizes complex prompts across various agent-based application scenarios. For effective training without interactions with the dedicated environments, we introduce a data synthesis technique that autonomously collects conversational datasets by swapping the roles of the agent and environment. This method is especially useful in scenarios where only a predefined prompt is available without a corresponding training dataset. By internalizing complex prompts, Generative Prompt Internalization enables high performance and efficient inference without the need for explicit prompts.