Towards a Middleware for Large Language Models

作者: Narcisa Guran, Florian Knauf, Man Ngo, Stefan Petrescu, Jan S. Rellermeyer

分类: cs.SE, cs.CL

发布日期: 2024-11-21

💡 一句话要点

面向企业级LLM部署,提出一种中间件架构以实现自主可控的LLM服务

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 中间件 企业级应用 自主可控 LLM即服务

📋 核心要点

- 企业希望自主托管LLM以满足隐私、成本和定制需求,但LLM的复杂性和集成难度构成挑战。

- 论文提出一种中间件系统架构,旨在简化LLM在企业中的部署和集成,使其能作为应用生态的网关。

- 该论文侧重于架构愿景的讨论,并未提供具体的实验结果或性能数据,属于概念验证阶段。

📝 摘要(中文)

大型语言模型(LLM)因其处理自然语言输入并从训练数据中生成洞见的能力而得到广泛应用,其能力已接近真正的人工智能。这种进步促使全球企业将LLM集成到其服务中。目前,这项工作主要由商业云解决方案主导,如OpenAI的ChatGPT和Microsoft Azure。然而,随着技术的成熟,出于隐私、成本和定制需求,企业有强烈的动机通过自托管“LLM即服务”来实现独立于大型云提供商。实际上,由于LLM的复杂性以及与现有系统的集成问题,独立托管LLM面临着巨大的挑战。在本文中,我们讨论了我们对前瞻性中间件系统架构的愿景,该架构有助于在企业中部署和采用LLM,即使是在高级用例中,我们预计LLM将充当完整应用程序生态系统的网关,并在某种程度上吸收传统上归因于中间件的功能。

🔬 方法详解

问题定义:企业在采用大型语言模型(LLM)时,面临着对商业云服务提供商的依赖,这带来了隐私、成本和定制方面的限制。自托管LLM虽然有吸引力,但由于LLM本身的复杂性以及与现有企业IT基础设施的集成困难,实施起来极具挑战。现有的中间件解决方案可能无法充分满足LLM的特殊需求,例如资源管理、模型版本控制、安全访问控制等。

核心思路:论文的核心思路是设计一种专门为LLM量身定制的中间件系统,该系统能够抽象底层LLM的复杂性,提供统一的接口供企业应用调用,并解决LLM部署和管理中的各种挑战。通过中间件,企业可以更轻松地将LLM集成到现有系统中,并实现对LLM的自主控制。

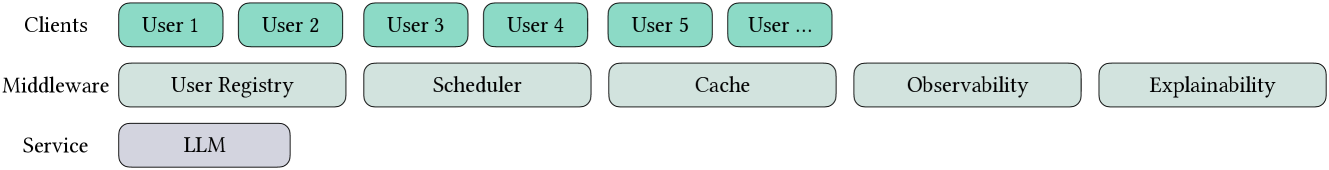

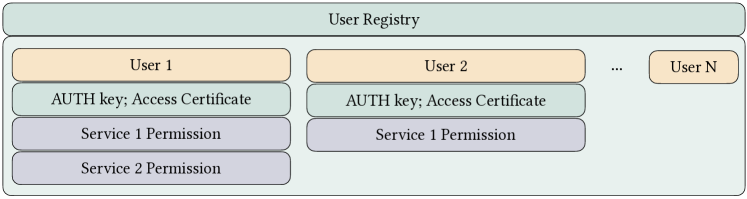

技术框架:论文提出了一种前瞻性的中间件系统架构,该架构旨在充当LLM与企业应用之间的桥梁。具体架构细节未在摘要中详细说明,但可以推测其可能包含以下模块:模型管理模块(负责LLM的部署、更新和版本控制)、资源调度模块(负责分配计算资源给LLM)、API网关模块(负责提供统一的API接口供应用调用)、安全模块(负责访问控制和数据安全)、监控模块(负责监控LLM的性能和健康状况)。

关键创新:该论文的关键创新在于提出了将LLM视为一种新型的中间件组件的视角。传统的中间件主要负责应用之间的集成和数据交换,而该论文设想的中间件不仅要集成LLM,还要让LLM承担一部分传统中间件的功能,例如业务逻辑处理和决策制定。这种设计思路能够更好地发挥LLM的潜力,并简化企业应用的开发和部署。

关键设计:由于论文主要讨论的是架构愿景,因此没有提供具体的参数设置、损失函数或网络结构等技术细节。未来的研究可以关注以下关键设计:如何设计高效的API接口以支持各种LLM应用场景?如何实现对LLM的细粒度访问控制?如何优化资源调度以提高LLM的利用率?如何监控LLM的性能并及时发现和解决问题?

🖼️ 关键图片

📊 实验亮点

该论文主要提出了一个面向企业级LLM部署的中间件架构愿景,旨在解决LLM集成和自主可控的难题。由于是概念性的架构设计,论文没有提供具体的实验结果或性能数据。未来的工作可以围绕该架构进行具体实现和性能评估。

🎯 应用场景

该研究成果可应用于各种需要自然语言处理能力的企业级应用,例如智能客服、自动化文档处理、知识图谱构建、内容生成等。通过该中间件,企业可以更便捷地将LLM集成到现有业务流程中,提升工作效率和智能化水平。未来,随着LLM技术的不断发展,该中间件有望成为企业数字化转型的重要基础设施。

📄 摘要(原文)

Large language models have gained widespread popularity for their ability to process natural language inputs and generate insights derived from their training data, nearing the qualities of true artificial intelligence. This advancement has prompted enterprises worldwide to integrate LLMs into their services. So far, this effort is dominated by commercial cloud-based solutions like OpenAI's ChatGPT and Microsoft Azure. As the technology matures, however, there is a strong incentive for independence from major cloud providers through self-hosting "LLM as a Service", driven by privacy, cost, and customization needs. In practice, hosting LLMs independently presents significant challenges due to their complexity and integration issues with existing systems. In this paper, we discuss our vision for a forward-looking middleware system architecture that facilitates the deployment and adoption of LLMs in enterprises, even for advanced use cases in which we foresee LLMs to serve as gateways to a complete application ecosystem and, to some degree, absorb functionality traditionally attributed to the middleware.